智能涌现

大模型是如何练成的

(预印本)

v1.0 2026年3月23日

致 谢

谨以此书献给我的妻子和女儿,

没有她们在精神上的支持,

我是没有信心开始本书的工作。

同时感谢各种 AI 工具,

没有它们在效率上的支持,

我是没有时间精力完成本书的。

序章:为什么你需要读这个系列

一个吃螃蟹的人的崩溃

2024年年底,我盯着屏幕上一份来自客户的需求文档,第一次认真怀疑自己是不是步子迈太大了。

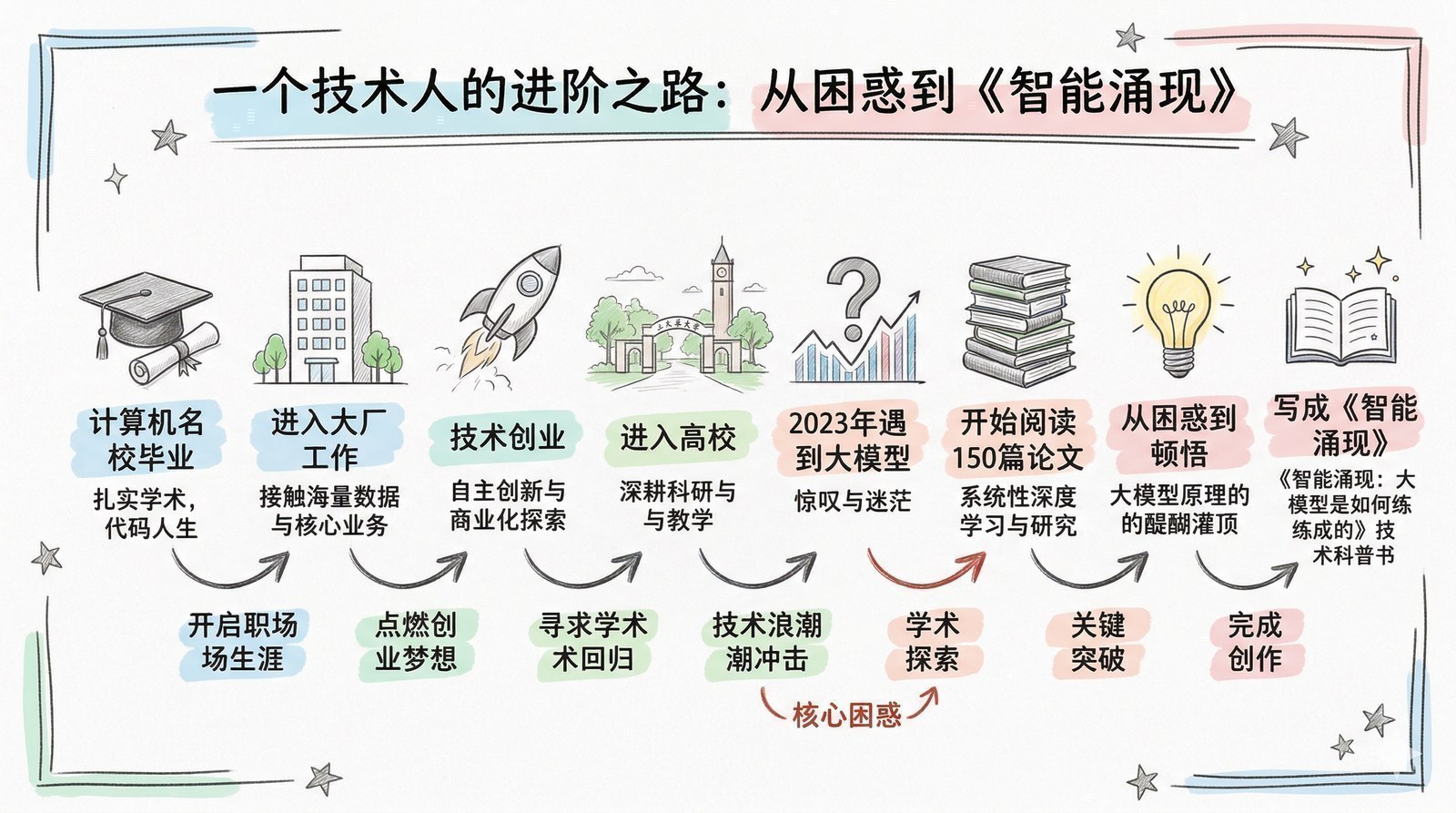

说来也好笑。十几年前我从计算机名校毕业,进了大厂做技术,后来出来创业,公司被收购,辗转几番回到高校做科技成果转化——说白了就是把实验室里的论文变成能解决真实问题的产品。听起来履历挺光鲜,但此刻坐在电脑前的我,和一个刚入行的实习生面对大模型时的困惑,其实没什么本质区别。

事情是这样的。2024年初,当大多数人还在讨论"大模型到底有没有用"的时候,我们团队已经开始接项目了——带着一股子"先干了再说"的劲头,成了行业里最早一批试图把大模型塞进真实业务场景的人。用今天时髦的话说,叫"AI落地先行者"。用更朴素的话说,叫"吃螃蟹的"。

螃蟹好不好吃暂且不论,先被扎了满手。

那个让我凌晨崩溃的项目,来自一家大型制造企业。他们想用AI自动审核供应商提交的技术规格书——几十页的PDF文档,混杂着表格、流程图、技术参数和手写批注。需求听起来合理:人工审核一份文档要两天,一年几千份,能不能用大模型压缩到两小时?

我的第一反应是"应该行吧"。毕竟GPT-4已经能看图了,openAI o1已经出现强大的推理能力了,多模态模型和推理模型一日千里。

然后现实给了我一记耳光。

模型能读懂合同里的文字,但读不准工程图纸上0.01mm精度的标注。能提取简单表格的数据,但遇到跨页合并单元格就乱了套。能总结一段话的意思,但没法在几十页文档中交叉比对前后矛盾的技术参数。

更要命的是接下来的决策——如果现在的模型做不到,我是该投入三个月自己造一个专用系统,还是再等三个月,等基座大模型迭代到能解决这个问题的水平?

这不是技术问题。这是赌注。赌错了方向,三个月的研发投入就打了水漂;等错了时间,客户就被竞争对手抢走了。

那天晚上我打开arXiv——一个科学论文搜索平台,搜了"multimodal document understanding",一篇论文引出另一篇,另一篇又引出十篇。我本以为会越读越迷糊,结果恰恰相反。

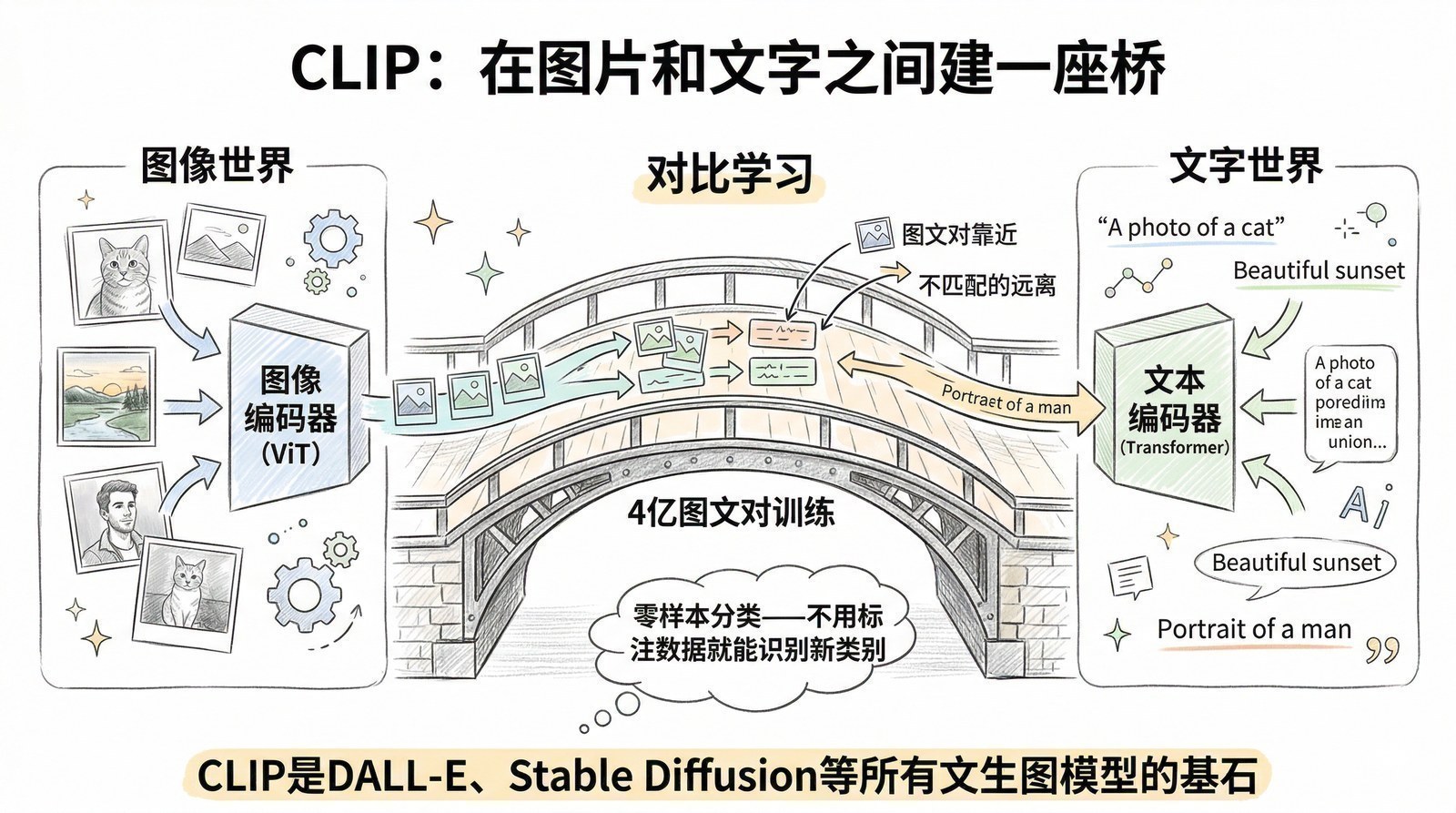

我发现自己陷入了一条清晰的线索:原来GPT-4的多模态能力[1]来自于2021年CLIP的对比学习思路[2],CLIP又站在了2020年SimCLR[3]和MoCo[4]这些对比学习方法的肩膀上,而这些方法又根植于2017年Transformer的自注意力架构[5]……

每一个我在项目中遇到的困惑——"为什么这个任务模型做不好""为什么那个能力突然出现了""下一步模型会往哪个方向进化"——答案都藏在这些论文里,写得清清楚楚、明明白白。

我只是之前从来没有系统地读过。

做了十几年技术,创过业,做过产品,自认为对技术趋势有一定的判断力。但面对大模型,我发现过去的经验框架几乎全部失效。这玩意儿的进化速度、涌现方式和迭代逻辑,和以往任何一次技术浪潮都不一样。你不能靠"直觉"来判断,你得回到论文里去找第一性原理。

于是那个夏天,一个吃螃蟹的人决定暂时放下螃蟹,先把菜谱研究明白。

150篇论文教会我的事

从那个夏天开始,我开始系统性地阅读AI和大模型领域的论文与技术报告。最初只是为了解决手头项目的困惑,但越读越停不下来。一年多的时间里,我读了超过150篇论文和技术报告——从2012年引爆深度学习的AlexNet[6],到2017年改写一切的Transformer[5],到2022年让全世界震惊的ChatGPT背后的InstructGPT[7],再到2025年DeepSeek-R1用纯强化学习"涌现"出推理能力[8]。

这150篇论文,在时间线上串起来,就是一部完整的"大模型进化史"。

让我说说它们教会了我什么。

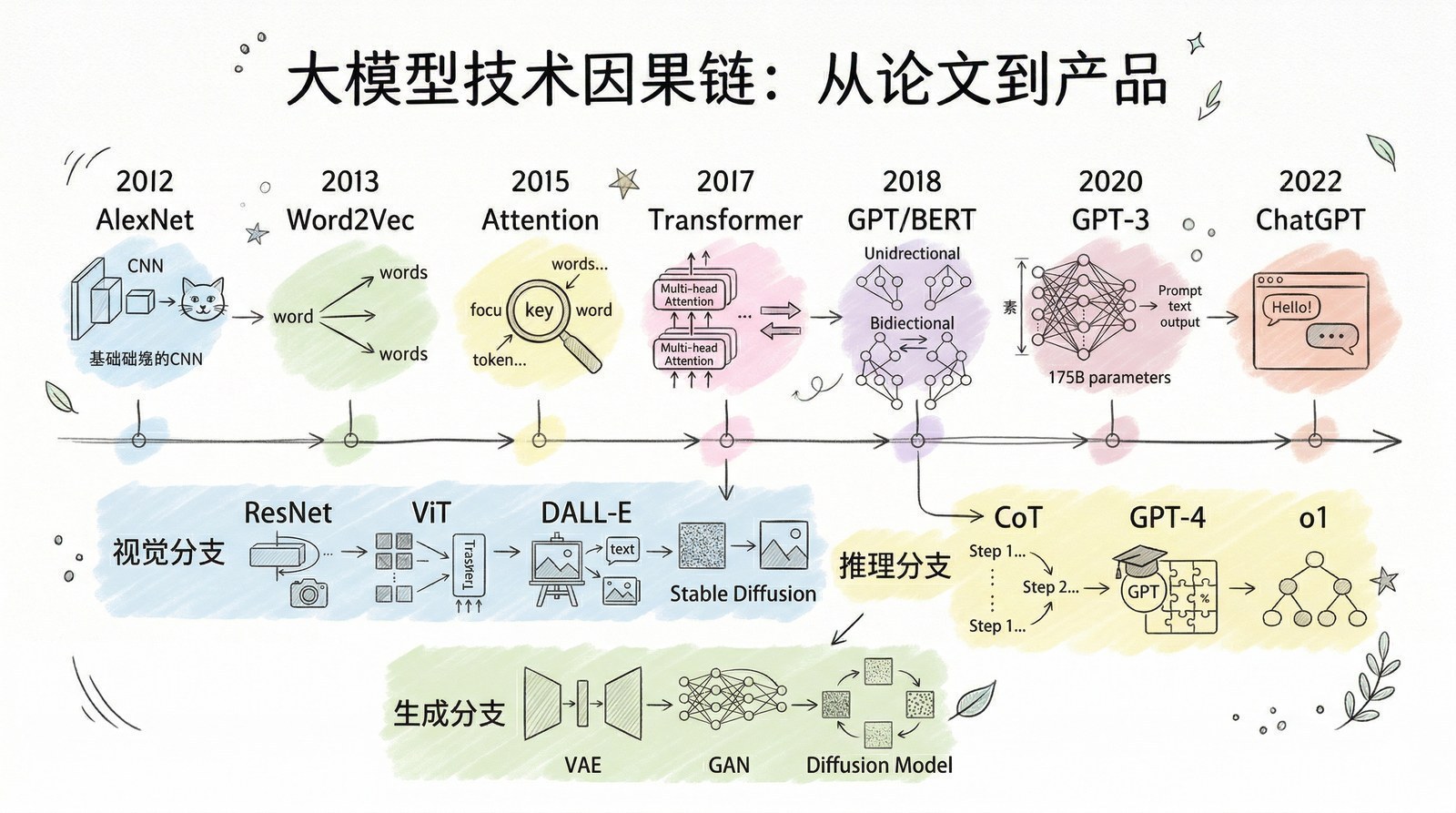

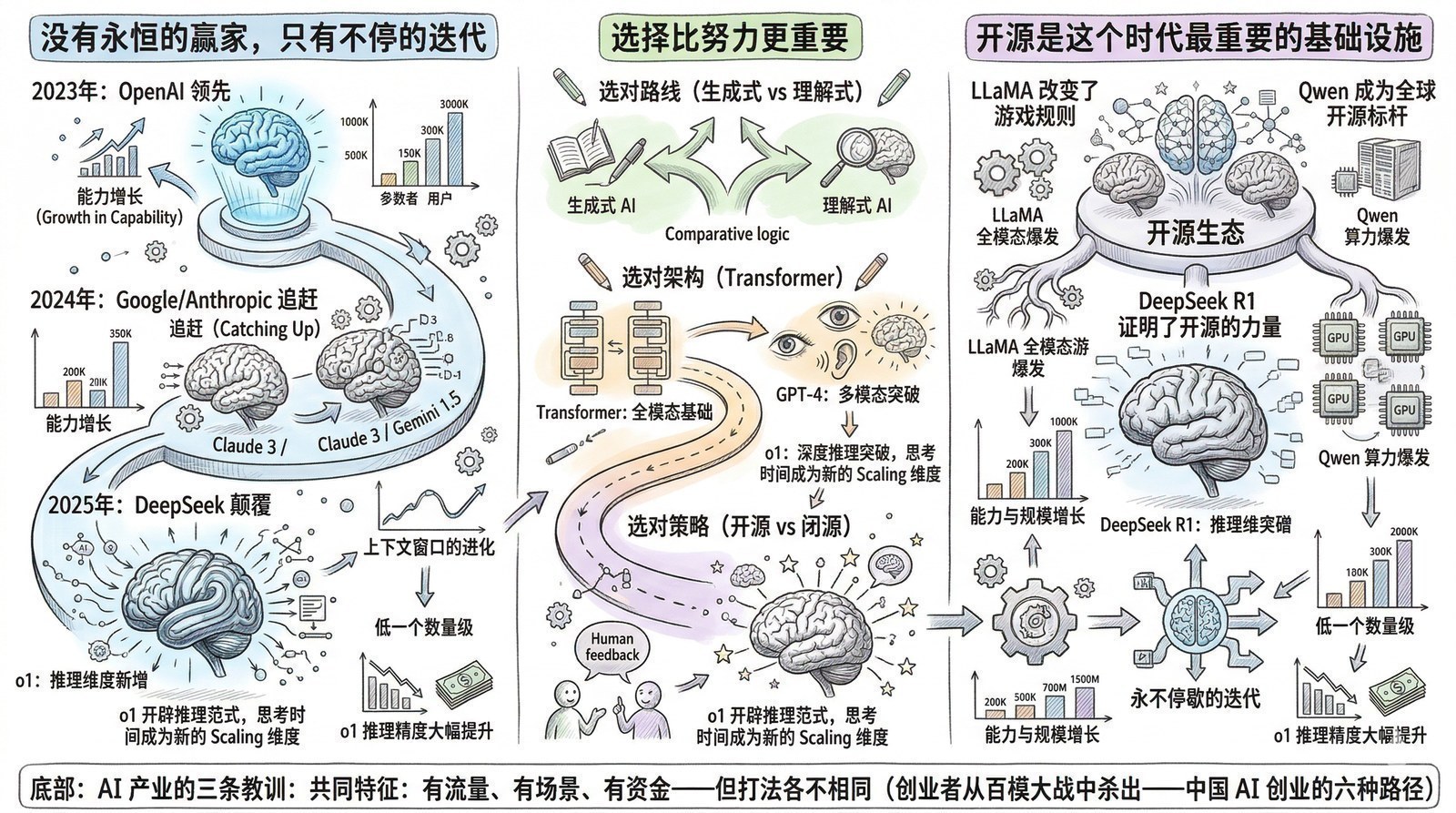

第一件事:大模型的每一次跃迁都不是凭空出现的,它有精确的因果链条。

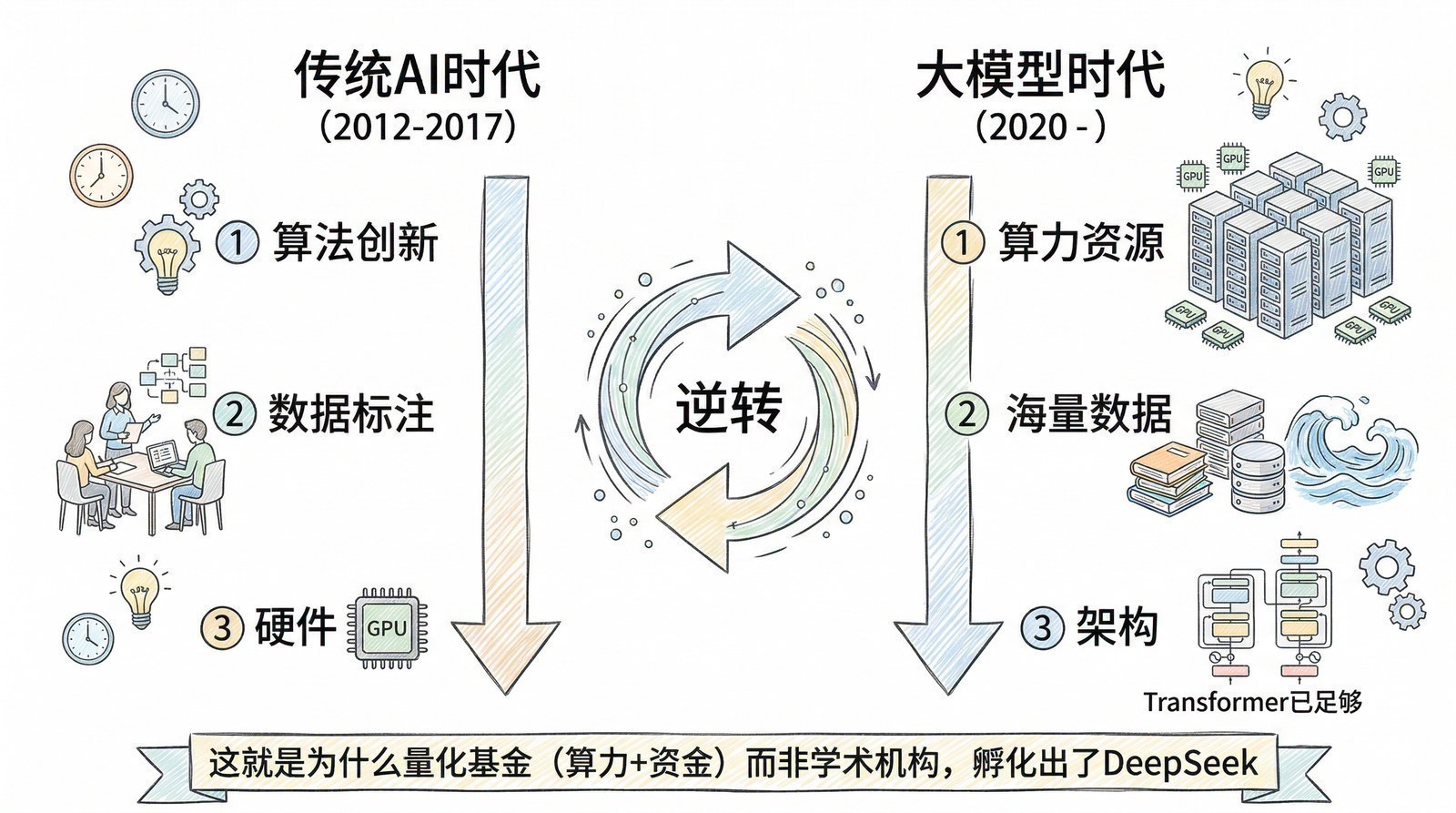

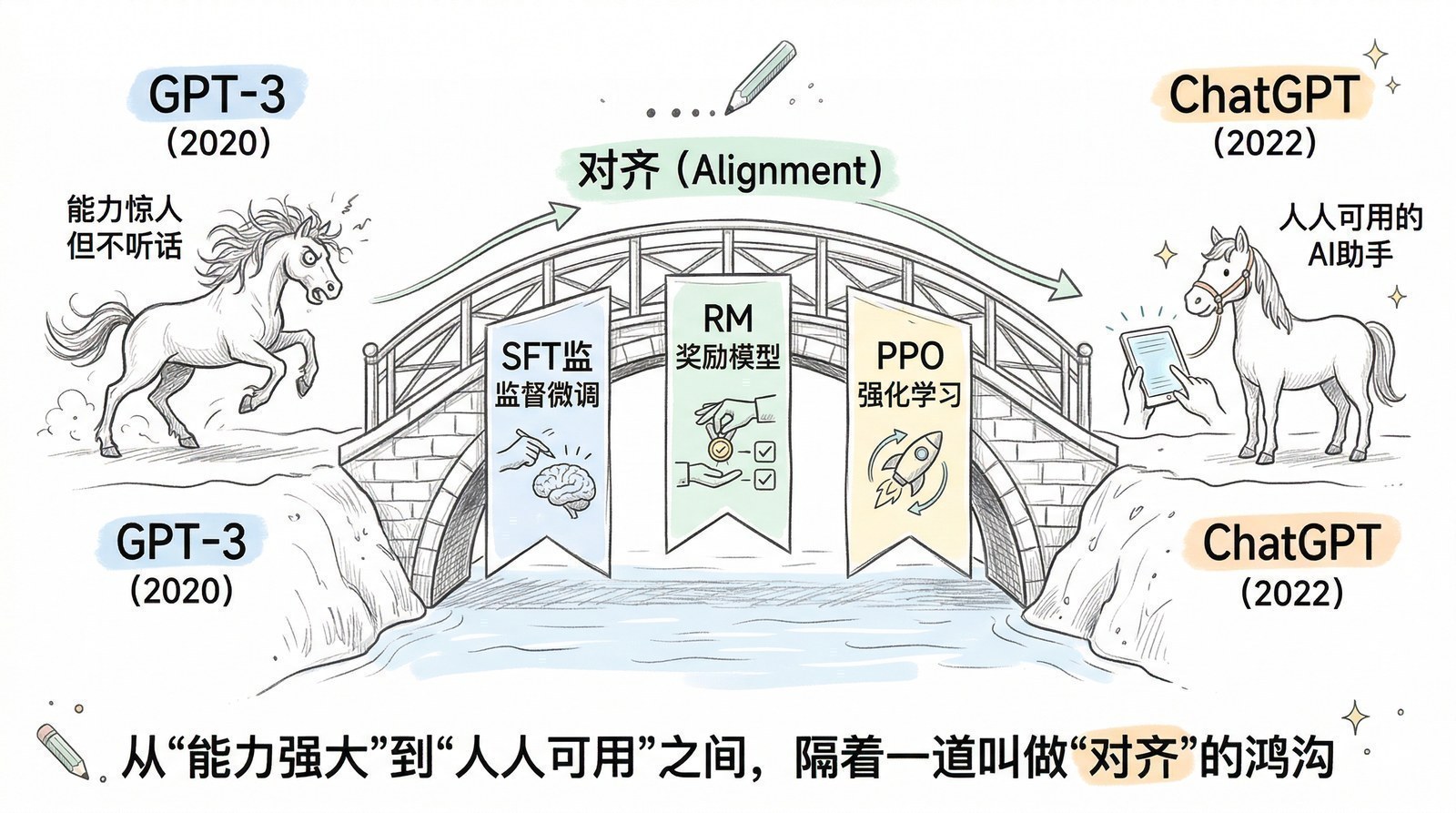

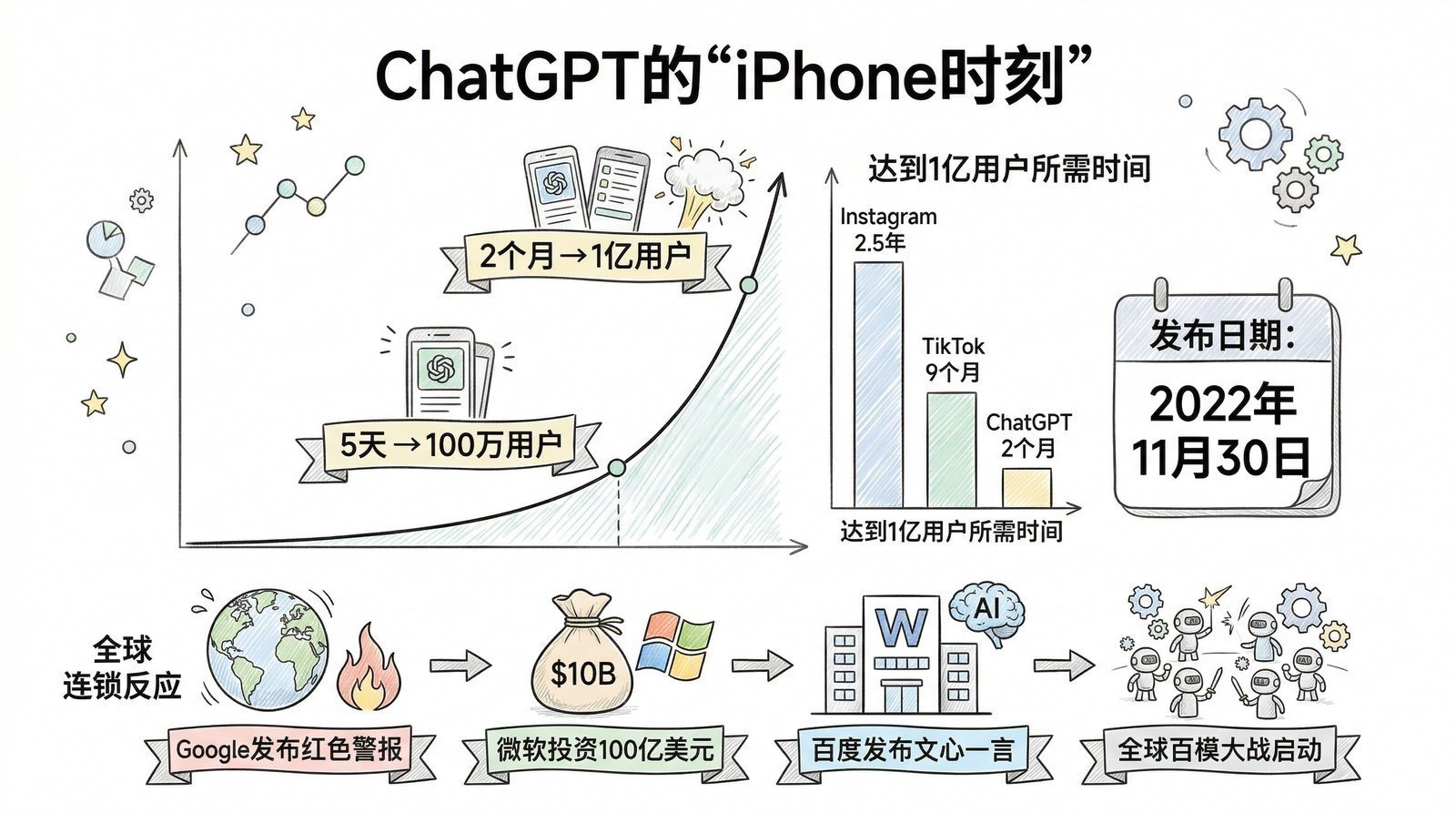

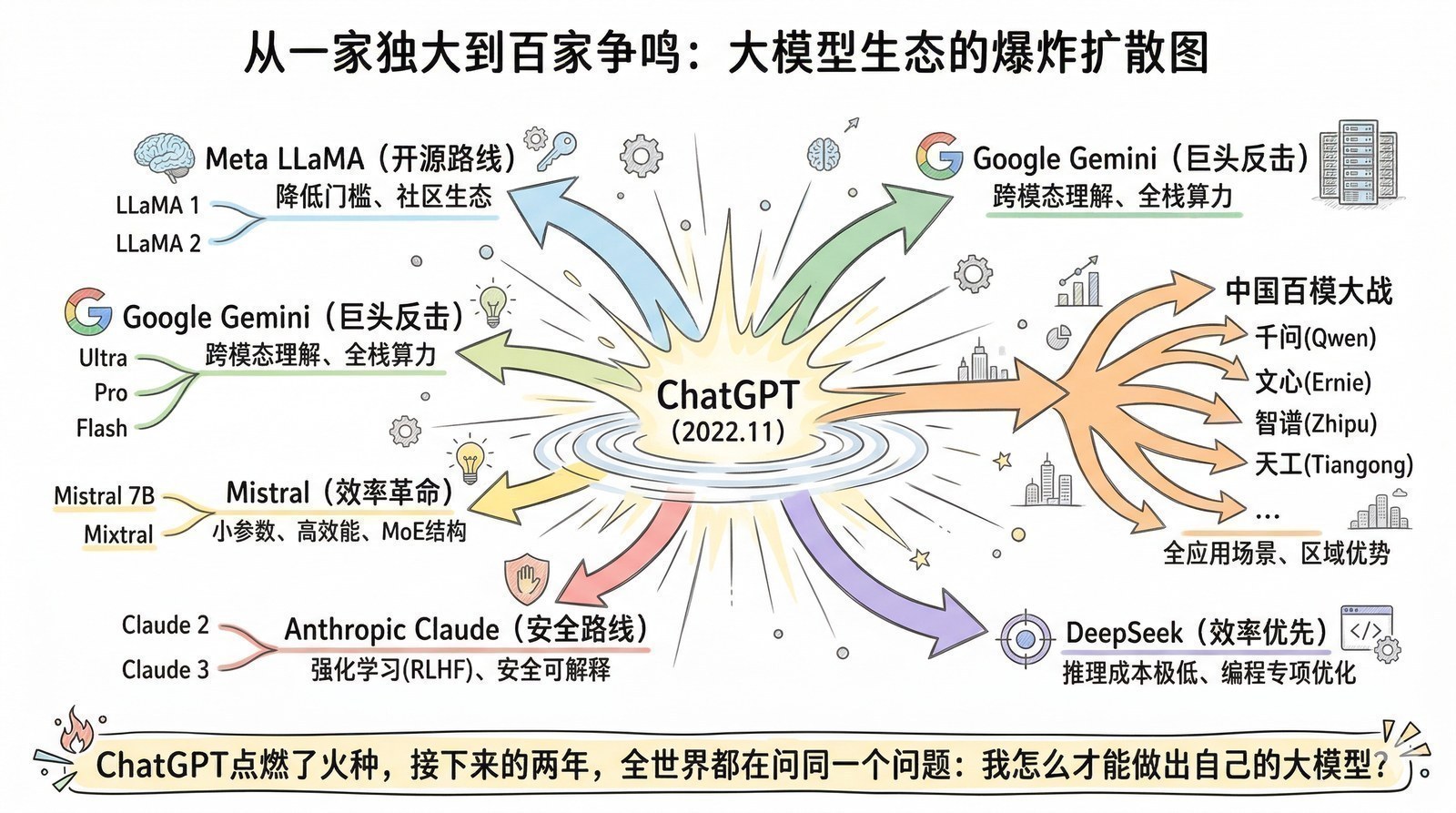

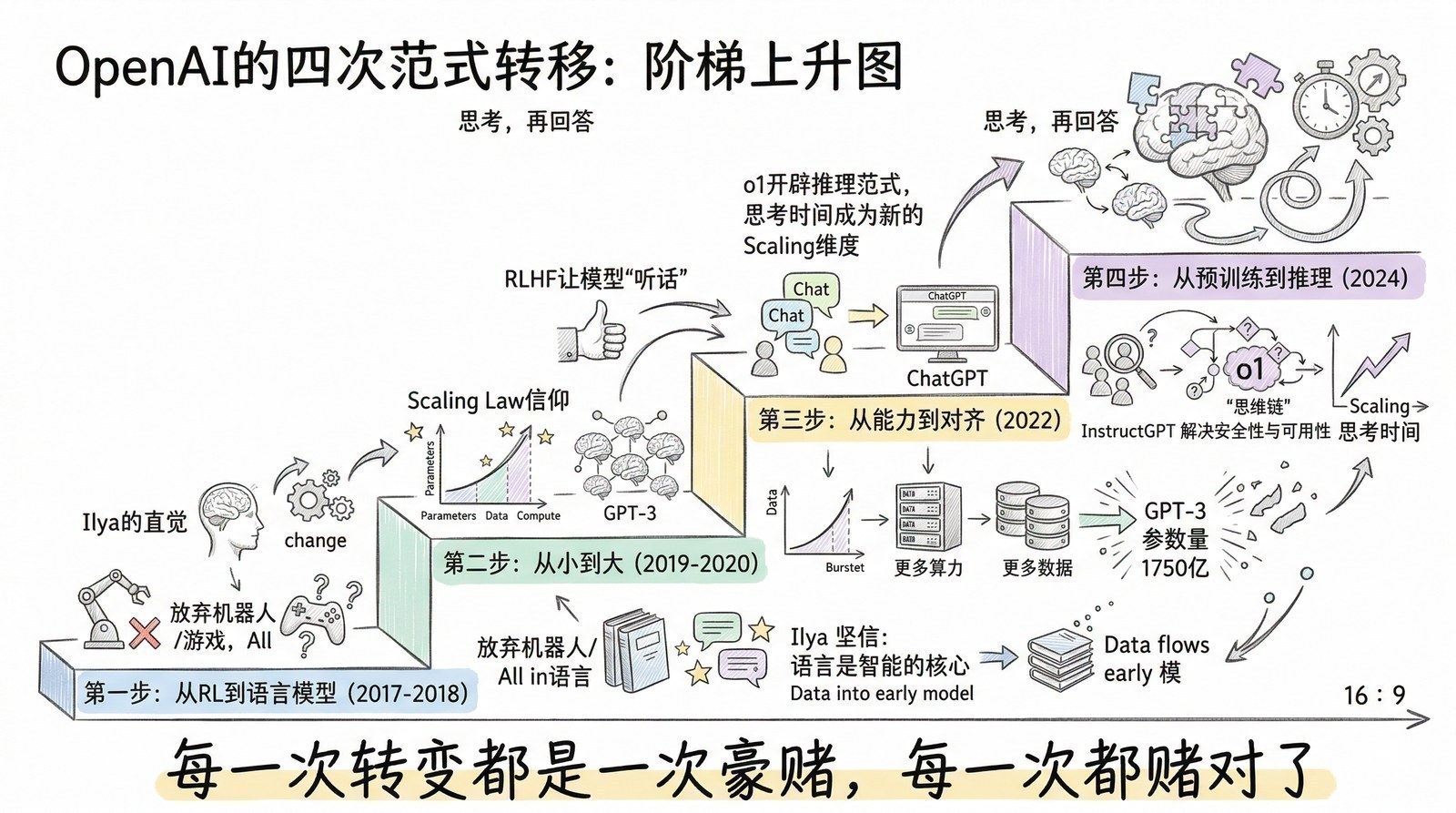

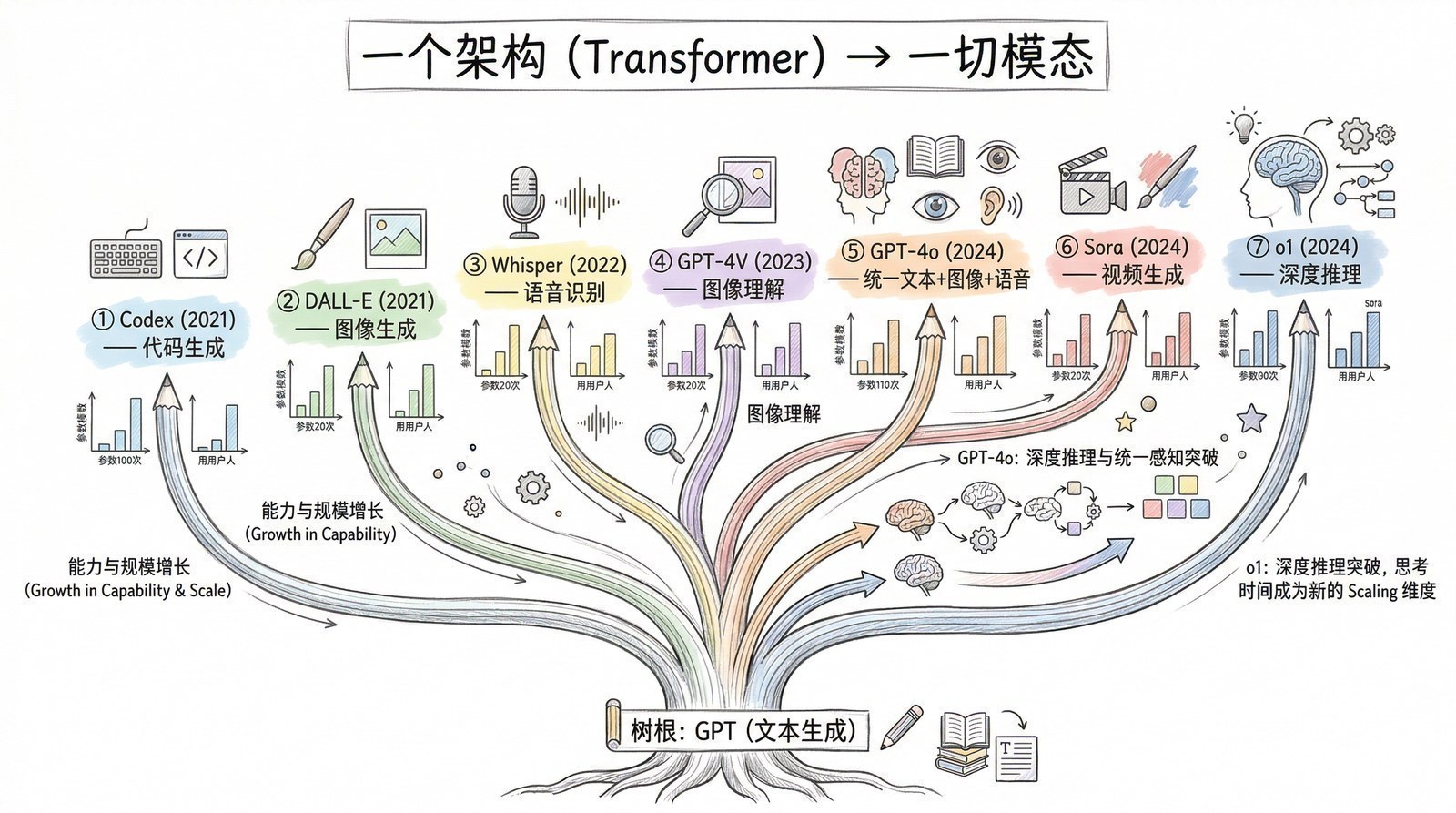

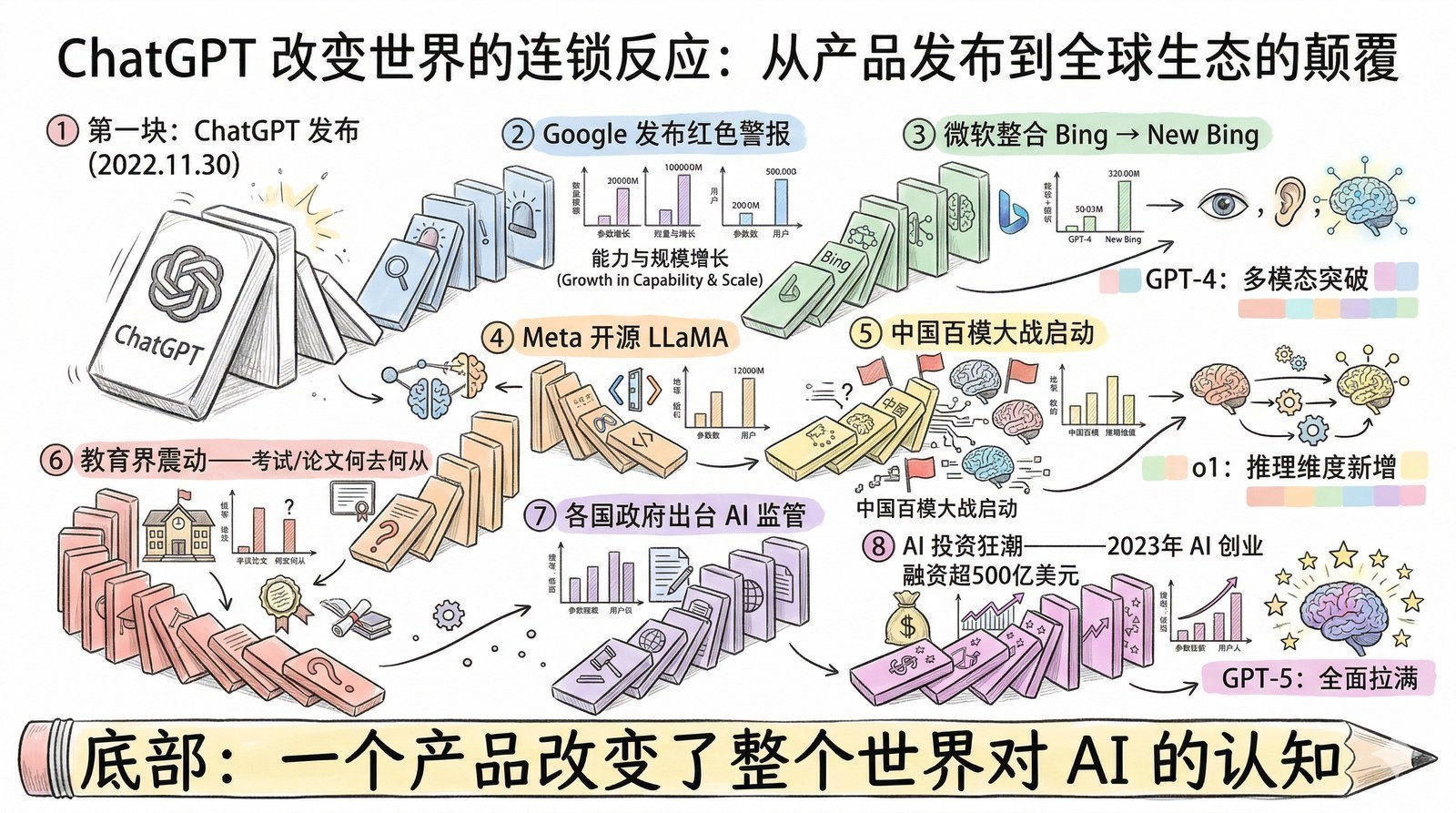

很多人觉得AI的发展是"突然爆发"的——2022年11月ChatGPT突然出现,好像一夜之间AI就无所不能了。但当你读完这些论文,你会发现ChatGPT的"一夜成名"背后是十年的积累:2012年AlexNet[6]证明深度学习可行 → 2017年Transformer[5]统一了模型架构 → 2018年GPT-1[9]证明"预测下一个词"是条好路 → 2020年GPT-3[10]证明规模出奇迹 → 2022年InstructGPT[7]用RLHF让模型"听话" → ChatGPT只不过是最后一块拼图落下的声音。

每一步都不可跳过,每一步都有论文记录。

第二件事:很多"做不到"的事,论文里已经告诉你什么时候能做到。

回到我那个凌晨两点的困惑。当我读完CLIP[2]、LLaVA、GPT-4V[1]这一系列多模态论文后,我明白了:2024年的大模型在"理解照片里的文字"这件事上已经相当不错了,但在"理解工程图纸上的精确标注"这件事上还差一大截。差距在哪里?在于训练数据中工程图纸太少、在于当前OCR模型对复杂版式的处理能力不够、在于多模态模型对表格结构的理解仍然脆弱。

这些不是我猜的。这些是论文里量化的benchmark数据告诉我的。

有了这些信息,决策就变得清晰了:核心的文本审核用大模型API,图纸识别的部分自研一个专用模块,表格提取用传统CV方案兜底。不需要赌,不需要等,也不需要焦虑。我们按照这个方案交付了项目,客户很满意。

但故事并没有结束。

大约一年后,2025年上半年,行业里突然密集发布了一批专攻文档理解的开源模型——DeepSeek发布了DeepSeek-OCR和OCR 2[11],百度持续迭代了PaddleOCR开源方案。这些模型在复杂表格还原、公式和数学符号识别、图片噪点过滤等方面有了质的飞跃。我在论文里读到的那些"还差一大截"的短板——一年后,开源社区用新的模型架构和训练数据把它们一个个补上了。

我们当初自研的那个"专用模块"?很快就被替换成了开源方案,效果更好,成本更低。

这个经历让我体会到了一种奇妙的节奏感:论文告诉你"现在做不到,瓶颈在哪里",然后行业的进化会告诉你"现在做到了,瓶颈被攻破了"。 你不需要预测未来,你只需要读懂当下的论文,就能在技术浪潮的节拍上踩准每一步——知道什么时候该自己造轮子,什么时候该等一等让行业替你把轮子造好。

这种感觉,就像是在看一本悬疑小说——论文是前面的伏笔,产品发布是后面的揭晓。只不过这个故事是真实发生的,而且还在不断续写。

第三件事:读懂了底层逻辑,焦虑就自然消退了。

过去两年,AI行业最不缺的就是焦虑。

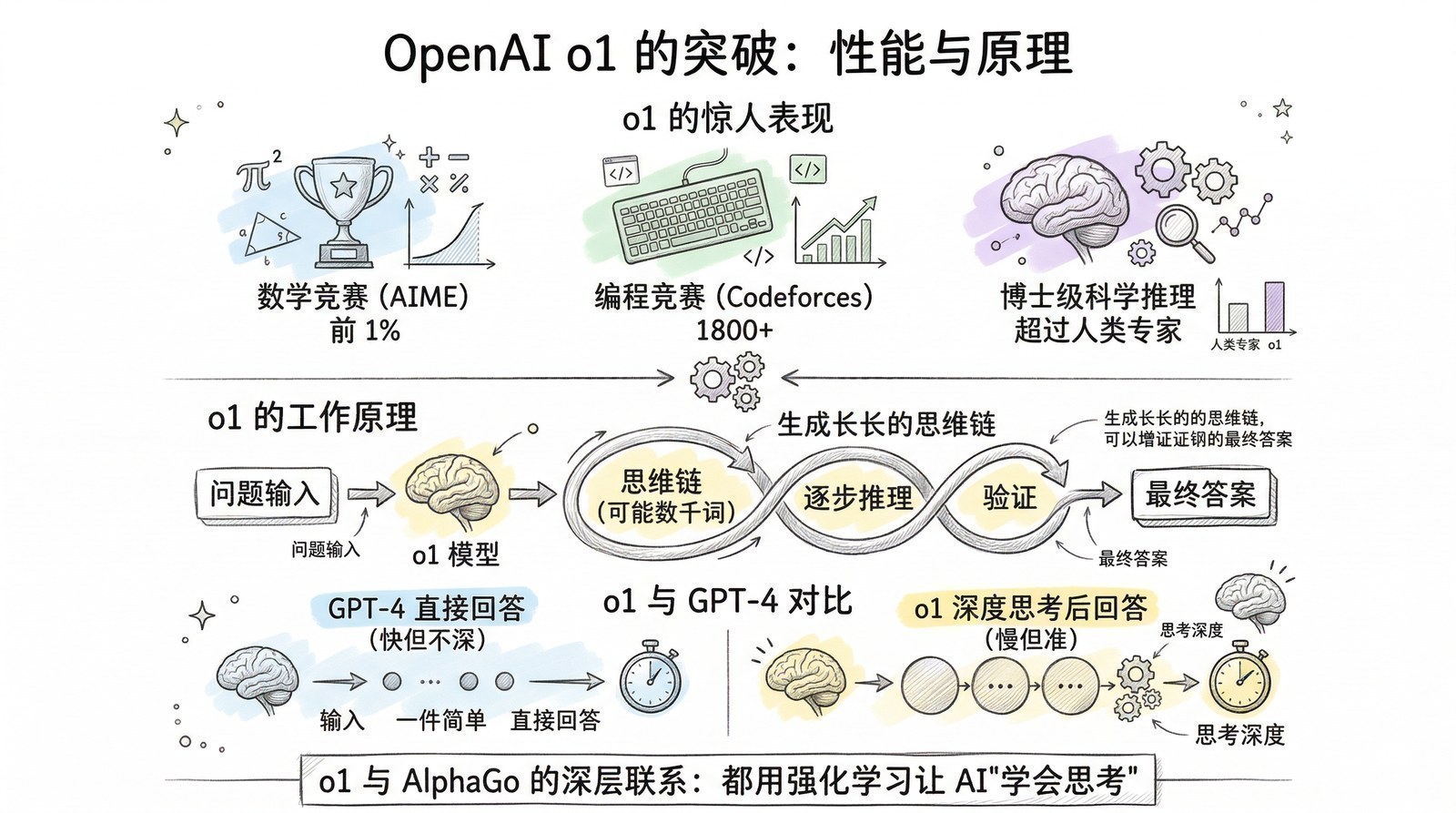

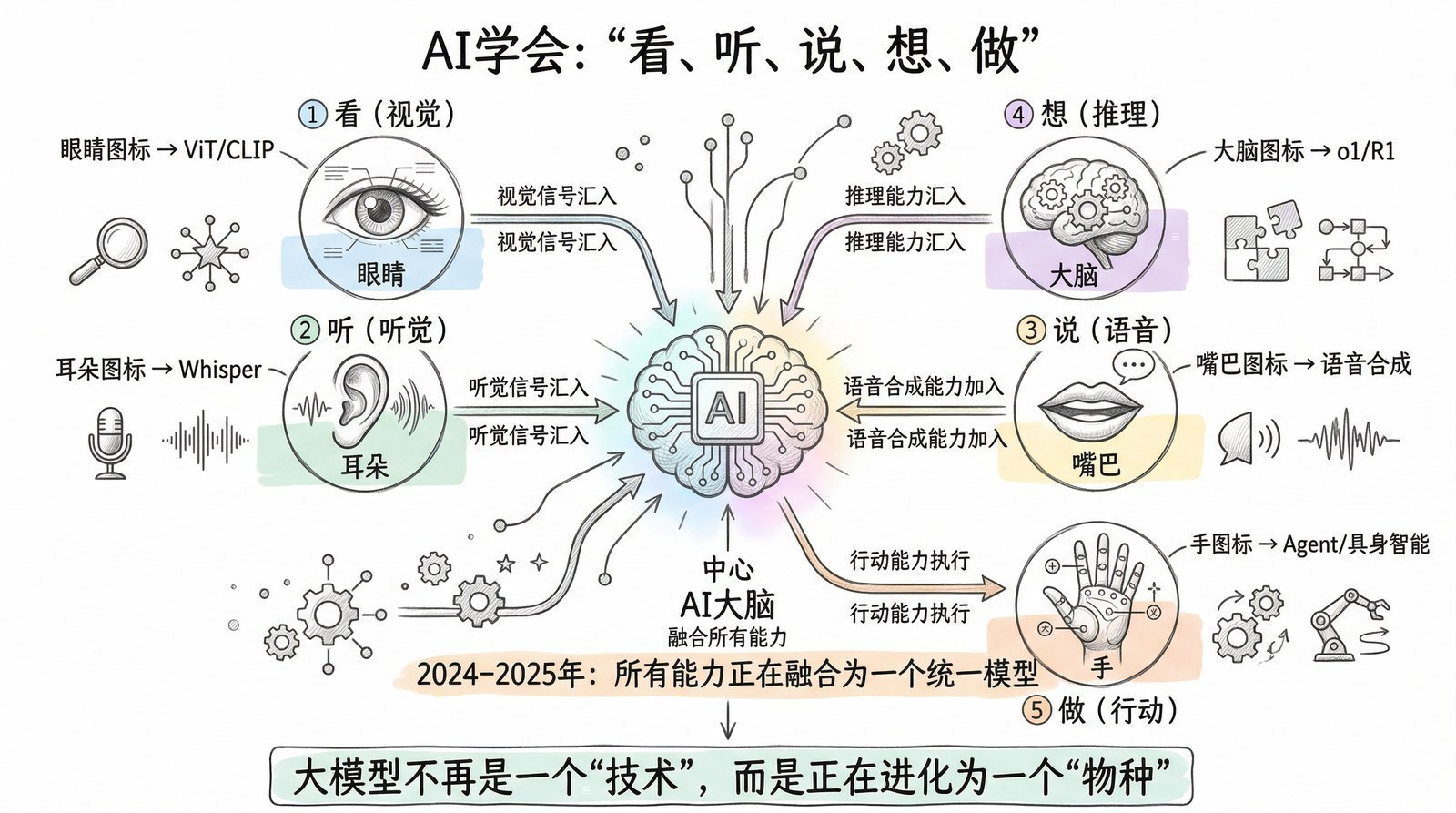

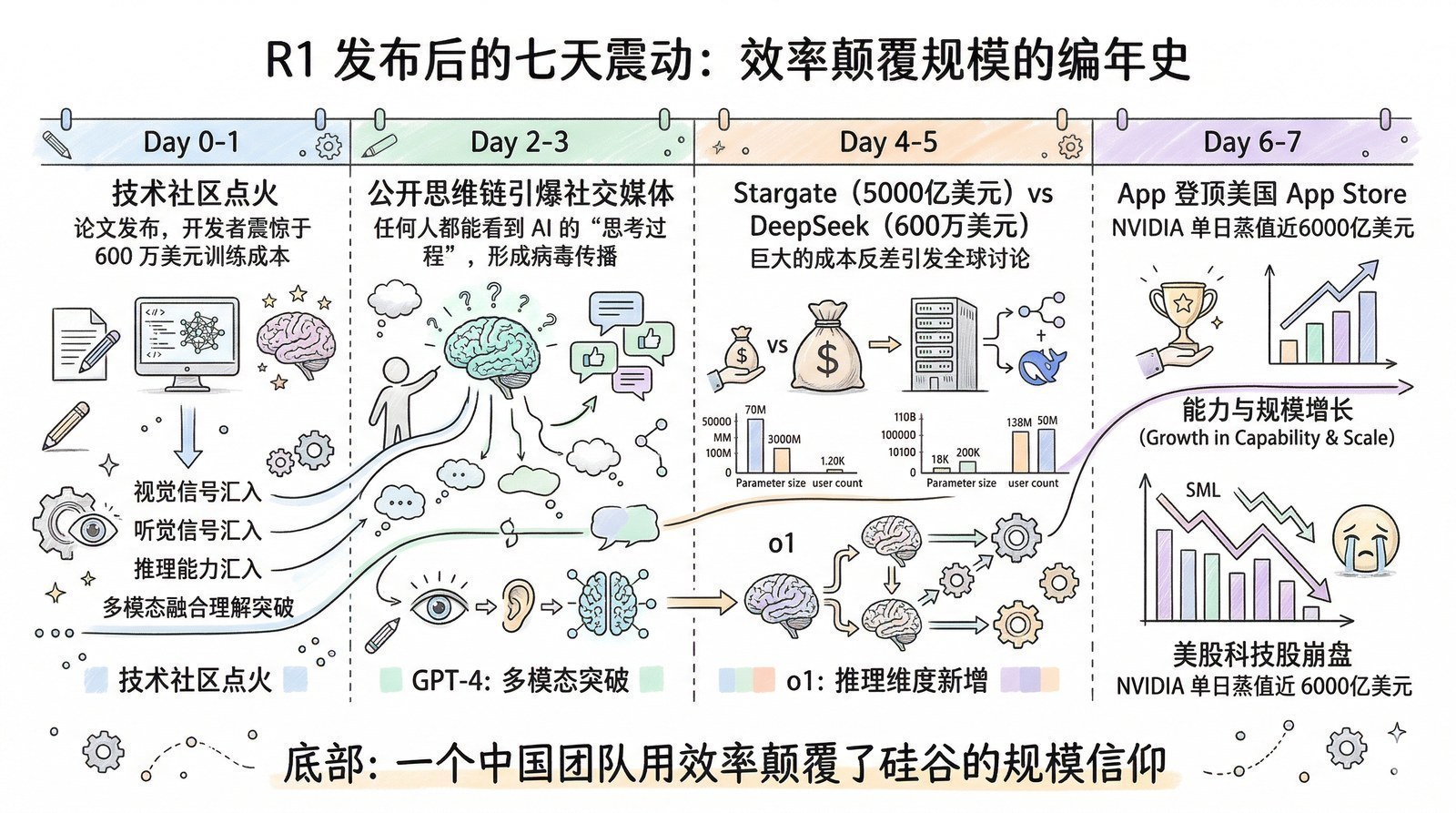

每隔几周就有一个新模型发布,媒体不是说"颠覆"就是说"革命"。2023年3月GPT-4[1]发布,说要颠覆所有白领工作。2024年2月Sora[12]发布演示视频,说影视行业要完了。2025年1月DeepSeek-R1[8]发布,说推理能力已经赶上OpenAI了。2025年8月GPT-5[13]发布,说这是通向AGI的最后一步。

如果你只看新闻标题,你会觉得世界每三个月就要被彻底重塑一次。焦虑感铺天盖地。

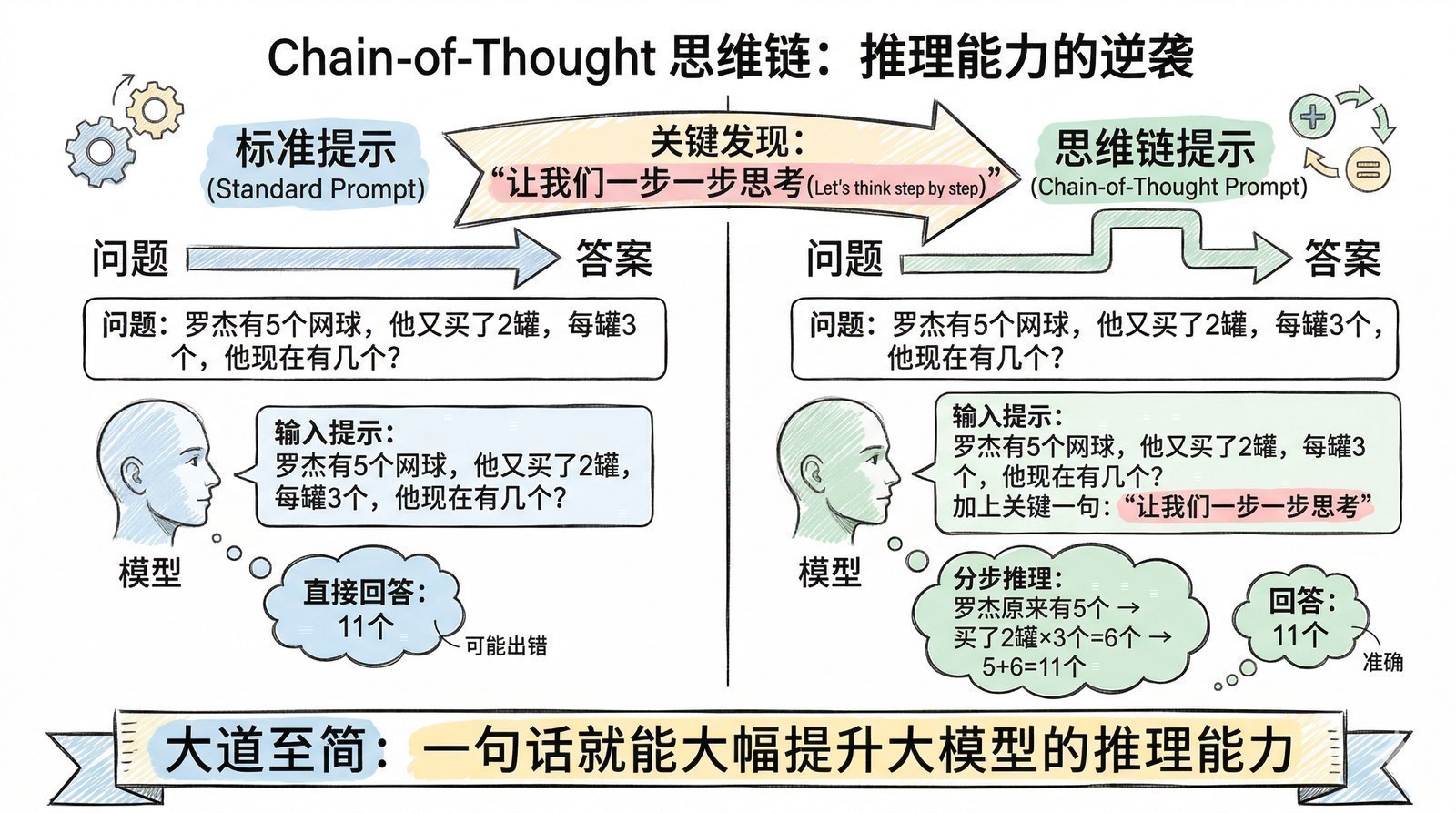

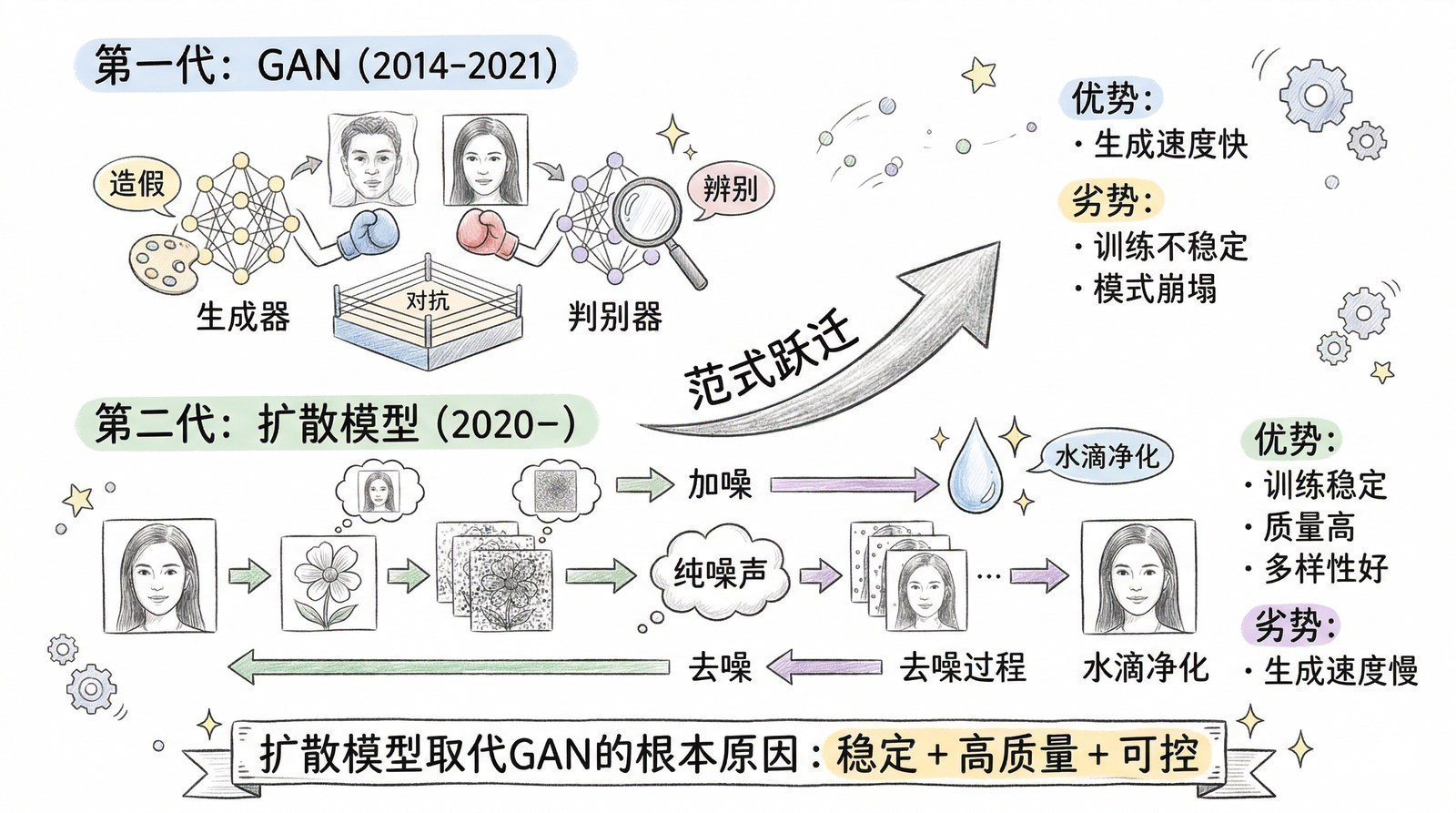

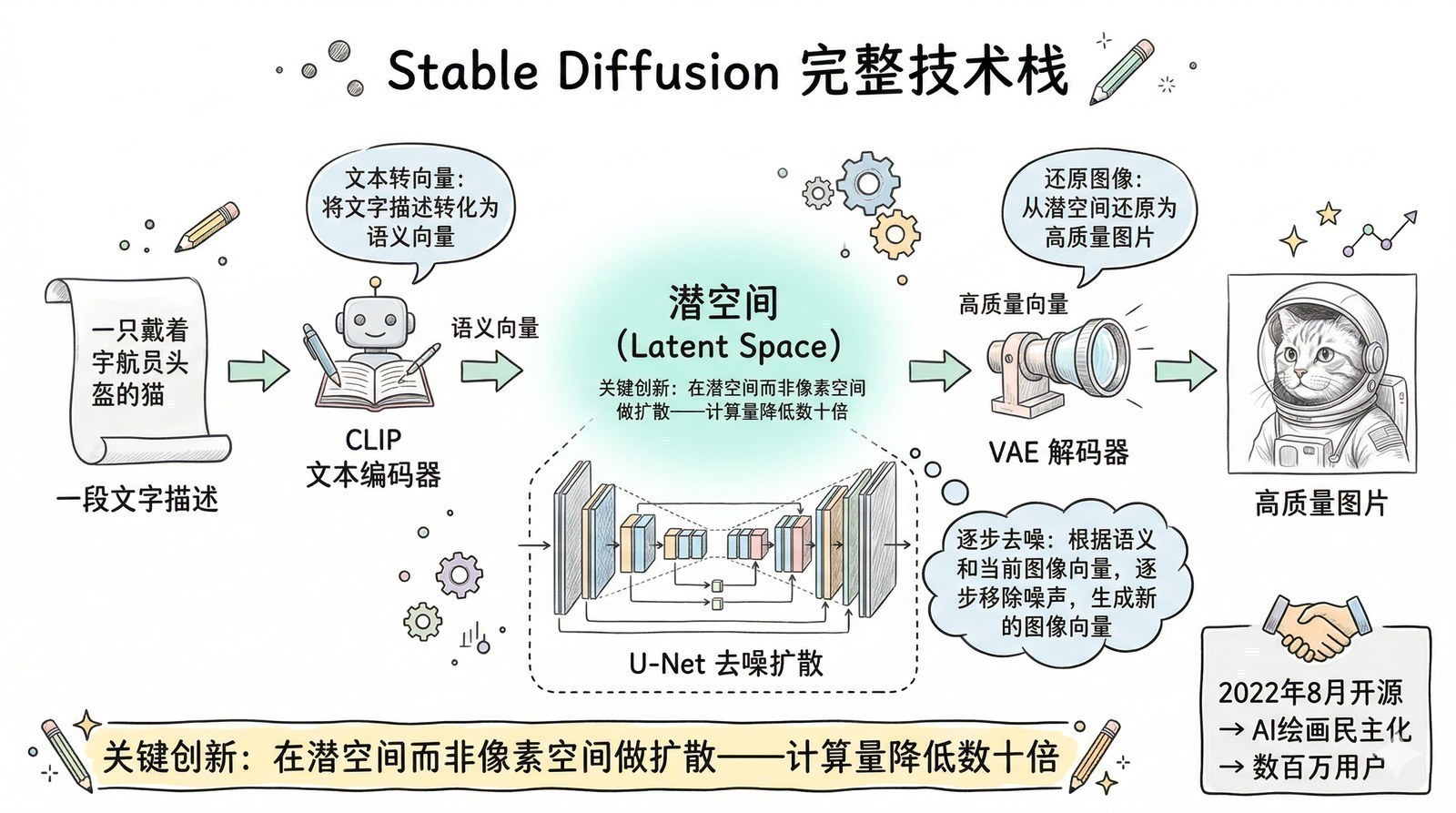

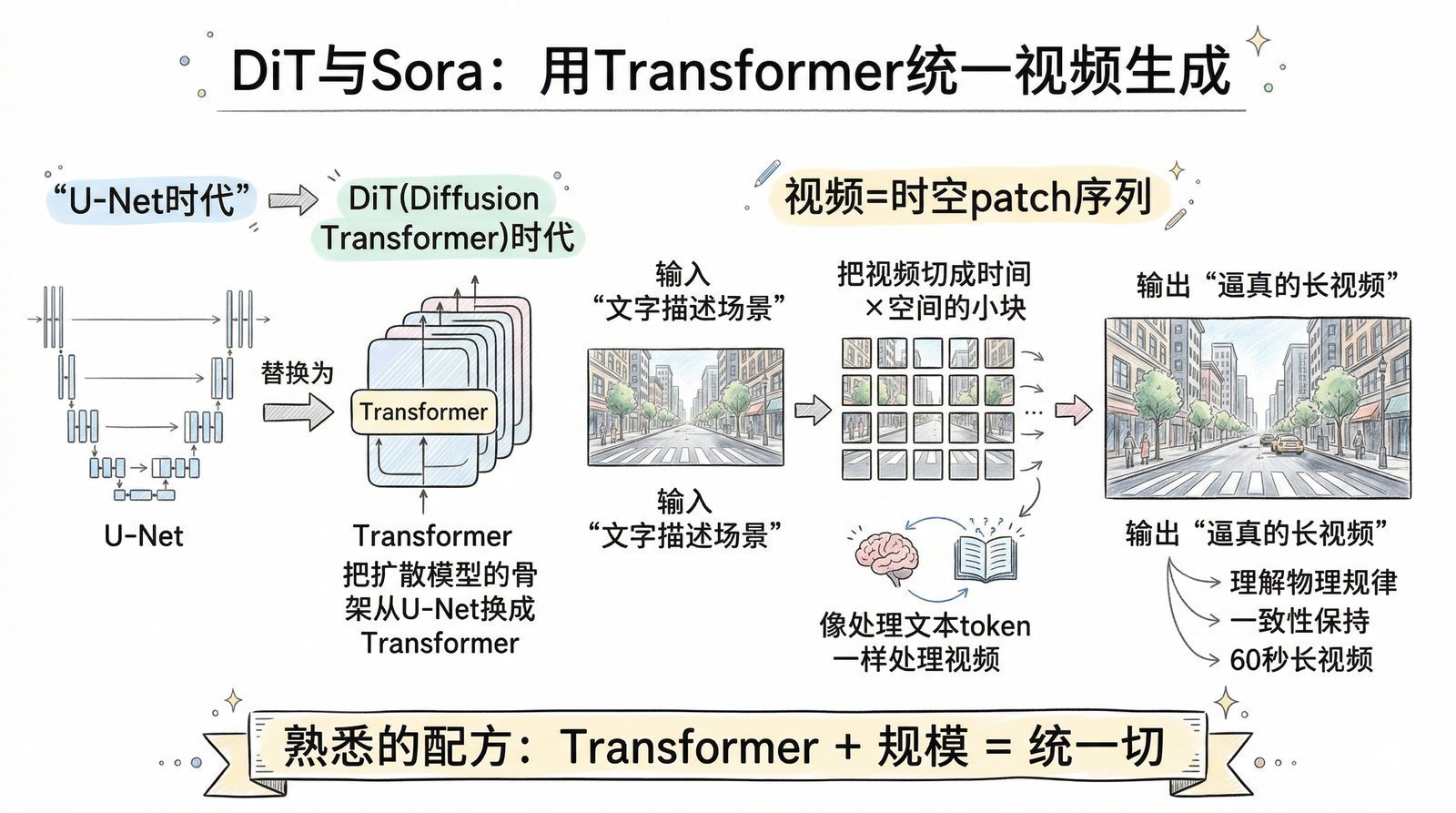

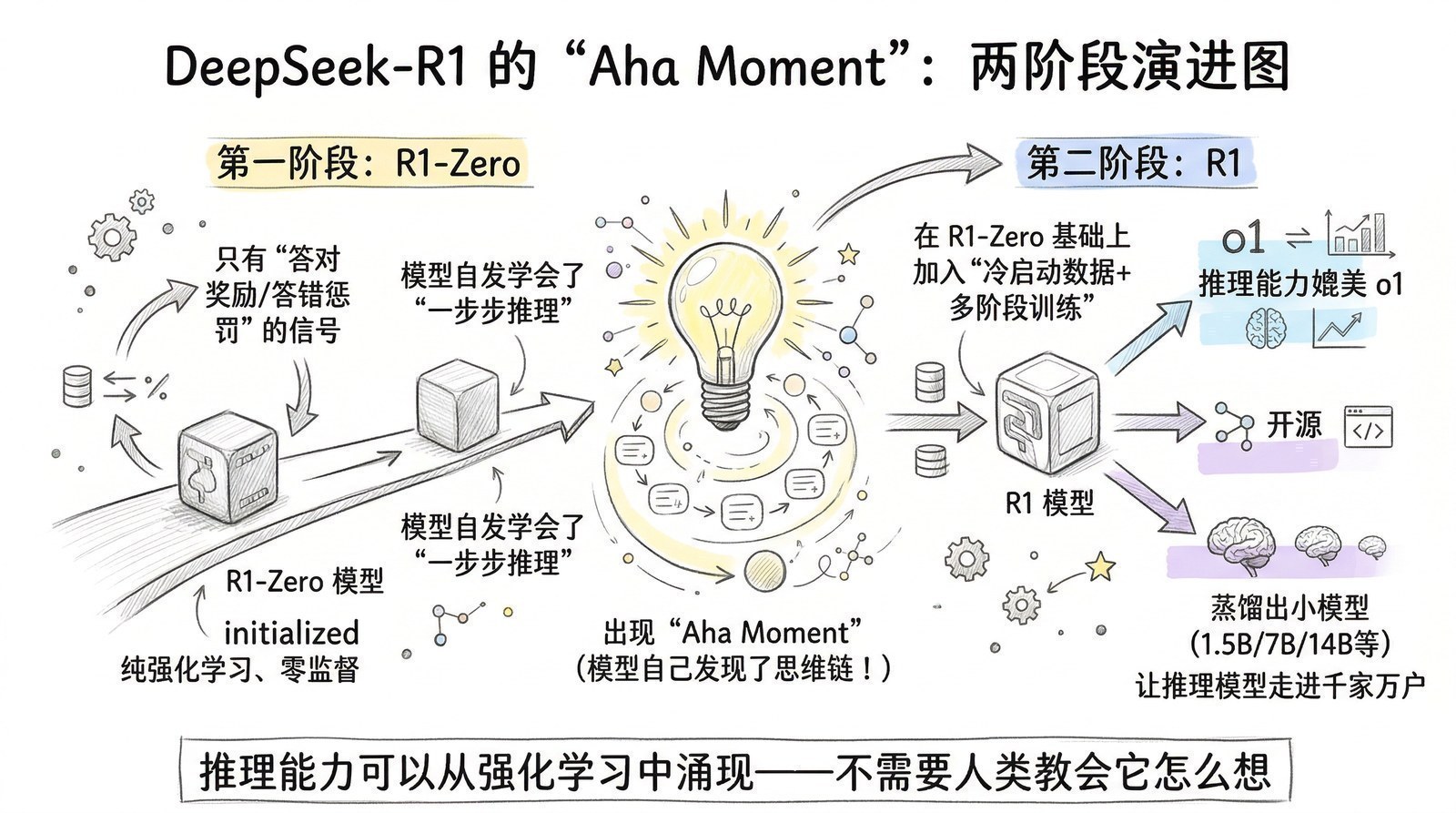

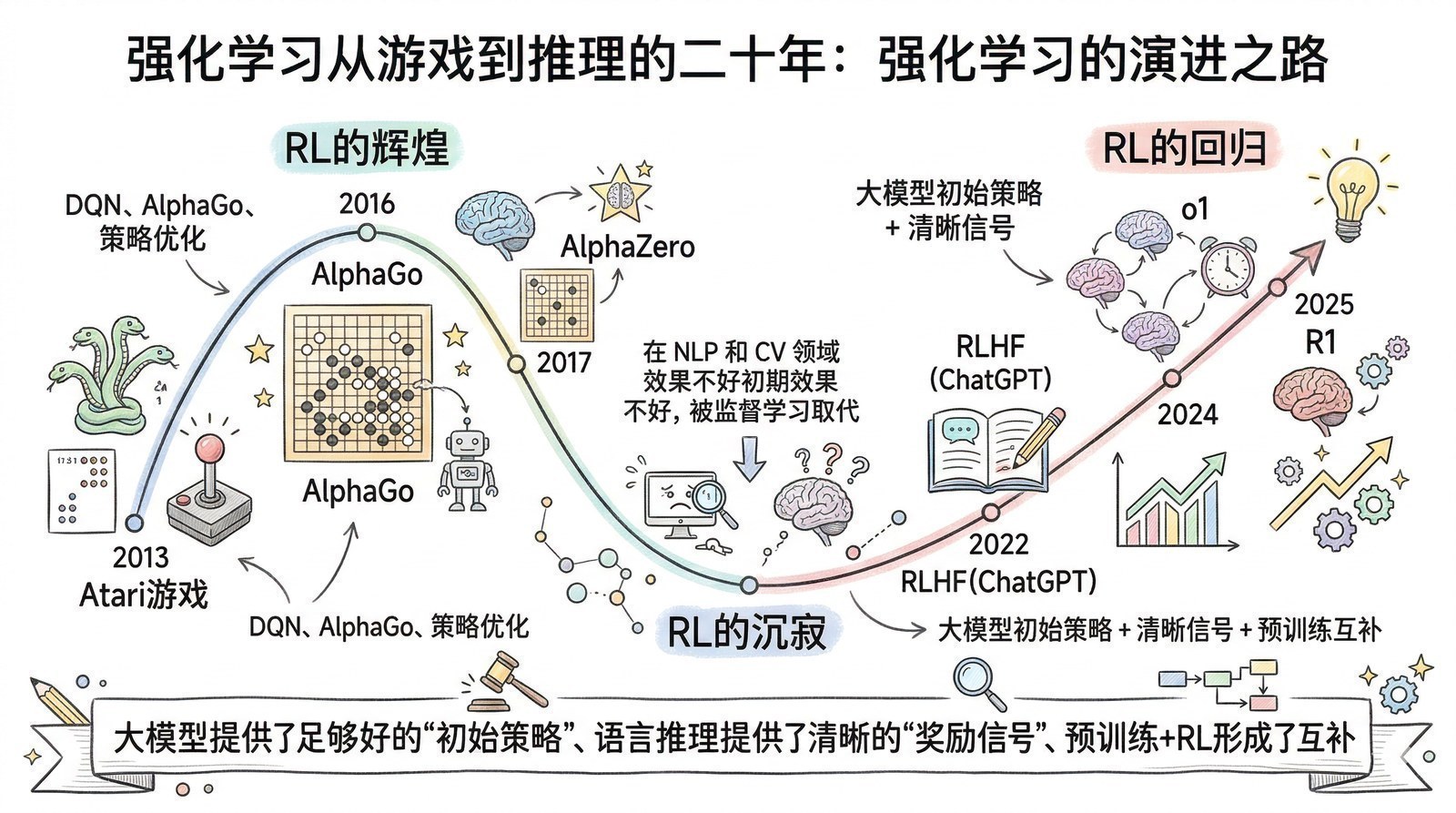

但当你读完这150篇论文,你会获得一种完全不同的视角。你会看到:Sora[12]的视频生成能力本质上是DiT架构[14](2022年)在视频领域的扩展,而DiT又是Transformer[5](2017年)和Diffusion模型[15](2020年)的结合——它不是凭空出现的魔法,是两条已知技术线的交汇。你会看到:DeepSeek-R1[8]的"涌现推理"其实和2017年AlphaGo Zero[16]的"纯自我学习"是同一种哲学——用强化学习让模型自己探索,不依赖人类示范。你会看到:o1的"慢思考"能力其实在2022年Chain-of-Thought论文[17]里就已经埋下了伏笔——那篇论文发现只要让模型"说出思考过程",推理正确率就会大幅提升,两年后OpenAI把这个发现变成了一整个产品方向。

当你理解了底层逻辑和发展规律,就会发现大模型的优势和劣势、已经突破的难题和还没搞定的卡脖子问题,都是清清楚楚、了然于胸的。焦虑来自于不确定性,而论文提供的恰恰是确定性。

这大概就是"吃螃蟹"最大的收获——螃蟹扎了手不要紧,关键是你学会了怎么拆螃蟹。

我为什么要写这个系列

说到底是因为一种"不甘心"。

做了十几年技术和产品,从大厂到创业再到高校,我的职业主线一直是同一件事:把复杂的技术变成能解决实际问题的东西。 在大厂时是把架构方案翻译成产品方案,创业时是把前沿技术翻译成商业模式,在高校做科技成果转化时是把论文翻译成可落地的项目。

大模型时代,我发现这种"翻译"的需求比以往任何时候都更迫切。

过去两年的AI浪潮中,我接触了大量的从业者——产品经理、运营总监、创业者、投资人。他们聪明、勤奋、对AI充满热情,但在面对技术决策时常常感到无力。不是因为他们不够努力,而是因为他们和核心知识之间隔着一道"论文墙"。

这道墙有多高?

一篇典型的AI论文,20-50页的PDF,充满了数学公式、架构图、实验表格,用的是只有同行才能理解的专业术语。一个非CS背景的产品经理,就算有心去读,打开第一页看到"multi-head self-attention with scaled dot-product"大概率就会关掉。

但这篇论文真正想说的事情,可能只用一句话就能概括:"让模型在处理每个词的时候都能同时参考整段话中所有其他词的信息。"不需要公式,不需要代码,一个类比就够了。

问题是,谁来做这个"翻译"?

学术界的人不太愿意做,因为简化意味着不精确,不精确在学术界是一种"罪过"。媒体倒是愿意做,但往往简化过头——把所有新模型都写成"颠覆性突破",所有技术都标注为"里程碑",读者看完除了焦虑什么也没获得。而真正天天在项目里用大模型的人,又大多忙于交付,没有时间和精力去系统地梳理这些知识。

我觉得我恰好卡在一个合适的位置上。计算机科班出身,读论文不算太吃力;在行业里做了十几年,知道从业者真正关心的问题是什么;现在在高校做成果转化,本来就是干"把论文变成产品"这件事的。

于是,在各种AI工具的辅助下,我决定把自己读过的这150多篇论文和技术报告汇总起来,梳理成一条从2012年到2025年的大模型进化路线图。用最朴素的语言,把最复杂的技术演进讲清楚。

我给这个系列起了一个名字:智能涌现。

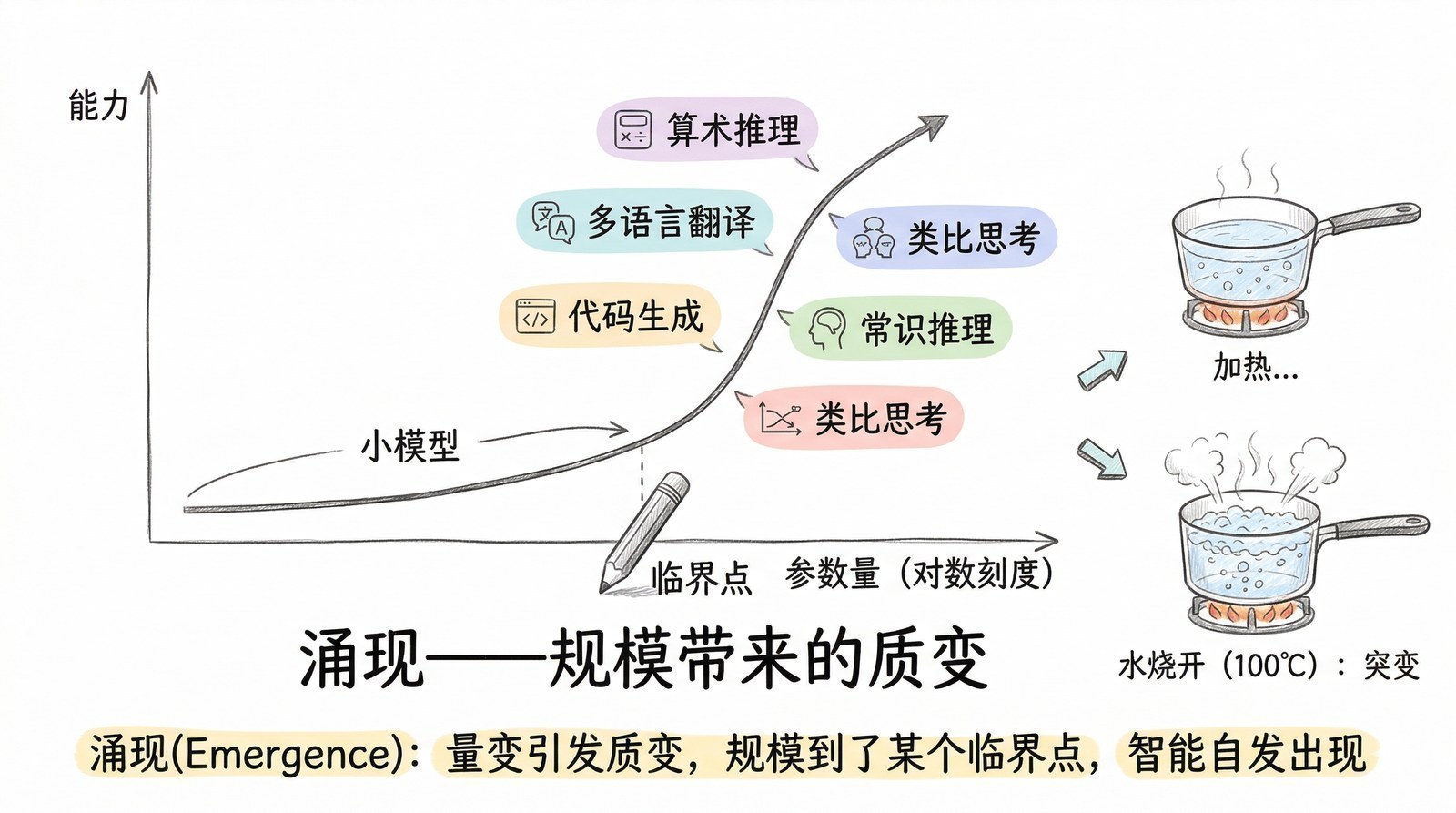

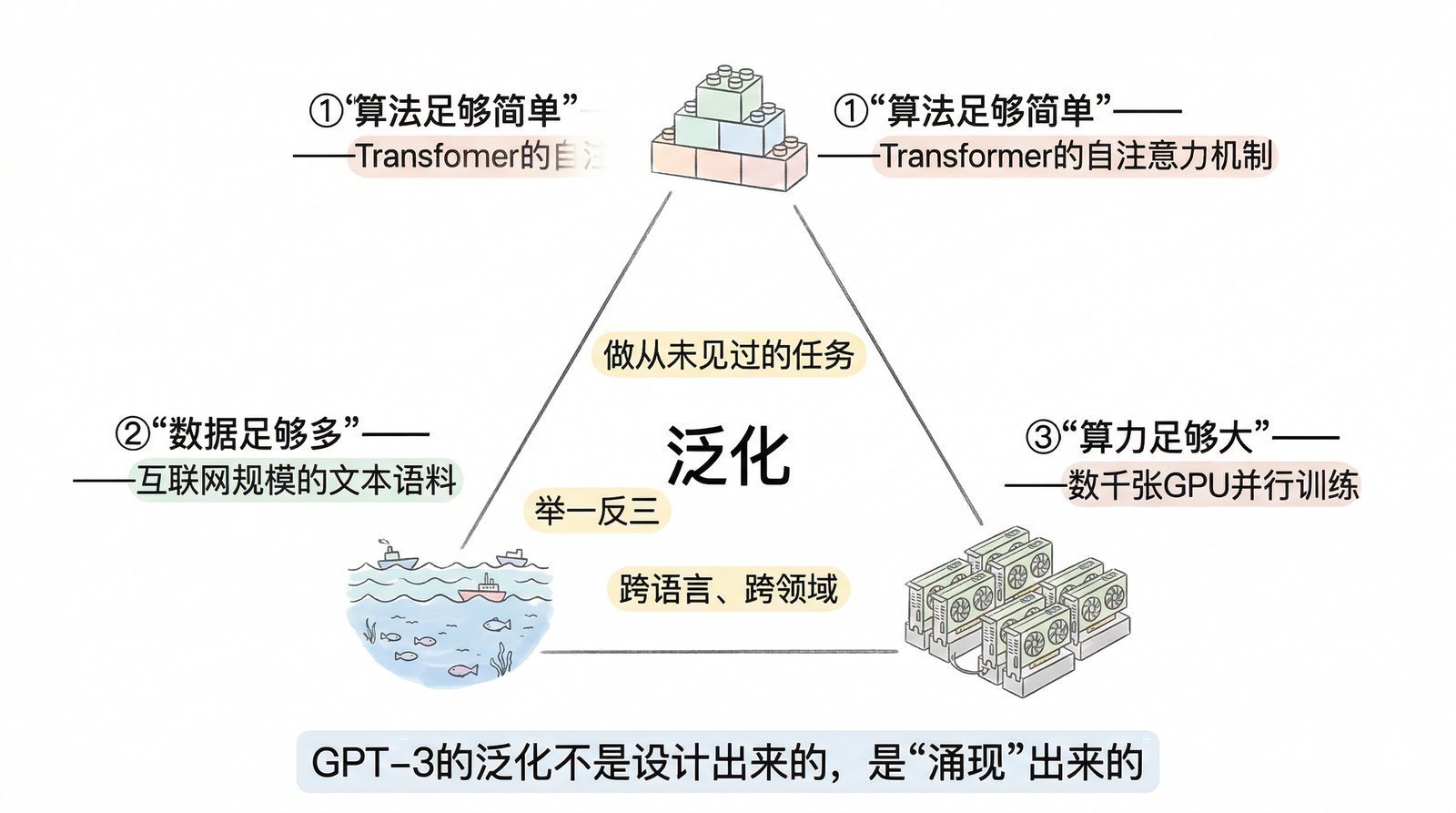

"涌现"是大模型领域一个很有意思的概念——当模型的规模达到某个临界点时,会突然展现出没有人设计过的新能力。GPT-3[10]突然学会了翻译,没有人教过它。DeepSeek-R1[8]突然学会了反思自己的错误,没有人编程让它这么做。这些能力不是被"设计"出来的,是从规模中"涌现"出来的。

我希望这个系列本身也能产生某种"涌现"——当足够多的论文、故事、数据和洞见被串联在一起时,读者能自发地形成一种看待AI发展的全局直觉。这种直觉不是任何单篇文章能给的,它只能从对全貌的理解中自然生长出来。

这个系列讲什么

一句话:大模型是怎么一步步"练成"今天这个样子的。

我会沿着时间线,用14个章节讲述大模型从萌芽到爆发的完整故事。每一章回答一个问题——"这个阶段,AI又能做什么以前做不到的新事情了?"

- AI是怎么学会"看图"的?(2012年的AlexNet[6],到今天特斯拉自动驾驶的视觉系统)

- AI是怎么学会"理解人话"的?(从2016年Google翻译的突然变好[18],到今天的实时同传)

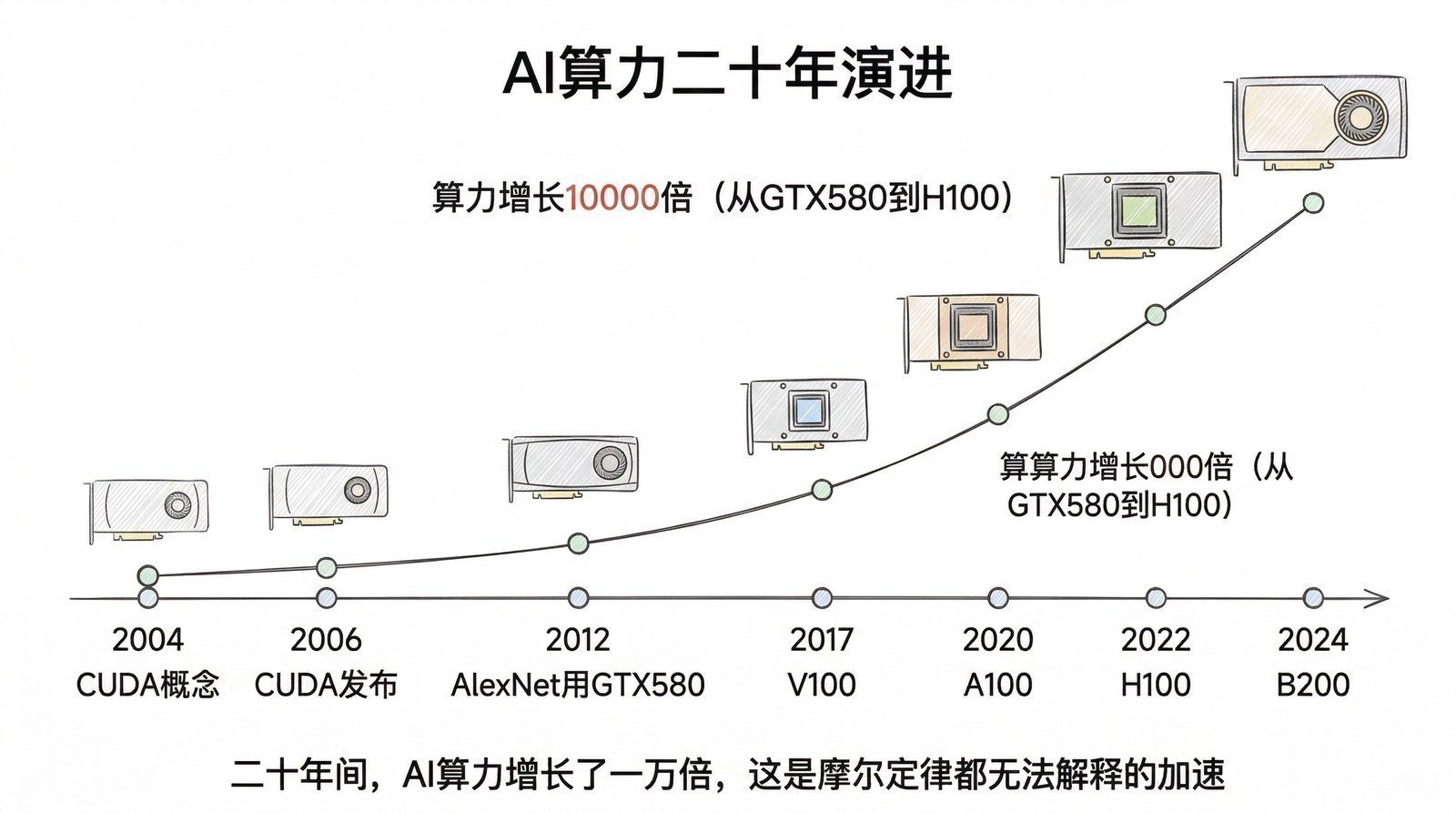

- 为什么NVIDIA成了全世界最值钱的芯片公司?(从游戏显卡到H100一卡难求)

- 一篇论文是怎么改写整个AI历史的?(2017年的Transformer[5],今天所有大模型的基础)

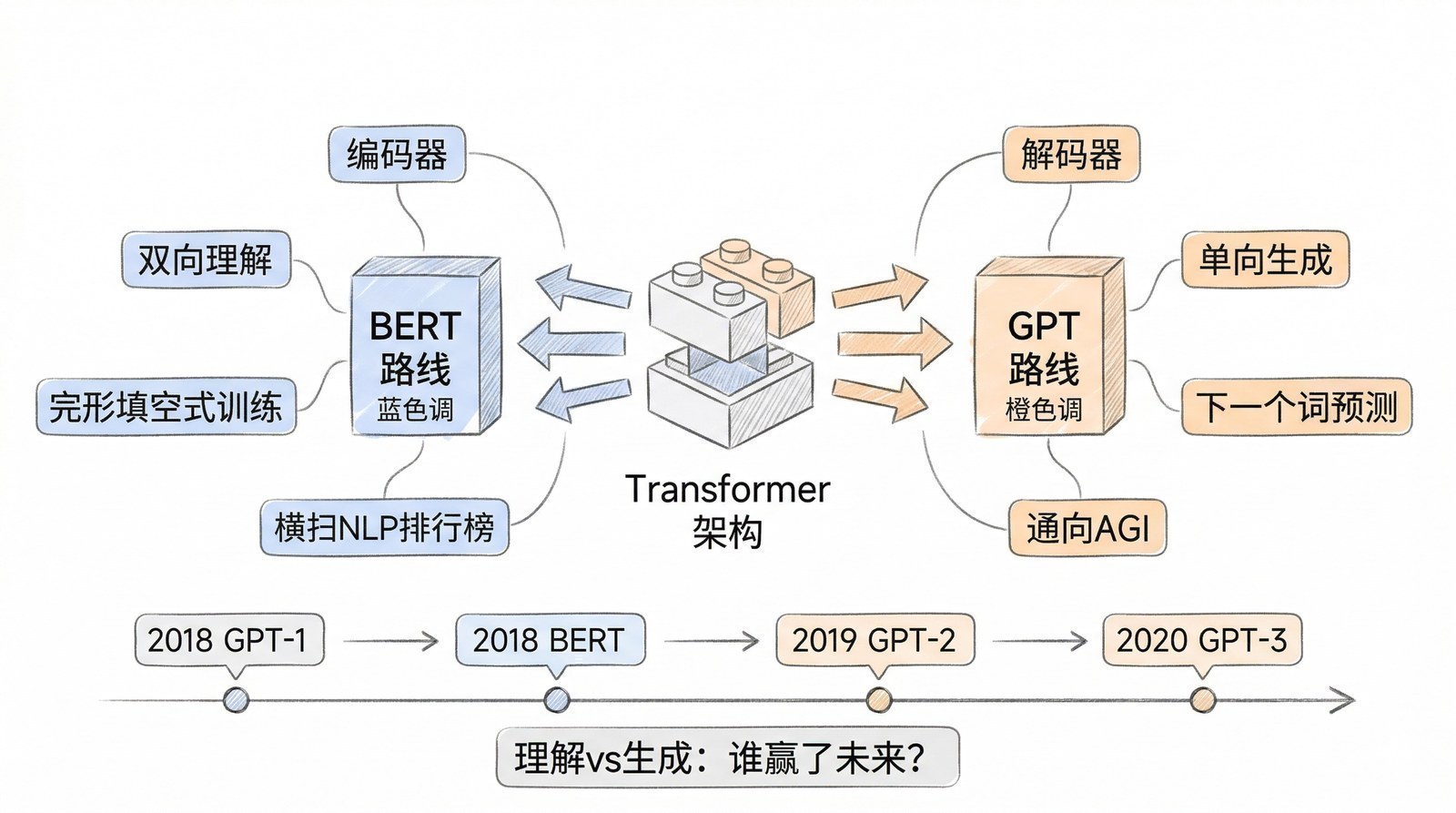

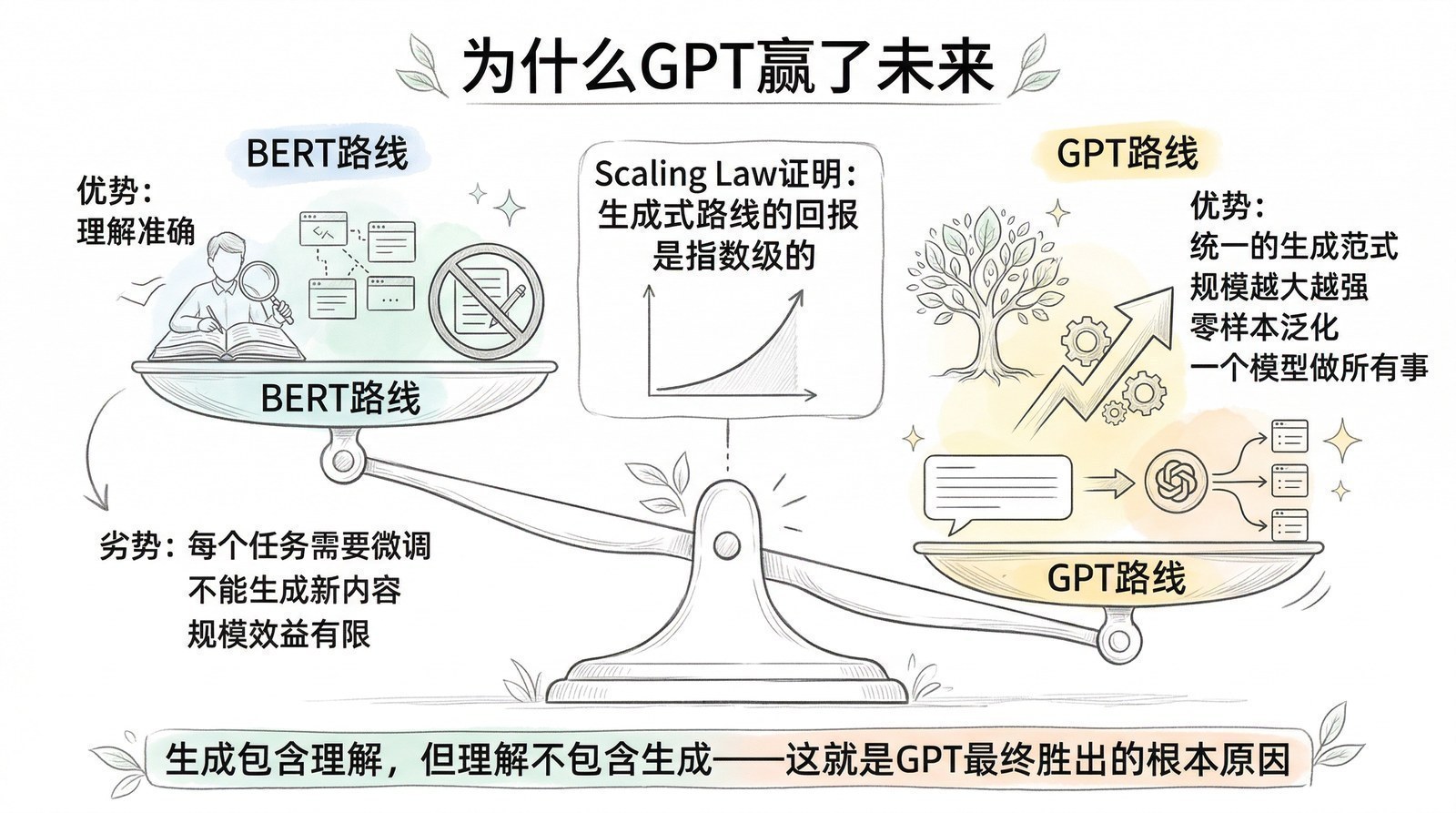

- GPT和BERT[19]这两条路,为什么最终GPT赢了?(Google起了个大早赶了个晚集的故事)

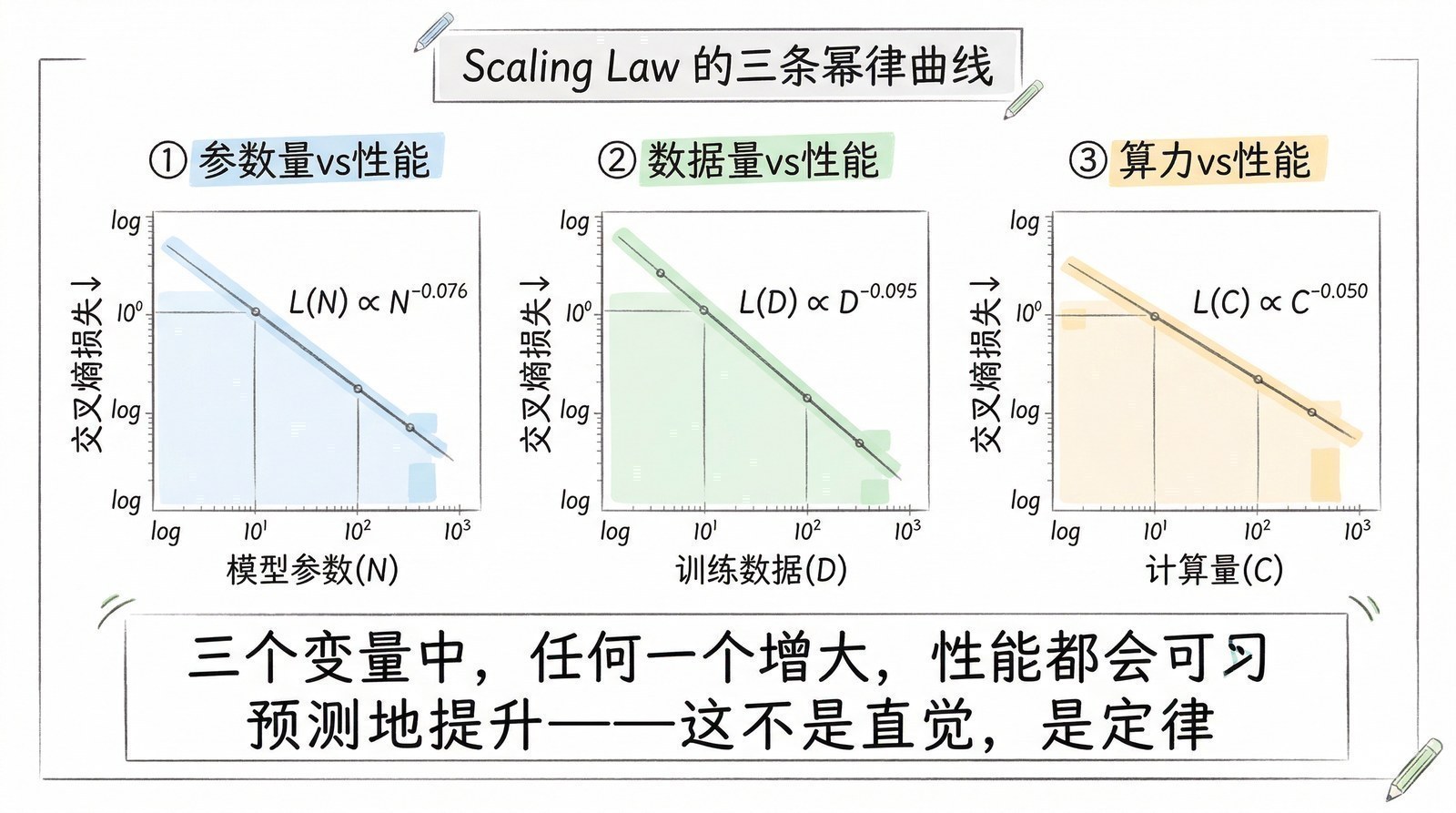

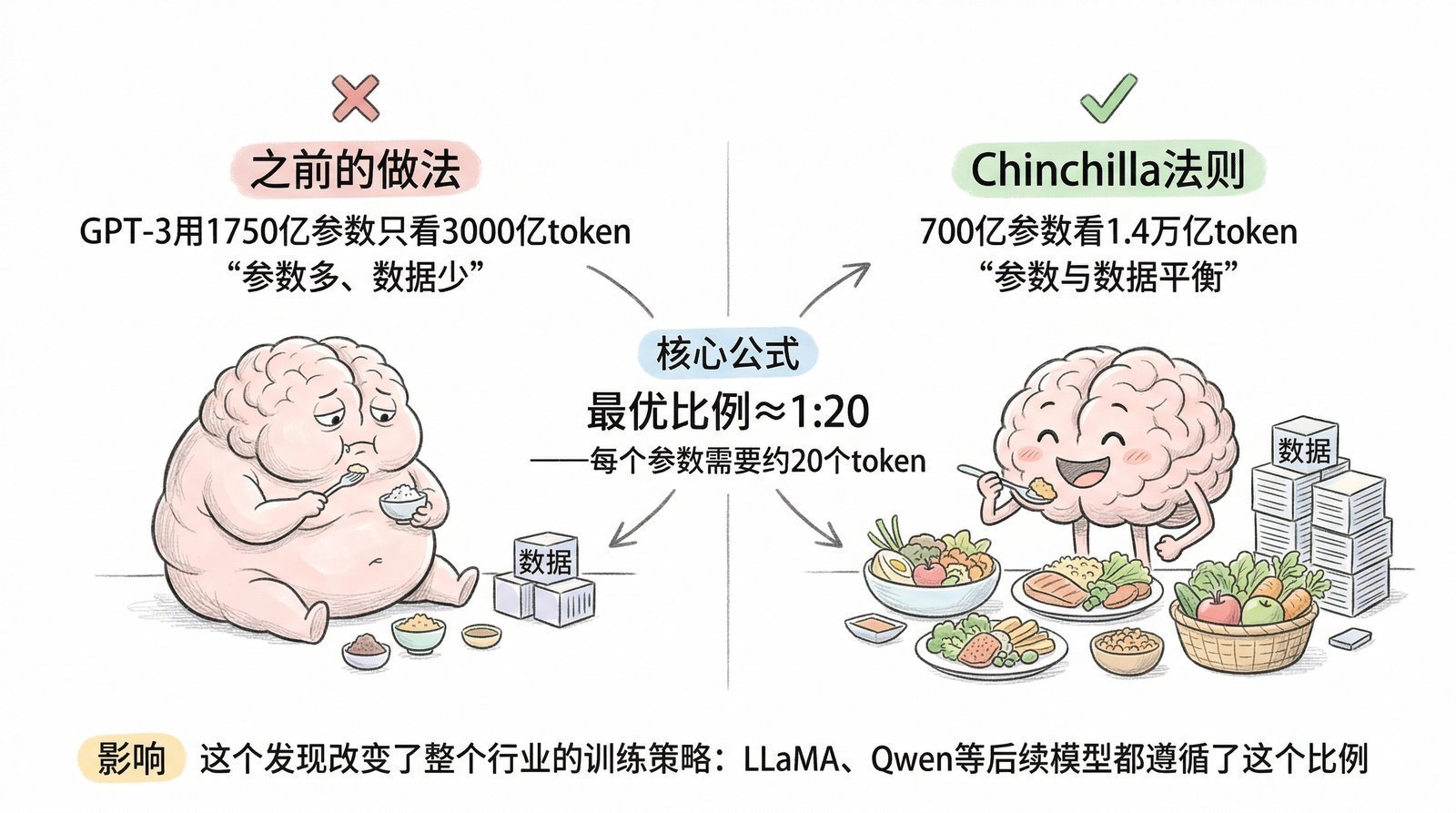

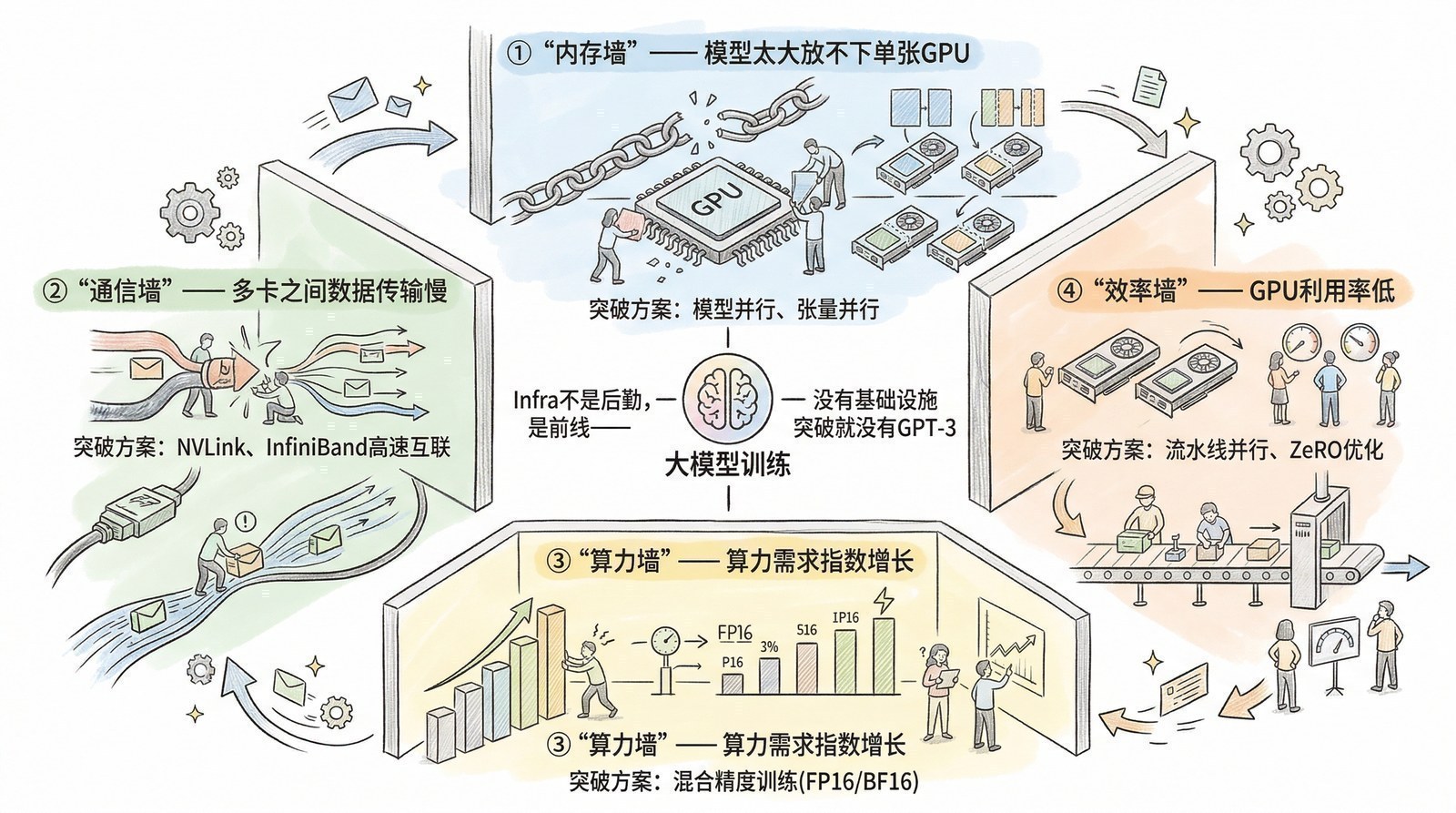

- "模型越大越好"这件事背后的数学和工程是什么?(Scaling Law[20]、ZeRO[21]、万卡GPU集群[22])

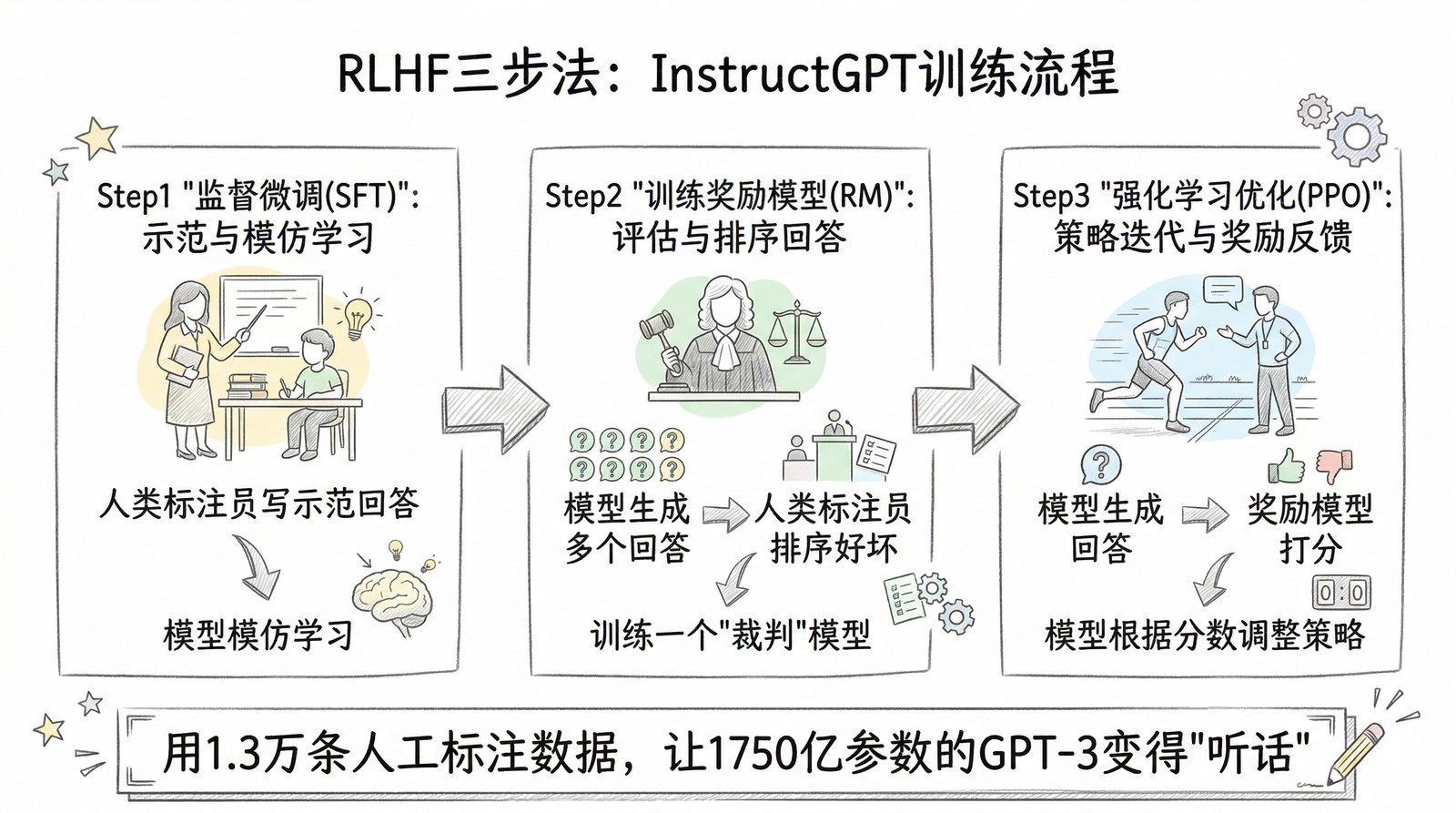

- ChatGPT凭什么两个月破亿用户?(RLHF[7]让AI从"能力强"变成"好用"的关键一步)

- AI是怎么学会画画的?(CLIP[2]打通视觉和语言,Midjourney零融资做到5亿美元)

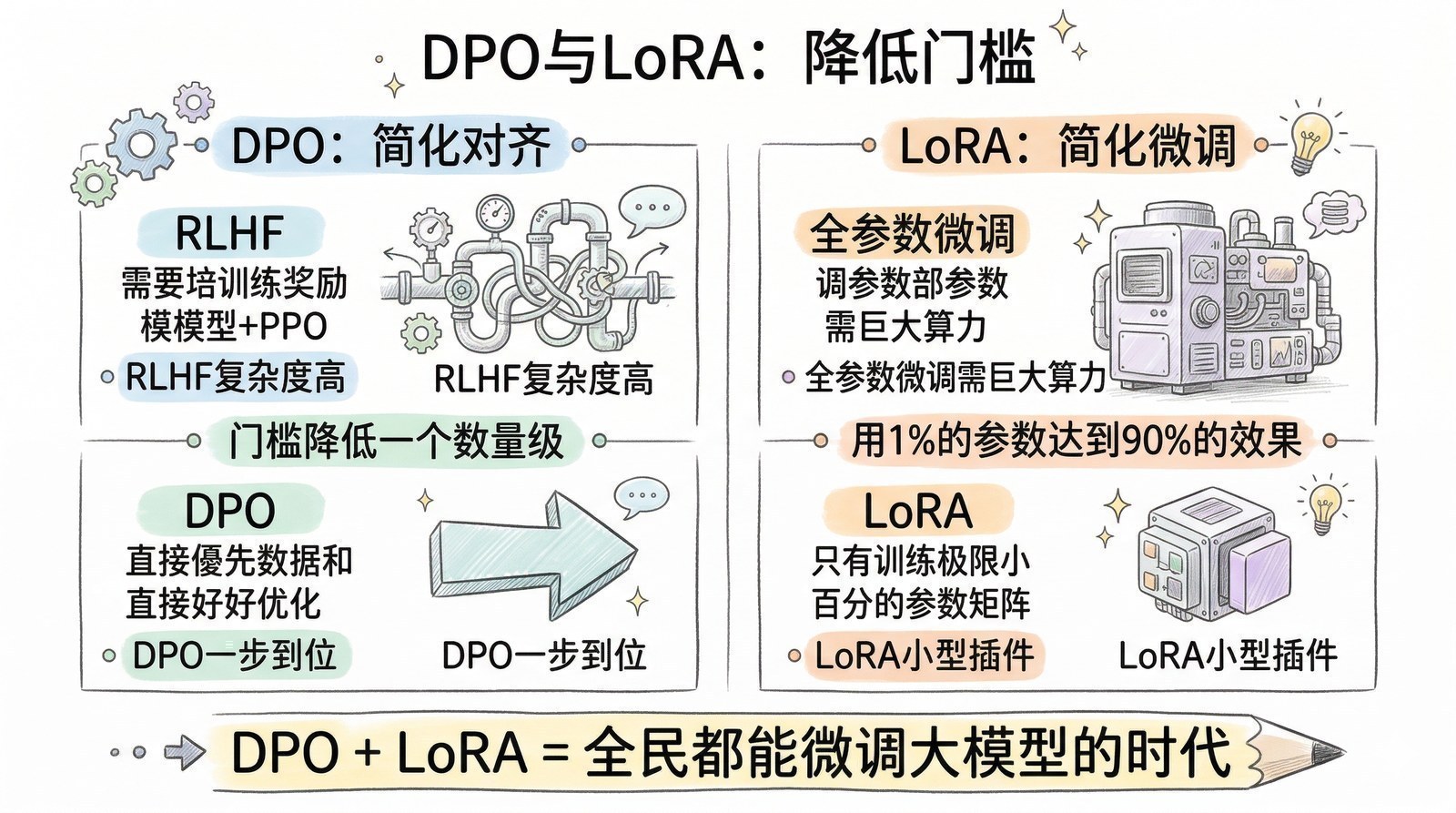

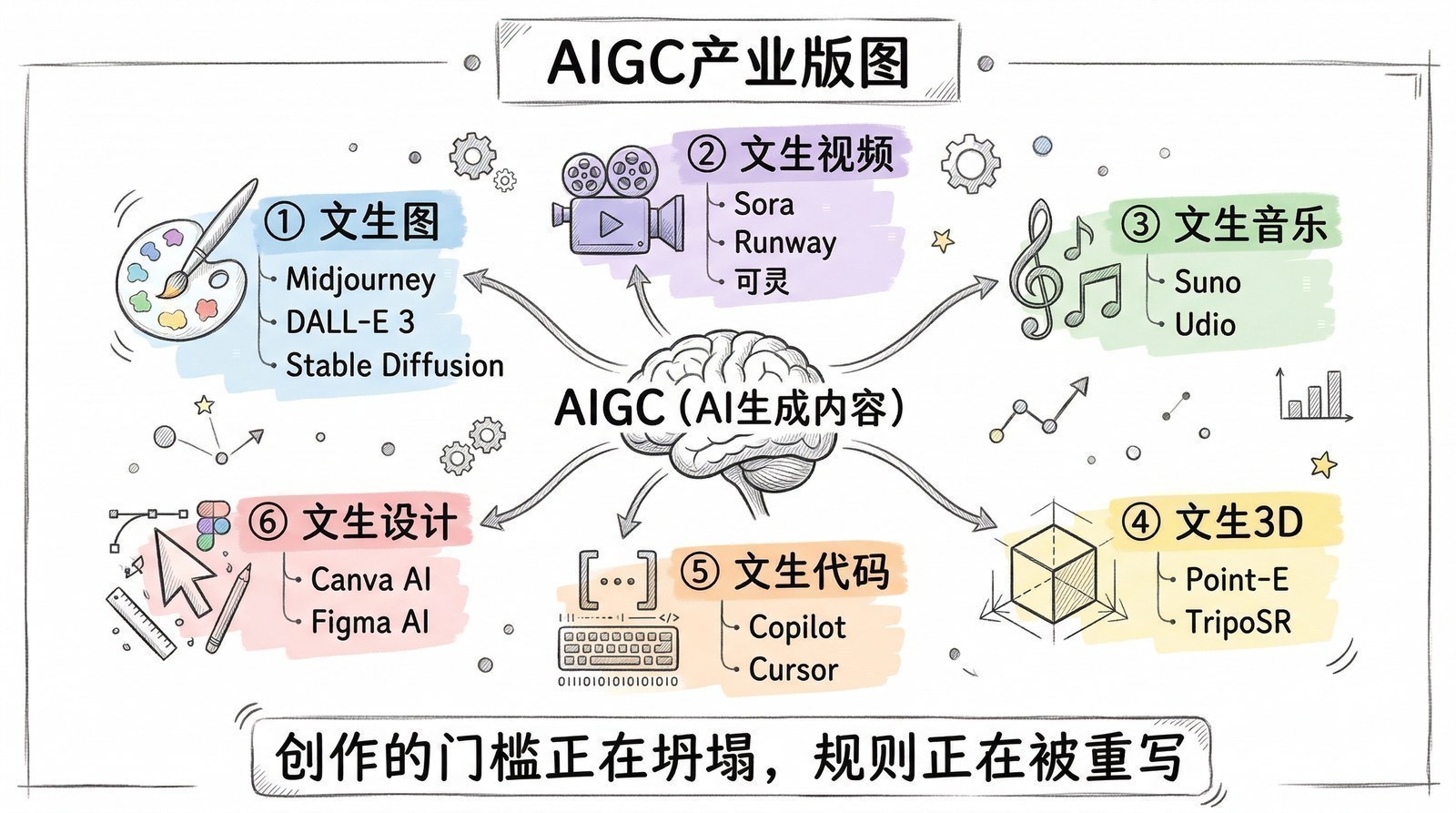

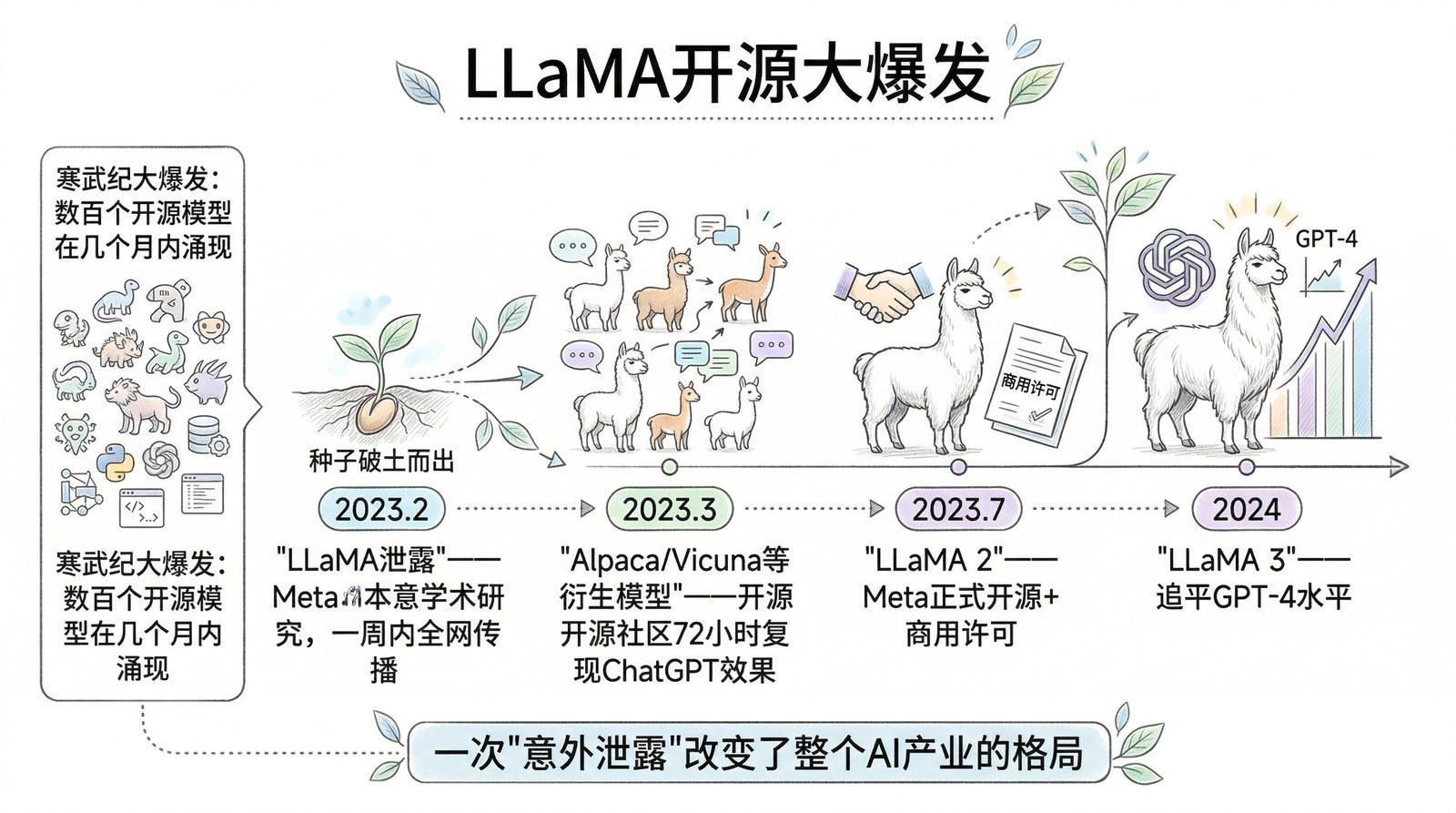

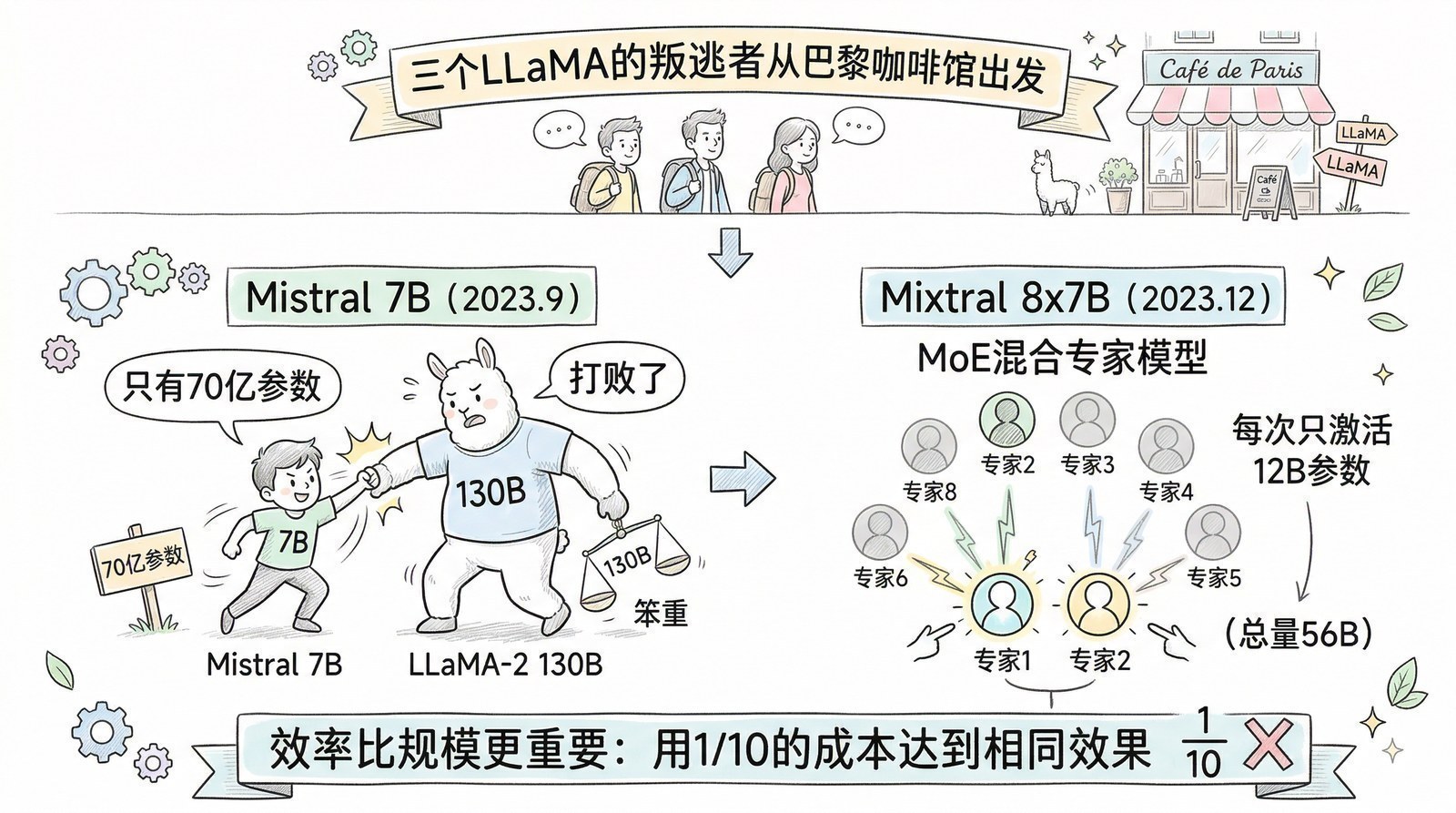

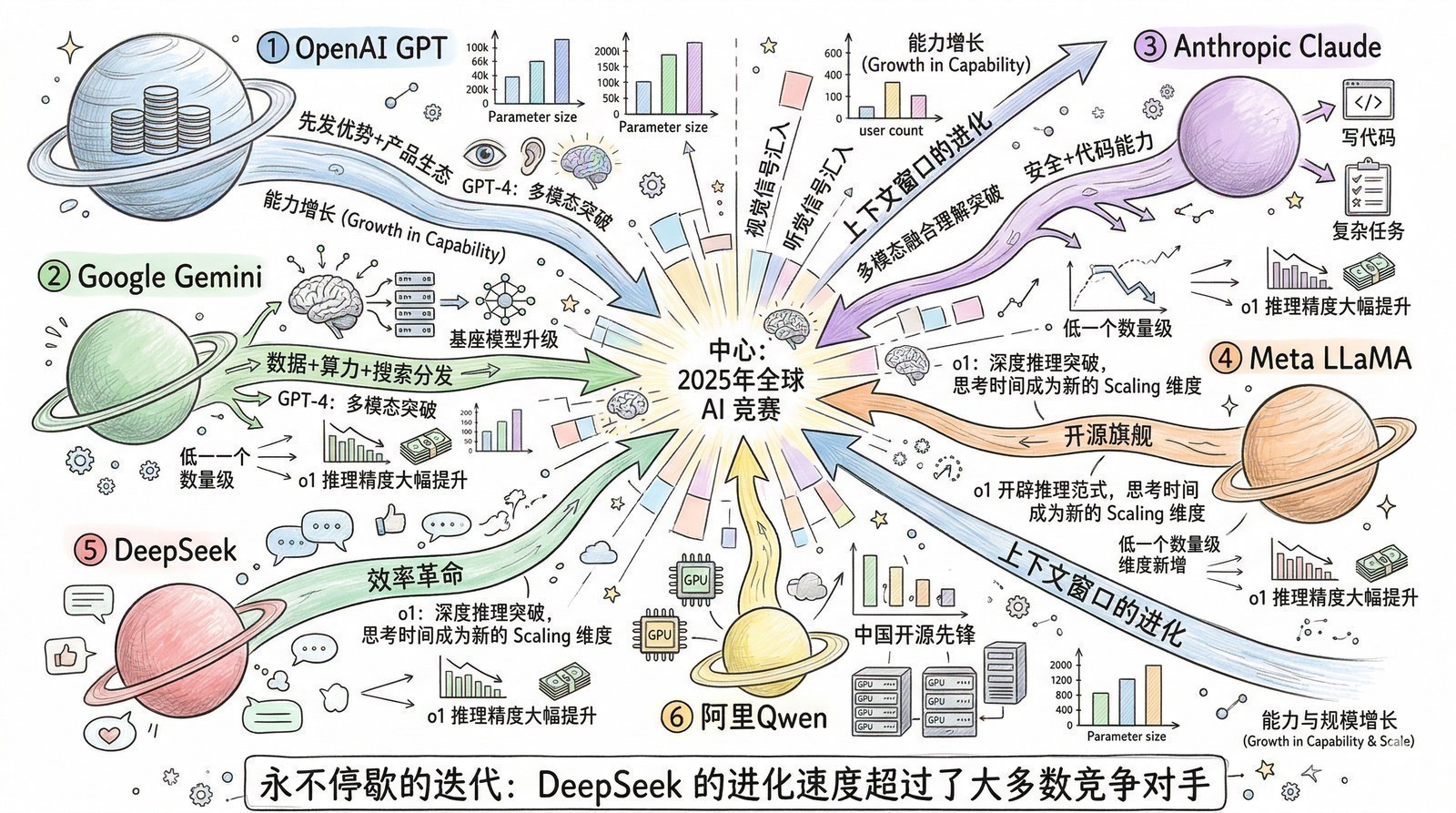

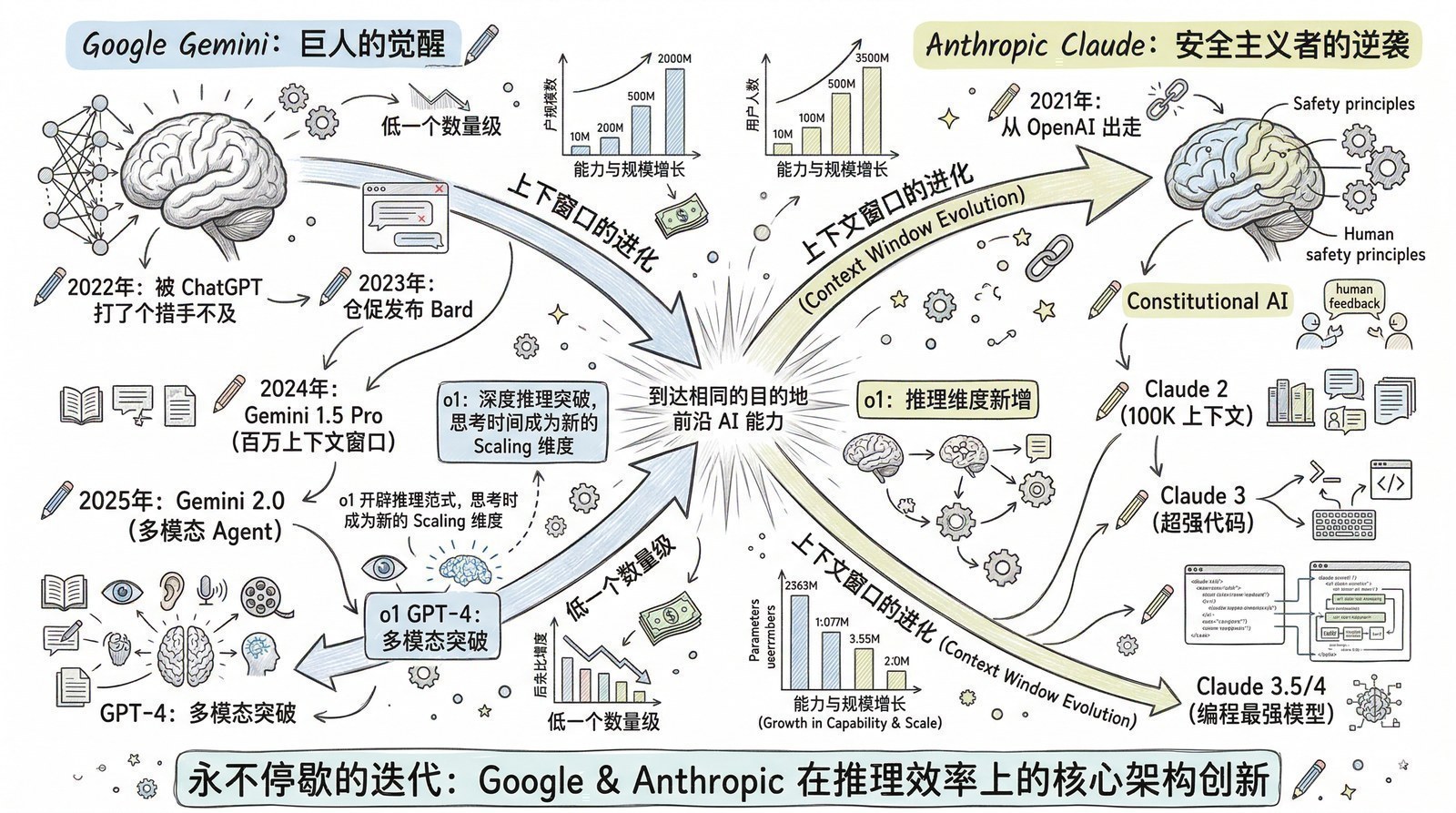

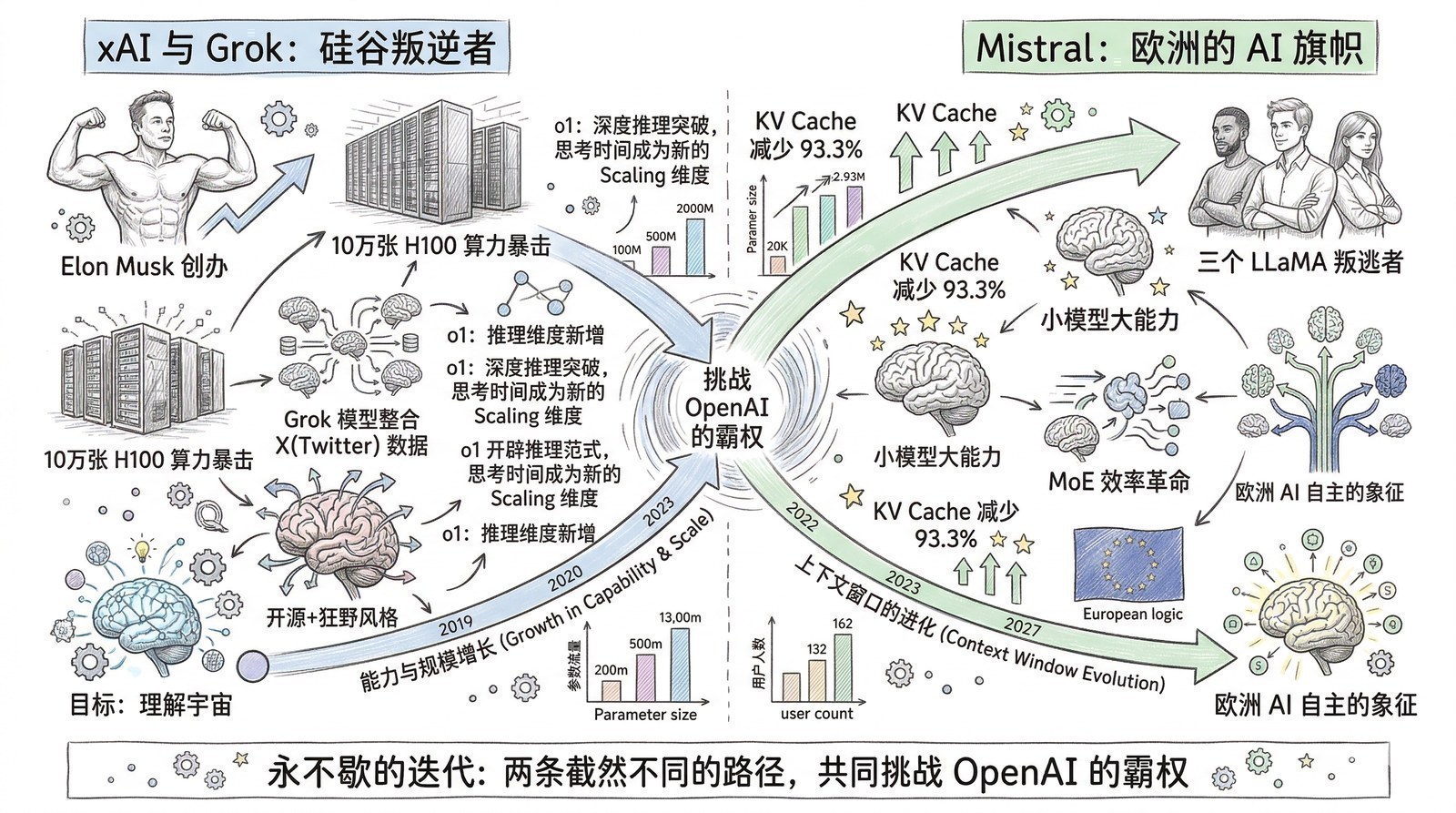

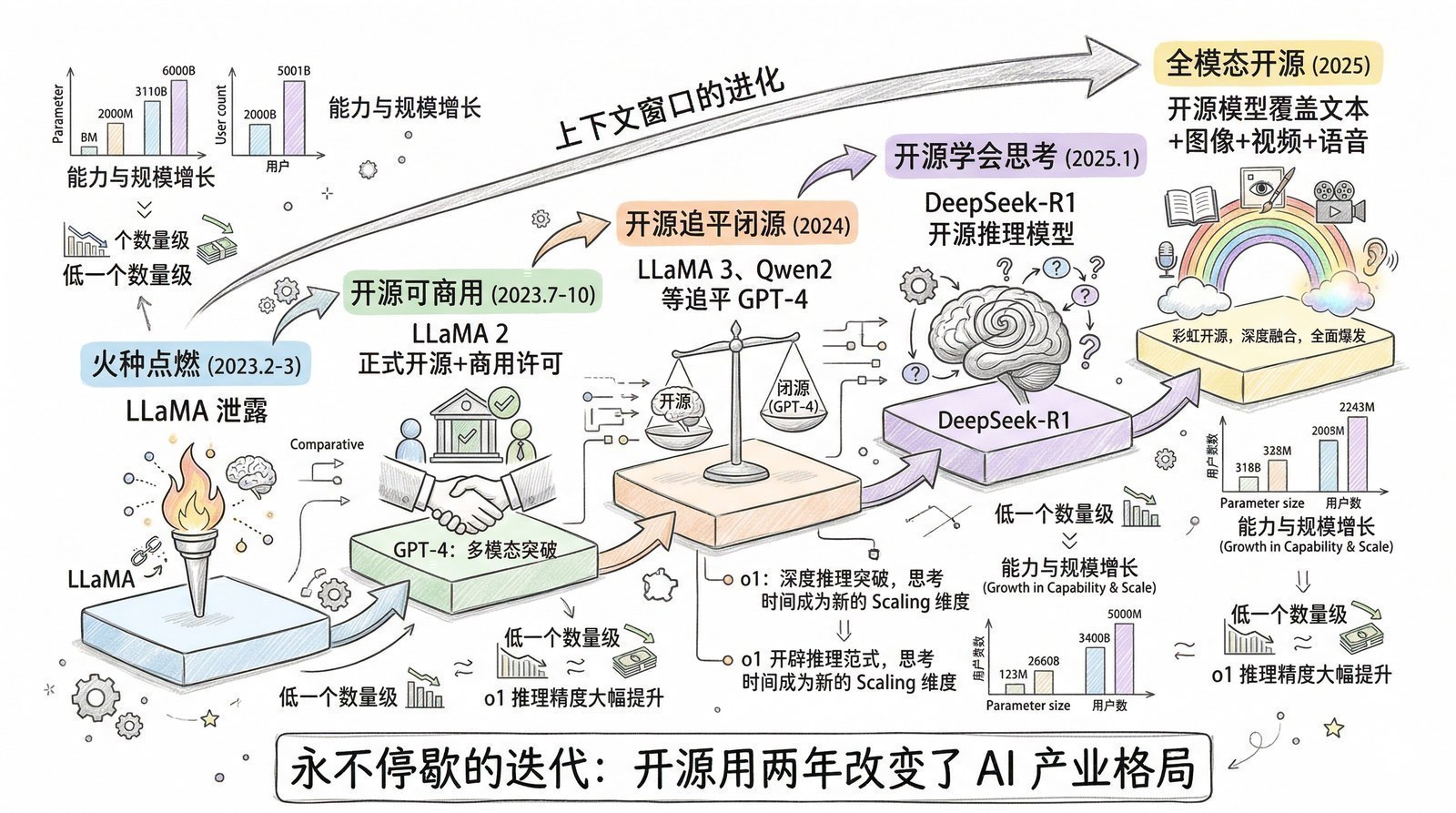

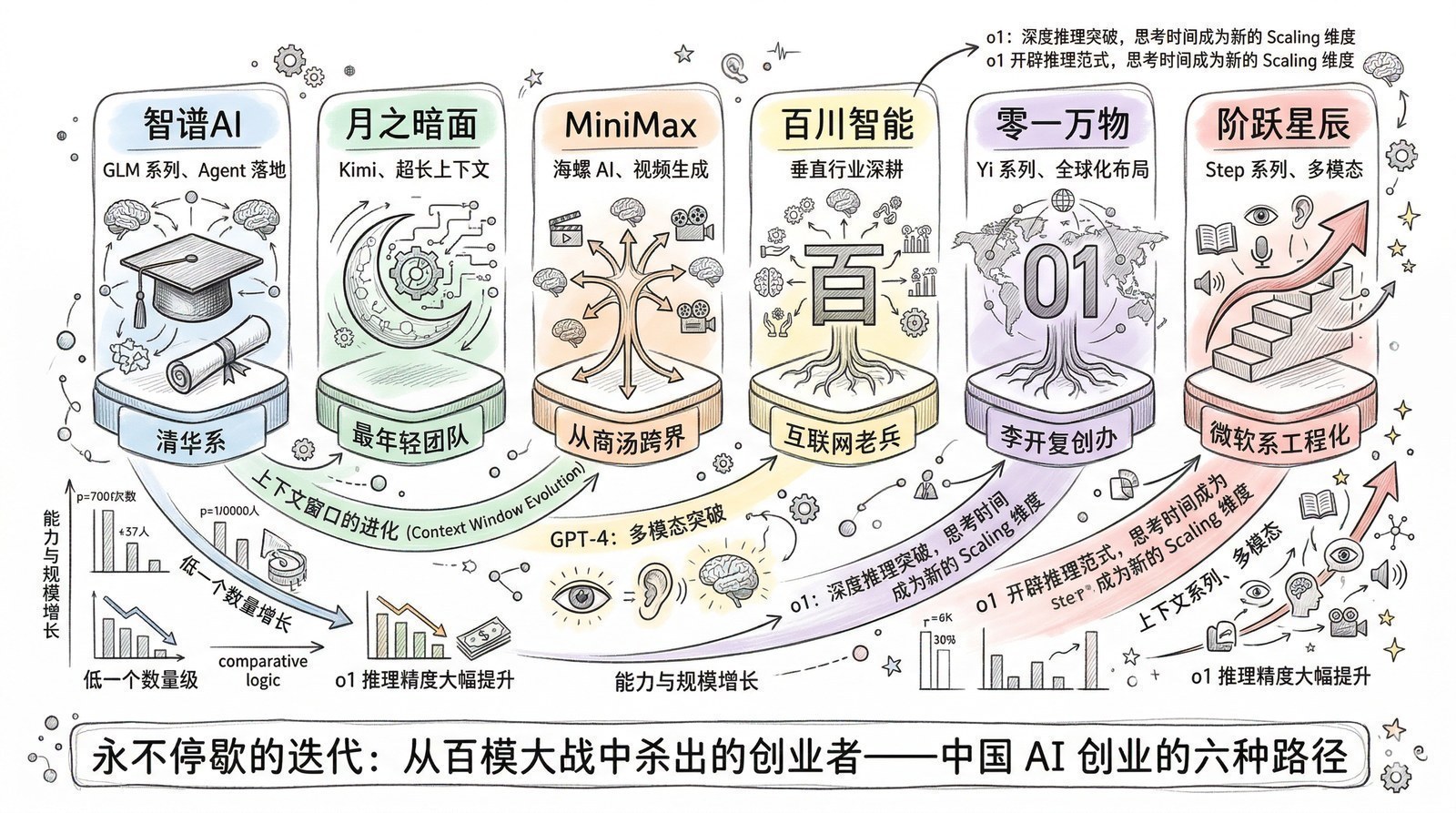

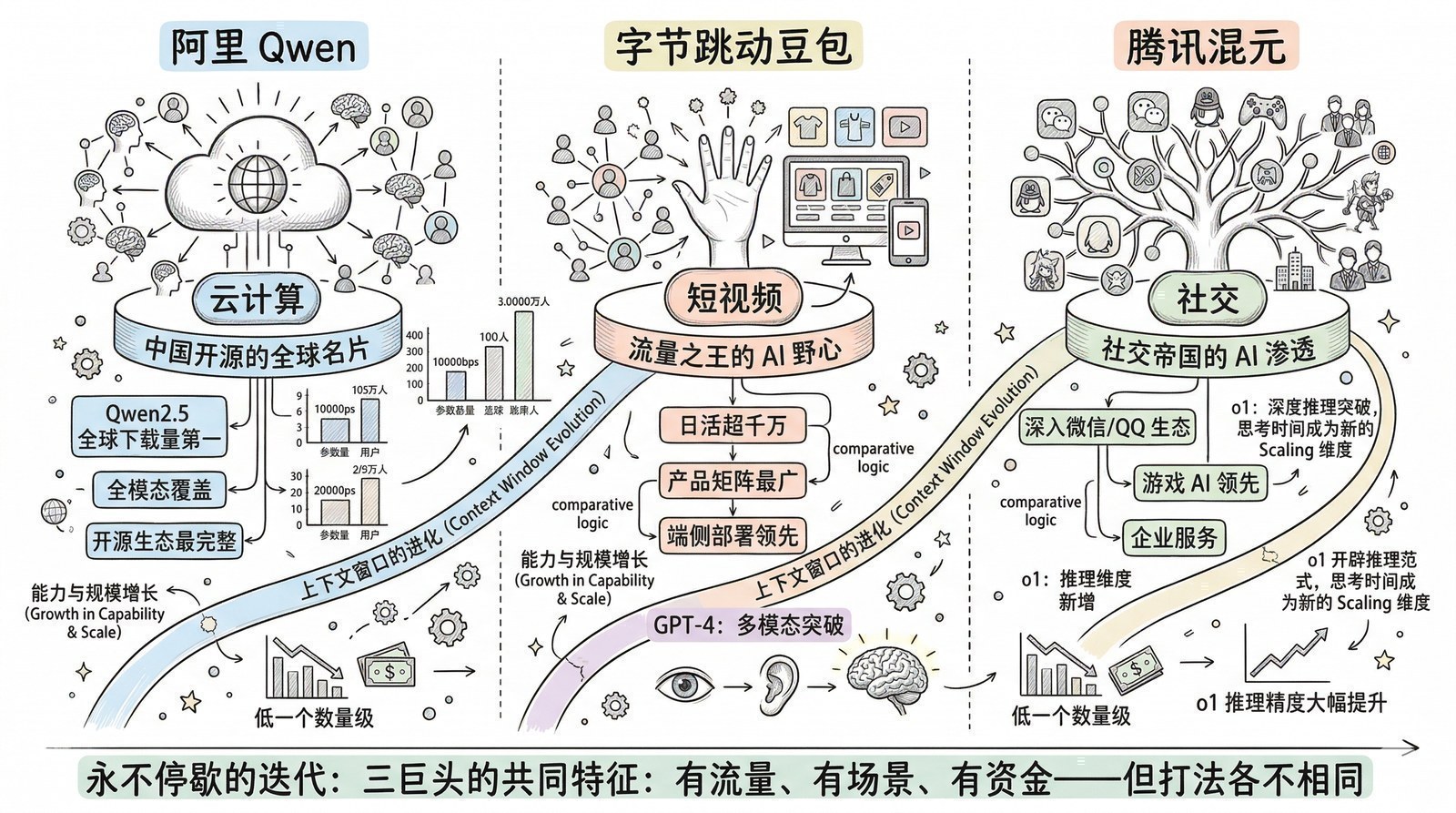

- 为什么2023年之后突然冒出来这么多大模型?(开源运动、效率革命、全球混战)

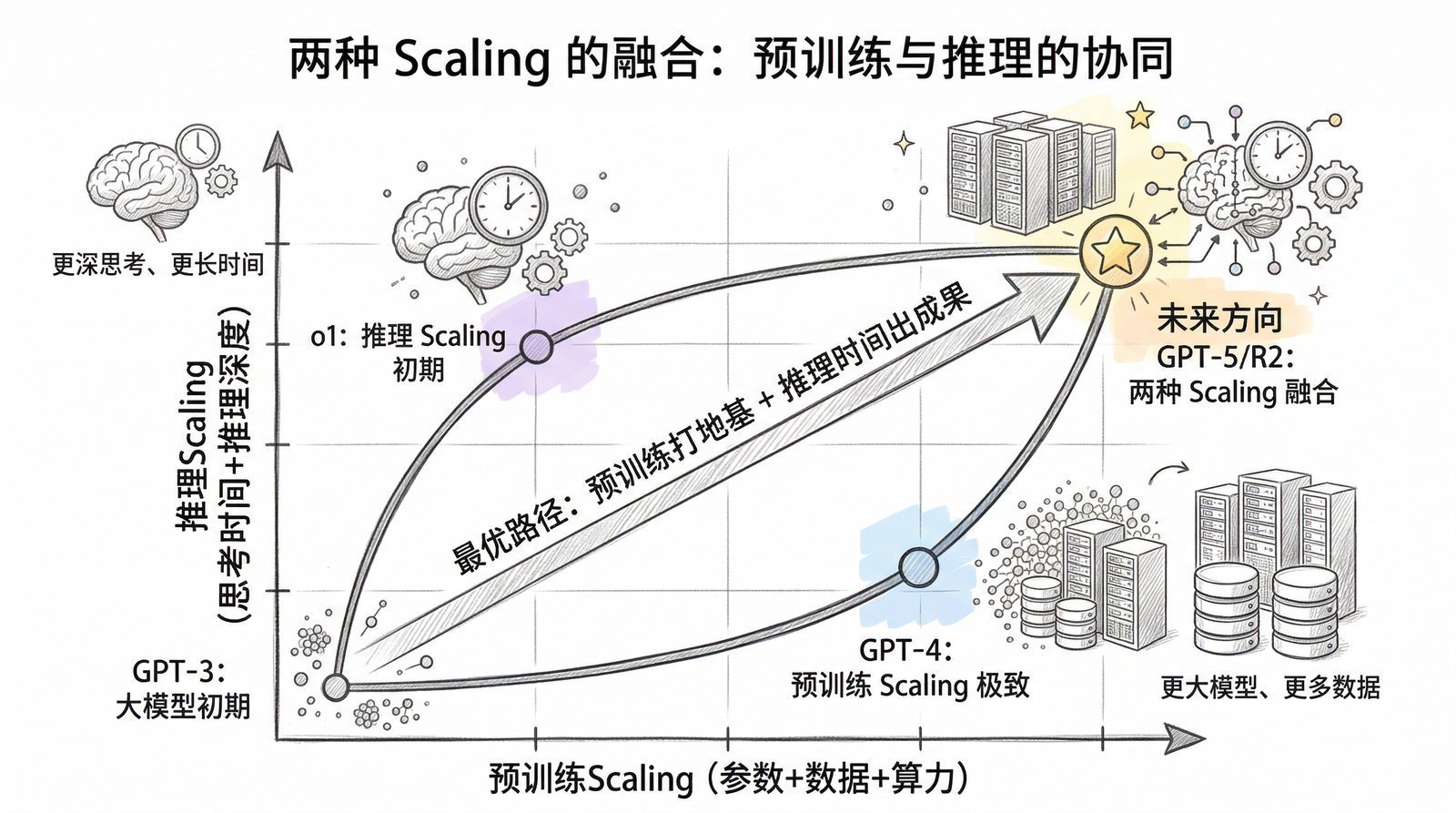

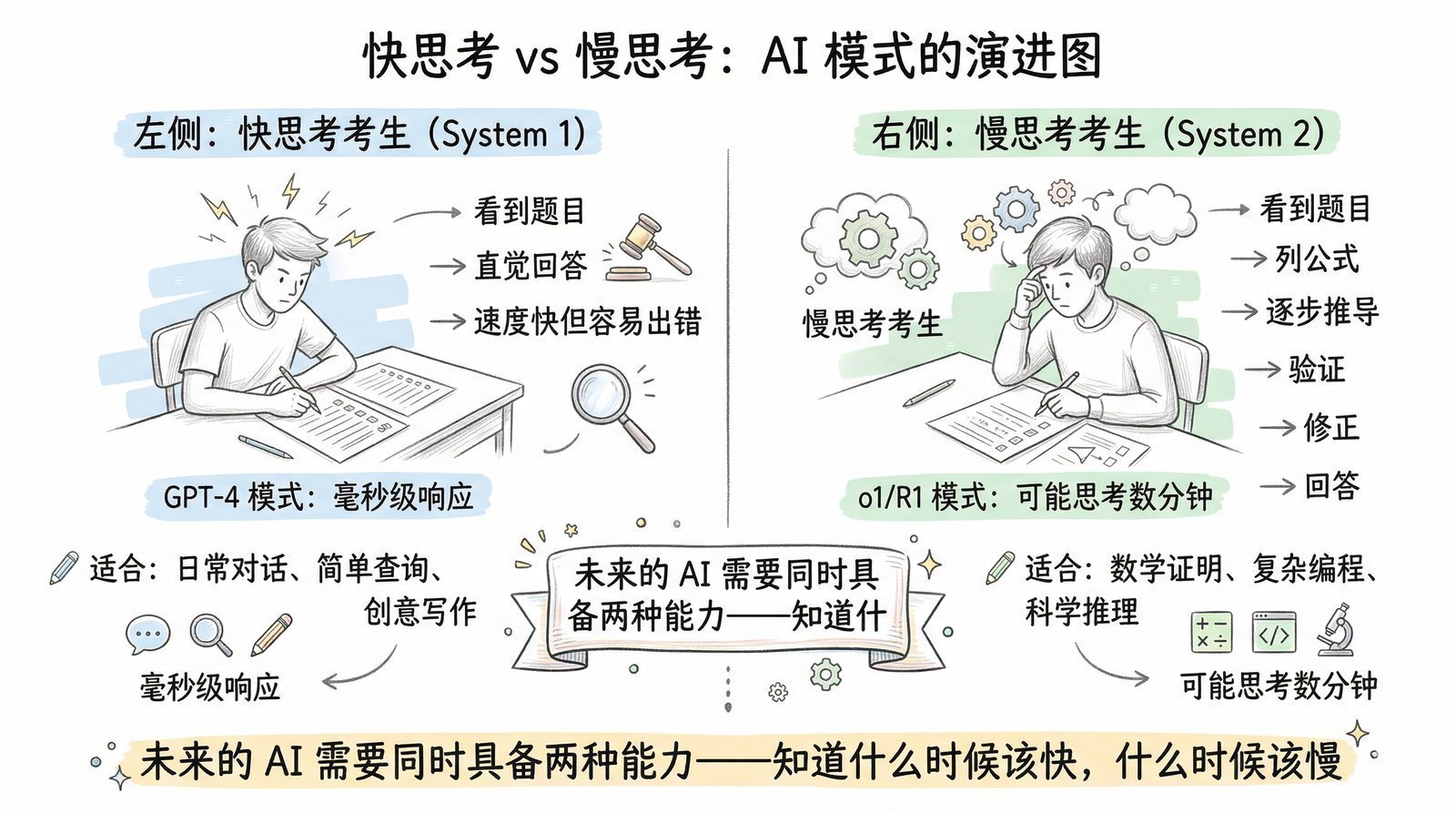

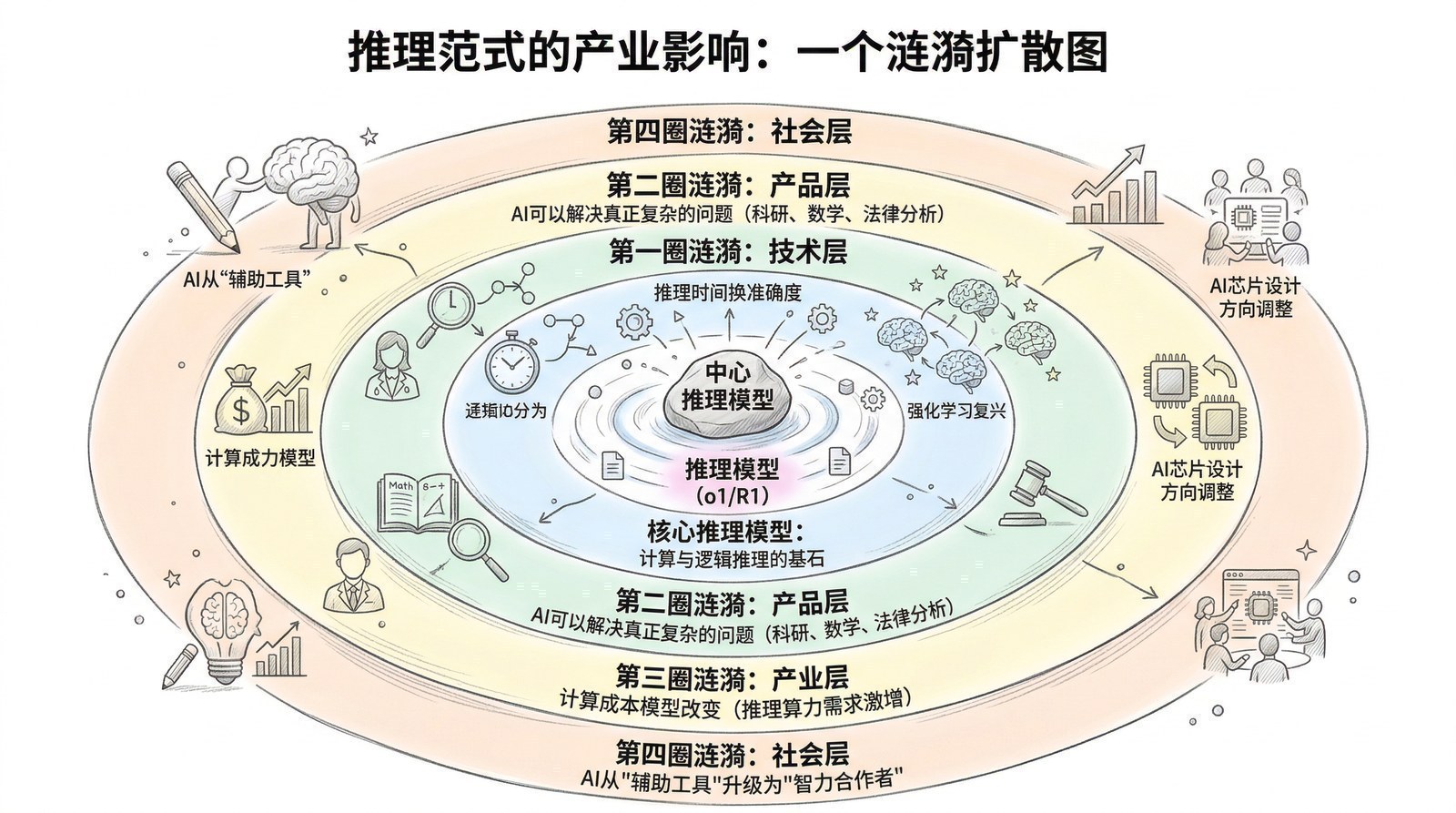

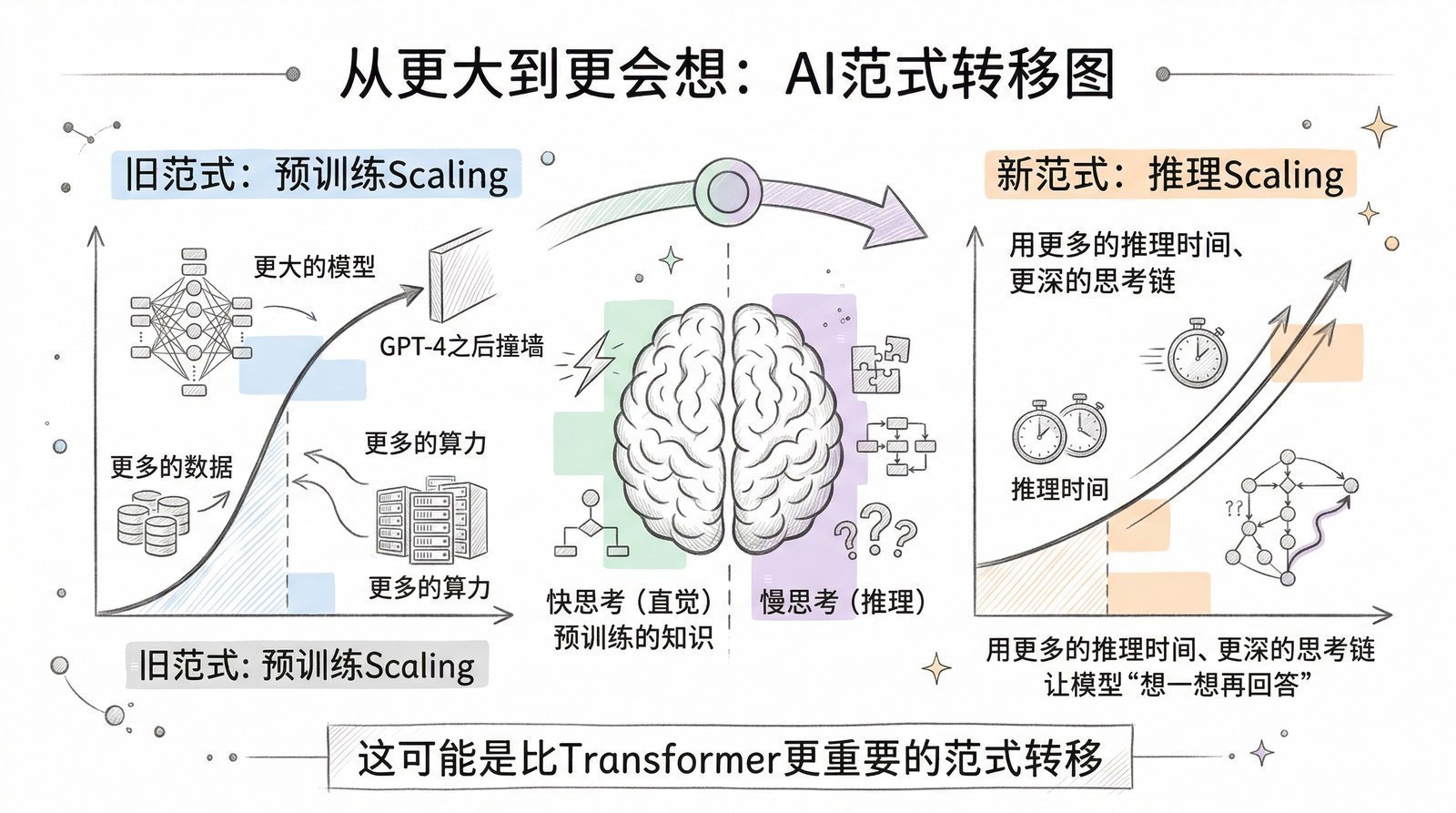

- AI是怎么从"快思考"进化到"慢思考"的?(从ChatGPT的直觉回答到o1/DeepSeek-R1[8]的深度推理)

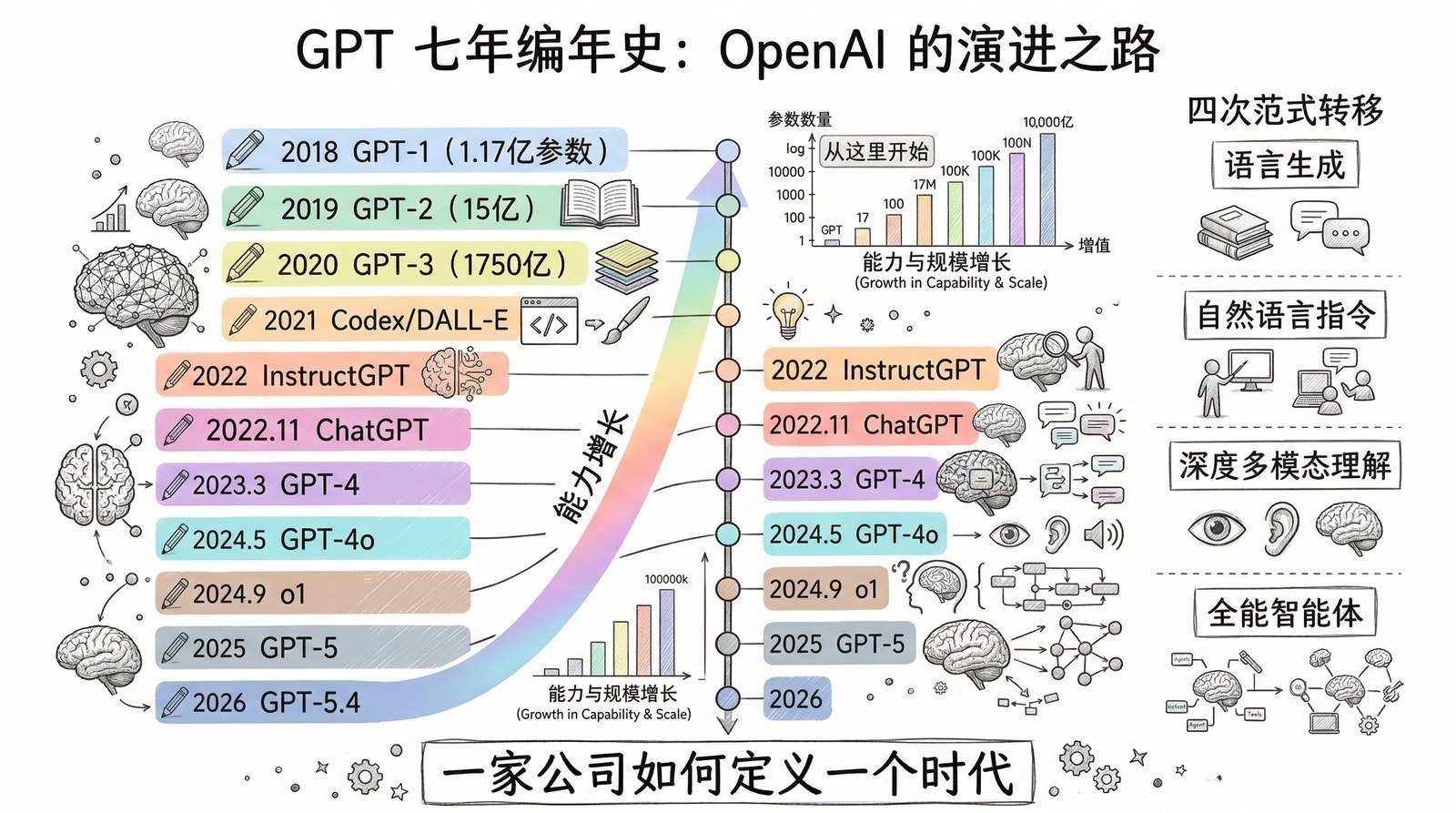

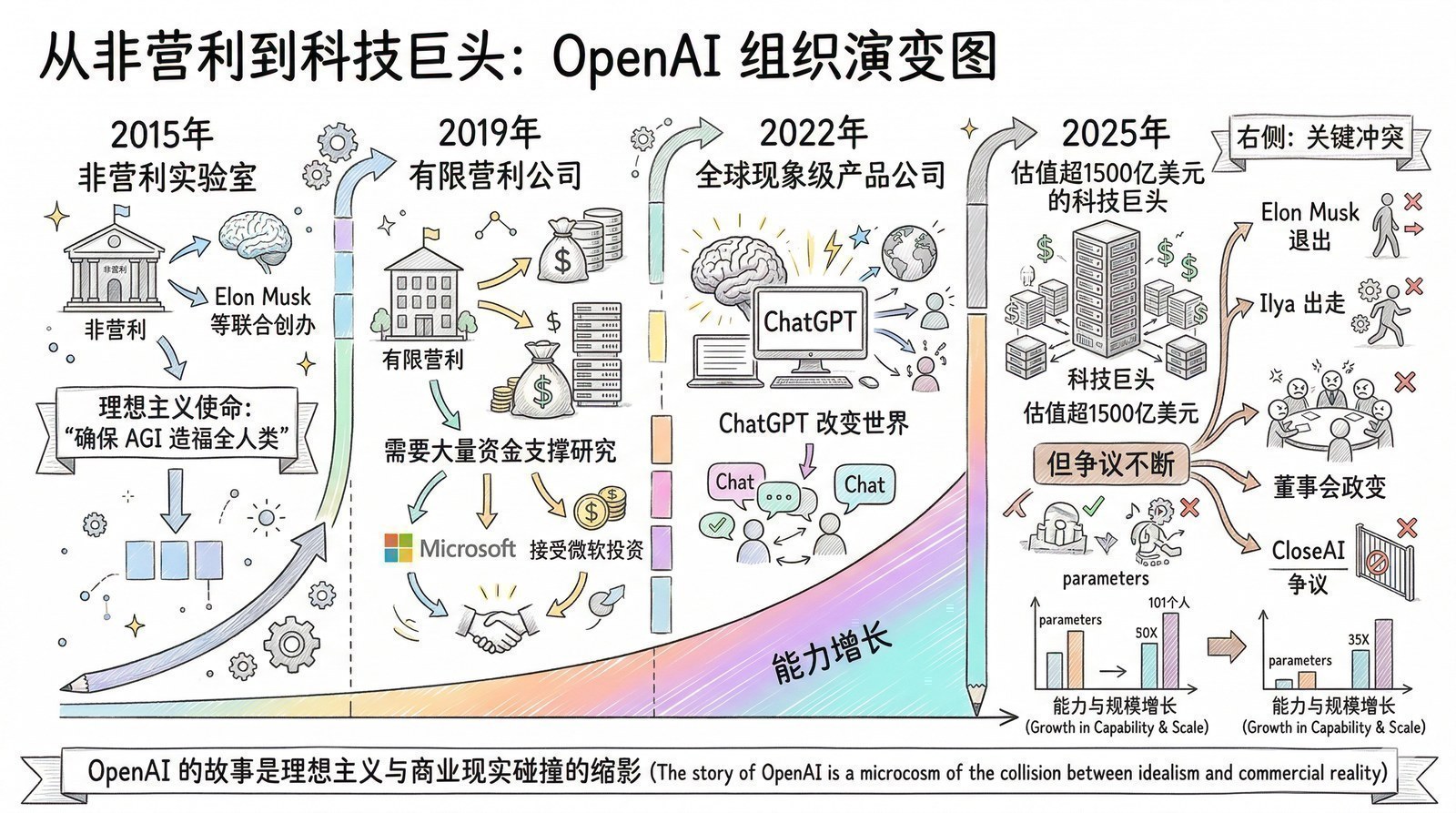

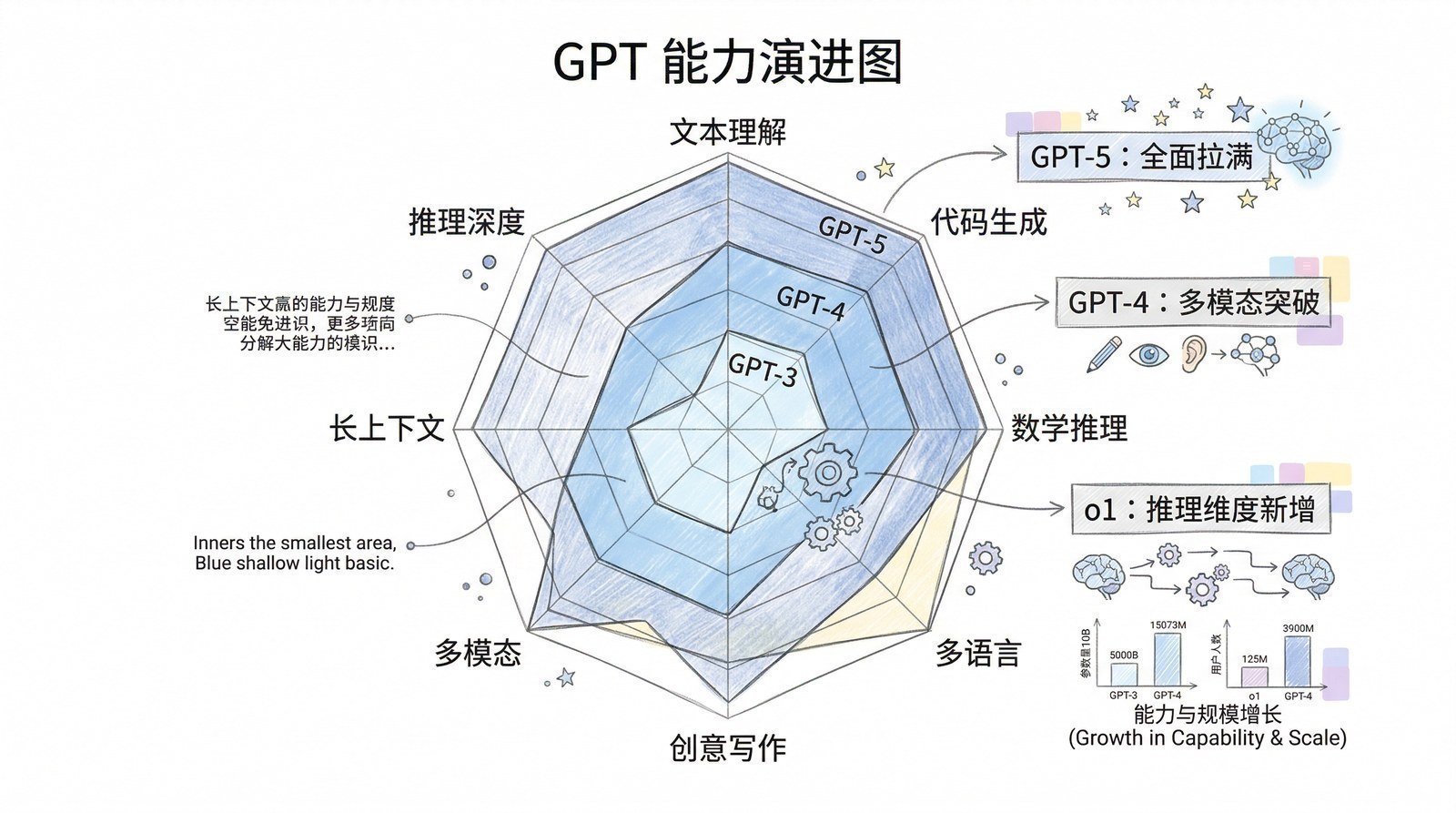

- OpenAI用七年走了一条什么样的路?(GPT-1[9]到GPT-5[13]的完整编年史)

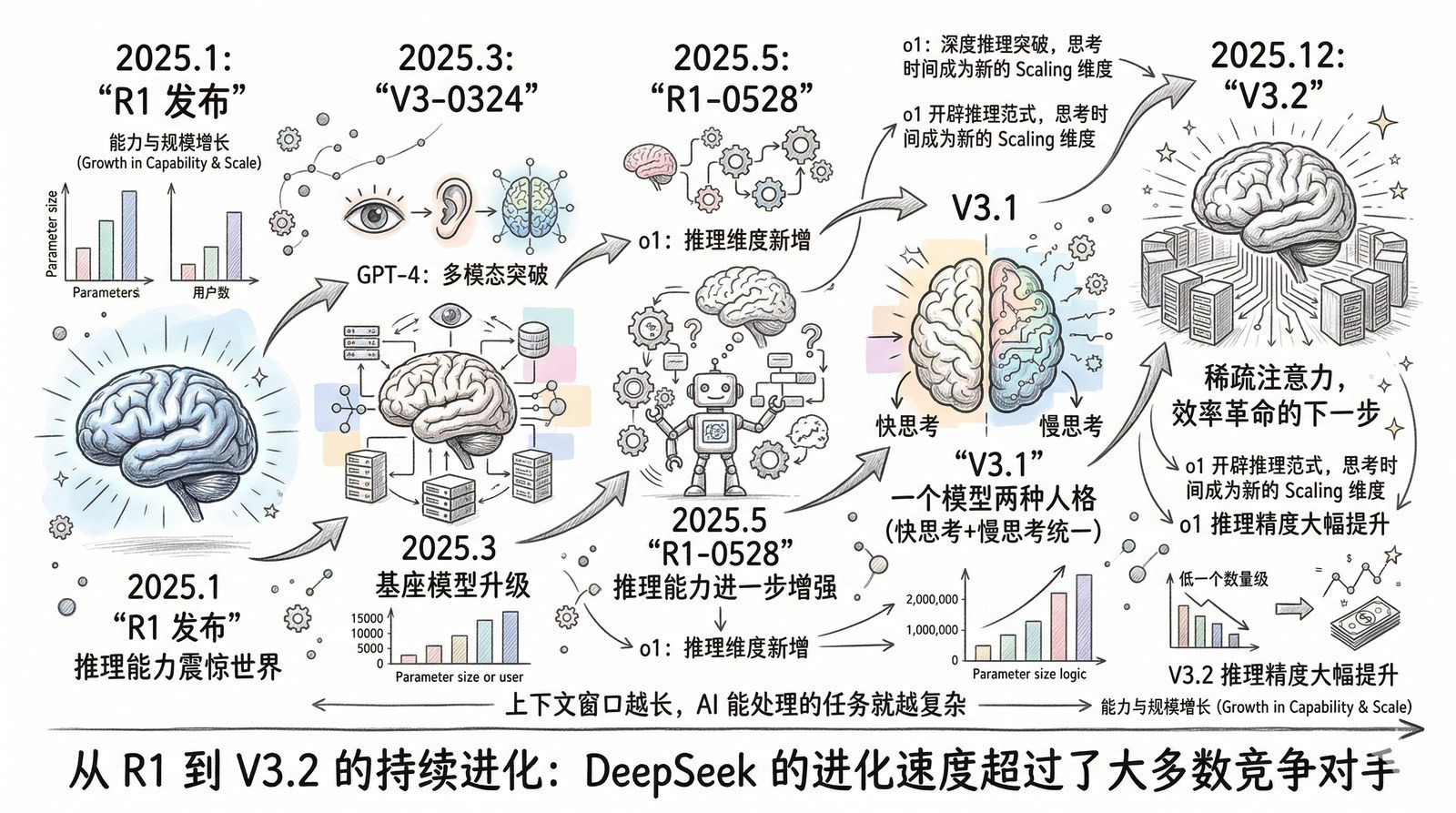

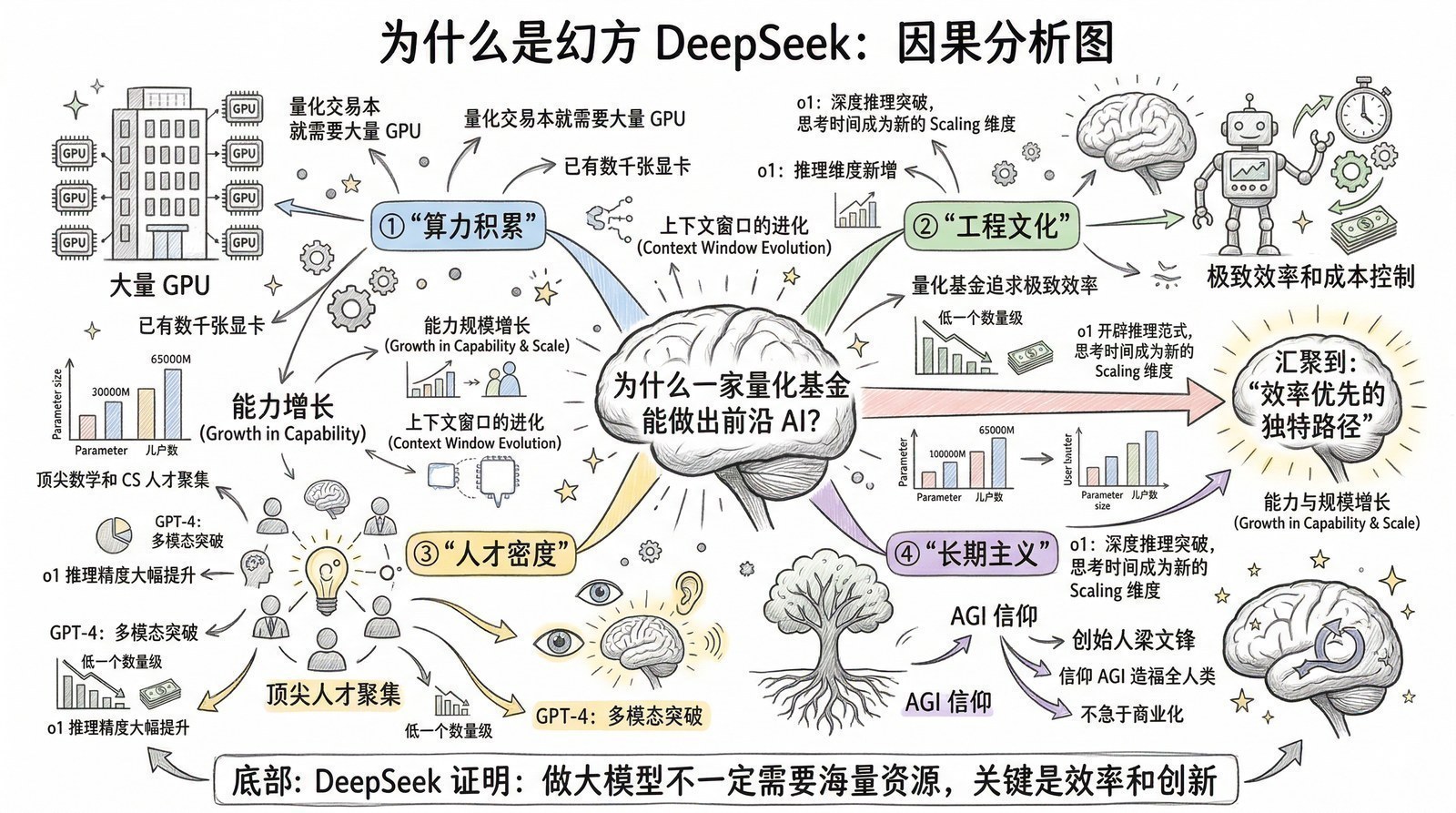

- DeepSeek用两年走了一条什么样的路?(17篇论文拼出的效率优先路线)

- 今天市面上几十个大模型,到底该怎么选?(一张开源大模型全景地图)

这个系列不讲什么

我想先管理一下预期。

不讲数学公式。 不会出现任何一行求导、矩阵运算或概率推导。每个技术概念都会用日常类比来解释。

不讲代码实现。 不会教你如何训练模型、如何调参数、如何部署。这些有大量优秀的技术教程,不需要我重复。

不做预测。 不会告诉你"AGI会在2027年到来"或者"某某公司会赢得AI竞赛"。我只呈现已经发生的事实和已被验证的规律,判断留给你自己。

不贩卖焦虑。 恰恰相反,我希望你读完这个系列后,焦虑能减少一些。因为当你看清了大模型的发展脉络,就会发现很多"颠覆性"新闻其实是技术演进的自然结果,既不需要恐慌,也不需要狂喜。

谁应该读这个系列

如果你符合以下任何一条,这个系列就是为你写的:

- 你用过ChatGPT、Claude或其他AI产品,觉得很厉害,但不太清楚"为什么厉害"和"还能厉害到什么程度"

- 你在工作中需要判断"这个需求能不能用AI做",但缺少技术直觉

- 你看到各种AI新闻感到兴奋又焦虑,想搞清楚哪些是真突破、哪些是炒作

- 你想理解OpenAI、DeepSeek、Meta、Google这些公司在做什么、为什么这么做

- 你是产品经理、运营、投资人、创业者,需要一个关于AI的"全局认知框架"

- 你想读论文但读不下去,需要一个"翻译者"

如果你是AI研究员或算法工程师,这个系列对你来说可能太浅了——你应该直接读原始论文。但如果你想找一份材料推荐给你的非技术同事,让他们快速理解你每天在做的事情,这个系列也许是个不错的选择。

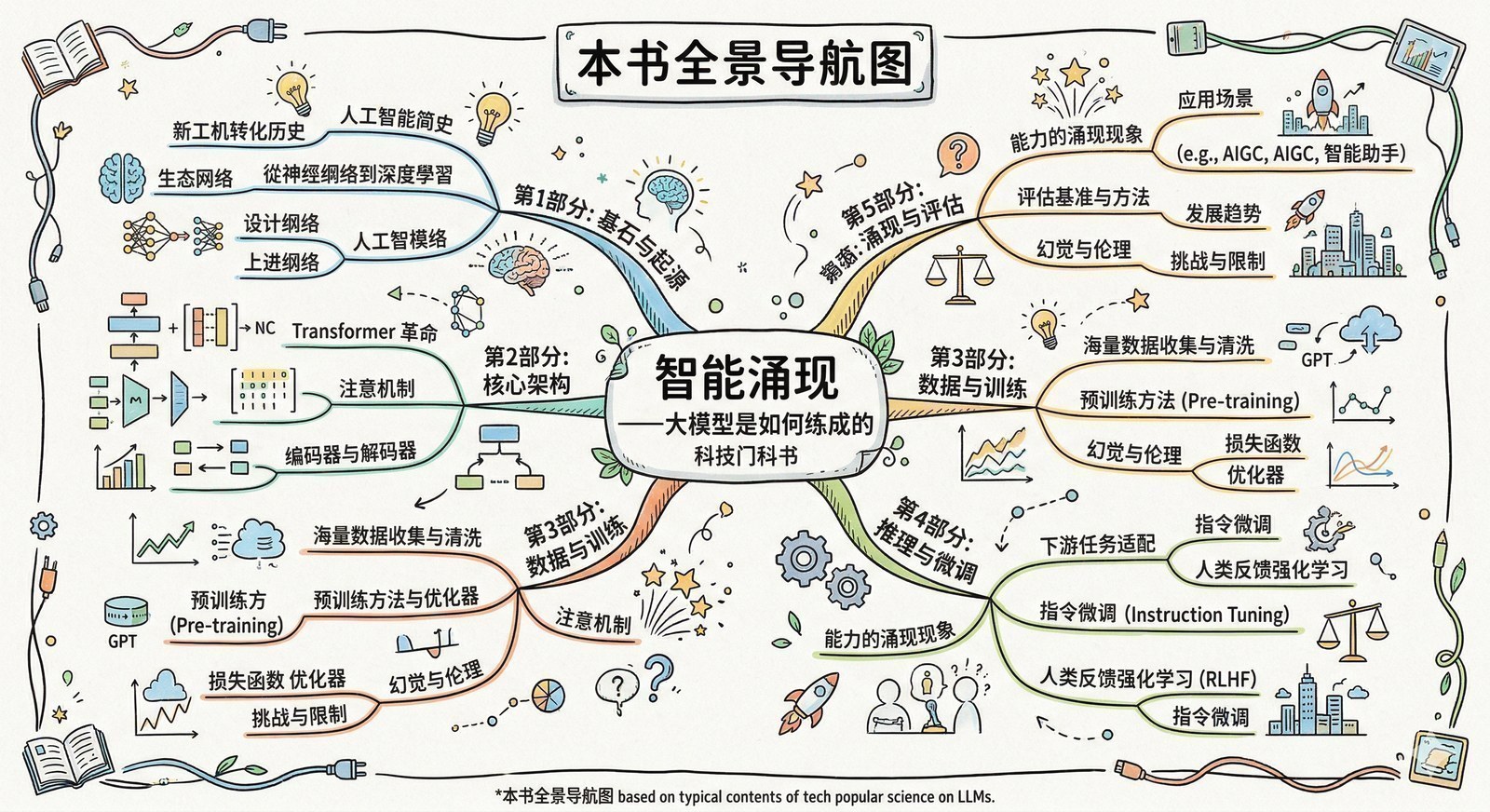

一张地图

在正式开始之前,让我给你一张"地图",帮你建立全局感。

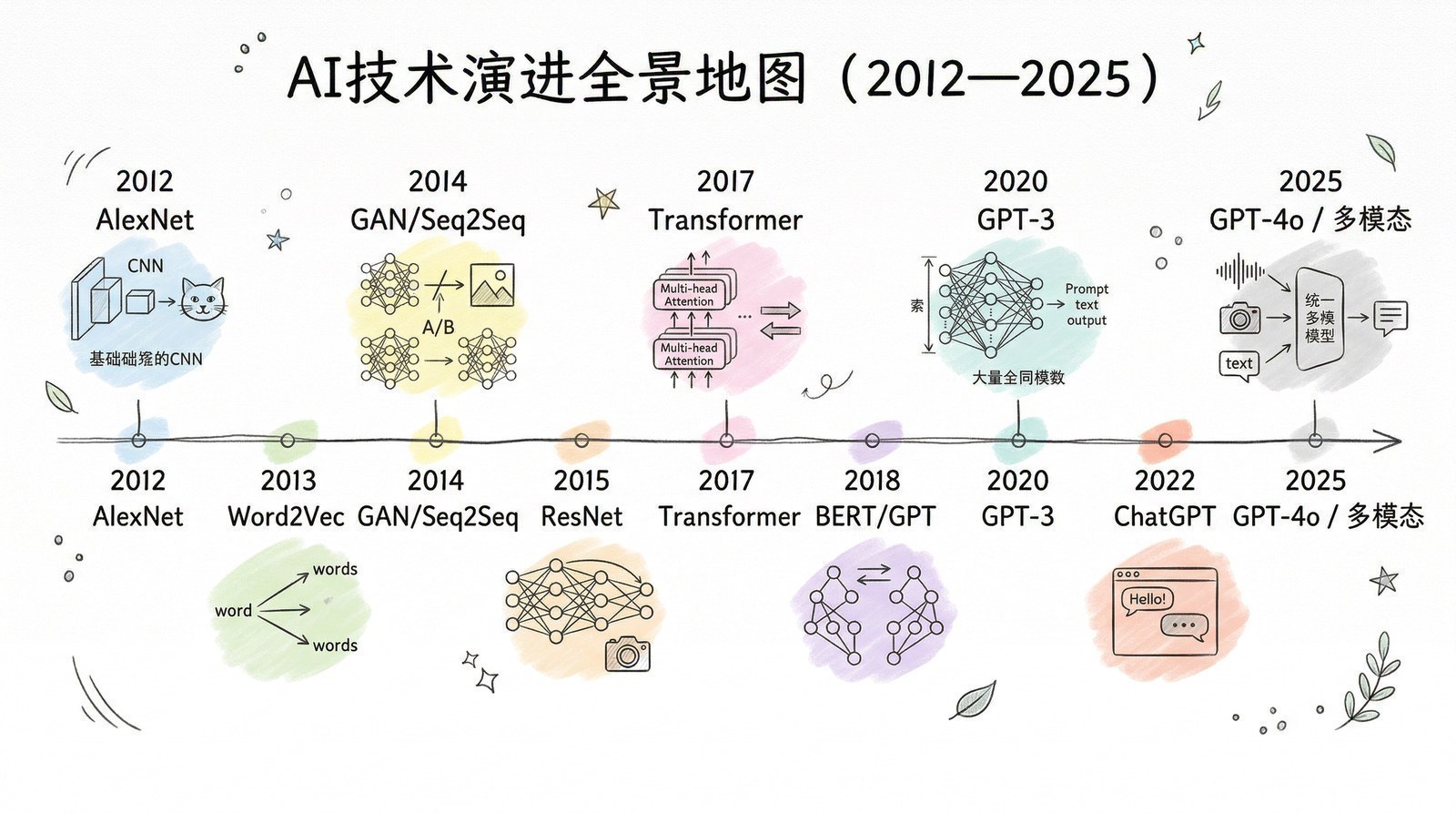

大模型从2012年到2025年的进化,可以浓缩成一条主线:

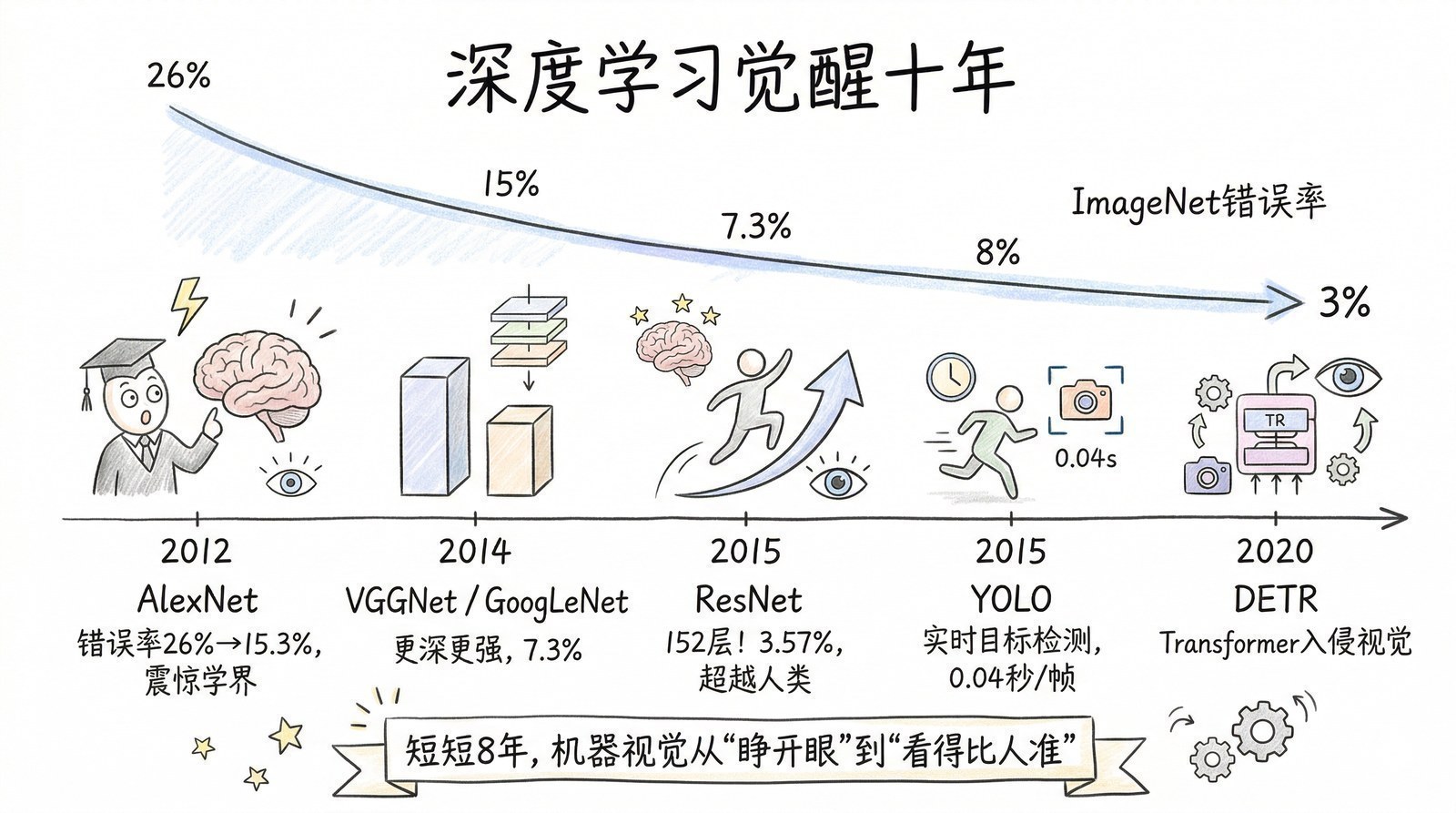

2012年——AI睁开眼睛,学会了看图,AlexNet[6]在ImageNet竞赛上碾压传统方法。

2015年——AI学会了"重点阅读",注意力机制[23]让模型能关注最重要的信息。

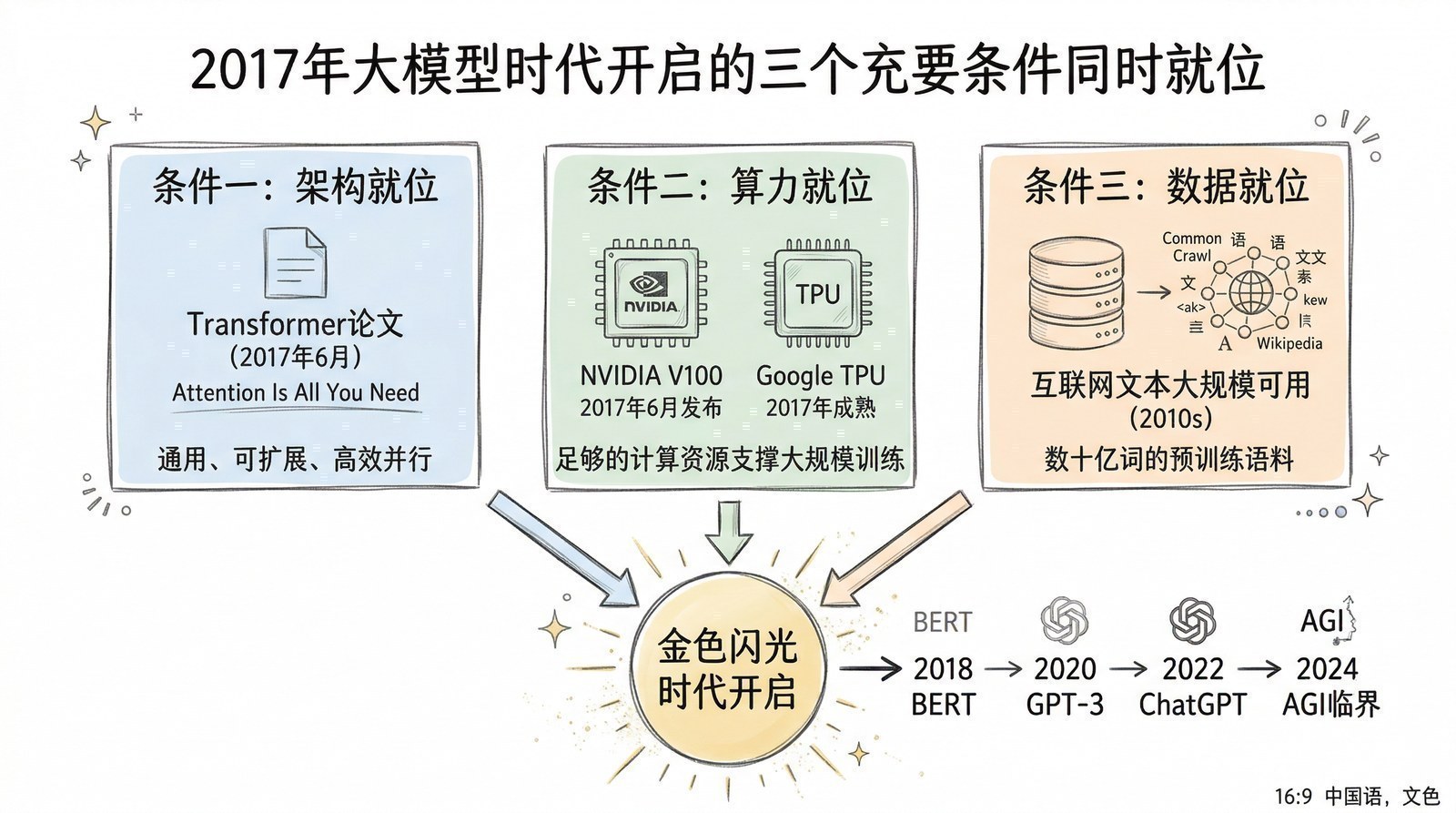

2017年——一篇论文统一了一切,Transformer[5]架构诞生,同年NVIDIA推出第一款AI专用芯片V100。

2018年——两条路线的分叉,Google的BERT[19]走"理解",OpenAI的GPT[9]走"生成"。

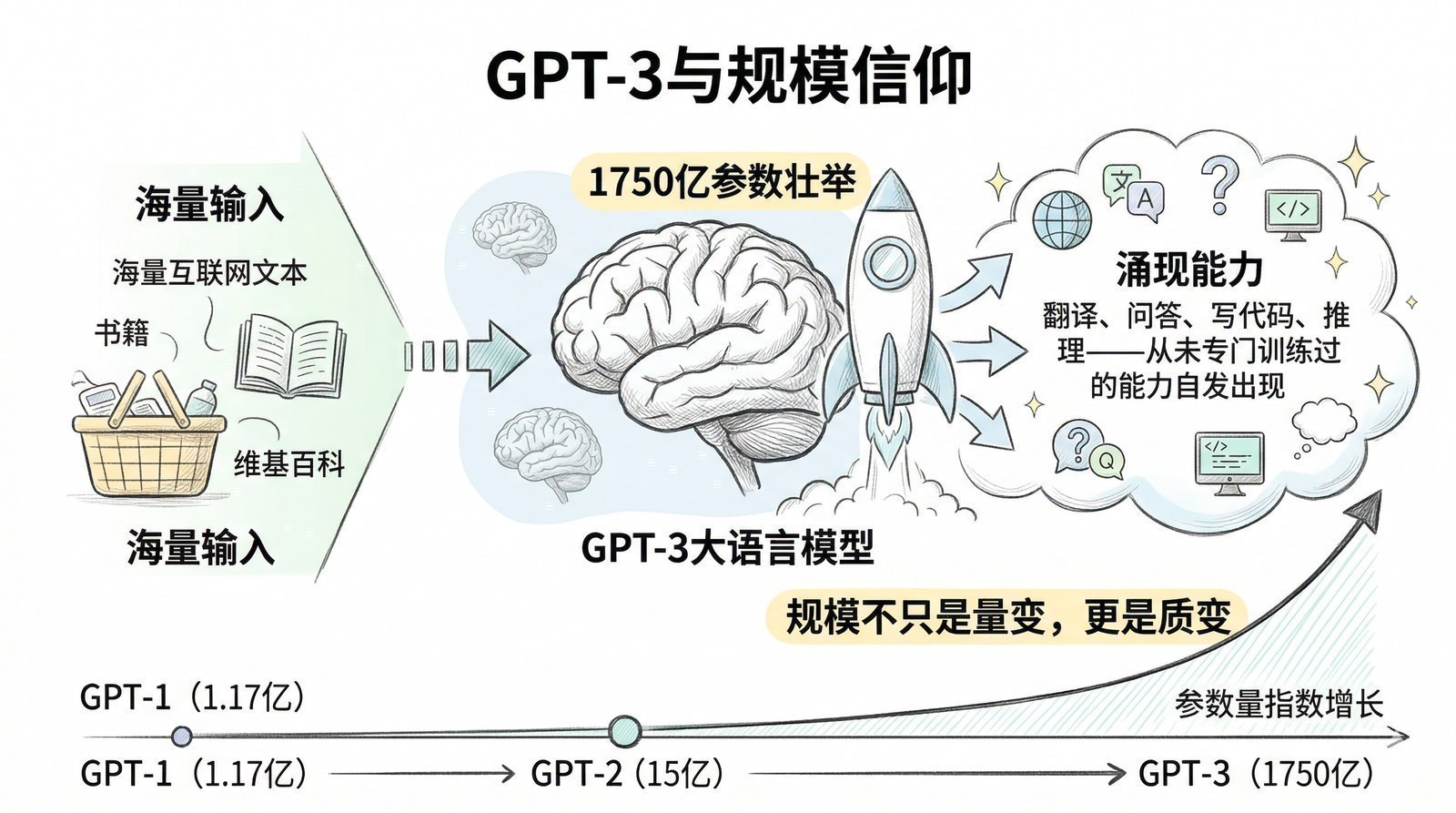

2020年——规模涌现奇迹,GPT-3[10]的1750亿参数证明:模型够大,能力自动涌现

2022年——AI学会听话,变成产品,InstructGPT[7] + RLHF → ChatGPT两月破亿。

2022年——从文字到画画,CLIP[2] + Diffusion[15] → Stable Diffusion / Midjourney / DALL-E 2引爆AI绘画。

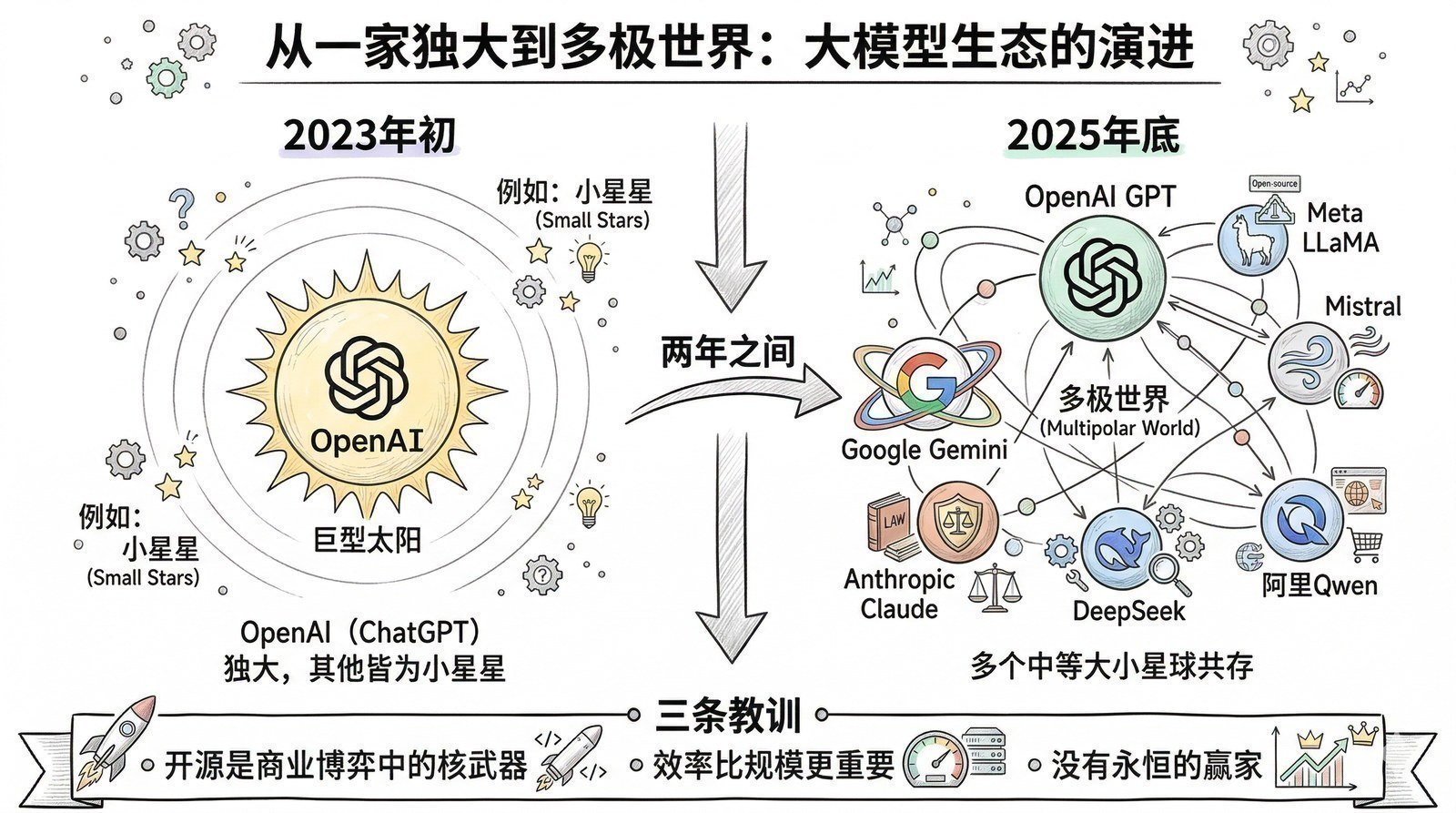

2023年——百家争鸣,Meta开源Llama,Google发布Gemini,Anthropic推出Claude,全球AI竞争白热化。

2024年——AI从"快思考"进化到"慢思考",OpenAI o1让模型学会"想一想再回答"。

2025年——DeepSeek-R1[8]震动全球,GPT-5[13]统一快慢思考,开源模型追平闭源

这条线上的每一个节点,背后都有几篇到十几篇论文支撑。接下来的14章,我会带你一个节点一个节点地走过去。

怎么读这个系列

如果你时间充裕——按顺序从第一章读到终章。全书的叙事是连贯的,每一章的结尾都会自然引出下一章的问题。

如果你只有两小时——读第四章(Transformer)、第七章(ChatGPT)、第十章(快思考到慢思考)。这三章覆盖了大模型历史上最重要的三次跳跃。

如果你只关心当下和未来——直接跳到第十章(推理模型)、第十二章(GPT编年史)、第十三章(DeepSeek现象)、第十四章(全景地图)。

如果你只想解决工作中的具体问题——翻到第十四章的"开源vs闭源决策框架"和终章的"从业者行动指南"。

无论你从哪里开始,我希望读完之后,你能获得三样东西:

一条时间线——大模型是怎么一步步走到今天的,每一步的因果关系是什么。

一张地图——当下几十个模型和公司各自在做什么,你该怎么看这个格局。

一种直觉——下次看到AI新闻时,你能判断它在整个进化链条上处于什么位置,是真突破还是渐进改良。

好了,让我们开始吧。

当然,我个人的基座模型能力、推理能力、记忆能力、上下文能力都有限,虽然也用了很多AI工具来协助我校验本文提到的事实、技术、产品的准确性,但是难免有出错的地方,还请大家多包容和指正。

第一站:2012年。一个叫Alex Krizhevsky的博士生,用两块游戏显卡训练了一个神经网络,让整个世界重新相信——机器可以学会"看见"。

本章引用论文

| 编号 | 论文题目 | 年份 | 机构 |

|---|---|---|---|

| [1] | GPT-4 Technical Report | 2023 | OpenAI |

| [2] | CLIP: Learning Transferable Visual Models From Natural Language Supervision | 2021 | OpenAI |

| [3] | SimCLR: A Simple Framework for Contrastive Learning of Visual Representations | 2020 | |

| [4] | MoCo: Momentum Contrast for Unsupervised Visual Representation Learning | 2019 | FAIR (Meta) |

| [5] | Attention Is All You Need (Transformer) | 2017 | |

| [6] | ImageNet Classification with Deep Convolutional Neural Networks (AlexNet) | 2012 | Toronto |

| [7] | InstructGPT: Training Language Models to Follow Instructions with Human Feedback | 2022 | OpenAI |

| [8] | DeepSeek-R1: Incentivizing Reasoning Capability in LLMs via Reinforcement Learning | 2025 | DeepSeek |

| [9] | GPT-1: Improving Language Understanding by Generative Pre-Training | 2018 | OpenAI |

| [10] | GPT-3: Language Models are Few-Shot Learners | 2020 | OpenAI |

| [11] | DeepSeek-OCR: Contexts Optical Compression / DeepSeek-OCR 2: Visual Causal Flow | 2025 | DeepSeek |

| [12] | Sora: Video Generation Models as World Simulators | 2024 | OpenAI |

| [13] | GPT-5 System Card | 2025 | OpenAI |

| [14] | DiT: Scalable Diffusion Models with Transformers | 2022 | Meta/UC Berkeley |

| [15] | DDPM: Denoising Diffusion Probabilistic Models | 2020 | UC Berkeley |

| [16] | Mastering the Game of Go Without Human Knowledge (AlphaGo Zero) | 2017 | DeepMind |

| [17] | Chain-of-Thought Prompting Elicits Reasoning in Large Language Models | 2022 | |

| [18] | Google's Neural Machine Translation System (GNMT) | 2016 | |

| [19] | BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding | 2018 | |

| [20] | Scaling Laws for Neural Language Models | 2020 | OpenAI |

| [21] | ZeRO: Memory Optimizations Toward Training Trillion Parameter Models | 2019 | Microsoft |

| [22] | MegaScale: Scaling Large Language Model Training to More Than 10,000 GPUs | 2024 | ByteDance |

| [23] | Neural Machine Translation by Jointly Learning to Align and Translate (Bahdanau Attention) | 2015 | Montreal |

第一章:让机器"看见"——深度学习觉醒与计算机视觉的胜利

两块游戏显卡改变世界

2012年9月30日,加拿大多伦多大学的一个三人小组向ImageNet大规模视觉识别挑战赛(ILSVRC)提交了他们的参赛作品。

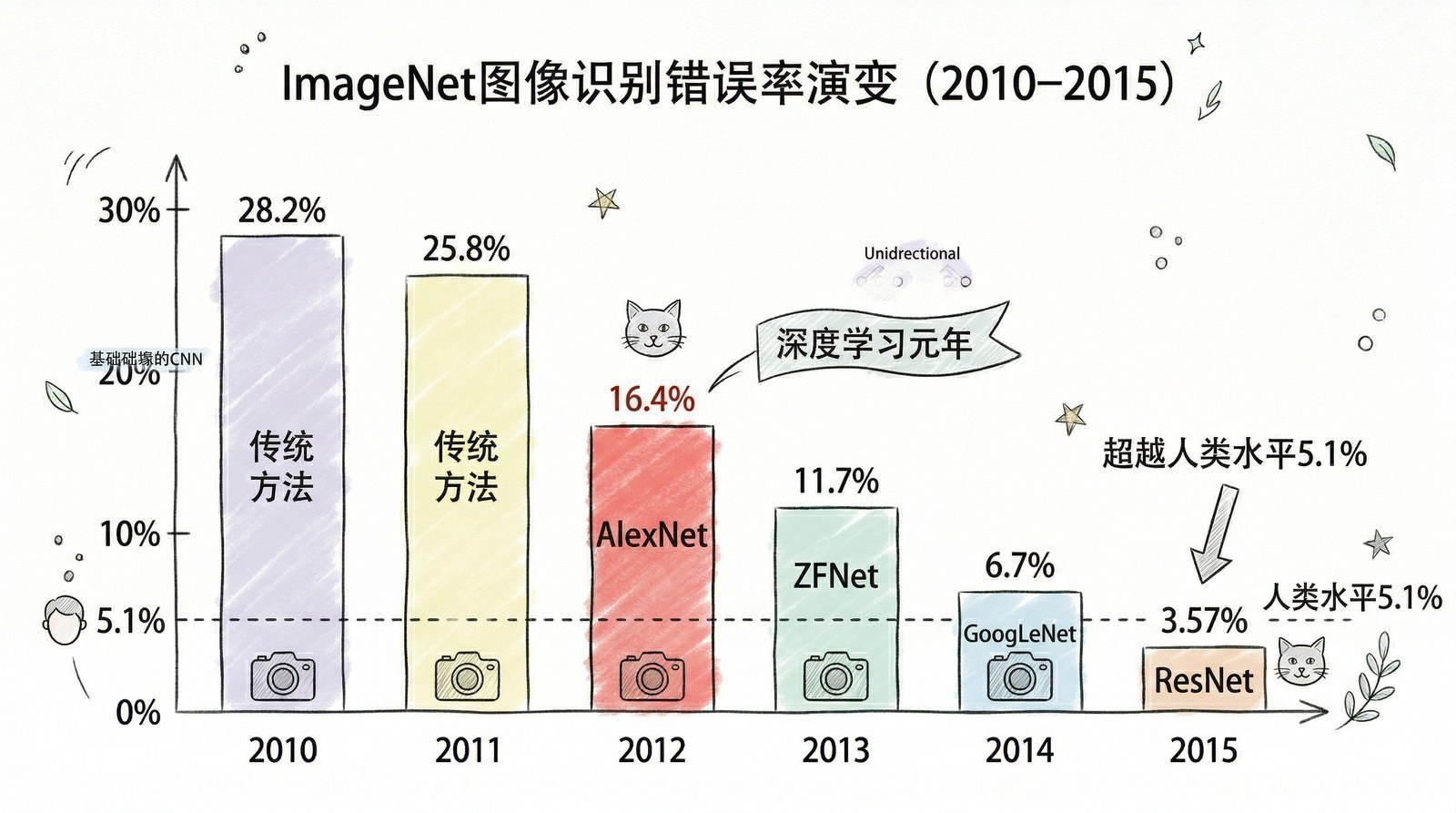

ImageNet竞赛的规则很简单:给计算机一张图片,让它猜这是什么东西——从"金鱼"到"火山"到"吉他",总共1000个类别。衡量标准是Top-5错误率——计算机可以猜5次,如果5次都没猜对,就算错。这是计算机视觉领域的"高考",全球最顶尖的团队每年都会参加。

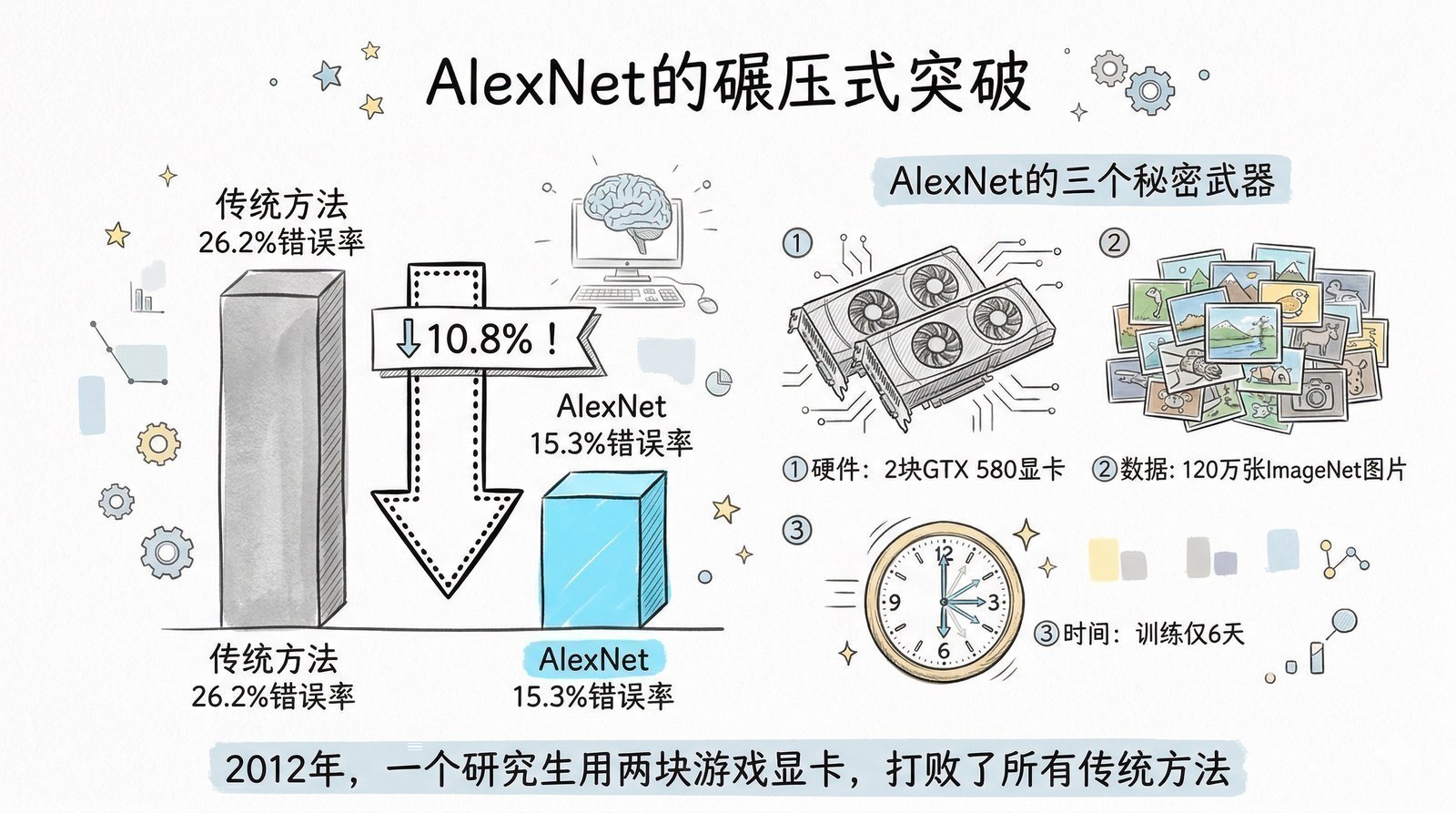

在AlexNet[1]出现之前的2010年和2011年,参赛系统用的都是手工设计的特征提取器——研究者需要亲手编写算法来告诉计算机"边缘长什么样""纹理长什么样""颜色分布是什么",然后把这些特征喂给一个支持向量机(SVM)做分类。说白了,这种方法的核心是人的智慧,而不是机器的学习。两年来最好的成绩是Top-5错误率25%-26%——也就是说,每四张图片计算机就会彻底认错一张。

Alex Krizhevsky,一个乌克兰裔的加拿大博士生,和他的导师Geoffrey Hinton——后来被称为"深度学习教父"、2024年诺贝尔物理学奖得主——以及师兄Ilya Sutskever(后来成为OpenAI的联合创始人和首席科学家,2024年离开OpenAI创办了安全超级智能公司SSI),提交了一个完全不同的方案。

他们没有手工设计任何特征。而是搭了一个8层深的卷积神经网络——一种模拟人类视觉皮层结构的计算模型——然后让它在120万张标注图片上自己"学会"区分不同物体。

训练这个网络用的硬件是什么?不是什么超级计算机。是两块NVIDIA GTX 580——一款零售价不到500美元的游戏显卡。总显存加起来不到3GB。训练跑了大约6天。

结果出来的时候,所有人都震惊了。

AlexNet的Top-5错误率是15.3%,而第二名是26.2%。不是微弱优势,是碾压——足足低了10.8个百分点,超过了此前整个领域三年的进步幅度之和。

要知道,在学术竞赛中,哪怕0.5%的进步都值得发一篇论文。10.8个百分点的差距,几乎等于宣告:过去几十年,你们方向都走错了。

这个结果在计算机视觉学术界引发了一场地震。原本被视为"过时玩具"的神经网络,突然以令人无法反驳的方式证明了自己的价值。第二年的ImageNet竞赛,几乎所有参赛团队都改用了深度学习。

用今天的眼光看,AlexNet的架构简单得像一个课程作业——8层网络、几千万个参数、两块游戏显卡。放在2025年,这连一个手机上的AI模型都算不上。但正是这个朴素的网络,撕开了深度学习三十年冬眠的幕布,让整个世界重新相信——机器可以学会"看见"。

这篇论文后来成为机器学习历史上被引用最多的论文之一。而它的三位作者,也从此走上了截然不同的人生轨迹:Hinton获得了图灵奖和诺贝尔奖,成为AI时代最受尊敬的学者之一;Sutskever参与创建了OpenAI,主导了GPT系列的早期研发,塑造了今天大模型的基本形态;Krizhevsky短暂加入Google后逐渐淡出公众视野——但他点燃的那把火,至今还在燃烧。

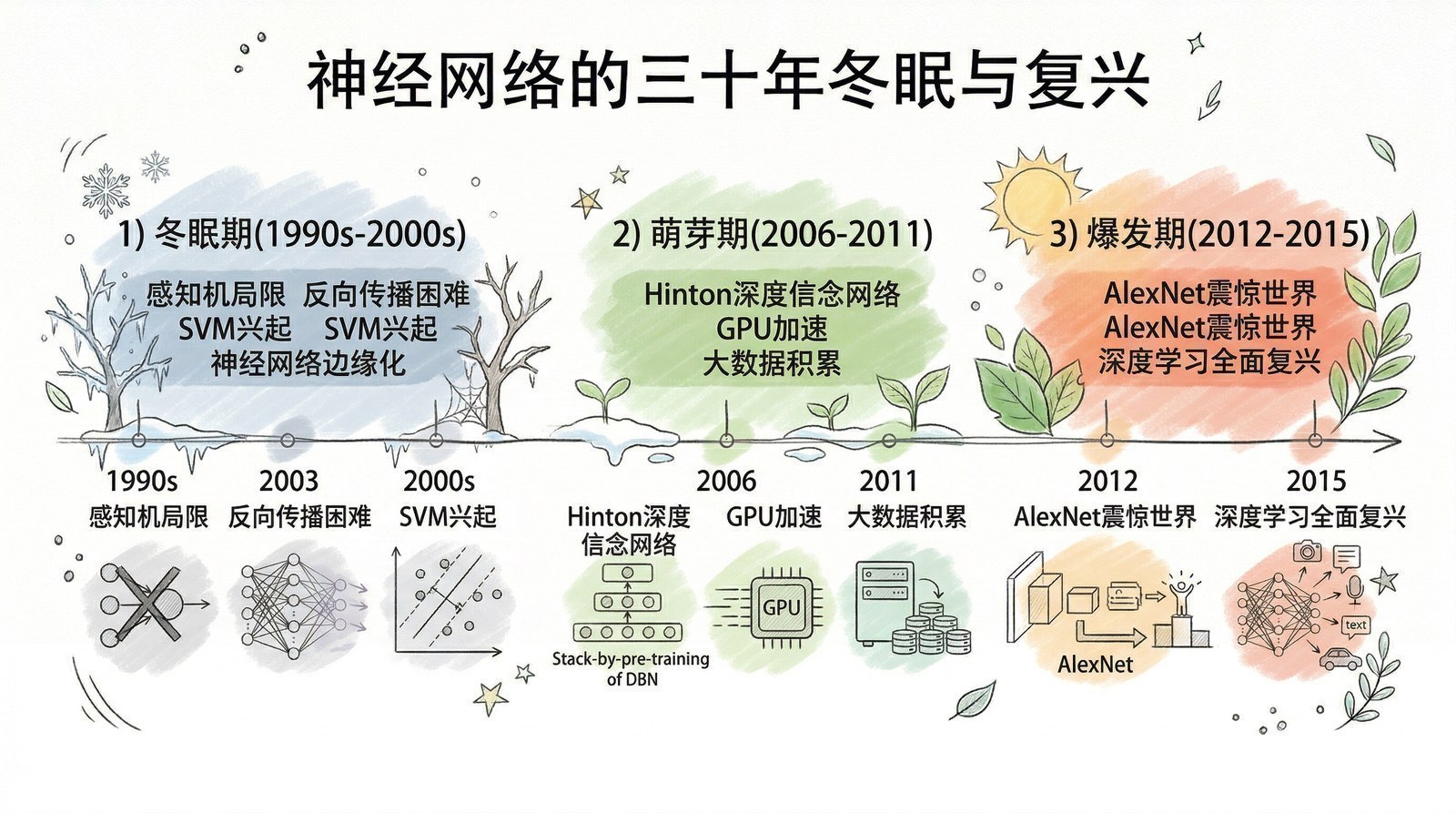

AI的三十年冬眠与一个被忽视的真相

要理解2012年的震撼,需要先理解此前的沉寂。

神经网络的想法最早可以追溯到1950年代。1989年,Yann LeCun在贝尔实验室用一个5层的卷积神经网络(LeNet)来识别手写支票上的数字,效果不错,被用于美国银行系统处理了数十亿美元的支票。但之后的二十多年里,神经网络几乎被整个学术界抛弃了。

原因有三个:

第一,算力不够。 训练一个稍微深一点的网络需要的计算量,在1990年代的CPU上要跑几个月甚至几年。没人等得起,也没人愿意为一个看起来"不靠谱"的方法投入这么多计算资源。

第二,数据不够。 LeNet能识别手写数字,只有10个类别,几万张图片。但真实世界有几万种物体,需要几百万甚至上千万张标注图片。这种规模的标注数据集在2000年代之前根本不存在——谁会花几年时间去给上千万张图片一张张打标签呢?

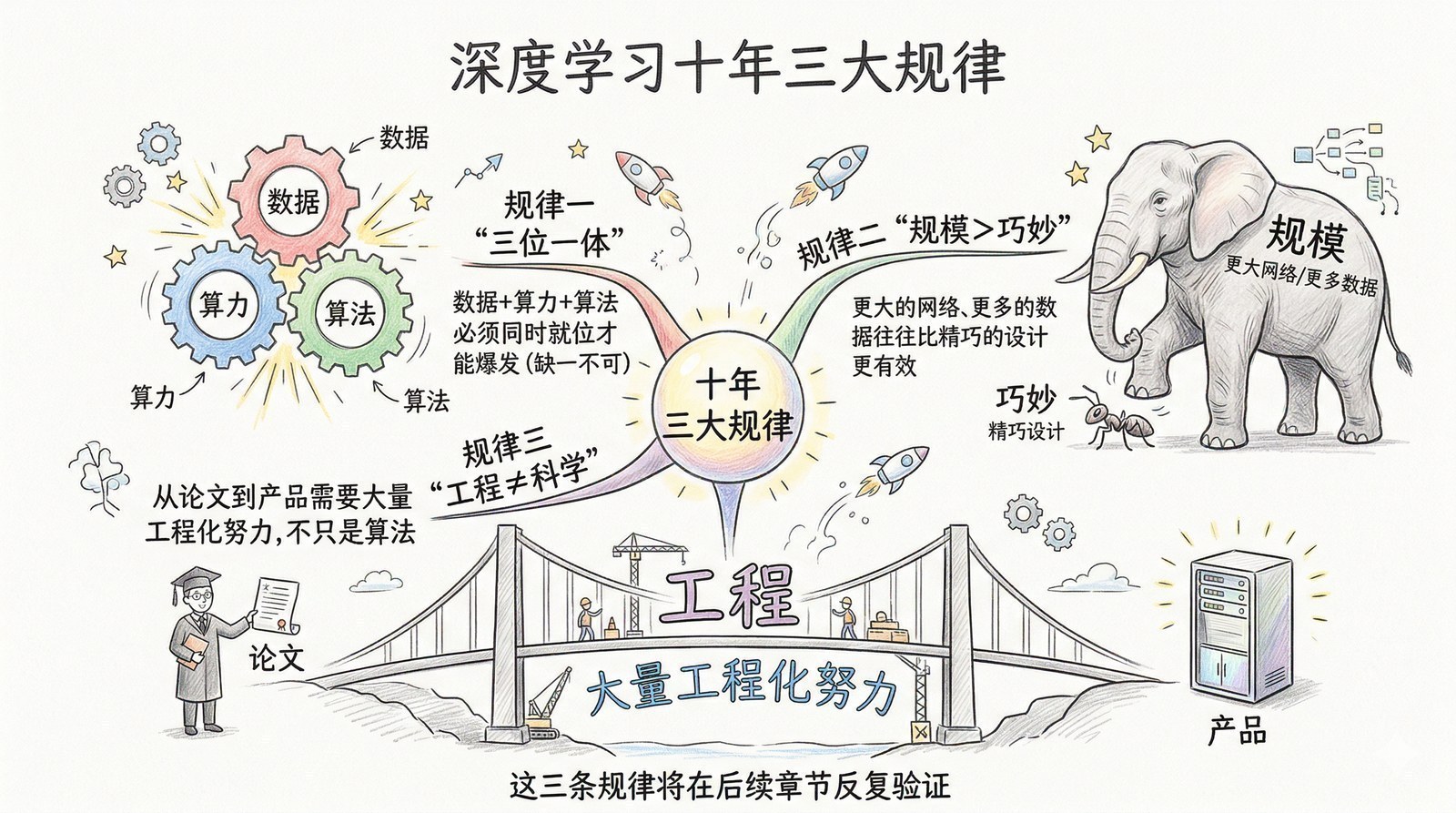

第三,"浅层"方法够用了。 支持向量机(SVM)、随机森林这些"传统"机器学习方法在小数据集上表现不差,而且有严格的数学理论支撑——你能证明它为什么有效。相比之下,神经网络像一个"黑箱"——效果不稳定,理论不清楚,训练困难,还容易过拟合。在"能解释"和"效果好"之间,学术界选择了前者。

更深层的原因是,那个时代的研究者忽视了一个后来被证明至关重要的真相:算法的能力不是孤立存在的,它必须建立在数据规模和算力规模之上。 在小数据、弱算力的条件下,精巧设计的手工特征确实比粗糙的神经网络更好用。但这并不意味着神经网络"不行",只是说它的威力需要在更大的尺度上才能展现出来。

Richard Sutton——强化学习领域的先驱——在2019年写了一篇著名的短文《The Bitter Lesson》(苦涩的教训)[24],回顾了AI六十年的历史后得出一个尖锐的结论:每一次,那些试图依靠人类知识和精巧设计的方法,最终都会被"简单方法+大规模计算"所打败。 人类一次又一次地低估了"规模"的力量,一次又一次地高估了"巧妙"的价值。

这个洞见在2012年被AlexNet第一次验证:手工设计的特征提取器(巧妙+小规模)输给了粗糙的卷积神经网络(简单+大规模GPU计算+大规模数据)。八年后,它又在GPT-3身上被再次验证:精心设计的小模型输给了"暴力堆参数"的大模型。这条规律贯穿了本书的每一章。

AI不仅仅是算法。它是算法、数据、算力和系统的整体协同进化。 任何一个要素的缺失,都会让其他要素无法发挥作用。AlexNet的成功不是某一个突破的功劳,而是三个条件同时成熟的结果:

2004年:GPU可以做通用计算了。 Stanford大学的Ian Buck等人发表了Brook for GPUs[2],证明图形处理器可以做通用计算。两年后NVIDIA推出CUDA平台,让程序员可以用类似C语言的方式编写GPU程序。GPU原本是为了渲染游戏画面中的成千上万个像素而设计的——它天生擅长大规模并行计算。而神经网络的核心运算——矩阵乘法——恰好也是大规模并行的。这个巧合为后来的一切铺好了路。

2009年:ImageNet诞生。 斯坦福大学的李飞飞教授花了两年多时间,用亚马逊Mechanical Turk众包平台组织标注,建成了一个包含超过1400万张图片、涵盖2万多个类别的数据集。在一个大多数人还在用几千张图片做实验的年代,这个规模堪称疯狂。很多同行不理解:花这么大力气收集数据有什么意义?算法才是关键啊。但李飞飞坚信,数据的规模和多样性是AI进步的根本驱动力——而不是更精巧的算法。后来的历史证明她是对的。

2012年:三者同时就位。 GPU提供了算力,ImageNet提供了数据,更深的卷积网络结构提供了模型表达能力。AlexNet是第一个同时站在这三条腿上的系统。

从此,AI从冬眠中苏醒,而它睁开眼睛后做的第一件事,是学会"看见"。

从"看见"到"看懂":图像识别的飞跃

AlexNet打开了大门,但它只是开始。接下来三年,卷积神经网络(CNN)的深度和能力以每年一个台阶的速度飞速攀升。

2014年的VGGNet做到了19层,证明"更深的网络效果更好"这条直觉是正确的。但当研究者试图继续往深里做——50层、100层——的时候,遇到了一个诡异的问题:网络越深,反而越不准。 梯度信号在层层传递中"消失"了,深层根本学不到东西。这被称为"梯度消失"问题,一度被认为是深度网络不可逾越的障碍。

2015年:ResNet让网络可以"无限深"[3]

微软亚洲研究院的何恺明等人提出了一个极其优雅的解决方案:快捷连接(shortcut connection)——让每一层的输入可以"抄近道"直接传到后面,跳过中间的变换层。

这是什么意思?打个比方:假设你要把一句话从中文翻译成英文,传统的方式是每一层做一点变换,一层层传递下去。但到了第100层,原始信息可能已经面目全非了。快捷连接相当于给了信息一条"直通车"——原始输入可以直接跳到第100层,和中间层的输出相加。这样网络需要学习的就不是"从头构造输出",而只是"在原始输入的基础上做微调"——这个任务要简单得多。

听起来简单得难以置信——就是加一条"旁路"而已。但效果是革命性的。ResNet做到了152层,在ImageNet上的Top-5错误率降到了3.57%,第一次低于人类专家水平(约5%)。

这意味着,在"识别图片里是什么东西"这件事上,机器已经比人类更准了。整个过程——从AlexNet的15.3%到ResNet的3.57%——只用了三年。

何恺明后来加入Meta(Facebook)AI研究院,成为当今计算机视觉领域最有影响力的研究者之一。他参与的后续工作——Mask R-CNN[13]、ResNeXt、Feature Pyramid Network——直接塑造了目标检测和实例分割的技术版图。

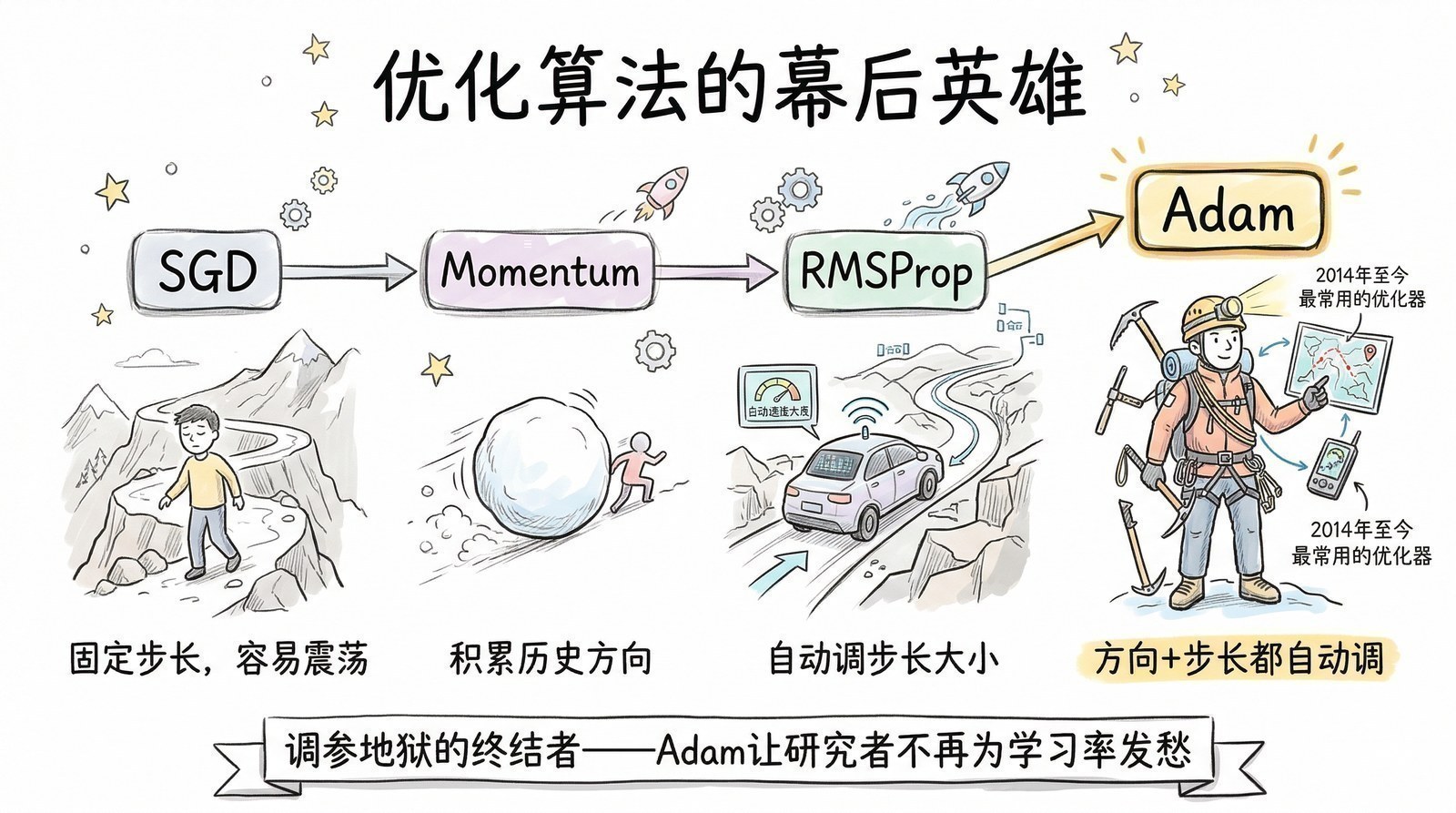

优化算法:深度学习的幕后英雄

模型架构的进步是台前的明星,但幕后还有一群同样重要的角色——优化算法。没有好的优化算法,再精妙的网络也训练不起来。

Adam优化器(2014)[4]

2014年,Diederik Kingma和Jimmy Ba提出了Adam(Adaptive Moment Estimation)优化器。在Adam之前,训练神经网络是一件非常需要"手感"的事——学习率设大了,训练会发散;设小了,收敛慢得令人绝望。Adam的核心想法是让学习率自适应调整:对于梯度大的参数,学习率自动缩小;对于梯度小的参数,学习率自动放大。

这听起来是个技术细节,但它的影响是深远的。Adam让神经网络的训练变得更稳定、更不容易失败,大幅降低了"调参"的门槛。至今,它仍然是最广泛使用的优化器之一——几乎所有你今天用的AI模型,从ChatGPT到Stable Diffusion,训练时大概率用的就是Adam或它的变体。

泛化之谜(2016)[25]

2016年,Chiyuan Zhang等人发表了一篇引发广泛讨论的论文《Understanding Deep Learning Requires Rethinking Generalization》[25]。他们做了一个惊人的实验:把ImageNet的标签完全随机打乱(猫的图片标记为"飞机",狗的图片标记为"火山"),然后用深度网络去训练。结果网络居然能完美地"记住"所有的错误标签——训练准确率达到100%。

这说明深度网络的记忆能力远超我们的想象,它强大到可以死记硬背一百万张完全没有规律的图片。那问题来了:既然网络有能力记住所有训练数据,为什么它在真实测试中还能表现得那么好? 它是真的"学会"了识别物体,还是只是在"背答案"?

这个问题至今没有完全解答,但它揭示了深度学习最深层的奥秘之一——这些网络的工作方式,可能比我们以为的更加复杂和微妙。

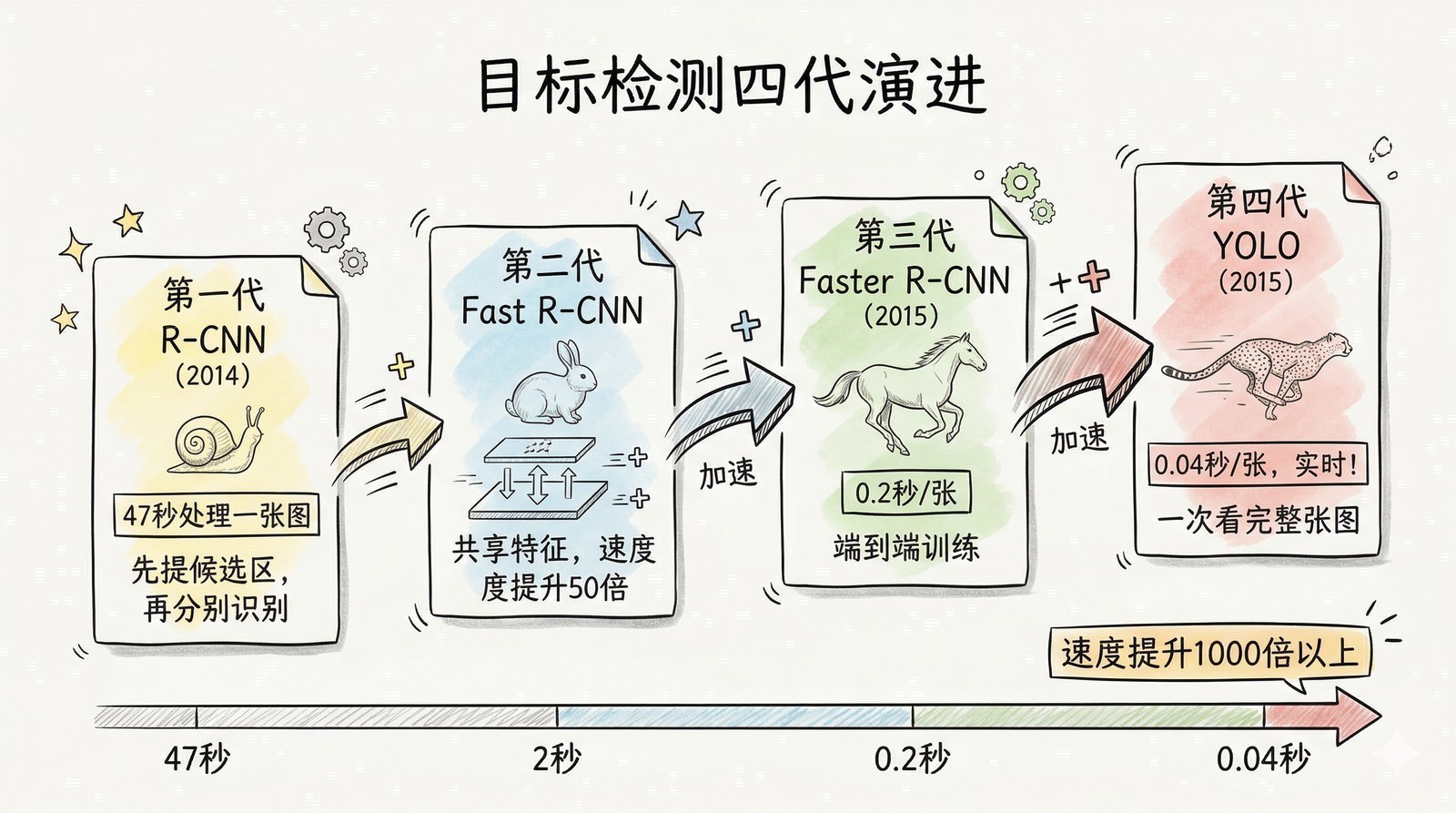

不只是认出来,还要找到它:目标检测的进化

识别一张只有"一只猫"的图片是一回事。但真实世界的图片里往往有很多物体——一条街上有行人、汽车、交通灯、商店招牌、路面标线。AI不仅需要知道"图里有什么",还需要知道"它们分别在哪里",并且用方框精确地标出每个物体的位置。这就是目标检测要解决的问题。

目标检测的进化是一条特别清晰的技术迭代链。它直接支撑了2015-2020年以国内"AI四小龙"为代表的整个计算机视觉产业链——人脸识别、车牌识别、安防监控、自动驾驶感知,底层都是目标检测技术。可以说,这条技术链是深度学习时代AI商业化的第一条"主干道"。

2014年:R-CNN——第一次用深度学习做检测[6]

UC Berkeley的Ross Girshick提出R-CNN(Regions with Convolutional Neural Networks),思路分三步:首先用一个传统算法(Selective Search)在图片上"猜"出大约2000个可能包含物体的候选区域;然后把每个区域逐一送进CNN提取特征;最后用SVM分类器判断每个区域是什么物体。

R-CNN的效果相比传统方法有巨大提升,在PASCAL VOC数据集上的检测精度从33%跳到了58%。但它有一个致命的问题:太慢了。每张图片要生成2000个候选区域,每个区域都要独立跑一次CNN——处理一张图片需要47秒。在学术论文里可以接受,但在任何实际应用场景中完全不可用——你总不能让安防摄像头每47秒才能分析一帧画面。

2015年:Fast R-CNN——共享计算,快了百倍[7]

仅仅一年后,Girshick自己改进了R-CNN。他发现R-CNN最大的浪费在于:2000个候选区域,每个都要独立跑一次CNN,但其实大部分计算是重复的——因为这些区域都来自同一张图片。Fast R-CNN[7]的改进很简单但非常有效:先对整张图片跑一次CNN提取特征图,然后从特征图上"裁剪"出每个候选区域对应的部分。这样2000次CNN前向传播变成了1次,速度提升了几十倍。

2015年:Faster R-CNN——端到端,速度再翻倍[8]

Fast R-CNN还有一个瓶颈:候选区域的生成仍然依赖传统的Selective Search算法,这一步本身就很慢。任少卿、何恺明、Ross Girshick和孙剑提出Faster R-CNN[8],核心创新是用一个小型神经网络(Region Proposal Network, RPN)来替代传统候选区域生成算法——让网络自己学习"哪里可能有物体"。

RPN和检测网络共享同一个CNN的特征,整个系统实现了真正的端到端训练——从原始图片输入到检测结果输出,中间没有任何非神经网络的步骤。处理速度达到了每秒5帧(每张图约0.2秒),精度也更高。

Faster R-CNN成为目标检测领域的"标准答案",在之后两三年里统治了各大检测基准测试。直到今天,它的"区域提议+分类"两阶段框架仍然是很多检测系统的基础。

2016年:YOLO——"你只需要看一次"[9]

就在Faster R-CNN成为学术界的宠儿时,Joseph Redmon——一个充满个性的华盛顿大学研究者——提出了一个截然不同且更加激进的想法:能不能跳过"找候选区域"这一步,一步搞定?

YOLO(You Only Look Once)[9]把整张图片分成一个S×S的网格(比如7×7=49个格子),每个格子直接预测"这里是否有物体、物体是什么、物体的精确边框在哪"。整个检测过程就是一次神经网络的前向传播——看一次就够了,所以叫"You Only Look Once"。

YOLO的速度达到了每秒45帧——是Faster R-CNN的9倍,是最初R-CNN的千倍以上。虽然精度略低于Faster R-CNN(尤其是在检测小物体时),但它是第一个达到实时性能的深度学习检测器。这意味着,目标检测终于可以用在视频流上了——安防监控、自动驾驶、无人机避障,所有需要"实时看"的场景,都因为YOLO的出现而成为可能。

同年,Wei Liu等人提出SSD(Single Shot MultiBox Detector)[10],用另一种方式实现了单阶段检测。SSD在图片的不同尺度上同时检测物体,在精度和速度之间取得了更好的平衡。

2017-2019年:YOLO家族的持续进化

Joseph Redmon没有停下来。YOLOv2[11](2017年)引入了批归一化、锚框机制和多尺度训练,在保持速度优势的同时大幅提升了精度。YOLOv3[12](2018年)采用了多尺度预测——在三个不同分辨率的特征图上同时检测,让小物体的检测精度有了明显提升。

与此同时,何恺明团队的Mask R-CNN[13](2017年)在Faster R-CNN基础上增加了一个分支,实现了像素级别的实例分割——不仅找到物体在哪里,还能精确画出它的轮廓。这项技术后来被广泛用于自动驾驶中的场景理解和医学影像中的病灶标注。

CenterNet[14](2019年)则提出了更优雅的无锚框方法——把物体检测简化为"找物体中心点",去掉了锚框这个需要人工调参的组件,让检测器的设计更加简洁。

2020年:DETR——Transformer入侵视觉[15]

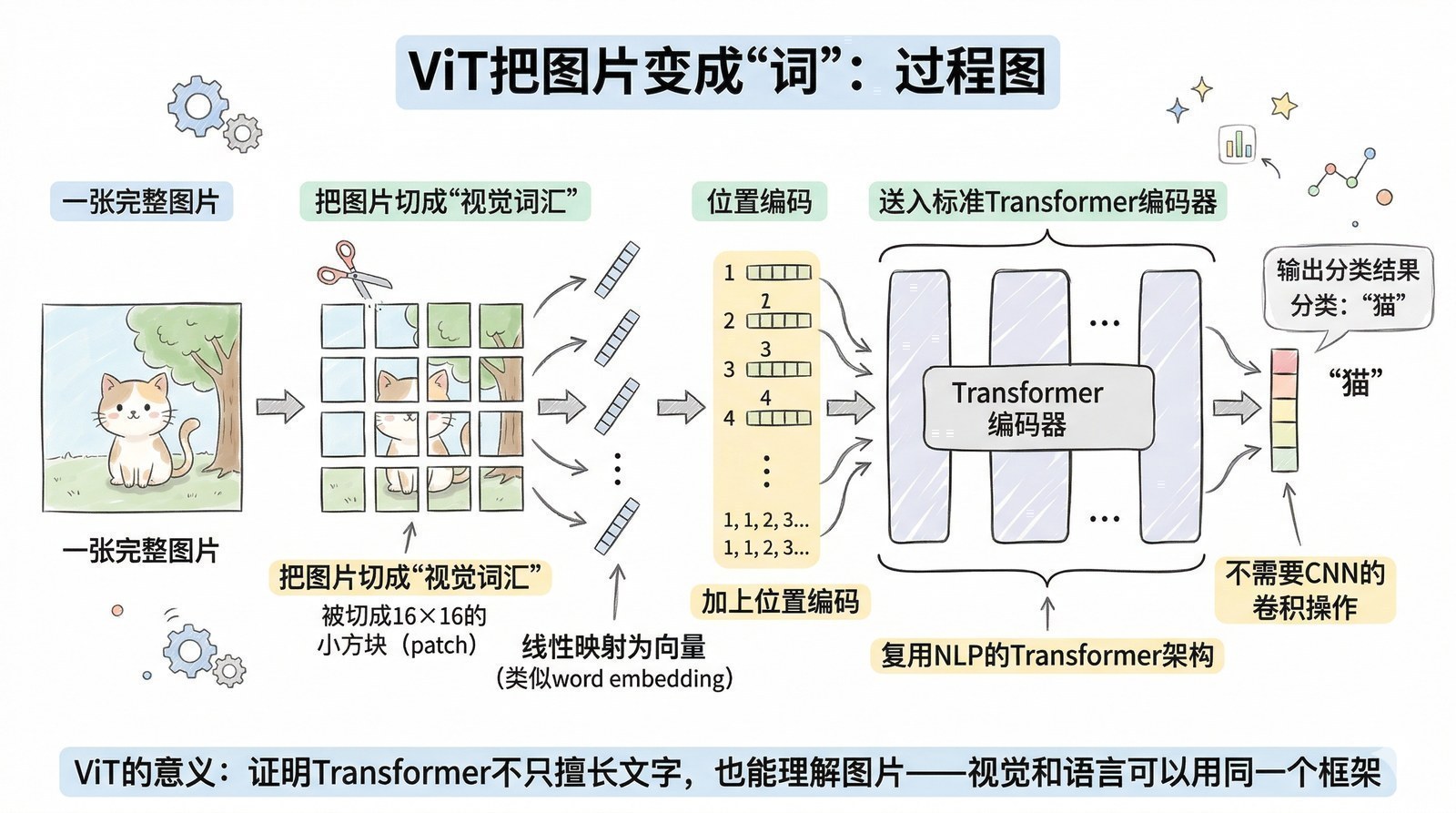

2020年,Meta AI的Nicolas Carion等人做了一件让很多人意想不到的事:用Transformer(本书第四章的主角)来做目标检测。DETR[15]去掉了所有手工设计的组件——锚框、非极大值抑制(NMS)后处理——用一个纯粹的编码器-解码器结构,端到端地预测物体。

DETR在大物体检测上效果出色,但在小物体上还有不足。更重要的是,它标志着一个深远的趋势:Transformer正在从NLP领域入侵计算机视觉。这条线将在后续章节中不断延伸——先是ViT用Transformer做图像分类(第六章),然后是CLIP用Transformer打通视觉和语言(第八章),最终走向今天的多模态大模型。

这条进化链的产业意义

R-CNN → Faster R-CNN → YOLO → Mask R-CNN → DETR,这条目标检测的技术进化链不是学术游戏。它直接支撑了2015-2020年以深度学习为核心的第一波AI商业化浪潮:

- 安防监控:实时检测行人、车辆、异常行为。海康威视、大华股份等公司将YOLO类算法嵌入摄像头芯片,让"智能监控"成为城市基础设施

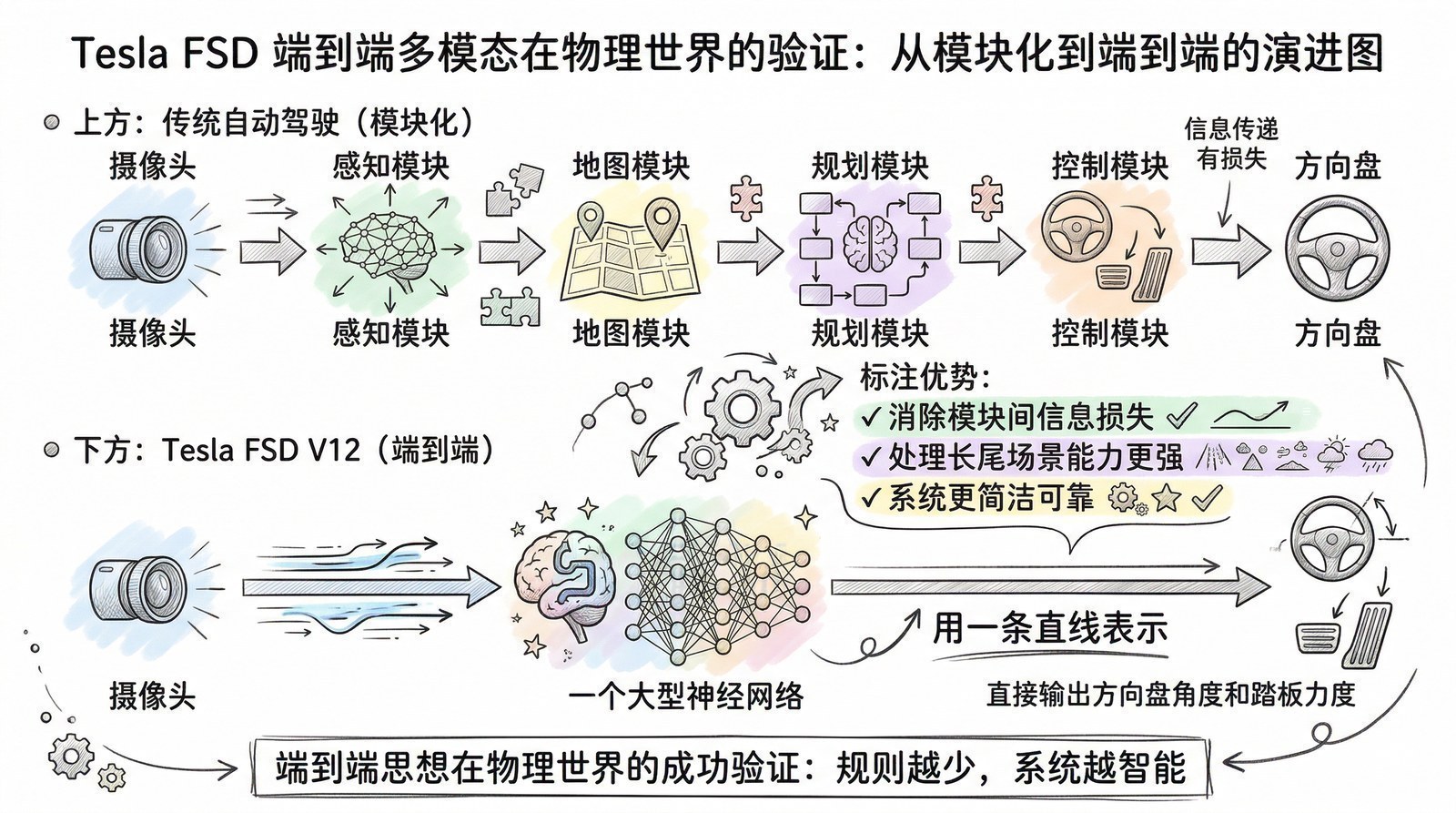

- 自动驾驶:车辆需要以毫秒级速度识别行人、车辆、交通标志和车道线。Tesla的纯视觉方案本质上就是YOLO思路的延伸

- 人脸识别:从手机解锁到支付验证到安检通关,底层都是"先检测人脸位置,再识别是谁"的两步流程

- 零售自动化:Amazon Go无人商店用摄像头+目标检测跟踪每个顾客拿了什么商品

- 工业质检:在流水线上用视觉检测产品缺陷——划痕、裂纹、错位——替代人工目检

可以说,2015-2020年整个"深度学习+计算机视觉"的产业链——国内的AI四小龙(商汤、旷视、云从、依图)、安防巨头(海康威视、大华)、自动驾驶公司(百度Apollo、小鹏、蔚来)——它们的核心技术根基,都建立在这条目标检测进化链之上。

而从2020年开始,随着GPT-3和ChatGPT的出现,AI产业的主轴逐渐从"以计算机视觉为核心"转向了"以大语言模型为核心"。但视觉并没有被淘汰——它通过CLIP、GPT-4V等多模态技术,融入了大模型体系,成为了更大故事的一部分。这条融合之路,我们将在第八章(打通视觉与语言)中详细讲述。

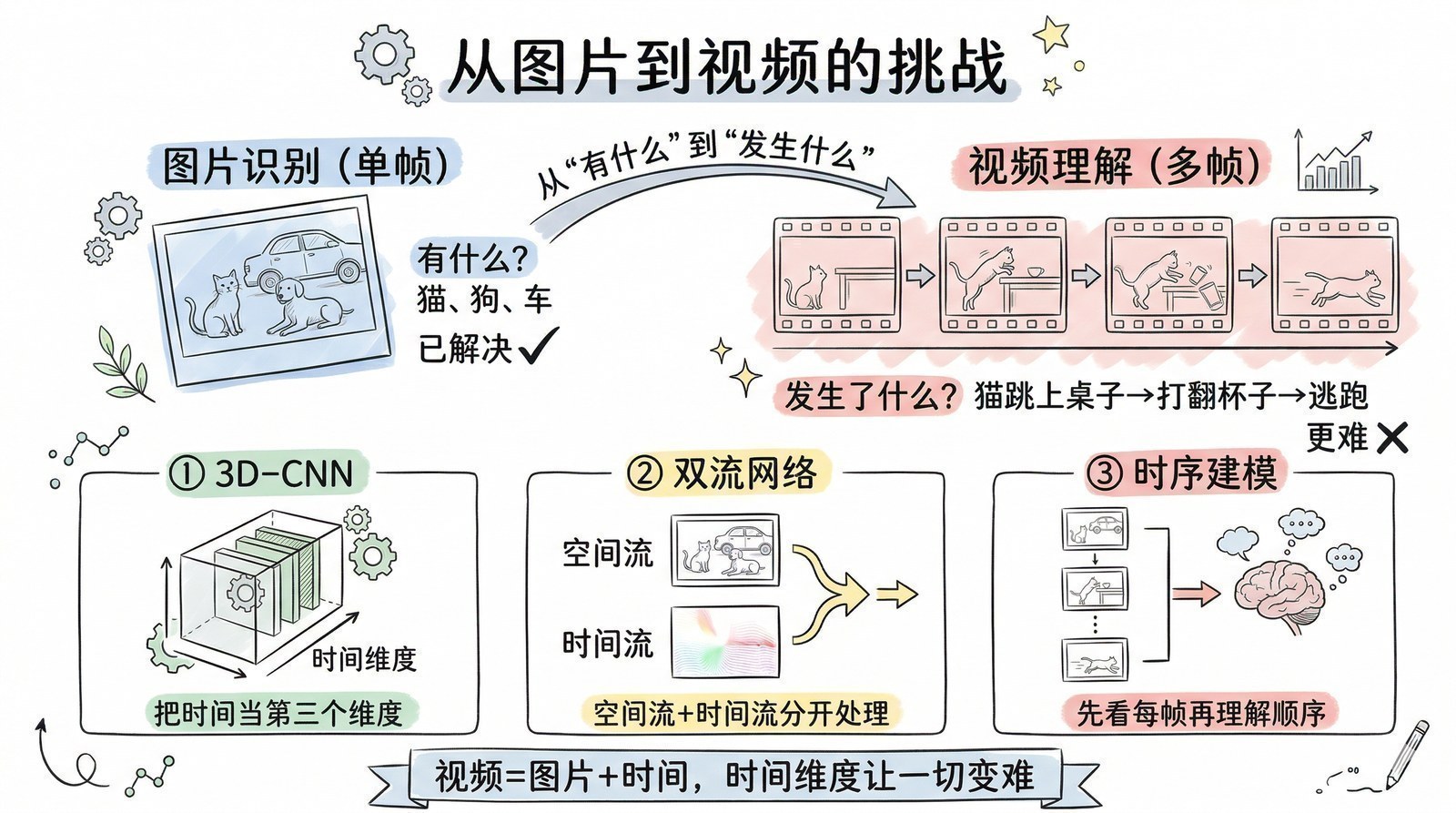

让AI理解运动:视频理解的挑战

图片是静止的一帧。但真实世界是动态的——人在走路、球在飞、车在拐弯。理解视频比理解图片难得多,因为你不仅要理解每一帧"有什么",还要理解帧与帧之间"发生了什么"。一个人举起手臂——他是在打招呼、投篮还是要打人?单看一帧你可能分辨不出来,必须看前后几帧的动作序列才能判断。

这就是视频理解要解决的问题。它的技术迭代路径清晰地展示了研究者如何一步步攻克"时间维度"这个难题。

2014年:双流网络——分开看"样子"和"动作"[16]

Karen Simonyan和Andrew Zisserman(牛津大学,VGGNet的作者)提出了一个巧妙的架构:Two-Stream Network[16]。核心洞见来自神经科学——人类视觉系统有两条独立的通路:腹侧通路处理"这是什么"(物体形状、颜色),背侧通路处理"它怎么动的"(运动方向、速度)。

双流网络模拟了这个结构:一个"空间流"CNN处理单帧RGB图像(看画面长什么样),一个"时间流"CNN处理光流图(看东西怎么动的),最后把两个流的结果融合。光流是一种描述像素运动方向和速度的表示方法——如果一个人向右走,他所在的像素点都会有一个向右的光流向量。

同期还有其他尝试:C3D[17]用3D卷积核直接在时间和空间维度上同时提取特征,相当于把2D的图像卷积"膨胀"到3D的视频卷积;DeepVideo[18]则由Stanford和Google合作探索了如何将CNN应用于大规模视频分类(Sports-1M数据集,100万个视频)。

2016年:TSN——把长视频"切片"采样[19]

视频可能有几分钟长,但受限于GPU显存,模型一次只能处理几秒钟。如何让模型"看到"整个视频?TSN(Temporal Segment Networks)[19]的解决方案简单而有效:把视频均匀切成若干段,从每段中随机抽一帧来处理,然后把所有段的结果汇总(取平均或投票)。

这个方法的哲学是:一段视频的关键信息分布在整个时间线上,不需要逐帧分析,只需要在每个时间段上"采一个样"就够了。TSN成为视频理解领域的标准基线方法,后续很多工作都在它的框架上改进。

2017年:I3D和R(2+1)D——Inflate和分解[20][21]

来自DeepMind的Joao Carreira和Andrew Zisserman提出I3D(Inflated 3D ConvNet)[20],做了一件巧妙的事:把已经在ImageNet上预训练好的2D卷积核"膨胀"成3D卷积核——相当于给一个学会了看图片的模型,加上一个时间维度,让它带着已有的图像知识去理解视频。同时他们发布了Kinetics数据集(包含40万个视频片段,涵盖400种人类动作),成为视频理解的"ImageNet"。

同年,Meta的Du Tran等人提出R(2+1)D[21],发现把3D卷积分解为2D空间卷积+1D时间卷积,效果反而更好——因为这种分解让网络先学空间特征再学时间特征,优化更容易,而且参数量更少。

2018年:SlowFast——快慢双通道[22]

Meta的何恺明团队提出SlowFast Network[22],灵感同样来自人类视觉系统——视网膜上有两种细胞:约80%的细胞(P细胞)响应缓慢但对空间细节敏感,约20%的细胞(M细胞)响应快速但只关注运动。

SlowFast用两个分支模拟这两种通路:一个"慢路径"以低帧率(如每秒2帧)处理高分辨率的空间信息;一个"快路径"以高帧率(如每秒16帧)处理低分辨率的运动信息。快路径的计算量很小(因为通道数少),但能捕获关键的运动模式。两条路径的特征在多个层级上融合,在视频动作识别上取得了当时最佳效果。

2021年:TimeSformer——Transformer统一视频理解[23]

和DETR对目标检测做的事一样,Meta AI的Gedas Bertasius等人将Transformer引入了视频理解。TimeSformer[23]把视频拆成一系列时空patch(比如把每一帧切成16×16的小块,再沿时间串起来),然后用自注意力机制让每个patch能"看到"视频中任意位置、任意时间点的其他patch。

这种"全局注意力"意味着模型不再受限于局部卷积的"视野"——它可以直接关联视频开头和结尾的信息。TimeSformer再次证明了Transformer架构的通用性:处理文字能行,处理图片能行,处理视频也能行。

视频理解的产业落地

视频理解技术已经渗透到了很多你可能没有意识到的场景中:

- 短视频推荐:抖音/TikTok需要"理解"每个视频的内容(是美食、舞蹈还是搞笑),才能做精准推荐。视频理解模型帮助平台从每天上传的千万条视频中自动打标签、分类和过滤违规内容

- 体育赛事分析:自动识别进球、犯规、精彩回放。NBA和英超联赛已经在使用AI自动剪辑集锦、追踪球员跑位数据

- 安防视频分析:从数千小时的监控视频中自动找出异常行为(翻越围栏、逆行、聚集),不再需要人盯着屏幕看。海康威视的"深眸"系列摄像头内置了视频分析AI

- 工业质检:在流水线视频中实时检测产品缺陷。华为的机器视觉解决方案"好望"(HoloSens)被应用于多条制造业产线

- 医学影像分析:分析超声视频中的心脏运动、内窥镜视频中的息肉检测,辅助医生诊断

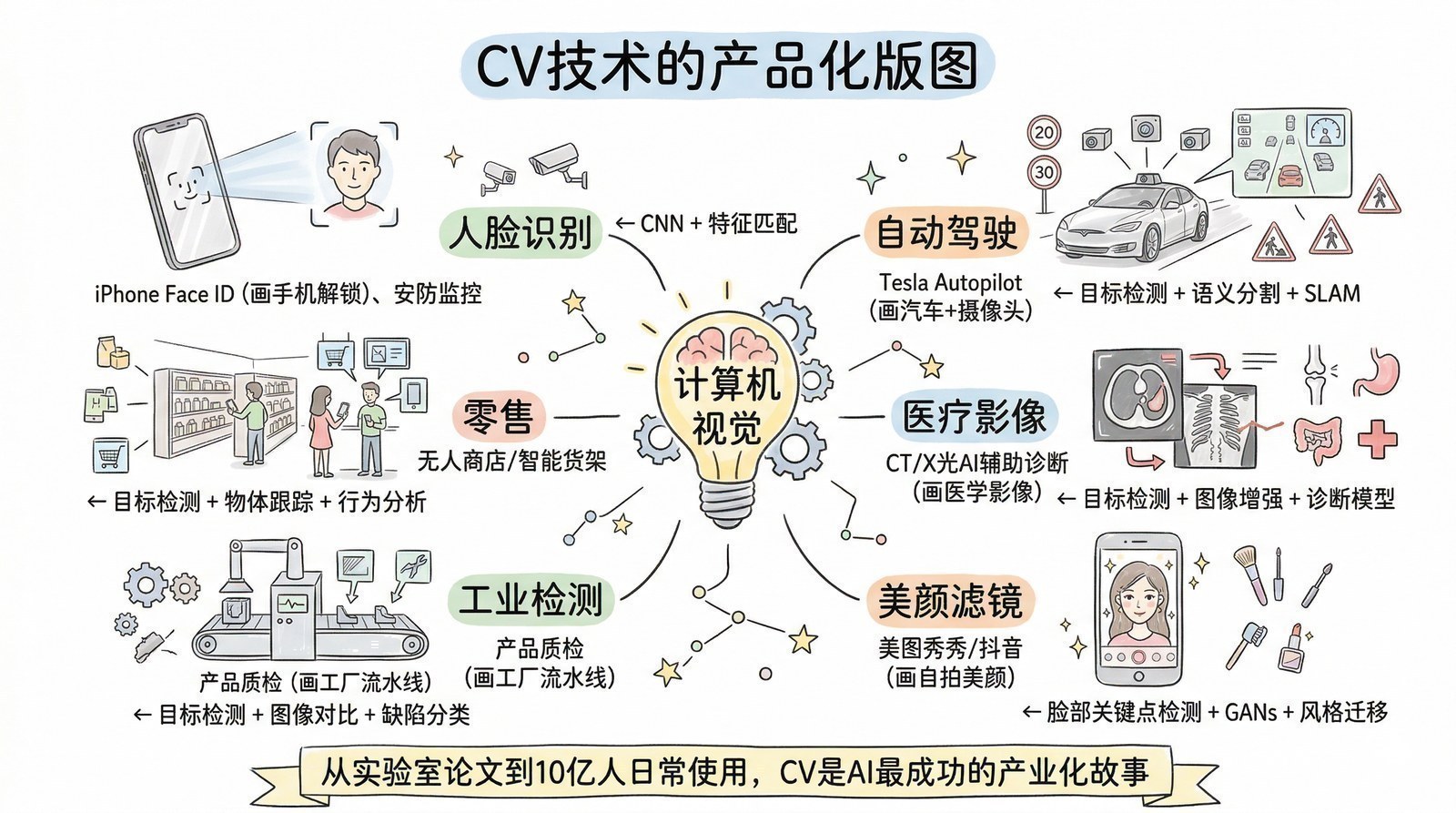

产品与公司聚光灯:AI技术大开大合,AI产品润物细无声

计算机视觉的十年进化催生了一批改变世界的产品。有意思的是,AI技术本身的发展是大开大合的——每年一篇重磅论文、每次竞赛刷新记录、媒体争相报道。但AI产品对日常生活的渗透,却是悄然无息的。

回想一下:你是从什么时候开始用人脸解锁手机的?什么时候开始刷脸过地铁闸机的?什么时候开始习惯手机自动把照片分类到"人物""风景""美食"?你可能根本记不住具体的日期——因为这些功能就是在某一天默默上线,然后你就习惯了。

这大概就是最成功的AI产品的特征:润物细无声。用户甚至意识不到自己在使用AI。

以下是计算机视觉时代最具代表性的产品和应用——你大概率每天都在使用其中的好几个:

| # | 产品/应用 | 公司 | 核心CV技术 | 故事 |

|---|---|---|---|---|

| 1 | ImageNet竞赛 | 斯坦福 | 图像分类基准 | 李飞飞花两年众包标注1400万张图片。竞赛从2010年11支队伍发展到2017年38支,错误率从28%降到不足5%。2017年后停办——AI已经超过了人类,比赛没有意义了 |

| 2 | Google Photos | CNN图像分类+人脸聚类 | 2015年上线,用深度学习自动对照片分类和搜索。你输入"沙滩"就能找到所有海边照片,输入"狗"就能找到所有狗的照片——不需要手动打标签。这是普通人第一次在日常生活中无感使用深度学习 | |

| 3 | Face ID | Apple | 3D人脸检测+识别 | 2017年随iPhone X发布。用结构光投射3万个红外点建立人脸3D模型,配合深度学习做活体检测和身份识别。这是深度学习进入十亿级消费设备的里程碑——从此每个人口袋里都有一个深度学习模型在运行 |

| 4 | Tesla Autopilot | Tesla | YOLO类实时目标检测+车道线识别 | 2016年起持续迭代。Tesla坚持纯摄像头方案(不依赖激光雷达),用8个摄像头+视觉神经网络构建360度感知。争议极大——出过致命事故,监管多次调查——但它推动了整个自动驾驶行业从"实验室"走向"量产" |

| 5 | 美图秀秀/抖音特效 | 美图/字节 | 人脸关键点检测+图像分割+风格迁移 | 美图秀秀的"一键美颜"基于人脸关键点检测(68-106个点精确定位五官位置),然后对肤色、轮廓、眼睛大小做像素级调整。抖音的AR特效(猫耳朵、变脸、背景替换)同样依赖实时人脸检测和图像分割。这类应用让数亿用户在不知不觉中成为了深度学习的日常使用者 |

| 6 | 手机AI拍照 | 华为/小米/苹果 | 场景识别+语义分割+超分辨率 | 你对着菜拍照手机自动切到"美食模式",对着人拍自动切到"人像模式"背景虚化——这是CNN在做场景分类。夜景模式的"计算摄影"用多帧融合+神经网络降噪。华为P30 Pro的"月亮模式"曾引发争议,但本质上就是AI超分辨率 |

| 7 | Amazon Go无人商店 | Amazon | 多摄像头目标检测+跟踪+行为识别 | 2018年在西雅图开业。数百个摄像头+深度学习追踪每个顾客拿了什么商品、放回了什么,出门时自动从账户扣款。虽然后来规模缩减(成本太高),但它验证了"视觉AI替代收银员"的技术可行性 |

| 8 | 海康威视智能摄像头 | 海康威视 | 嵌入式目标检测+行为分析 | 全球最大的视频监控设备商。将YOLO类检测算法压缩后嵌入摄像头端侧芯片,实现"前端智能"——摄像头本身就能做人脸识别、车牌识别、行为异常检测,不需要把所有视频传回后台。2023年营收超890亿元人民币 |

| 9 | 医学影像AI(肺结节检测) | 多家公司 | 3D CNN+目标检测 | 用CT扫描的3D图像训练CNN检测肺结节。AI可以在几百张CT切片中找到直径仅几毫米的可疑结节,辅助放射科医生诊断。FDA已经批准了多款AI辅助诊断软件。在中国,推想科技、依图医疗等公司的产品已进入数百家医院 |

| 10 | 刷脸支付/刷脸通行 | 支付宝/微信 | 人脸检测+活体检测+1:N识别 | 支付宝2015年率先推出刷脸支付(旷视科技提供技术),到2020年全国刷脸支付终端超过千万台。地铁闸机刷脸通行、机场自助通关、酒店刷脸入住——所有这些场景的底层都是"人脸检测+识别"这条计算机视觉技术链 |

你可能注意到了一个有趣的现象:上面这10个产品和应用,大部分都没有在发布时引发什么"震动"。没有人因为Google Photos能搜索"沙滩"就觉得世界要被颠覆了。iPhone X的Face ID发布时人们关注的是刘海屏好不好看,而不是里面的深度学习模型有多先进。美图秀秀的用户只关心自拍变好看了多少,不会去想背后是68个人脸关键点在做像素级别的变换。

这和大模型时代的产品形成了鲜明对比——ChatGPT两月破亿用户,Sora的演示视频让全网炸锅——大模型时代的AI产品是"大开大合"式的出场。

但计算机视觉时代的AI产品,走的是润物细无声的路线。它们在某一天默默地上线了一个新功能,然后你就习惯了。等到你习惯之后,你甚至忘了以前没有这个功能的日子是什么样的。

这种"无感渗透"可能才是AI对社会最深远的影响方式。

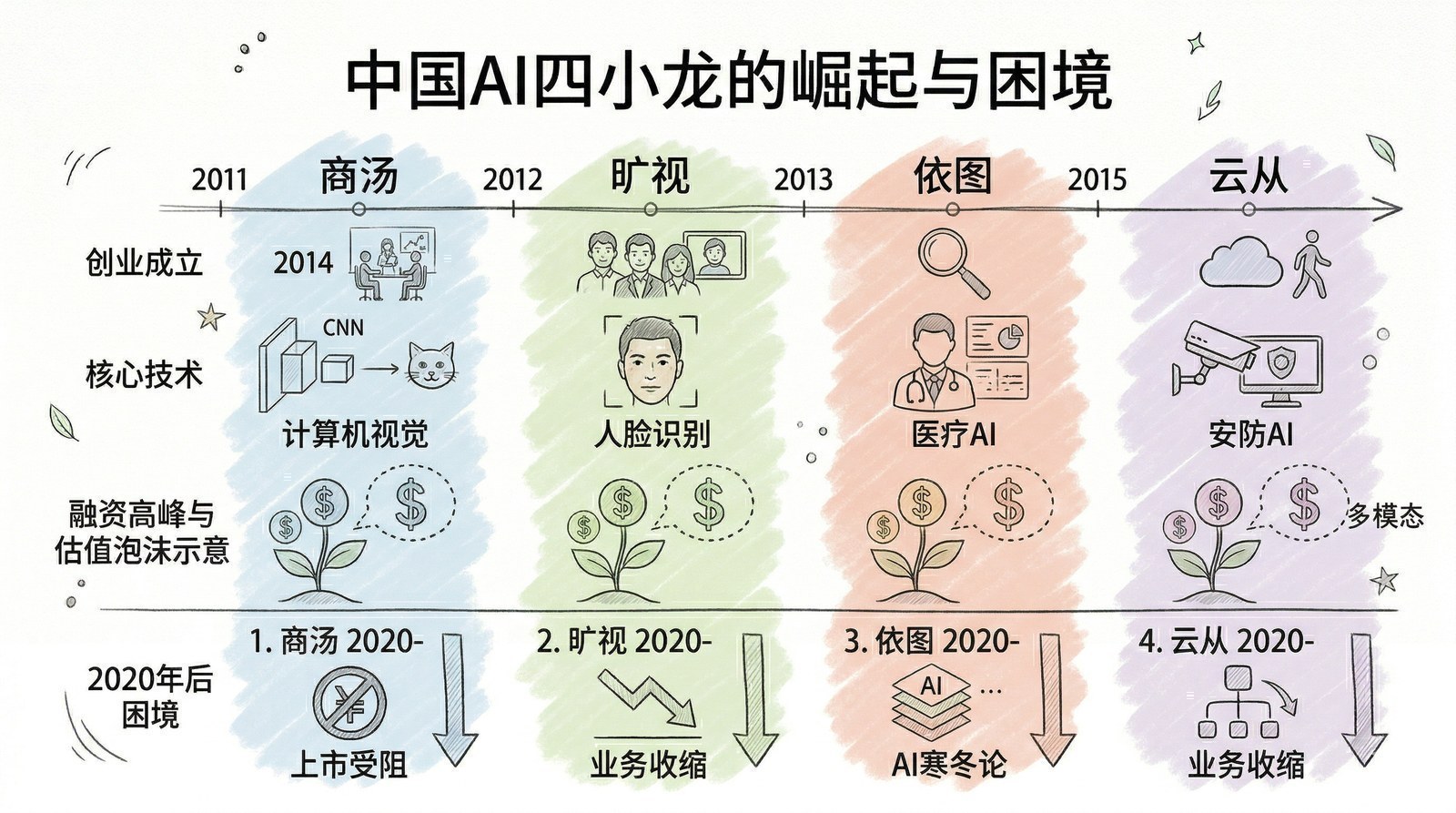

中国"AI四小龙":一场辉煌与教训并存的资本故事

如果说AlexNet点燃了全球学术界对深度学习的热情,那么2016年AlphaGo战胜李世石则点燃了中国资本市场对AI的狂热。一夜之间,"人工智能"成了创投圈最性感的标签,而计算机视觉——因为商业落地路径最清晰(人脸识别、安防、自动驾驶)——成了资本追逐的主赛道。

在这个赛道上,四家公司脱颖而出,被业界并称为"AI四小龙":

| 公司 | 成立时间 | 创始团队 | 技术起点 | 最高估值 |

|---|---|---|---|---|

| 旷视科技 | 2011 | 三位清华学生(印奇等) | 人脸识别 | ~50亿美元 |

| 依图科技 | 2012 | MIT背景(朱珑、林晨曦) | 医疗影像+安防 | ~40亿美元 |

| 商汤科技 | 2014 | 香港中文大学汤晓鸥团队 | 计算机视觉全栈 | ~100亿美元 |

| 云从科技 | 2015 | 中科院背景 | 金融+安防 | ~42亿美元 |

崛起期(2014-2018):技术变现金

旷视科技是最早嗅到商机的。2014年,支付宝寻找"刷脸支付"的技术提供商,旷视拿下了这个标杆项目——这是人脸识别技术第一次大规模商用。此后四小龙各显神通:商汤帮中国移动完成3亿人手机实名认证,云从成为银行领域第一大AI供应商,依图凭借"蜻蜓眼系统"帮助公安部门做人像识别。

2016年AlphaGo之后,资本彻底疯狂了。2017年10月,旷视完成C轮4.6亿美元融资,刷新了当时全球人工智能单笔融资最高纪录。商汤科技在2017-2018年连续完成多轮融资,估值飙升至60亿美元以上,投资方阵容堪称豪华——软银、银湖、IDG、阿里巴巴等明星机构云集。到2020年,四家公司在一级市场融资接近500亿元人民币,总估值超过1400亿元。IDC数据显示,2020年这四家加上海康威视,合计占据了中国计算机视觉市场近50%的份额。

困境期(2019-2022):高融资、高研发、高亏损

但资本狂欢掩盖了一个根本问题:技术门槛在快速降低,而商业化落地远比想象中困难。

人脸识别的算法门槛其实并不高。当阿里、百度、腾讯等大厂自行开发出类似的技术后,四小龙最引以为豪的技术壁垒开始瓦解。蚂蚁金服在2020年就透露,公司刷脸系统早已不再与旷视合作,改为自主研发。

四小龙的营收主要来自政府和大企业客户(ToG/ToB),但这类项目周期长、回款慢、定制化程度高,做完一个项目几乎没有可复用的组件。与此同时,研发费用居高不下——商汤科技2022年的研发费用率高达105%,研发投入超过了营业收入。

数字触目惊心:2018-2024年,商汤科技累计亏损超过546亿元。四小龙三年合计亏损超过500亿元。

上市坎坷(2021-2022)

四小龙的上市之路堪称一波三折。旷视科技最早行动,2019年递交港股招股书,却遭遇美国"实体清单"制裁,被迫转战科创板,到2021年通过审核后又长期卡在注册环节。依图科技两次IPO中止后主动撤材料。商汤科技2021年底匆忙登陆港股,上市四天市值冲破2720亿港元,随后一路下跌,六个月后一天内市值蒸发超900亿。云从科技2022年5月登陆科创板,上市后一个月即进入下行通道。

转型期(2023-2025):押注大模型

ChatGPT的出现给了四小龙一线希望。商汤科技押注生成式AI,2024年生成式AI业务收入达24亿元,占总营收的64%。依图科技创始人林晨曦透露公司已经盈利,现金流为正。旷视转向纯视觉自动驾驶方案。云从科技发布"从容大模型"进军行业AI。

但新赛道上,它们面对的对手已经换了一批——不再是彼此,而是DeepSeek、智谱AI、月之暗面这些"AI新六虎",以及阿里Qwen、字节豆包等大厂的碾压。

昔日的"计算机视觉四小龙"正试图蜕变为"大模型玩家"。这场转型能否成功,将在第十四章(群星闪耀)中再次提及。但无论最终命运如何,它们在中国AI产业史上的地位不可磨灭——它们证明了中国团队可以在全球AI技术竞争中站到第一梯队,也用自己的血泪经验为后来者留下了最昂贵的一课。

这十年告诉我们什么

从2012年的AlexNet到2020年的DETR,计算机视觉的进化展现了几个在整个大模型时代反复出现的规律。

技术规律

规律一:数据、算力、算法必须同时就位——而且规模比巧妙更重要。

AlexNet的成功不是某一个突破的功劳,是ImageNet(数据)+ GPU(算力)+ 更深的CNN(算法)三者同时成熟的结果。这个"三位一体"的模式在此后每一次大跃迁中都会反复出现。而正如Richard Sutton在《The Bitter Lesson》[24]中总结的:每一次,简单的方法配合大规模计算,都会战胜精巧但规模有限的方法。 AlexNet用粗糙的CNN打败了精心设计的手工特征,八年后GPT-3用"暴力堆参数"打败了精心设计的小模型,历史不断重演。

规律二:简单粗暴往往打败精巧设计。

YOLO[9]的设计思路比R-CNN[6]"粗糙"得多——一步到位而不是精确分两步——但因为够快,反而在实际应用中胜出。ResNet[3]的快捷连接简单到让人怀疑"这也能发论文?",但效果是革命性的。这种"简单即力量"的哲学,后来在Transformer(去掉了所有循环和卷积,只留注意力)、GPT(只做"预测下一个词"这一件事)中一再被验证。

规律三:架构统一的力量。

从R-CNN到YOLO到DETR[15],从CNN到Transformer入侵视觉(DETR、TimeSformer[23]),我们看到一个反复出现的趋势:最终胜出的不是"为某个任务专门设计的最优架构",而是"足够通用、可以无限扩展的统一架构"。 专用架构在自己的领域里可能更精确,但通用架构因为可以吃到更多数据和更大算力的红利,最终会追平甚至超越。这个趋势在第四章(Transformer的诞生)中会被推到极致——一个架构统一了NLP、CV、语音乃至所有AI领域。

产品规律

规律四:AI产品最成功的渗透方式是润物细无声。

回顾这十年最成功的CV产品——Google Photos、Face ID、美图秀秀、手机AI拍照——它们有一个共同特征:用户根本不知道自己在用AI。没有人因为Face ID而觉得自己在使用"人工智能技术",它就是"用脸解锁手机"而已。最好的AI产品,是让技术完全消失在体验中。

这和今天大模型产品的思路形成了对比——ChatGPT是以"AI"为卖点的,用户清楚地知道自己在和AI对话。但计算机视觉时代的教训是:长期来看,AI的最大价值可能不在于创造新的"AI产品"类别,而在于让所有现有产品都变得更智能。 手机变得更会拍照了,相册变得更会搜索了,监控变得更会识别了——这些提升无声无息,但累积起来改变了整个世界。

规律五:技术最强的公司未必赢——海康威视的启示。

在AI四小龙的光环下,很少有人注意到一个事实:过去十年计算机视觉领域最赚钱的中国公司,不是商汤、旷视中的任何一家,而是海康威视——一家成立于2001年的"传统"安防公司。2023年海康威视营收超过890亿元人民币,利润超过140亿元,而四小龙的营收加起来还不到它的十分之一。

海康威视做对了什么?它没有最先进的算法(它的AI算法团队远小于四小龙),但它有遍布全球的销售渠道、成熟的硬件制造能力和二十年积累的客户关系。当深度学习检测算法成熟后,海康威视将其集成进自己的摄像头产品线——这个过程花了不到两年。对它来说,AI只是给已有产品加了一个新功能,而不是需要从零建立商业模式的全新业务。

这个故事的教训很清楚:在AI行业,技术是入场券,但不是终点线。 渠道、场景理解、硬件能力、客户关系——这些"非技术"壁垒,往往比算法本身更难被复制。

产业规律

规律六:技术领先≠商业成功——AI四小龙的三条教训。

四小龙的故事是中国AI产业最好的教科书。它揭示了三个在今天的大模型时代依然高度相关的产业规律:

其一,算法的门槛在快速降低,但场景的门槛在快速升高。 四小龙在2016年拥有世界一流的人脸识别技术,但仅仅两三年后,阿里、百度、腾讯就自研了同等水平的方案。技术壁垒消失的速度远超所有人预期。今天的大模型创业面临完全相同的处境——当Llama、Qwen、DeepSeek等开源模型把基座能力拉平后,纯技术优势几乎不可能维持。真正的壁垒在于对行业场景的深度理解、数据的独特性和客户关系的粘性。

其二,ToG/ToB定制化是一条看起来安全但极其危险的路。 四小龙超过70%的营收来自政府和大企业客户。这类项目单笔金额大,但周期长、回款慢、高度定制化,做完一个项目几乎没有可复用的组件。更要命的是,当政府预算收紧时,营收会断崖式下跌——云从科技2024年营收同比下降了37%。今天做AI落地的团队,如果业务模式是"接项目做定制",四小龙的经历就是前车之鉴。

其三,融资和估值不是护城河,造血能力才是。 四小龙在一级市场融资近500亿元,总估值一度超过1400亿元。但七年过去,没有一家实现稳定盈利,商汤累计亏损超过546亿元。资本可以催大一家公司的估值,但不能替代产品的市场竞争力。这个教训在今天的大模型投资热潮中尤其刺耳——当下的"AI新六虎"们,是否也在重复同样的剧本?

回头看,2012到2020这八年,AI完成了一件了不起的事:让计算机学会了"看见"。从识别一张猫的照片,到在高速路上以毫秒级速度识别行人和车辆,到从几千小时的监控视频中自动找出异常——机器的"视觉"已经在很多场景中达到甚至超过了人类水平。

但"看见"只是第一步。机器能看懂一张猫的图片,却读不懂一句"今天天气真好"。AI的下一个挑战,是学会理解人类最复杂的创造——语言。

而解决这个问题的关键线索——注意力机制——恰恰来自于一位做机器翻译的研究者在2015年的一个灵感。

本章引用论文

| 编号 | 论文题目 | 年份 | 机构 |

|---|---|---|---|

| [1] | ImageNet Classification with Deep Convolutional Neural Networks (AlexNet) | 2012 | Toronto |

| [2] | Brook for GPUs: Stream Computing on Graphics Hardware | 2004 | Stanford |

| [3] | Deep Residual Learning for Image Recognition (ResNet) | 2015 | Microsoft Research Asia |

| [4] | Adam: A Method for Stochastic Optimization | 2014 | Toronto/Montreal |

| [6] | R-CNN: Rich Feature Hierarchies for Accurate Object Detection | 2014 | UC Berkeley |

| [7] | Fast R-CNN | 2015 | Microsoft Research |

| [8] | Faster R-CNN: Towards Real-Time Object Detection with Region Proposal Networks | 2015 | Microsoft Research Asia |

| [9] | You Only Look Once: Unified, Real-Time Object Detection (YOLO v1) | 2016 | U. of Washington |

| [10] | SSD: Single Shot MultiBox Detector | 2016 | UNC Chapel Hill |

| [11] | YOLO9000: Better, Faster, Stronger (YOLOv2) | 2017 | U. of Washington |

| [12] | YOLOv3: An Incremental Improvement | 2018 | U. of Washington |

| [13] | Mask R-CNN | 2017 | FAIR (Meta) |

| [14] | CenterNet: Objects as Points | 2019 | UT Austin |

| [15] | DETR: End-to-End Object Detection with Transformers | 2020 | FAIR (Meta) |

| [16] | Two-Stream Convolutional Networks for Action Recognition in Videos | 2014 | Oxford |

| [17] | C3D: Learning Spatiotemporal Features with 3D Convolutional Networks | 2014 | FAIR (Meta) |

| [18] | Large-scale Video Classification with CNNs (DeepVideo) | 2014 | Stanford/Google |

| [19] | TSN: Temporal Segment Networks | 2016 | CUHK |

| [20] | I3D: Quo Vadis, Action Recognition? A New Model and the Kinetics Dataset | 2017 | DeepMind |

| [21] | A Closer Look at Spatiotemporal Convolutions (R(2+1)D) | 2017 | FAIR (Meta) |

| [22] | SlowFast Networks for Video Recognition | 2018 | FAIR (Meta) |

| [23] | TimeSformer: Is Space-Time Attention All You Need for Video Understanding? | 2021 | FAIR (Meta) |

| [24] | The Bitter Lesson | 2019 | Richard Sutton |

| [25] | Understanding Deep Learning Requires Rethinking Generalization | 2016 | MIT/Google |

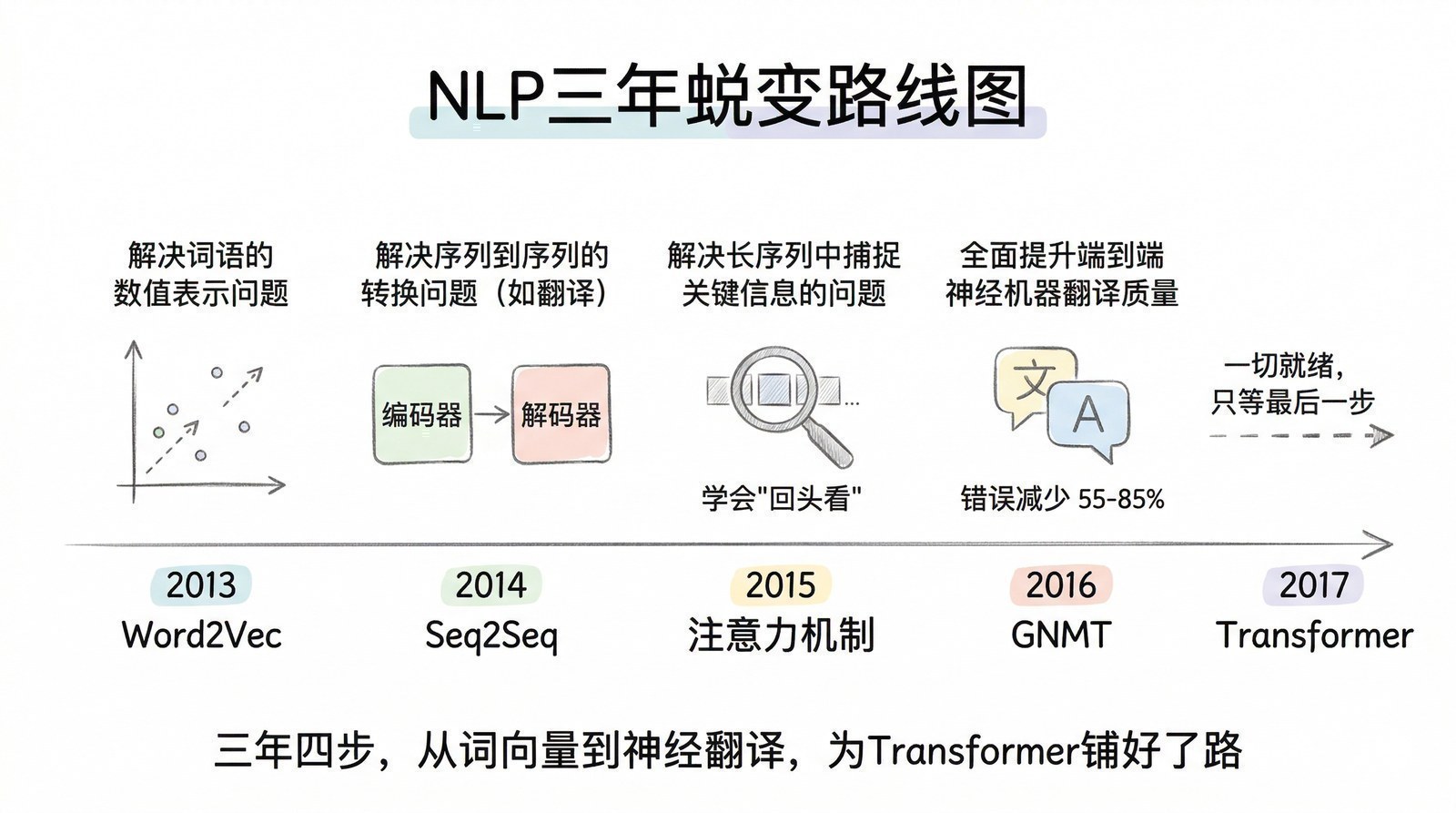

第二章:让机器"听懂"——从词向量到神经翻译,大模型前夜的三年蜕变

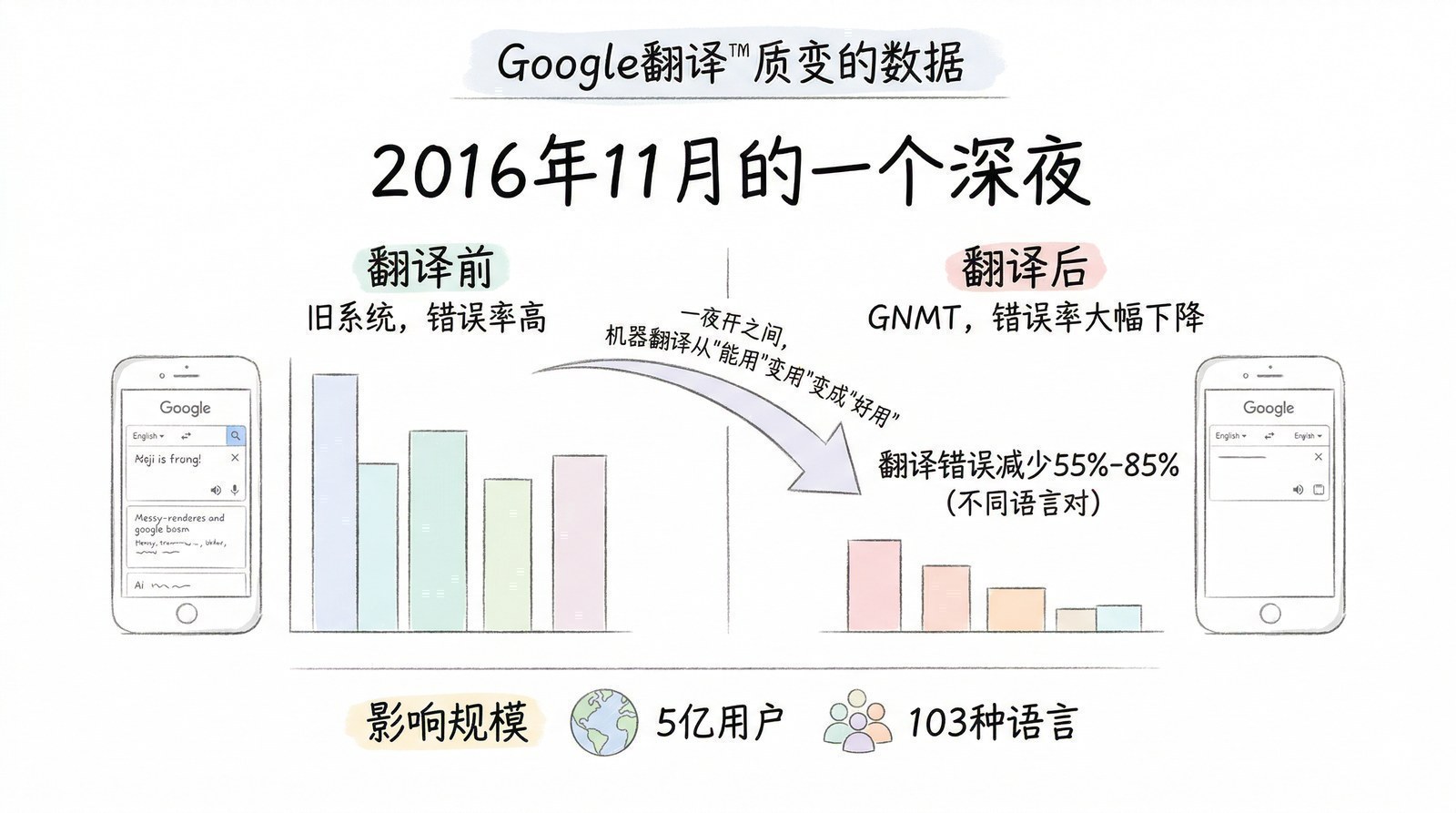

2016年11月的一个深夜

2016年11月15日,全球数亿Google翻译用户在毫不知情的情况下,成为了一场技术革命的见证者。

这天,Google悄悄地把中文↔英文翻译的后端系统从运行了十年的统计翻译引擎,切换成了一个全新的神经网络翻译系统——GNMT[6]。没有发布会,没有新闻稿,只是在Google Research的博客上低调地发了一篇文章。

但用户立刻感觉到了变化。

在此之前,Google翻译的中译英经常像是一个不太懂中文的外国人在逐字查词典:语法颠倒、词不达意、偶尔还会蹦出让人啼笑皆非的翻译。在此之后,翻译结果突然变得通顺了——不是完美的,但至少像一个"懂中文的人在说英文"了。

有多大的改善?Google自己的测量数据显示:在主要语言对上,翻译错误减少了55%-85%。社交媒体上的反应是即时的——"Google翻译怎么突然变好了?"在各种论坛被反复提问。有人甚至怀疑Google偷偷雇了真人翻译员在后台工作。

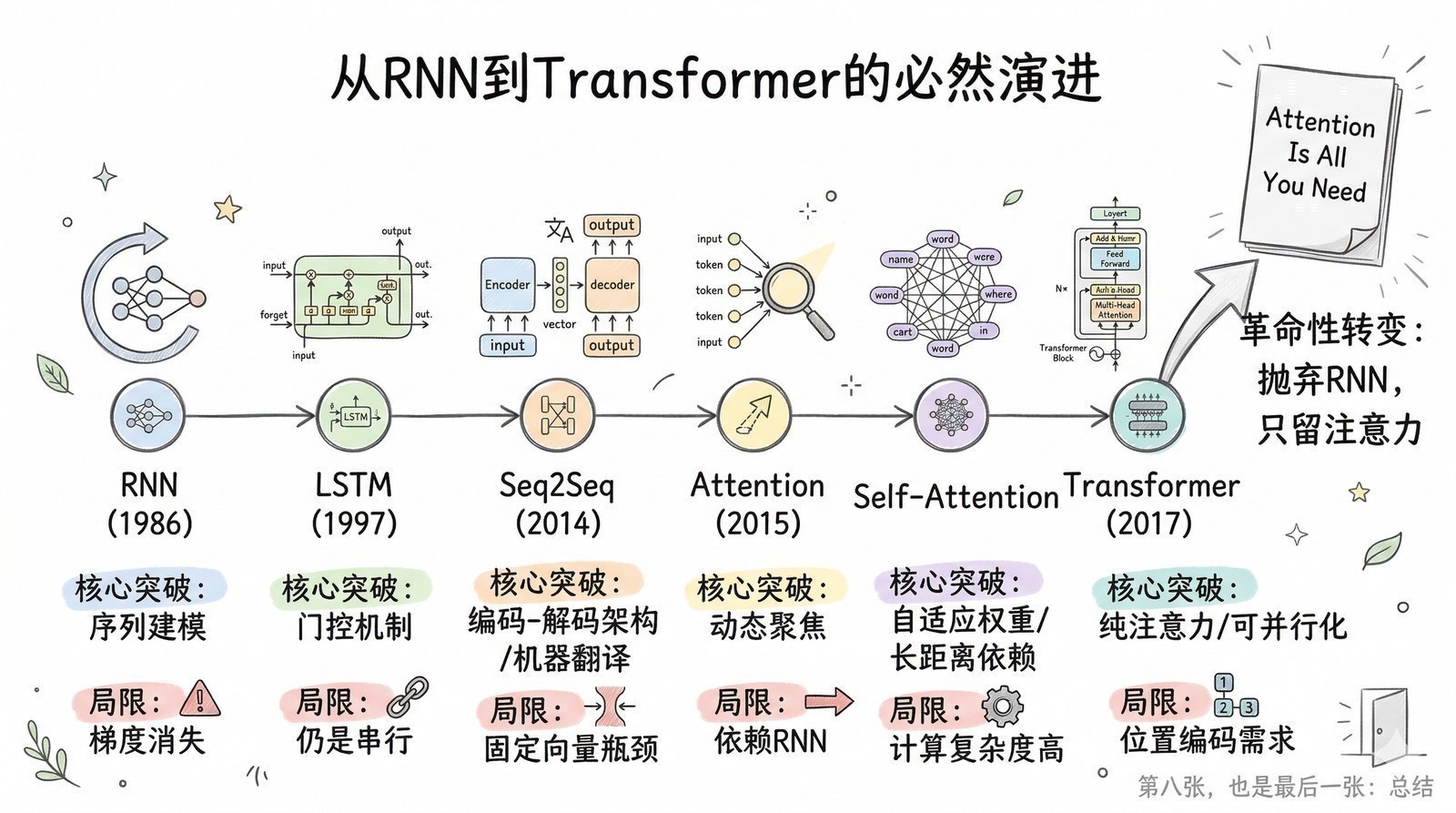

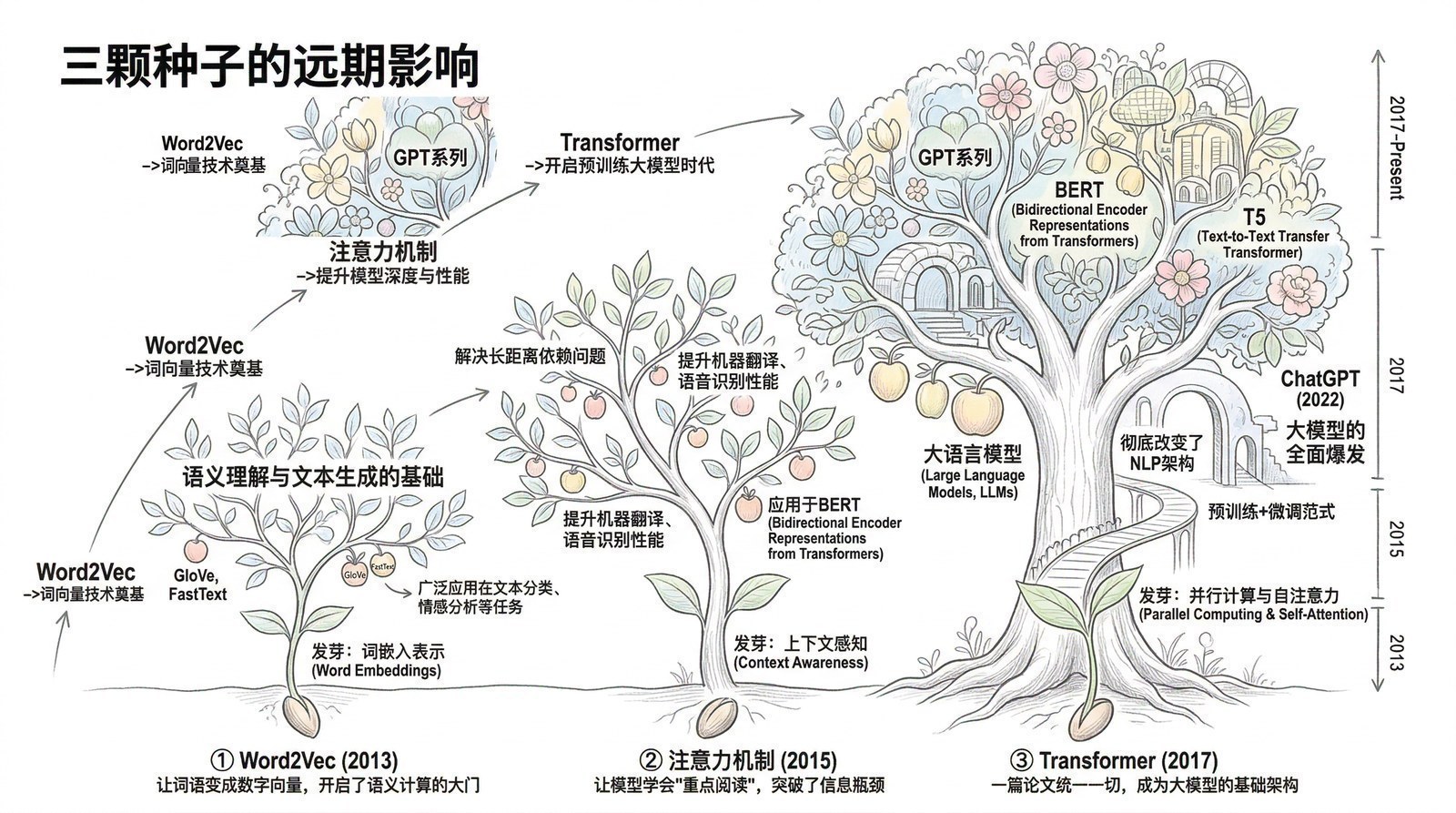

背后的秘密是一条从Word2Vec到Seq2Seq到注意力机制再到GNMT的技术进化链——只有短短三年(2013-2016),却为后来的整个大模型时代奠定了几乎所有的核心基础。今天你使用的ChatGPT、Claude、GPT-4——它们身上几乎每一个关键组件,都可以追溯到这三年间诞生的论文。

第一步:让词语变成数字——Word2Vec与词向量革命

在AI能"理解"语言之前,首先要解决一个最基本的问题:怎么把文字变成计算机能处理的数字?

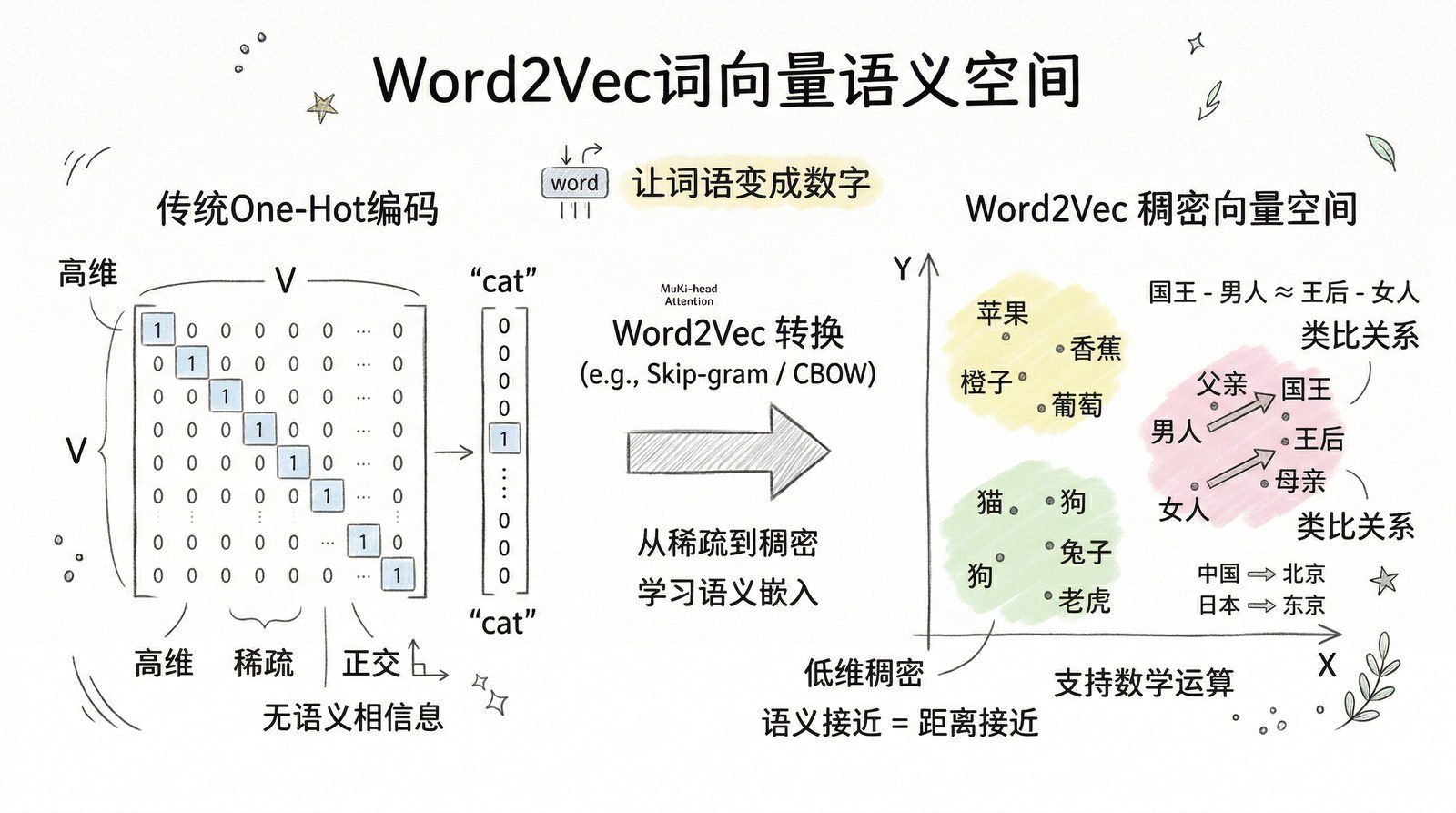

最朴素的做法叫"one-hot编码"——假设词典里有10万个词,每个词用一个10万维的向量表示,只有对应位置是1,其他全是0。问题很明显:在计算机看来,"猫"和"狗"的距离,与"猫"和"经济学"的距离完全一样。计算机根本不知道"猫"和"狗"是相似的概念。 语言中蕴含的丰富语义关系——同义、反义、类比、从属——全部丢失了。

2013年,Google的Tomas Mikolov、Kai Chen、Greg Corrado和Jeffrey Dean发表了Word2Vec[1],提出了一个简单但深刻的想法:通过预测一个词周围的词来学习这个词的"含义"。

核心逻辑基于语言学中的"分布假说":一个词的含义由它经常出现的语境决定。"猫"经常和"宠物""毛茸茸的""喂食"一起出现,"狗"也是——所以它们的向量应该很接近。"经济学"经常和"市场""GDP""通胀"一起出现,所以它的向量应该离"猫""狗"都很远。

Word2Vec用一个只有一层隐藏层的浅层神经网络,提供了两种训练方式:CBOW(Continuous Bag-of-Words,用周围的词预测中间的词)和Skip-gram(用一个词预测它周围的词)。在大量文本上训练后,每个词被表示为一个几百维的"词向量"——维度从常见的100维到Google自己使用的300维不等。

这些向量有一些令人惊叹的性质,其中最著名的是语义算术:

"国王" - "男人" + "女人" ≈ "女王"

"巴黎" - "法国" + "日本" ≈ "东京"

词向量不仅捕捉了词语之间的相似性,还捕捉了词语之间的关系。"国王到男人的关系"和"女王到女人的关系"被编码在向量空间中相同的方向上——语义关系可以用简单的向量加减法来计算。这在2013年是一个令人震惊的发现。

Word2Vec确立了一种贯穿整个大模型时代的核心思想:语言可以被"压缩"成数学空间中的点和方向,语义关系可以用向量运算来表达。 后来BERT(2018年)的核心任务——随机遮住一个词,让模型根据上下文猜测是什么词——本质上就是Word2Vec"用上下文预测目标词"的深度升级版。GPT的"预测下一个词",和Skip-gram在精神上一脉相承。

但Word2Vec有两个根本性的局限。第一,它为每个词只能生成一个固定的向量——无法处理一词多义。"苹果"在"吃苹果"和"苹果公司"中含义完全不同,但Word2Vec给它们同一个向量。第二,它只能捕捉局部的词与词关系,无法理解句子级别的含义——"狗咬人"和"人咬狗"在Word2Vec看来差别不大,因为包含的词完全相同。

要解决这些问题,需要一种能处理序列的模型——不只是看单个词,而是按顺序读整句话。

第二步:让机器学会"读入一句话,吐出另一句话"——Seq2Seq

2014年是自然语言处理历史上极为密集的一年。三篇几乎同时发表的论文,共同确立了Seq2Seq(Sequence to Sequence) 这个影响深远的框架。

第一篇来自蒙特利尔大学的Kyunghyun Cho等人,提出了RNN Encoder-Decoder框架[2]——用一个循环神经网络(RNN)把输入序列"编码"成一个向量,再用另一个RNN把这个向量"解码"成输出序列。他们在这篇论文中还提出了GRU(门控循环单元),一种比标准RNN更高效的变体。

第二篇同样来自蒙特利尔团队,Cho等人分析了编码器-解码器架构的特性[4]——发现当输入句子变长时,翻译质量会急剧下降。

第三篇来自Google的Ilya Sutskever(AlexNet的那位作者,此时已加入Google Brain)、Oriol Vinyals和Quoc Le,题目直截了当:《Sequence to Sequence Learning with Neural Networks》[3]。这篇论文用更深的LSTM(长短期记忆网络——一种专门设计来记住长距离信息的RNN变体)实现了Seq2Seq,并加入了一个巧妙的技巧——把输入句子反转后再喂给编码器,在英法翻译上取得了当时最好的结果。

用一个比方来理解整个框架:想象你要把中文翻译成英文。你先从头到尾读一遍中文句子,在脑子里形成一个"这句话大概意思是什么"的整体理解——这是编码器的工作,把输入序列压缩成一个固定长度的"上下文向量"。然后你根据这个整体理解,一个词一个词地输出英文——这是解码器的工作,从这个向量中逐步生成输出序列。

Seq2Seq的编码器-解码器框架是一个极其通用的抽象。翻译只是它的第一个应用——文本摘要(长文→短文)、对话(问题→回答)、语音识别(音频→文字)、代码生成(自然语言→代码)都可以用它建模。今天ChatGPT回答你的每一个问题,本质上就是Seq2Seq——从输入序列生成输出序列。一年后Transformer(第四章)的架构直接继承了编码器-解码器结构;BERT只用了编码器(专注"理解"),GPT只用了解码器(专注"生成")——都是Seq2Seq框架的"半边天"。

但Seq2Seq有一个根本性的缺陷:信息瓶颈。无论输入是5个词还是50个词,都被塞进同一个几百维的向量里。就像把一本书压缩成一句话,短句还好,长句必然丢失大量信息。蒙特利尔团队的分析[4]清楚地展示了这一点:句子超过20个词后,翻译质量就开始显著下降。

更深层的限制来自硬件。Seq2Seq使用的RNN必须按顺序处理每个词,一个接一个,无法并行。读一个100词的句子就要顺序执行100步——即使2014年的主力GPU NVIDIA K80也无法加速这个过程,因为GPU擅长的是并行计算,而RNN偏偏是串行的。Sutskever的论文中,训练一个英法翻译模型需要在8块GPU上跑10天。想把模型做得更大、处理更长的文本?算力需求会急剧膨胀——这在当时完全不可承受。

RNN的顺序瓶颈和算力的天花板,成了NLP进一步突破的最大障碍。突破它需要两件事:一种不需要顺序处理的新机制,和更强大的并行计算硬件。 前者在一年后到来,后者是第三章的故事。

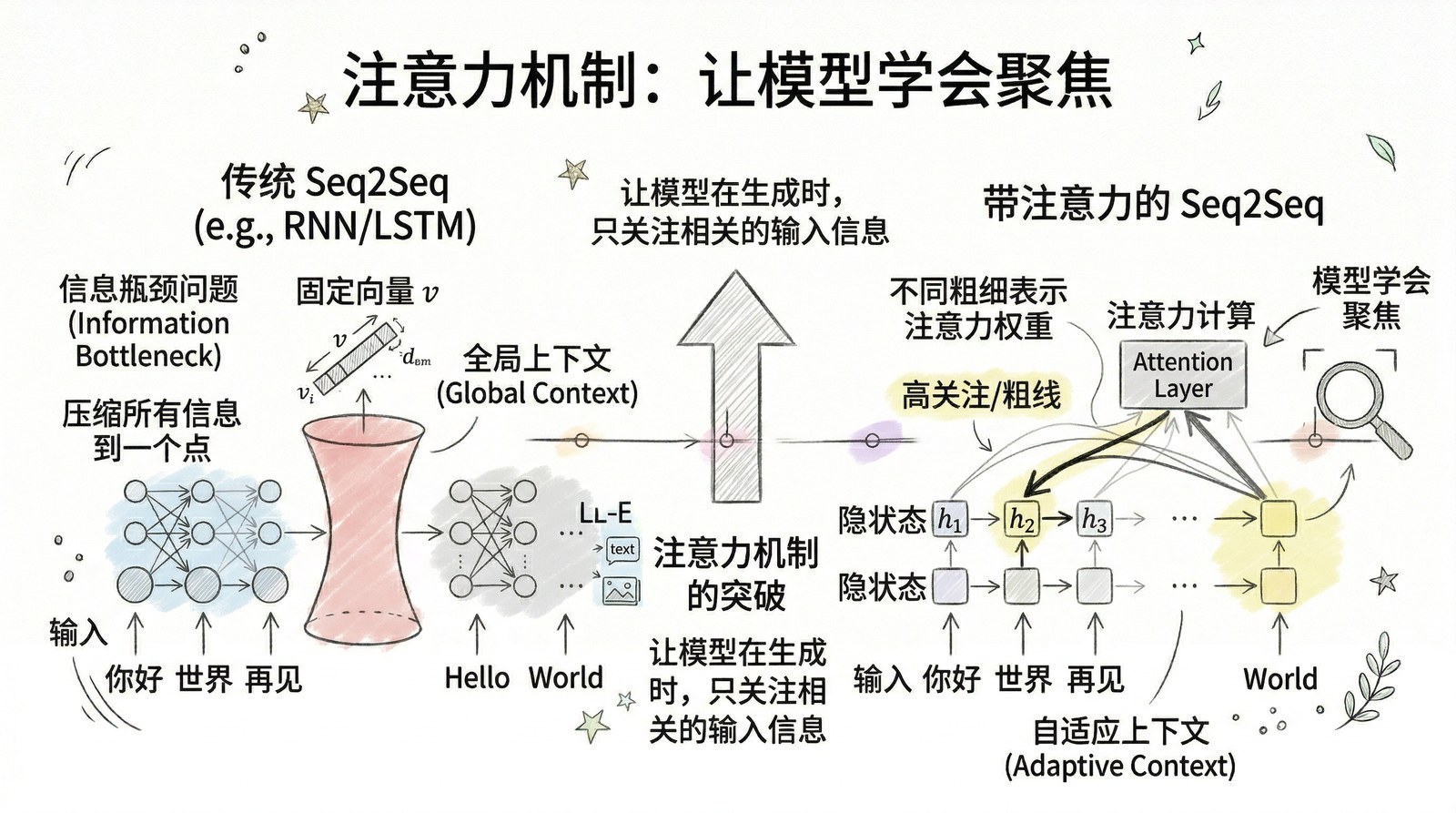

第三步:注意力机制——让模型学会"回头看"

2015年,Dzmitry Bahdanau、Kyunghyun Cho和Yoshua Bengio(深度学习三巨头之一、2018年图灵奖得主)发表了《Neural Machine Translation by Jointly Learning to Align and Translate》[5],提出了注意力机制(Attention Mechanism)。

Bahdanau的洞见很直接:Seq2Seq把整个输入压缩成一个固定向量,信息必然丢失。何必压缩呢?让解码器在生成每个输出词的时候,自己去"回头看"输入句子中最相关的部分。

翻译"我今天在北京吃了一碗很好吃的牛肉面"时,翻译到"beef noodles"就"回头看""牛肉面",翻译到"Beijing"就关注"北京"。模型在生成每个输出词时计算一组"注意力权重"——权重高的输入位置对当前输出产生更大影响。这些权重通过训练自动学习,不需要人工指定。

效果立竿见影——在长句子上(恰恰是Seq2Seq最弱的环节)提升尤为显著。而且注意力权重可以可视化:画出一张"对齐图",能直观看到模型翻译每个词时关注了输入的哪些位置。在深度学习的"黑箱"世界里,这种可解释性极为罕见。

注意力机制的影响远超翻译质量本身。它从根本上改变了神经网络处理信息的方式——从"必须顺序处理"变成了"可以跳跃关注"。两年后Google的八人团队把这个想法推到极致:如果注意力这么好用,为什么不把整个模型都建立在注意力之上? 去掉RNN,去掉卷积,只留注意力——这就是Transformer,论文标题"Attention Is All You Need"本身就是在向Bahdanau致敬。

Bahdanau注意力是"解码器关注编码器"的跨注意力。Transformer进一步发展出了"自注意力"——序列中每个位置都关注所有其他位置——彻底摆脱了RNN的顺序束缚。BERT用自注意力实现双向理解,GPT用带掩码的自注意力实现从左到右的生成。两者都直接站在Bahdanau的肩膀上。

但2015年的注意力仍然嫁接在RNN之上——模型主体还是顺序处理的LSTM,注意力只是一个附加组件。RNN的根本瓶颈并没有被消除。要彻底解决这个问题,需要一种完全基于注意力、不需要任何循环结构的新架构——这需要等到2017年的Transformer,而Transformer的训练又依赖更强大的GPU(从K80到P100再到V100,详见第三章)。

如果大模型时代有一个"创世时刻",那不是GPT-1的发表,不是ChatGPT的上线,而是2015年注意力机制的发明。它是后来一切的起点。

第四步:Google翻译的质变——GNMT

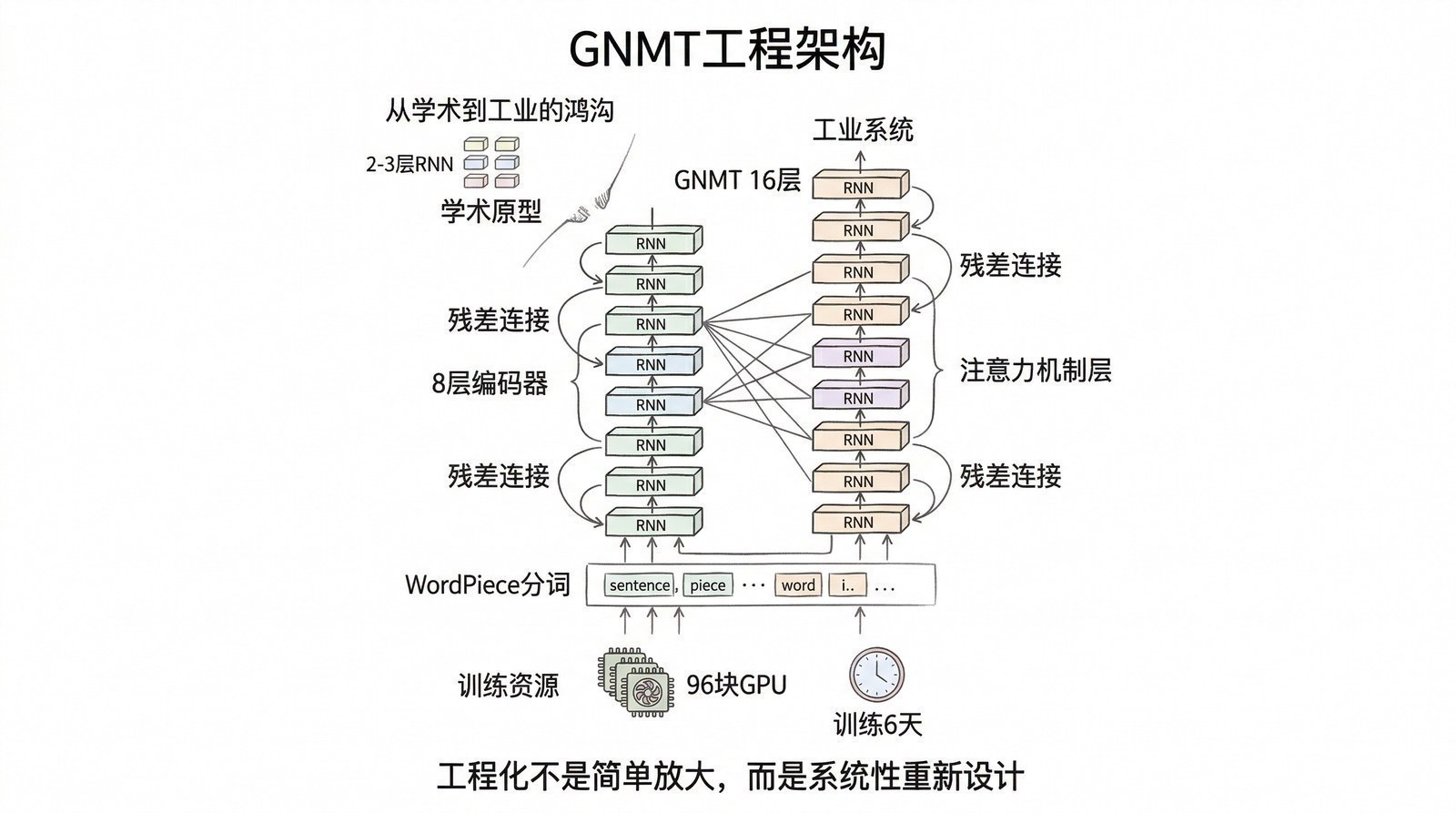

从学术论文到实际产品,中间隔着一段漫长的工程之路。Google翻译每天处理超过1800万次中英翻译请求,全部语言对加起来每天翻译超过1000亿个词。学术模型能翻译几百个句子就算成功,工业系统需要在毫秒级延迟内完成上亿次请求。

Google的吴永辉(Yonghui Wu)等人在《Google's Neural Machine Translation System》[6]中详细描述了这座桥是怎么搭起来的。GNMT的关键创新:

深层堆叠——8层LSTM编码器+8层LSTM解码器+注意力机制,总参数约2.1亿。当时学术模型通常只有2-4层,GNMT把深度推到了极限。但训练这样的深层网络需要Google专门研发的TPU(张量处理单元)——普通GPU已经扛不住了。

WordPiece分词——今天所有大模型"看"文字的方式在这里定型。 传统方法用整词作为最小单位,遇到陌生词只能标记"未知"。WordPiece把单词拆成更小的子词片段——"unbelievable"变成"un"+"believ"+"able"。即使遇到训练时没见过的新词,也能通过组合已知子词来处理。这个思路直接被BERT的WordPiece分词器和GPT的BPE(字节对编码)分词器继承。

残差连接——和ResNet(第一章)的思路一样,在深层LSTM之间加入快捷连接,让梯度可以"抄近道"直达深层。这使训练极深的序列模型成为可能,后来也被Transformer全面采用。

GNMT于2016年11月上线,首批支持中英等8个语言对。翻译错误减少55%-85%——Google评估这一次升级的提升幅度,相当于过去十年统计翻译方法累积的全部进步。到2017年底覆盖100+种语言。

GNMT往往被视为"一个翻译产品的升级",但它的贡献远超翻译本身:WordPiece/BPE分词成为所有主流大模型的标配,深层残差网络+注意力的组合为Transformer提供了工程经验,GNMT对算力的饥渴更是直接驱动了Google TPU的研发——"模型推动芯片进化"这条路线,后来在NVIDIA的A100/H100上不断重演。

GNMT也暴露了RNN架构的终极天花板。8层LSTM的训练需要TPU集群跑6天,而且由于RNN的顺序特性,即使有更多TPU也很难进一步提速。如果想从2亿参数扩展到10亿、100亿,训练时间会变得不可接受。无法并行是RNN的"原罪"。

这个瓶颈让Google内部开始思考一个根本性的问题:有没有一种架构,既保留注意力的优势,又彻底摆脱RNN的顺序束缚?

一条注定走向"只留注意力"的进化之路

回头看这三年的技术演进,你会发现一条清晰到几乎"命中注定"的淘汰链——每一步进化都在做同一件事:扔掉不必要的组件,只保留真正有效的那个。

最初的Seq2Seq(2014年),核心组件有三个:RNN(负责顺序处理序列)、编码器-解码器框架(负责"读入→输出"的整体结构)、以及把整个输入压缩成一个固定向量的"信息瓶颈"。

这三个组件中,第一个被扔掉的是"信息瓶颈"。Bahdanau注意力(2015年)让模型可以直接"回头看"输入的任意位置,不再需要把所有信息塞进一个向量。但注意力此时只是一个附件——模型的主体仍然是RNN,信息仍然是一个词一个词顺序处理的。

GNMT(2016年)把这套"RNN + 注意力"的组合推到了工业极限——8层LSTM,2.1亿参数,TPU集群训练6天。结果证明了两件事:第一,注意力是真正带来质变的组件(它让翻译错误减少了55%-85%)。第二,RNN是那个拖后腿的组件——它让模型无法并行训练,成为扩展规模的最大瓶颈。

这就产生了一个很自然的问题:既然注意力才是带来效果提升的核心,而RNN是阻碍规模扩展的瓶颈,那为什么不把RNN也扔掉,只留注意力?

这个问题的答案不是理论上的飞跃,而是工程上的必然。背后的驱动力主要有三个:

第一,并行化的需求。 GPU(以及后来的TPU)天生擅长大规模并行计算——同时处理成千上万个运算。但RNN必须按顺序处理每个词(第1个词处理完才能处理第2个词),完全无法利用GPU的并行能力。注意力机制则不同——计算每个位置的注意力权重时,可以同时计算所有位置,天然适合并行。如果把模型全部建立在注意力之上,训练速度会有数量级的提升。

第二,长距离依赖的需求。 RNN处理序列时,信息必须一步一步传递——从第1个词传到第100个词,中间经过了99步传递,信息不可避免地衰减。LSTM通过记忆门控机制缓解了这个问题,但在超过几百个词的序列上仍然力不从心。而注意力机制可以让第1个词直接"看到"第100个词——信息传递的路径从99步缩短到1步。只用注意力的模型在处理长文本时有天然的优势。

第三,规模扩展的需求。 2016年的GNMT有2.1亿参数,已经需要TPU集群训练6天。如果想把模型扩展到10亿、100亿参数(后来GPT-3确实做到了1750亿),必须要一种能高效利用大规模并行硬件的架构。RNN的顺序瓶颈意味着增加再多的GPU也没法线性加速训练。只有去掉RNN,才能真正释放硬件的全部潜力。

所以,2017年Transformer论文的标题"Attention Is All You Need"(注意力就是你所需要的一切)不是一句口号,而是对前三年技术进化的精确总结——经过三年的逐步试错和排除,RNN被排除了(因为无法并行),卷积被排除了(因为视野有限),最终只剩下注意力机制被证明是那个既能捕获语义关系、又能完全并行化的组件。

Transformer没有发明注意力——Bahdanau在2015年已经做了。Transformer也没有发明编码器-解码器——Seq2Seq在2014年已经做了。Transformer真正做的事情是:把前三年摸索出来的所有有效成分保留下来(注意力、编码器-解码器框架、残差连接、子词分词),把所有被证明是瓶颈的成分去掉(RNN的顺序处理、卷积的局部视野),重新组装成一个干净、统一、完全可并行的新架构。

这就是为什么说"Attention Is All You Need"不是凭空出现的——它是一条确定的进化路线的终点。从Seq2Seq到注意力到GNMT,每一步都在指向同一个方向:去掉冗余,只留注意力。 2017年的那篇论文只是把这个方向走到了逻辑上的尽头。

而这个新架构需要的算力支撑——能让注意力完全并行运行的硬件——恰好也在同一年成熟了。2017年NVIDIA发布了V100 GPU,首次集成了专为矩阵运算设计的Tensor Core。技术和算力,在2017年这个节点上再次同时就位——就像2012年AlexNet需要GPU和ImageNet同时成熟一样。这是第三章要讲的故事。

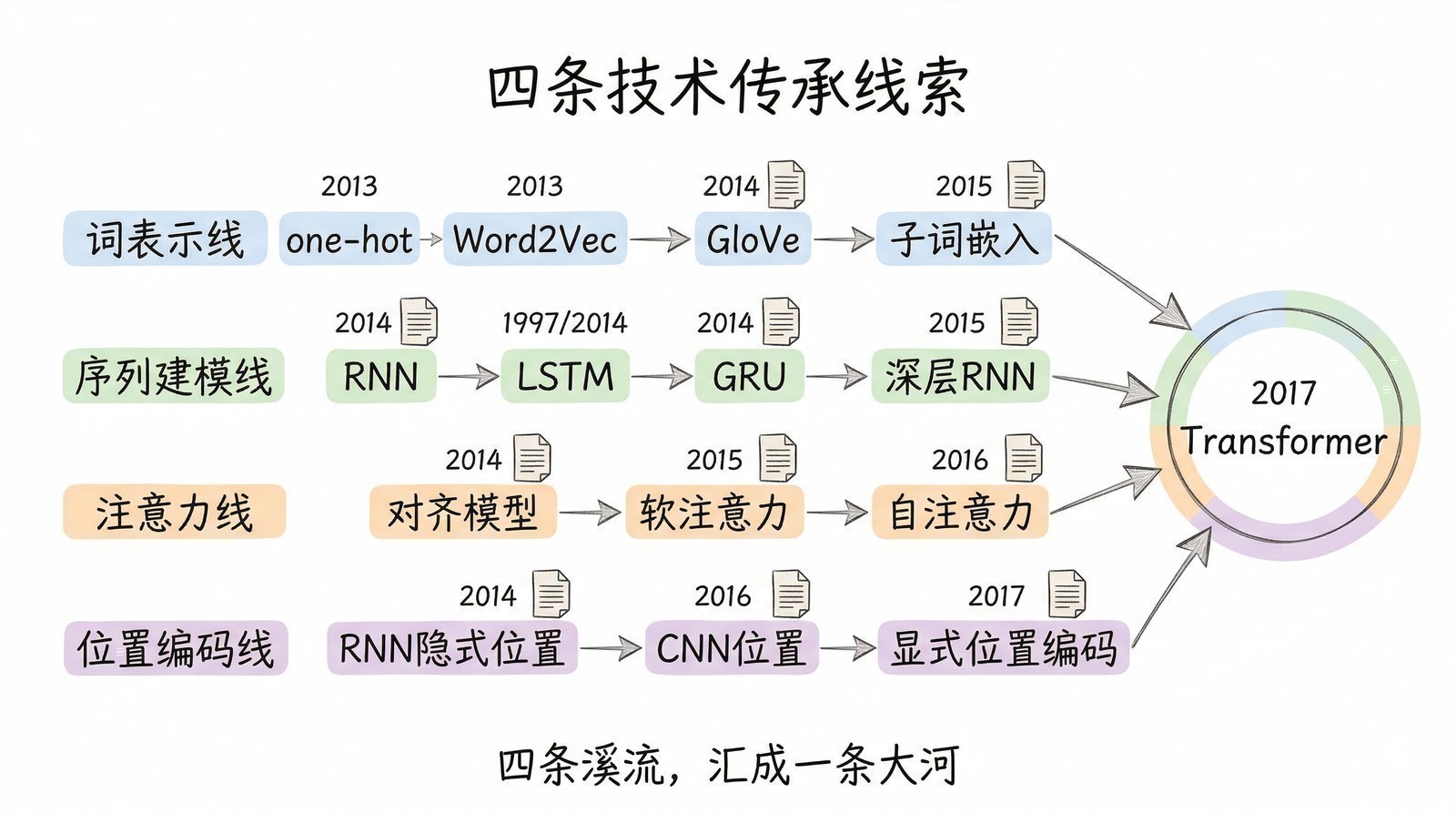

技术传承全景:从Word2Vec到大模型的四条线索

在进入产品和公司的故事之前,把这三年的技术传承关系梳理清楚:

线索一:词的表示方法 Word2Vec词向量(2013)→ GNMT的WordPiece子词表示(2016)→ BERT的WordPiece(2018)→ GPT的BPE分词(2018)→ 今天所有大模型的token化方式

线索二:序列建模框架 Seq2Seq编码器-解码器(2014)→ GNMT深层编码器-解码器(2016)→ Transformer编码器-解码器(2017)→ BERT只用编码器 / GPT只用解码器

线索三:注意力机制的进化 Bahdanau跨注意力(2015)→ GNMT工业级注意力(2016)→ Transformer自注意力+多头注意力(2017)→ 今天所有大模型的核心计算单元

线索四:算力需求的升级 Word2Vec在普通服务器上训练 → Seq2Seq需要多块GPU跑数天 → GNMT需要TPU集群跑一周 → Transformer需要更大规模并行 → GPT-3需要上万块GPU训练数月

每一步技术进步都要求更大的算力,每一次算力突破又使能新的技术。这种"技术推动算力需求,算力反过来使能新技术"的螺旋式上升,正是大模型时代最核心的动力学。第三章会专门展开这个故事。

为什么最终"只留注意力"——一条注定的进化路线

回顾这三年的技术演进,有一条暗线贯穿始终:RNN在一步步被淘汰,注意力在一步步被加强,直到注意力完全取代了RNN。 这个过程不是偶然的灵光一闪,而是一条有着清晰因果逻辑的进化路线。

故事要从RNN的"原罪"说起。

RNN(循环神经网络)处理语言的方式是逐词顺序读取——读完第一个词,才能读第二个词;读完第二个词,才能读第三个词。这种设计在直觉上很自然——人类读书也是从左到右一个字一个字读的。但它带来了三个越来越严重的问题:

问题一:记忆衰减。 RNN把已经读过的信息"压缩"在一个固定大小的隐藏状态中。句子越长,早期读到的信息在隐藏状态中的"痕迹"就越淡。读到第100个词时,第1个词的信息可能已经被后面99个词冲刷得所剩无几。LSTM(1997年发明)通过引入"门控"机制部分缓解了这个问题——它像一个有选择性记忆的人,能决定"记住什么、忘掉什么"。但LSTM也不是万能的:在超过几百个词的序列上,记忆衰减依然存在。

问题二:无法并行。 这是RNN最致命的缺陷。由于每一步的计算都依赖上一步的输出(第2个词的处理必须等第1个词处理完),RNN天生是串行的。一个100词的句子就是100步顺序计算,一个1000词的文档就是1000步。GPU的核心优势是大规模并行——它有数千个计算核心可以同时工作。但RNN只能让这数千个核心排着队一个一个干活,算力利用率极低。这就好比你有一支1000人的团队,但任务只能一个人接一个人地做——999个人在等待。

问题三:训练速度的天花板。 问题二直接导致了问题三。模型越大、序列越长,训练时间就以线性甚至超线性的速度增长。Sutskever在2014年训练一个Seq2Seq模型需要8块GPU跑10天,GNMT在2016年需要Google TPU集群跑6天。如果想继续扩大模型——比如从2亿参数到10亿参数——训练时间会从几天变成几周甚至几个月。这在工业界完全不可接受。

研究者们尝试了各种修补方案:LSTM加了门控来缓解记忆衰减,GRU简化了门控结构来加速计算,双向RNN让模型既能从前往后读也能从后往前读,深层RNN通过堆叠多层来增加表达能力。这些改进都有效果,但都没有触及根本——只要还是"逐词顺序处理",瓶颈就还在。

2015年注意力机制的出现打开了一扇窗。Bahdanau注意力[5]让解码器可以"跳回去"直接关注输入序列中的任意位置——这意味着模型获取远距离信息时不再依赖RNN的隐藏状态层层传递,而是可以"一步到位"。这大大缓解了记忆衰减问题。

但Bahdanau注意力只是一个"补丁"——它仍然嫁接在RNN之上。编码器还是逐词顺序地处理输入,只是在解码时多了一条"直达通道"。RNN的串行瓶颈依然存在。

接下来发生的事情,回头看几乎是不可避免的。当研究者们发现注意力机制如此有效——它不需要顺序处理、天然支持并行计算、能直接关联任意距离的信息——一个自然的问题就浮现了:

如果注意力能解决RNN解决不了的问题,那我们为什么还需要RNN?

如果把RNN比作一条必须按站停靠的地铁线路(从第1站到第100站必须经过中间98站),那注意力机制就像一个直升机——可以直接从第1站飞到第100站,不需要经过任何中间站。既然有了直升机,还要地铁干什么?

2017年,Google的Vaswani等人用一篇论文回答了这个问题:不需要了。 他们设计的Transformer架构完全去掉了RNN和卷积,只保留了注意力机制(以及一些必要的辅助组件如位置编码和前馈网络)。

这个选择的底层逻辑非常清晰:

并行化:Transformer用"自注意力"处理输入——序列中的所有位置可以同时计算它们之间的关联,不需要等前一个位置处理完。一个100词的句子不再需要100步顺序计算,而是一步并行完成。这让GPU的数千个计算核心可以同时满负荷工作。

长距离依赖:在RNN中,第1个词的信息要传到第100个词,需要经过99步传递,每一步都会有信息损耗。在自注意力中,第1个词和第100个词之间只隔一步计算——信息损耗几乎为零。

可扩展性:正因为可以并行,Transformer的训练速度和序列长度不再是线性关系。这意味着模型可以做得更大、处理更长的文本——这直接打开了后来GPT-3的1750亿参数和GPT-4的超长上下文窗口的可能性。

回顾这条进化路线:

RNN(顺序处理,记忆衰减)

→ LSTM/GRU(加门控缓解记忆,但仍然顺序)

→ Seq2Seq(编码器-解码器框架,但信息瓶颈)

→ 注意力+RNN(缓解瓶颈,但RNN仍是主体)

→ Transformer(去掉RNN,只留注意力)

每一步都在解决上一步的瓶颈,每一步都在减少对RNN的依赖,直到最后一步把RNN完全去掉。"Attention Is All You Need"不是凭空出现的。 它是这条进化路线走到尽头后唯一合理的终点——当你发现注意力能做RNN做的所有事情,而且做得更好、更快、更容易扩展,那么保留RNN就没有任何理由了。

这也是为什么说2013-2016年这三年如此重要——不是因为它们产出了多少惊天动地的产品,而是因为它们沿着一条确定的技术路线,一步步走到了Transformer的门口。Transformer只是最后推开了那扇已经半开的门。

产品与公司聚光灯

① Google翻译大升级(2016年11月) — Seq2Seq + 注意力 + 深层LSTM。首批支持中英等8个语言对,到2017年底覆盖100+种语言。Google翻译至今服务超过5亿用户,每天翻译超过1000亿个词。数亿用户在毫不知情的情况下体验到了神经网络的威力。

② Amazon Alexa / Echo(2014年) — 2014年11月Amazon发布Echo智能音箱,内置语音助手Alexa,AI助手第一次以独立硬件进入普通家庭。虽然早期的NLP能力相当原始(大部分是规则匹配),但它开启了"语音交互"这个全新品类。到2020年全球智能音箱出货量超过1.5亿台。

③ Apple Siri的进化(2014-2016) — Siri最初(2011年)用传统语音识别和规则匹配,理解能力有限。2014年起Apple引入深度学习改造语音识别,准确率大幅提升。虽然Siri后来在AI助手竞赛中逐渐落后,但它在2011年首次让"对手机说话"成为主流行为。

④ Google Duplex(2018年5月) — 在Google I/O大会上演示AI打电话给餐厅预约座位,对方完全没有察觉在和机器对话。AI能处理停顿、犹豫、话题变化,甚至会说"嗯哼"表示在听。震惊全场的同时,也引发了AI伦理讨论——AI是否应该表明身份?

⑤ 搜索引擎的语义升级 — Word2Vec发布后,各大搜索引擎陆续引入词向量技术。之前搜"感冒怎么办"找不到"着凉的处理方法",词向量让搜索引擎理解了"感冒"和"着凉"是近义概念。又一个"润物细无声"的AI升级。

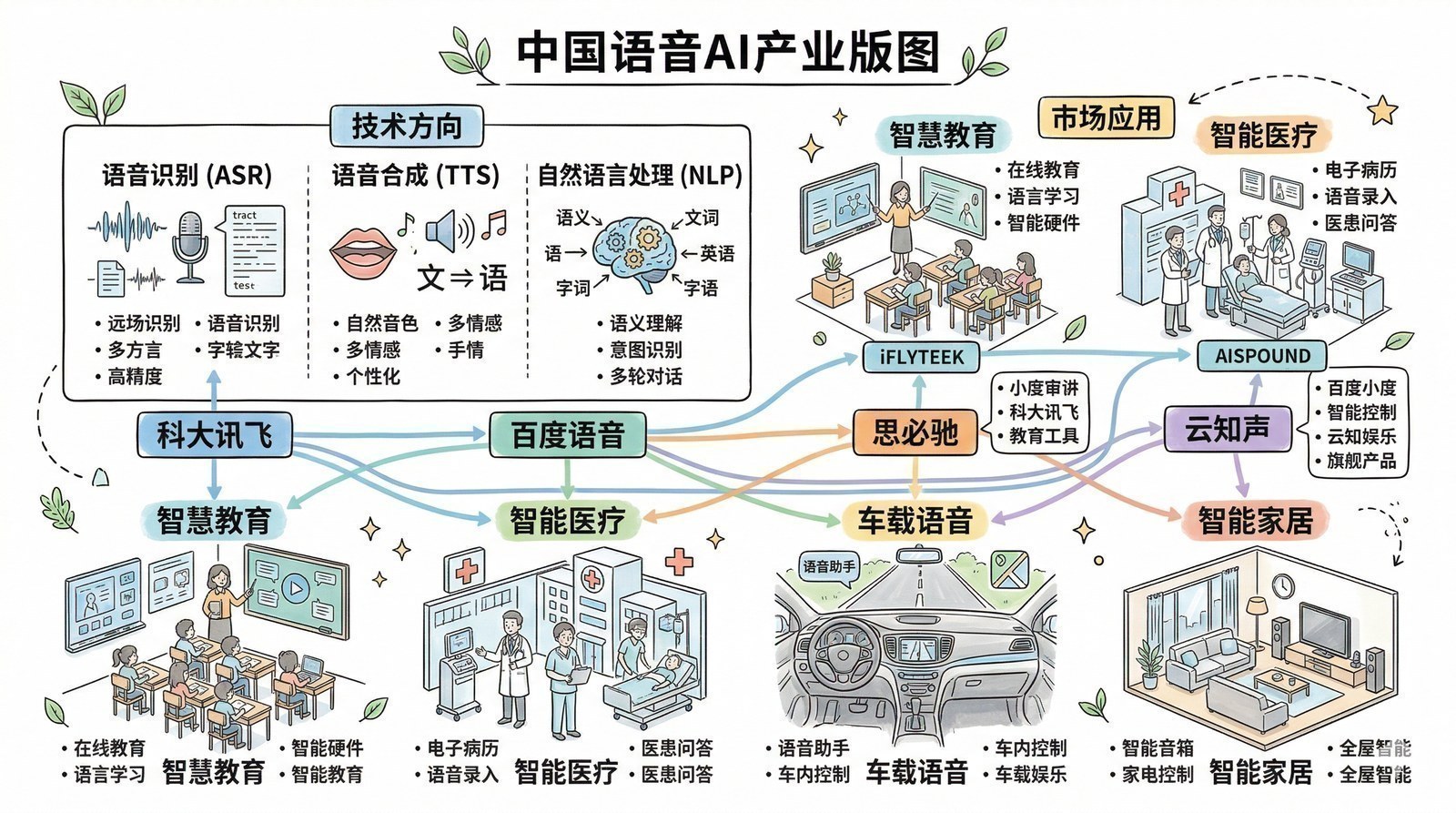

中国语音公司群像:技术与商业的互补之路

在Google翻译的GNMT震动全球的同时,中国的语音AI赛道也在上演一场精彩的竞争。这个故事值得细讲,因为它揭示了AI产业中一个反复被验证的规律——有技术还不够,技术与商业必须互补,才能走得远。

科大讯飞:老牌龙头,找到了"考试"这把金钥匙

1999年成立的科大讯飞是中国智能语音领域的先驱,创始团队来自中国科学技术大学。2008年上市,成为"中国AI第一股"。

科大讯飞的技术实力毋庸置疑——语音识别准确率长期保持国内领先。但真正让它屹立不倒的,是一个非常聪明的商业选择:深耕教育市场。通过收购多家语音评测公司,科大讯飞垄断了全国中高考英语口语评测市场——当你家孩子在学校做英语口语测试时,打分的大概率就是讯飞的系统。

考试场景的妙处在于:对技术精度要求极高(这正好是科大讯飞的强项),但一旦成为标准就极难被替代(没有学校愿意在考试评分上冒险换供应商)。到2023年,科大讯飞营收超过200亿元,在中国智能语音市场占据超过60%的份额。技术是入场券,"考试标准"才是护城河。

思必驰与云知声:在巨头的缝隙中找到自己的位置

2007年成立于英国剑桥的思必驰选择了IoT作为主攻方向——智能车载、智能家居、智能音箱。它的DUI开放平台打通了从语音识别到对话管理的全链路,在智能音箱爆发的2017-2019年为天猫精灵等产品提供了前端方案。2019年思必驰更进一步,发布了AI语音专用芯片TH1520,从纯软件走向"算法+芯片"一体化——用硬件绑定来建立更深的壁垒。

2012年成立的云知声团队来自盛大研究院,创始人梁家恩毕业于中科大(和科大讯飞是"师兄弟")。云知声选择了差异化路线——深耕智慧医疗,推出的AI语音病历系统让医生口述自动生成结构化病历,已在北京协和医院、福建省立医院等多家三甲医院上线。

这三家公司面对一个共同挑战:当BAT以免费或低价切入语音市场后,纯技术壁垒迅速降低。百度推出DuerOS,阿里有天猫精灵语音系统,腾讯也在自建。最终活下来并站稳的,都是找到了巨头不愿深耕的垂直场景——科大讯飞的教育考试、思必驰的IoT芯片、云知声的智慧医疗。

李志飞与出门问问:科学家创业的启示

在所有海外归来的AI创业者中,李志飞的故事最能说明"技术与商业互补"这个主题。

李志飞的履历堪称顶配:约翰霍普金斯大学计算机博士,师从全球顶级NLP实验室;博士期间开发了开源机器翻译软件Joshua,成为学术界两大主流翻译软件之一;毕业后拿到IBM、微软、Google、雅虎、Facebook的offer,加入Google翻译团队,参与开发了手机离线翻译系统。

2012年,李志飞从Google辞职回国创业。用他自己的话说:"从美国Google总部Research Scientist回中国创业,我是第一。"他拿到红杉资本和真格基金的天使投资,创办了出门问问,目标做"中国的Google Now"。

出门问问的发展轨迹揭示了一个关键洞见。最初它是一个语音搜索App——技术惊艳但缺乏用户粘性。李志飞很快意识到纯软件的语音助手很难建立壁垒,于是转向"软硬结合"——用自研AI语音技术打造智能硬件。2015年获得Google的C轮投资7500万美元,2017年大众汽车集团以1.8亿美元D轮独家投资,双方成立合资公司做智能车载。出门问问的TicWatch智能手表做到全球前五,进入了北美最大运营商Verizon的渠道——与苹果、三星同台竞争。

2023年大模型浪潮来临时,十年创业积累的技术底蕴和商业经验让李志飞再次站到了风口上。出门问问发布了自研大模型"序列猴子",推出AI配音助手"魔音工坊"、AI数字人"奇妙元"等AIGC产品矩阵,服务全球千万级用户。十年前从Google带回NLP技术的科学家,在大模型时代找到了技术与商业新的结合点。

李志飞的故事和第一章的AI四小龙形成了有意思的对照——同样是技术领先的AI创业者,李志飞的出门问问活了下来并持续进化,关键在于他很早就意识到:技术是敲门砖,但产品和场景才是护城河。 Google最前沿的NLP技术可以被大厂追平,但智能手表的硬件供应链、车载系统的客户关系、AIGC产品的用户数据——这些"非技术壁垒"需要时间积累,不是砸钱就能复制的。

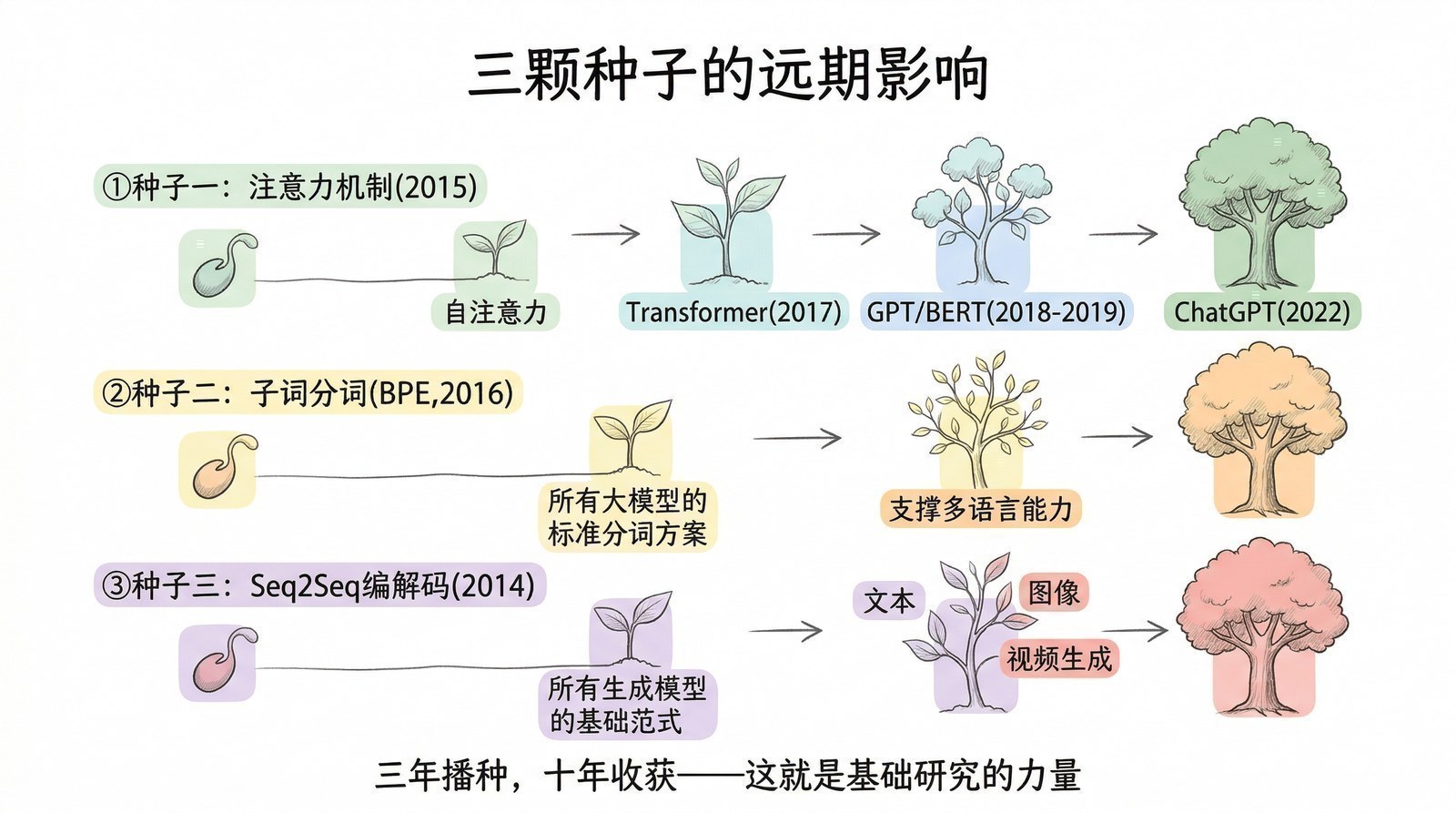

这三年播下的种子

从2013年的Word2Vec到2016年的GNMT,自然语言处理在短短三年内完成了一次蜕变。这三年虽然不如计算机视觉那么声势浩大,但它播下的种子,每一颗都在后来长成了参天大树。

种子一:注意力机制——后来一切的起点。 Bahdanau在2015年种下的那颗种子,两年后长成了Transformer,再后来成为GPT、BERT、CLIP乃至整个大模型时代的核心基础设施。

种子二:Seq2Seq + 词向量——大模型的DNA。 今天的大模型至少携带着三段来自这个时代的"基因":Word2Vec开创的"用预测学习语义"的训练范式、Seq2Seq建立的编码器-解码器框架、GNMT定型的子词分词方法。理解了这三件事,就理解了大模型最底层的工作原理。

种子三:算力是技术进步的"隐形台阶"。 Word2Vec可以在普通服务器上训练,Seq2Seq需要多块GPU,GNMT需要TPU集群。每一步技术进步都在要求更大的算力——而RNN因为无法并行,在算力利用上碰到了天花板。这条"技术与算力协同进化"的螺旋将在第三章完整展开。

种子四:技术与商业的互补才能走得远。 无论是Google翻译靠GNMT实现产品质变,还是科大讯飞靠教育考试站稳脚跟,还是李志飞靠智能硬件找到独特定位——成功的AI公司无一例外都在"技术能做什么"和"市场需要什么"之间找到了交汇点。

回到2016年那个11月的深夜。当全球数亿用户在不知不觉中用上了更好的翻译时,很少有人意识到:让这一切成为可能的注意力机制,其实是一种比翻译本身深远得多的发明。

它本质上是在说:处理信息时,不需要从头到尾按顺序看每一个元素。你可以直接跳到最重要的部分。

一年后,Google的一个八人小组把这个想法推到了逻辑上的极端:如果注意力这么好用,为什么不全部用注意力?

他们给论文起了一个霸气的标题:Attention Is All You Need。

但在那之前,还有一个故事需要讲——是什么样的硬件进化,让这些越来越大的模型有了生存的土壤?

本章引用论文

[1] Efficient Estimation of Word Representations in Vector Space (Word2Vec), 2013, Google (Mikolov, Chen, Corrado, Dean)

[2] Learning Phrase Representations using RNN Encoder-Decoder for Statistical Machine Translation, 2014, Montreal (Cho et al.)

[3] Sequence to Sequence Learning with Neural Networks (Seq2Seq), 2014, Google (Sutskever, Vinyals, Le)

[4] On the Properties of Neural Machine Translation: Encoder-Decoder Approaches, 2014, Montreal (Cho et al.)

[5] Neural Machine Translation by Jointly Learning to Align and Translate (Bahdanau Attention), 2015, Montreal (Bahdanau, Cho, Bengio)

[6] Google's Neural Machine Translation System: Bridging the Gap between Human and Machine Translation (GNMT), 2016, Google (Wu et al.)

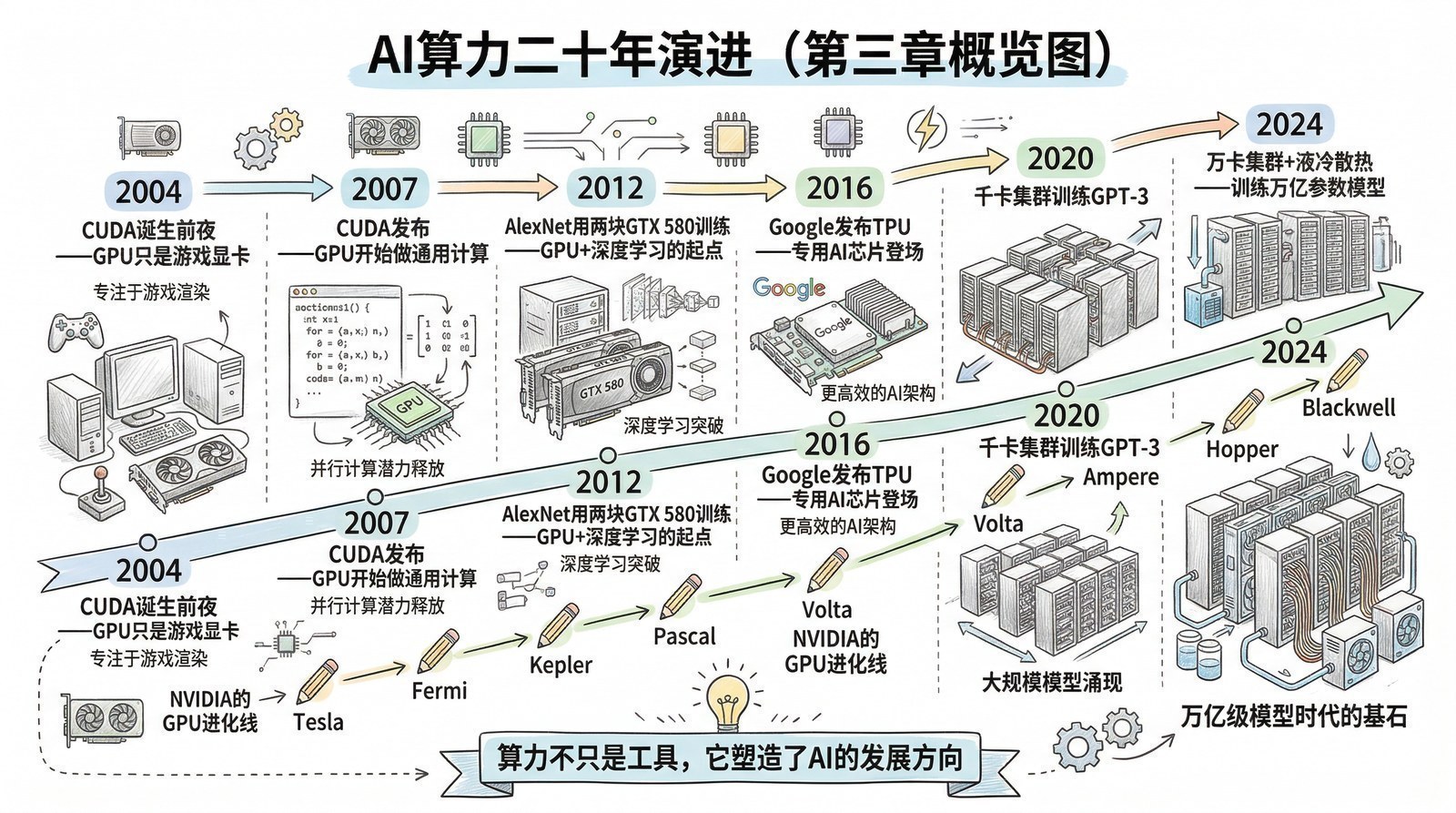

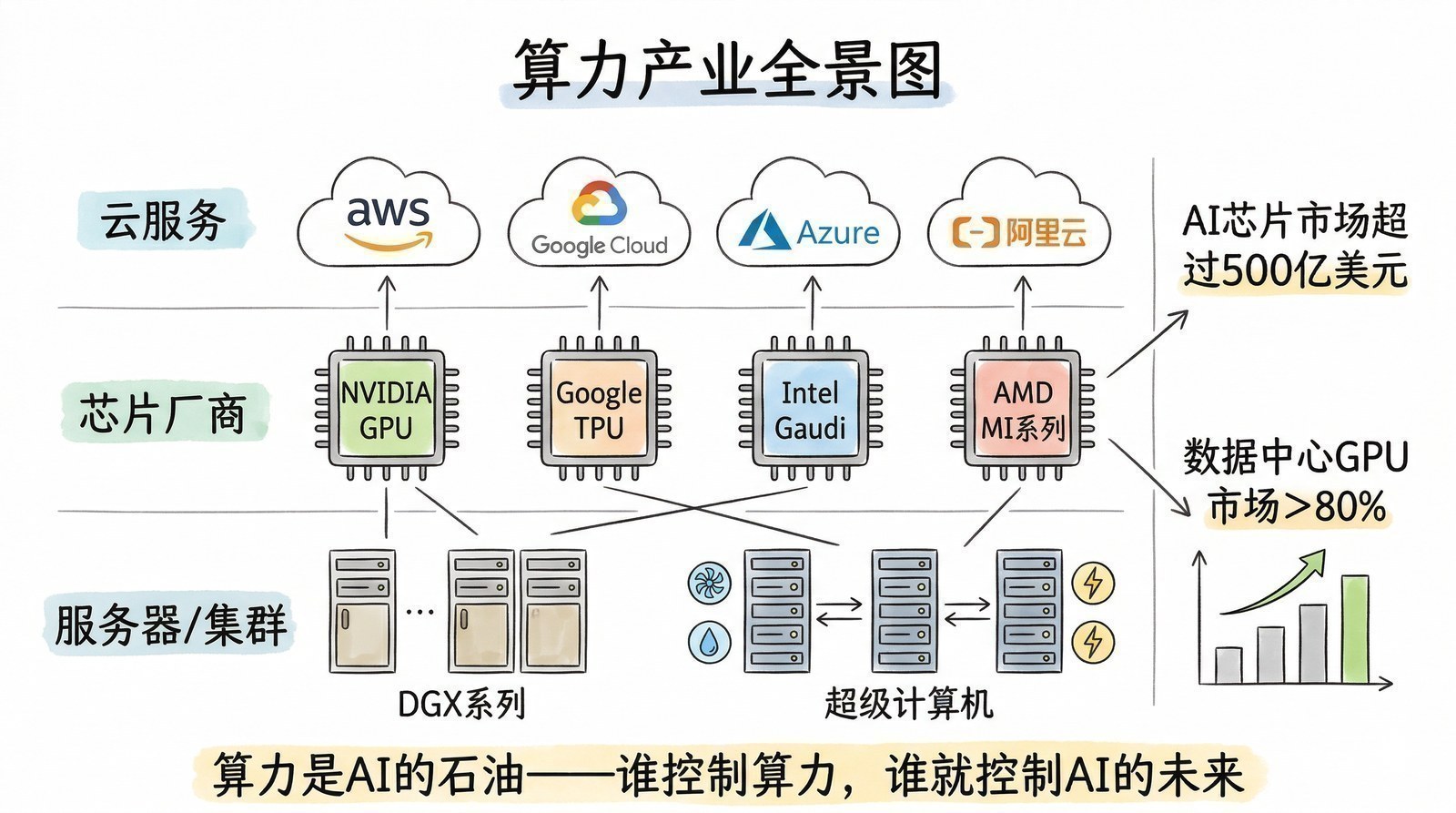

第三章:算力底座——从游戏显卡到AI超级计算机

一块"错配"的芯片

2012年AlexNet横扫ImageNet竞赛的时候(第一章),它用的训练硬件是两块NVIDIA GTX 580——零售价499美元、为游戏玩家设计的消费级显卡,每块只有1.5GB显存,总共3GB。

2024年,训练一个前沿大模型(如GPT-4级别)需要什么?上万块NVIDIA H100 GPU,每块售价约3万美元,总投资数亿甚至数十亿美元。一个H100 GPU集群的年电费账单就要几千万美元。

从两块500美元的游戏显卡到价值数十亿美元的AI超级计算机,中间只隔了12年。这12年间究竟发生了什么?

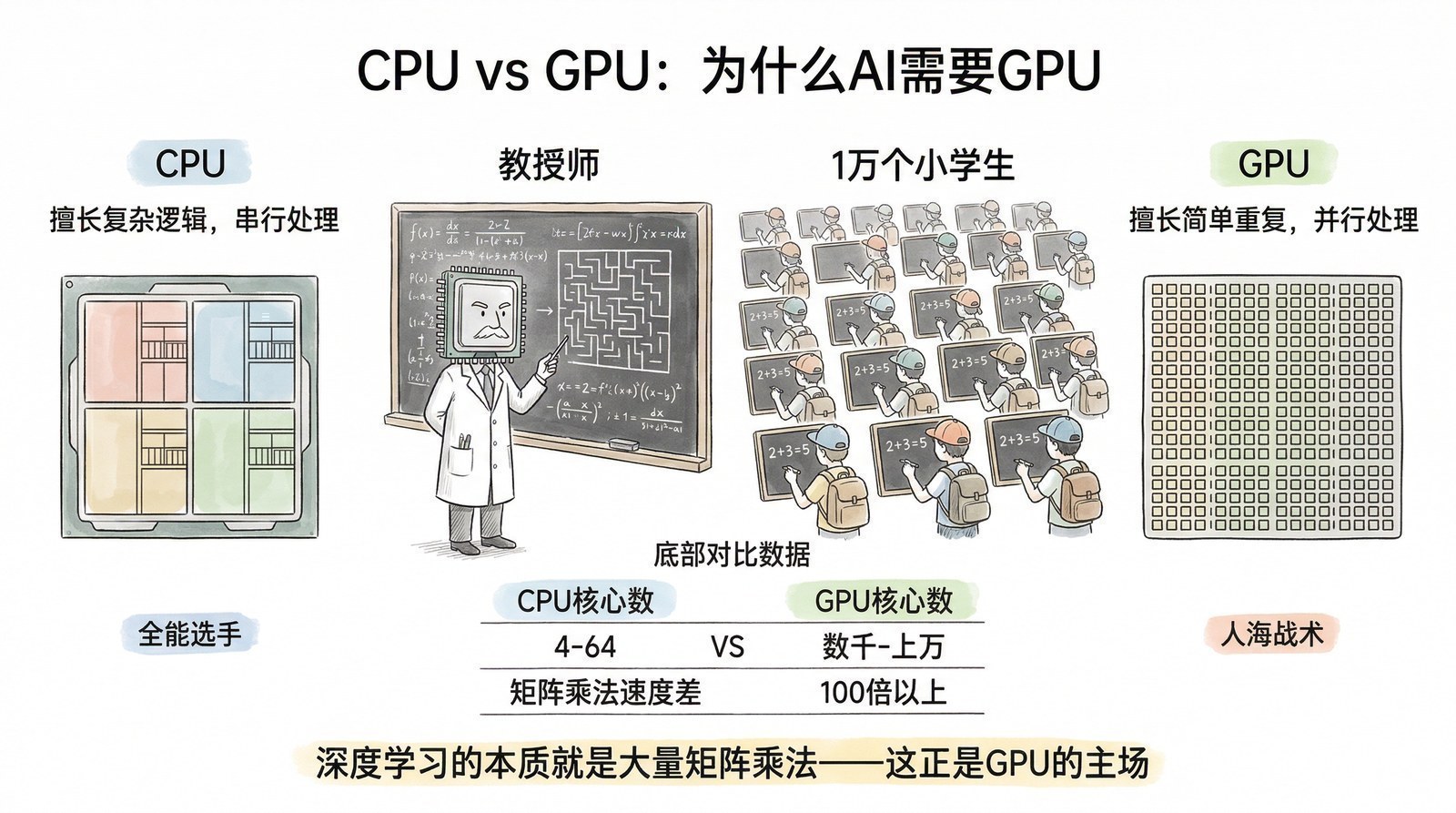

答案藏在一个反直觉的事实中:AI的爆发,最初不是因为有人专门为AI设计了芯片,而是因为一种为渲染游戏画面设计的芯片,恰好适合做AI需要的数学运算。 GPU被设计来渲染像素,每帧画面有几百万个像素需要独立计算颜色和亮度,GPU因此拥有数千个可以同时并行工作的计算核心。而训练神经网络的核心运算恰好也是大规模并行的矩阵乘法。渲染像素和训练神经网络,在数学层面上惊人地相似。

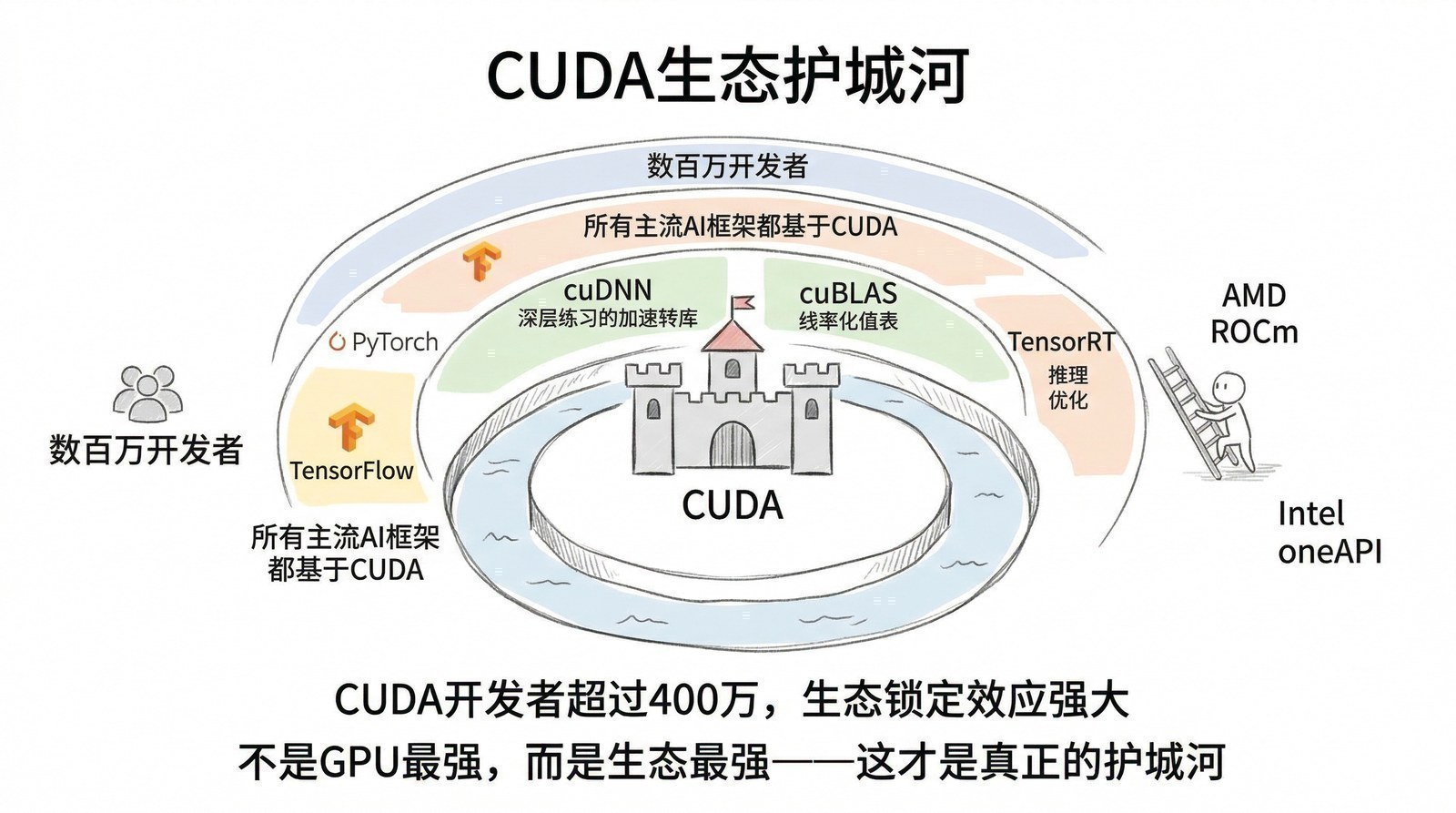

从游戏到科学:GPU通用计算的诞生

2004年之前,GPU只能做一件事:画图。如果你想用GPU做矩阵乘法,你必须把运算伪装成"给图片上色"的图形操作——荒谬但真实。

2004年,Stanford大学的Ian Buck等人发表了Brook for GPUs[1],第一次系统性地证明GPU可以高效执行通用计算。Ian Buck随后加入NVIDIA,主导开发了CUDA(Compute Unified Device Architecture)——2007年2月正式发布。CUDA让任何程序员都可以用类似C/C++的语言编写GPU程序,不再需要伪装成图形操作。

CUDA的重要性怎么强调都不为过。 它不是一块硬件,但可能是AI时代最重要的软件基础设施。后来NVIDIA在AI芯片市场占据超过80%的份额,CUDA建立的软件生态是最深的护城河——比任何一块芯片都更难被替代。

一段亲历者的记忆:CUDA 1.0的蛮荒时代

我(作者)在2008年左右就接触了第一代CUDA产品——用的是8800 Ultra(基于2006年发布的G80 Tesla架构,NVIDIA第一款统一着色器GPU)和CUDA 1.0工具链。那时候我们已经看中了GPU通用计算的巨大潜力,在本科期间就用CUDA做过人脸识别算法、信号处理算法、遗传算法的加速,性能提升效果都非常好——有些任务比CPU快了几十倍。

但那时候的CUDA开发体验极其痛苦。一方面,并行算法本身就不好写——把串行算法改成能在几百个核心上同时跑的并行版本,需要彻底重新设计计算流程。另一方面,CUDA的软硬件工具链极其不成熟:debugger几乎不存在,性能profiler非常原始,内存对齐、线程同步、bank conflict这些问题全靠经验排查。改一行代码性能可能差十倍,但你根本定位不了问题出在哪。

更关键的是,2008-2010年间深度学习还没有爆发,我们拿着CUDA的高算力找不到真正大规模的应用场景。后来移动互联网来了,Android来了,那才是当时最大的浪潮,我们也就逐渐从CUDA转向了Android开发。

后来我和本科期间的导师交流,他说如果你能再坚持两年左右对CUDA的投入,AlexNet就来了(2012年),深度学习就爆发了,CUDA的最大应用场景也就来了——我们本来可能成为第一代用CUDA加速深度学习和神经网络的团队之一。因为时至今日,开发和调优CUDA算子仍然是各个AI公司最头疼的事情,没有之一。但历史没有那么多如果——这段经历让我切身体会到:技术的价值不取决于它本身有多先进,而取决于它能否在正确的时间遇上正确的应用场景。

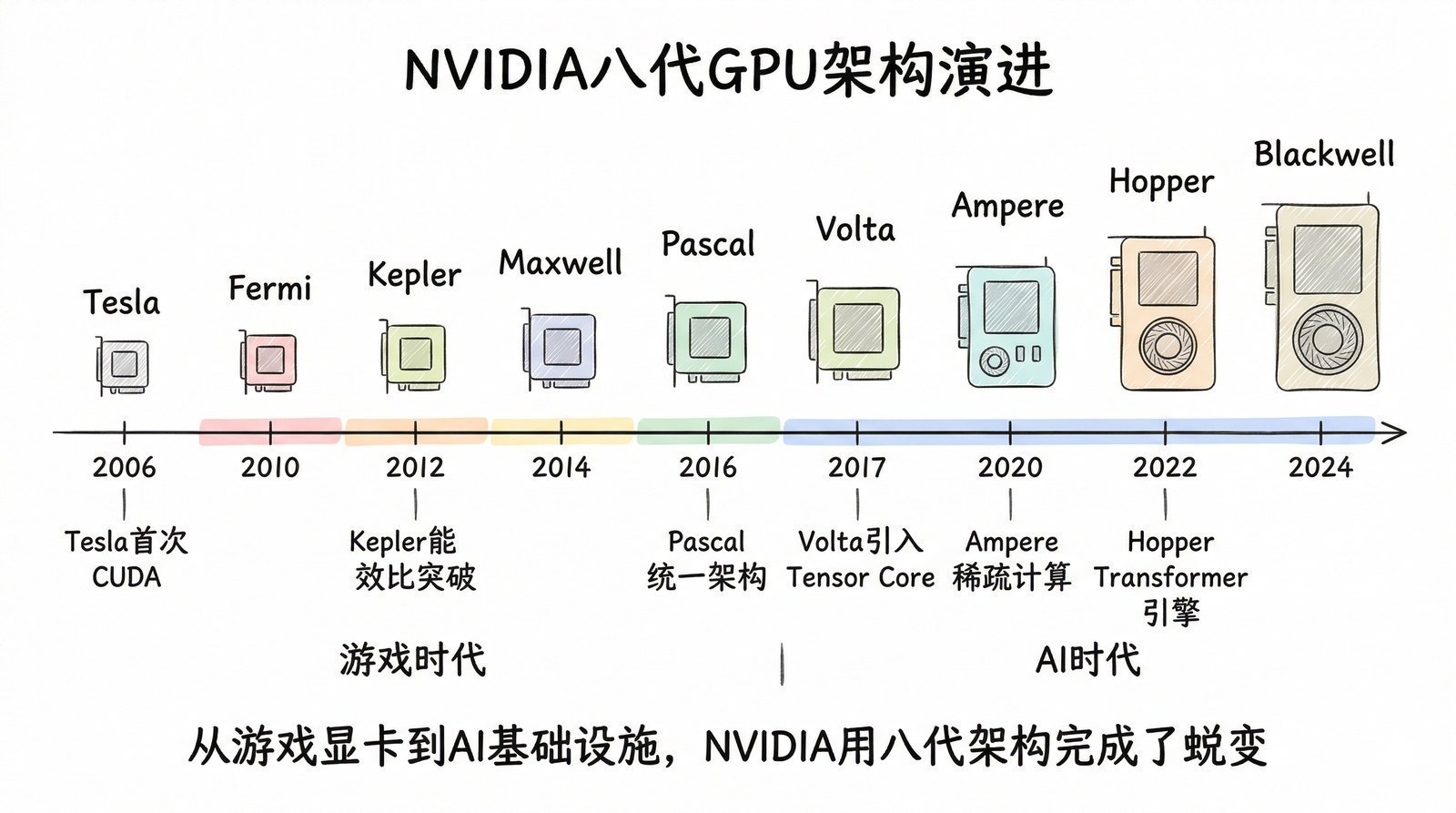

NVIDIA GPU进化史:八代架构,从游戏到AI的蜕变

早期探索(2006-2012)

2006年:Tesla架构(G80/GeForce 8800)——第一代CUDA GPU

2006年11月,NVIDIA发布了GeForce 8800 GTX,基于全新的Tesla架构(以发明家尼古拉·特斯拉命名)。G80是NVIDIA第一款统一着色器架构——把之前分开的顶点处理器和像素处理器合并成128个统一的流处理器(Stream Processor),既能渲染图形也能做通用计算。G80拥有约6.81亿个晶体管,是当时最大的商用GPU芯片。搭配2007年发布的CUDA 1.0,G80成为第一款真正可以编程做通用并行计算的GPU。

2010年:Fermi架构——GPU通用计算走向成熟

Fermi架构(GTX 480/580)是GPU从"能做通用计算"到"好用的通用计算平台"的关键一步。它引入了L1/L2缓存层次结构、首次支持ECC纠错内存(让GPU可以用于科学计算等对精度要求高的场景)、支持完整的C++编程。AlexNet用的GTX 580正是Fermi架构——两块GTX 580、总共3GB显存,训练了6天,改变了AI的历史。

深度学习时代(2012-2020)

2012年:Kepler架构(K80)——学术界的主力,24GB显存(双GPU),训练了Word2Vec[第二章]、VGGNet、ResNet[第一章]等经典模型。但K80没有任何AI专用硬件,训练深度网络纯靠通用浮点运算的暴力堆叠。

2016年:Pascal架构(P100)——第一款明确面向深度学习优化的GPU。引入FP16半精度浮点支持(训练神经网络不需要32位高精度,16位就够了,速度翻倍),搭载HBM2高带宽内存(16GB,带宽732GB/s)。P100是GNMT[第二章]训练的主力硬件。

2017年:Volta架构(V100)——分水岭

V100首次引入Tensor Core——专门为矩阵乘法设计的计算单元。普通CUDA核心一次做一个浮点乘法,一个Tensor Core一次做一个4×4的FP16矩阵乘法并用FP32累加,相当于64次乘加运算。V100有640个Tensor Core,混合精度深度学习算力达到约125 TFLOPS——成为第一款突破100 TFLOPS深度学习性能的GPU。

V100是Transformer(第四章)诞生时的主力硬件——自注意力的大规模矩阵乘法恰好是Tensor Core最擅长的运算。技术创新和硬件进化在这里完美同步了。

2020年:Ampere架构(A100)——第三代Tensor Core,引入TF32/BF16格式、结构化稀疏(自动跳过零值计算,有效算力翻倍)、MIG分区(一块A100可划分为7个独立GPU实例)。AI算力312 TFLOPS。虽然GPT-3(2020年)是在10,000块V100上训练的,但A100发布后迅速成为大模型训练的标配——此后的GPT-3.5、BLOOM、LLaMA等模型都以A100为主力。

大模型时代(2022-2025)

2022年:Hopper架构(H100)——针对Transformer做了深度优化。Transformer Engine自动在FP8/FP16精度间切换:大部分计算用低精度FP8够了,关键步骤切到FP16。训练速度比A100快约4.5倍。FP16算力约990 TFLOPS。2023年全球"一卡难求"的主角。

2024年:Blackwell架构(B200)——双芯片封装设计,192GB HBM3e(带宽8TB/s),FP16算力约2250 TFLOPS,首次支持FP4。GB200 NVL72机柜系统72块GPU通过第五代NVLink互连,推理性能宣称是H100的30倍。

不只是芯片:NVLink与多卡互联的进化

单块GPU的算力提升只是故事的一半。大模型训练需要几千块GPU协同工作,GPU之间的通信速度往往比GPU本身的计算速度更关键——如果数据在GPU之间搬运的速度跟不上计算速度,再快的芯片也只能在等待中空转。NVIDIA很早就意识到了这一点,从2016年起同步推进了一条平行的技术线:GPU间高速互连。

NVLink 1.0(2016年,Pascal P100)——NVIDIA自研的GPU-to-GPU高速链路,双向带宽160GB/s,是当时PCIe 3.0(双向约32GB/s)的5倍。这是NVIDIA第一次绕开通用的PCIe总线,为GPU之间建立"专线高速公路"。NVLink让同一台服务器内的多块GPU可以高效共享数据,是后来所有多卡并行训练的基础。

NVLink 2.0(2017年,Volta V100)——带宽提升到300GB/s,同时支持GPU和CPU之间的高速连接。8块V100通过NVLink组成的DGX-1成为当时最强的AI训练节点。

NVLink 3.0(2020年,Ampere A100)+ NVSwitch——NVLink带宽提升到600GB/s。更重要的是引入了NVSwitch芯片——一种专用的GPU交换芯片,让8块A100可以实现全对全(all-to-all)互连,任意两块GPU之间都有600GB/s的直连带宽。在此之前,8块GPU的NVLink连接是"环形"或"网格"拓扑,不是所有GPU之间都能直连。NVSwitch让GPU集群在逻辑上更像一块"超级GPU"。

NVLink 4.0(2022年,Hopper H100)——单GPU带宽提升到900GB/s。通过NVSwitch,最多256块H100可以在一个"SuperPOD"中实现高速互联。这个规模已经足够训练百亿参数级别的模型。

NVLink 5.0 + NVL72(2024年,Blackwell B200)——这是最激进的一步。72块B200 GPU通过第五代NVLink和NVSwitch连接在一个机柜内,形成一个巨大的统一计算节点——GB200 NVL72。72块GPU之间的总互联带宽达到130TB/s,几乎可以当作一块拥有13.8TB显存的"超级GPU"来使用。这种机柜级的一体化设计,让模型不需要跨节点通信就能利用72块GPU的全部算力——而跨节点通信恰恰是大模型训练中最大的效率损耗点。

跨节点互联:InfiniBand与以太网——NVLink解决的是"同一台服务器内"GPU之间的通信,但训练万卡级集群还需要"服务器与服务器之间"的高速网络。这里的主力是InfiniBand——一种专为高性能计算设计的网络协议,单端口带宽从2020年的200Gb/s发展到2024年的400Gb/s(NDR)和800Gb/s(XDR)。NVIDIA在2019年以69亿美元收购了InfiniBand的主要供应商Mellanox Technologies——这笔收购让NVIDIA同时掌控了"计算"(GPU)和"通信"(网络),成为AI基础设施的全栈供应商。

这条互联技术线的进化速度丝毫不逊于芯片本身——从2016年NVLink 1.0的160GB/s到2024年NVL72的130TB/s总带宽,八年间提升了约800倍。芯片决定了每块GPU能算多快,互联决定了一万块GPU能不能真的像一块GPU一样协同工作。 大模型训练的瓶颈,往往不在计算而在通信。NVIDIA之所以能在大模型时代独占鳌头,不仅因为它有最快的芯片,更因为它同时拥有最快的互联——从NVLink到NVSwitch到InfiniBand,构建了一个从芯片到机柜到数据中心的完整算力系统。

从2006年的G80到2024年的B200+NVL72,这不仅是十八年间单块GPU算力提升数百倍的故事,更是从"一块孤立的芯片"进化到"万卡协同的超级计算机"的系统工程故事。

不只是芯片:NVIDIA的互连进化同样关键

单块GPU的算力提升只是故事的一半。大模型训练需要成百上千块GPU协同工作,GPU之间的通信速度往往比单GPU性能更能决定训练效率。如果GPU之间交换数据的速度跟不上计算速度,大量时间就浪费在"等待通信"上——这就是所谓的"通信墙"。NVIDIA在互连技术上的持续投入,和芯片本身的进化同样重要。

NVLink:GPU之间的"高速公路"。 传统的PCIe总线带宽有限(PCIe 3.0约32GB/s),成为多GPU训练的瓶颈。2016年NVIDIA随P100推出了第一代NVLink,GPU间直连带宽达到160GB/s,是PCIe的5倍。此后每代NVLink都在翻倍:V100的NVLink 2.0达到300GB/s,A100的NVLink 3.0达到600GB/s,H100的NVLink 4.0达到900GB/s。到Blackwell的第五代NVLink,单GPU双向带宽达到1.8TB/s。NVLink让同一台服务器内的8块GPU可以像"一块大GPU"一样高效协作。

NVSwitch:从8卡到更大规模的桥梁。 NVLink解决了单台服务器内8块GPU的互连,但大模型训练需要跨服务器。NVIDIA在2018年推出NVSwitch芯片,作为GPU之间的"交换机",让一台DGX服务器内8块GPU实现全对全(all-to-all)的满速通信。H100时代的NVSwitch升级到第三代,支持在一个机柜内连接更多GPU。到了Blackwell的NVL72架构,NVSwitch更进一步——72块GPU通过NVSwitch组成一个巨大的统一内存域,所有GPU可以直接访问彼此的显存,仿佛72块GPU是一块拥有13.8TB显存的"超级GPU"。

InfiniBand:跨服务器的"神经系统"。 当训练规模扩展到数千块GPU、分布在数百台服务器上时,服务器之间需要更高速的网络。NVIDIA在2020年收购了InfiniBand网络的领导者Mellanox,获得了ConnectX网卡和Quantum交换机系列。InfiniBand的延迟比以太网低一个数量级,带宽从HDR(200Gb/s)到NDR(400Gb/s)再到XDR(800Gb/s)持续翻倍。Meta训练LLaMA 3.1用的万卡集群、OpenAI训练GPT-4用的超级计算机,骨干网络都是InfiniBand。

从"卖芯片"到"卖系统"。 NVIDIA的商业模式也随之进化——从单独卖GPU芯片,到卖DGX整机(8块GPU+NVLink+NVSwitch+网络),再到卖SuperPOD(数百块GPU的完整集群方案),再到GB200 NVL72这样的机柜级系统。芯片、互连、网络、软件栈被打包成一体化解决方案。这种"全栈交付"策略让客户更容易部署,也让NVIDIA的护城河从单一的芯片层延伸到了整个系统层。

算力是一个系统工程,不只是一块芯片。 这个道理在大模型时代被反复验证:一块H100的算力再强,如果GPU之间的通信跟不上,训练效率可能还不如一群通信高效的较弱芯片。NVIDIA之所以能在AI算力市场占据主导地位,不仅因为它的GPU最快,更因为它构建了从芯片到互连到网络到软件的完整体系——而这个体系的每一个环节都在同步进化。

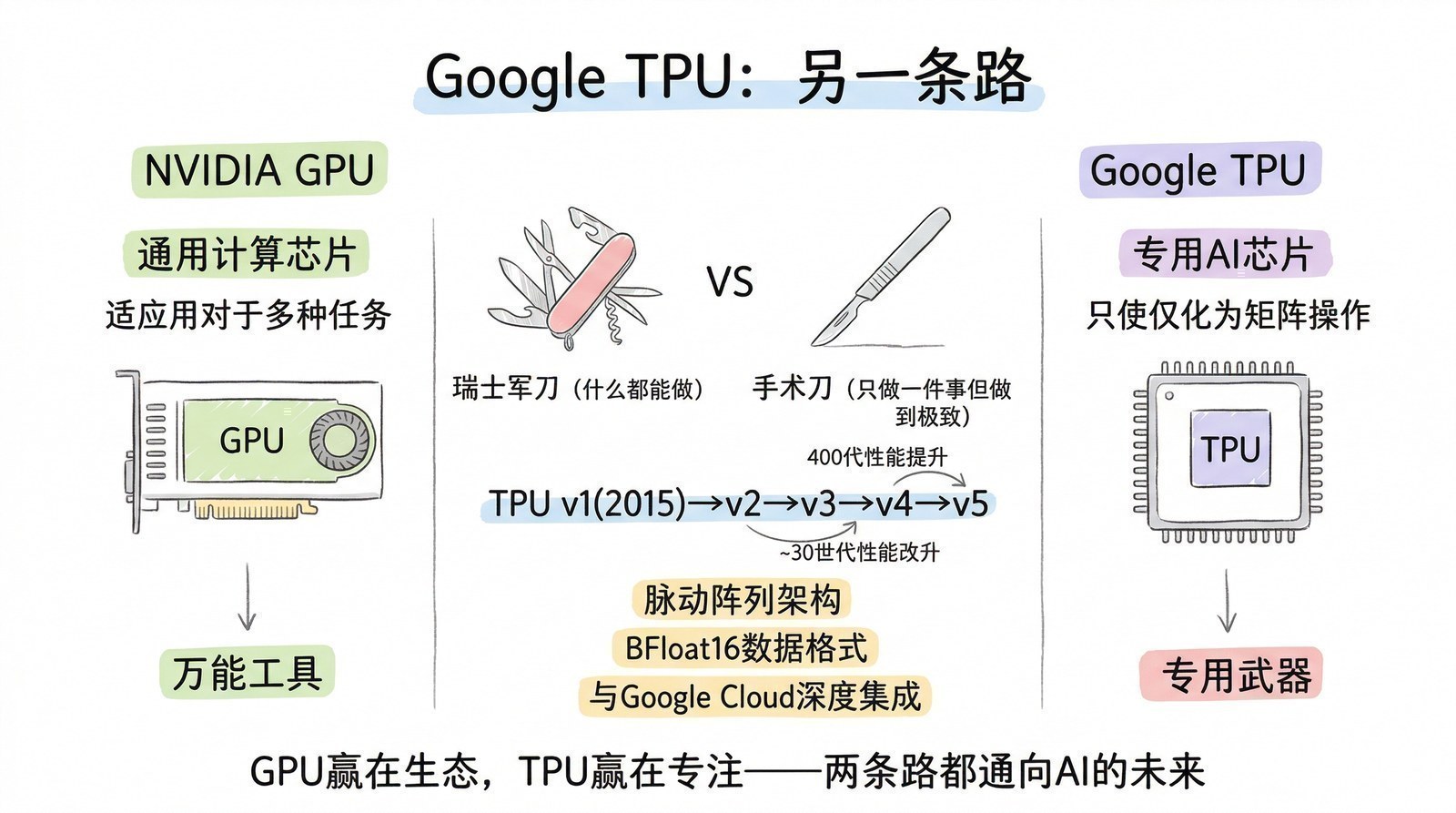

Google TPU:另一条路——从推理到训练,软硬件一体的十年进化

NVIDIA沿"通用GPU→AI专用GPU"路线迭代,Google则从2013年开始走了一条完全不同的路——从零设计一款只做AI计算的芯片。这个决定的背后有一个很现实的驱动力:2013年Google内部评估发现,如果用户每天对着手机用语音搜索说话三分钟,那么用当时的CPU来做语音识别推理,需要把Google整个数据中心的服务器数量翻一倍[6]。这个成本完全不可接受。

TPU v1(2015年内部部署,2017年ISCA论文[6])——推理专用,15个月从设计到上线

TPU v1的核心是一个256×256的8位整数脉动阵列(systolic array),峰值92 TOPS(每秒92万亿次整数运算),功耗仅75W。它只做推理、不做训练,设计极其简约——没有缓存层次、没有复杂的控制逻辑,就是一个巨大的矩阵乘法器。Google论文显示TPU v1比同期CPU快15-30倍,每瓦性能高30-80倍[6]。从设计到部署仅用15个月——Google内部的"快做完就好"原则让它在FPGA验证后迅速转为ASIC量产。

TPU v1解决的是推理成本问题——Google搜索、翻译、照片等服务背后海量的AI推理请求。但它不能训练模型,这限制了它的用途。

TPU v2(2017年)——第一次能训练,BF16格式影响全行业

TPU v2解决的核心问题是让TPU也能做训练。它引入了BF16(Brain Float 16)数据格式——保留了FP32的指数范围但缩减了尾数精度,在几乎不损失训练效果的前提下将算力翻倍[7]。BF16后来被全行业采纳,包括NVIDIA的A100和H100。

更重要的创新是芯片间自定义互连(ICI)。之前的加速器靠以太网或InfiniBand做多芯片通信,延迟高、带宽低。Google为TPU v2设计了专用高速链路,每块TPU直连四个邻居,256块组成2D环面(torus)拓扑的Pod,总算力11 PFLOPS。这种"把多块芯片当一个大芯片用"的思路,为后来的万卡训练奠定了基础。

TPU v3(2018年)——水冷散热,训练了BERT

TPU v3把单芯片算力翻倍至123 TFLOPS BF16,代价是功耗飙升到450W。这迫使Google做出一个大胆的工程决策:从风冷改为水冷。每块TPU v3都需要液冷管路——这在当时的数据中心加速器中几乎没有先例。1024块组成的Pod总算力达到125 PFLOPS。Google用TPU v3训练了BERT(第五章),证明了TPU在Transformer训练上的竞争力[7]。

TPU v4(2021年,2023年ISCA论文[8])——光交换互连,超越A100

TPU v4是Google最大的架构跳跃。每块芯片275 TFLOPS BF16,4096块组成Pod——但最革命性的创新是光路交换互连(OCS):Pod内部的芯片间通信不再走固定的电路拓扑,而是通过光交换机动态重新配置连接。这意味着网络拓扑可以按需调整——训练不同模型时,芯片之间的连接方式可以重新组合,大幅提高了通信效率和容错能力。论文显示TPU v4 Pod(4096块)比同规模的A100集群快5%-87%,同时功耗更低[8]。Google用TPU v4训练了PaLM(5400亿参数)等大模型。

TPU v5p(2023年)及后续——8960块组成Pod,3D环面拓扑,总算力接近4.5 EFLOPS。训练了Gemini系列。2025年Google发布了TPU v7(代号Ironwood),单芯片算力达4614 TFLOPS,继续在效率上追求极致。

TPU的独特价值和局限

Google是全球唯一实现AI全栈自研的公司——从芯片(TPU)到编译器(XLA)到框架(JAX/TensorFlow)到模型(BERT/PaLM/Gemini)到产品(搜索/翻译/Gmail)。这种垂直整合让软件团队可以直接向硬件团队反馈需求——比如发现BF16对训练够用后直接在下一代芯片里做原生支持——形成"模型需求→芯片设计→软件优化→模型提升"的闭环。十年间TPU的峰值性能提升了约100倍,但软硬件协同带来的实际效率提升远超纸面数字。

TPU的最大局限是生态封闭——只能通过Google Cloud使用,不能购买硬件,软件栈和CUDA不兼容。这让大多数AI公司和研究者无法使用TPU,客观上限制了它的产业影响力。

而TPU和中国AI芯片之间,有一条鲜为人知但极其重要的学术渊源。Google TPU v1论文的参考文献中,有6篇来自同一个中国团队——中科院计算所的陈云霁、陈天石兄弟。更耐人寻味的是,与陈氏兄弟合作发表这些论文的法国学者Olivier Temam,后来加入了Google,参与了TPU的后续研发。这意味着:全球最重要的两条AI芯片路线——Google TPU和中国寒武纪——在学术源头上共享着同一批开创性的工作。 这个故事,我们留到本章"中国算力之战"一节详细展开。

光有芯片不够:分布式训练的艺术

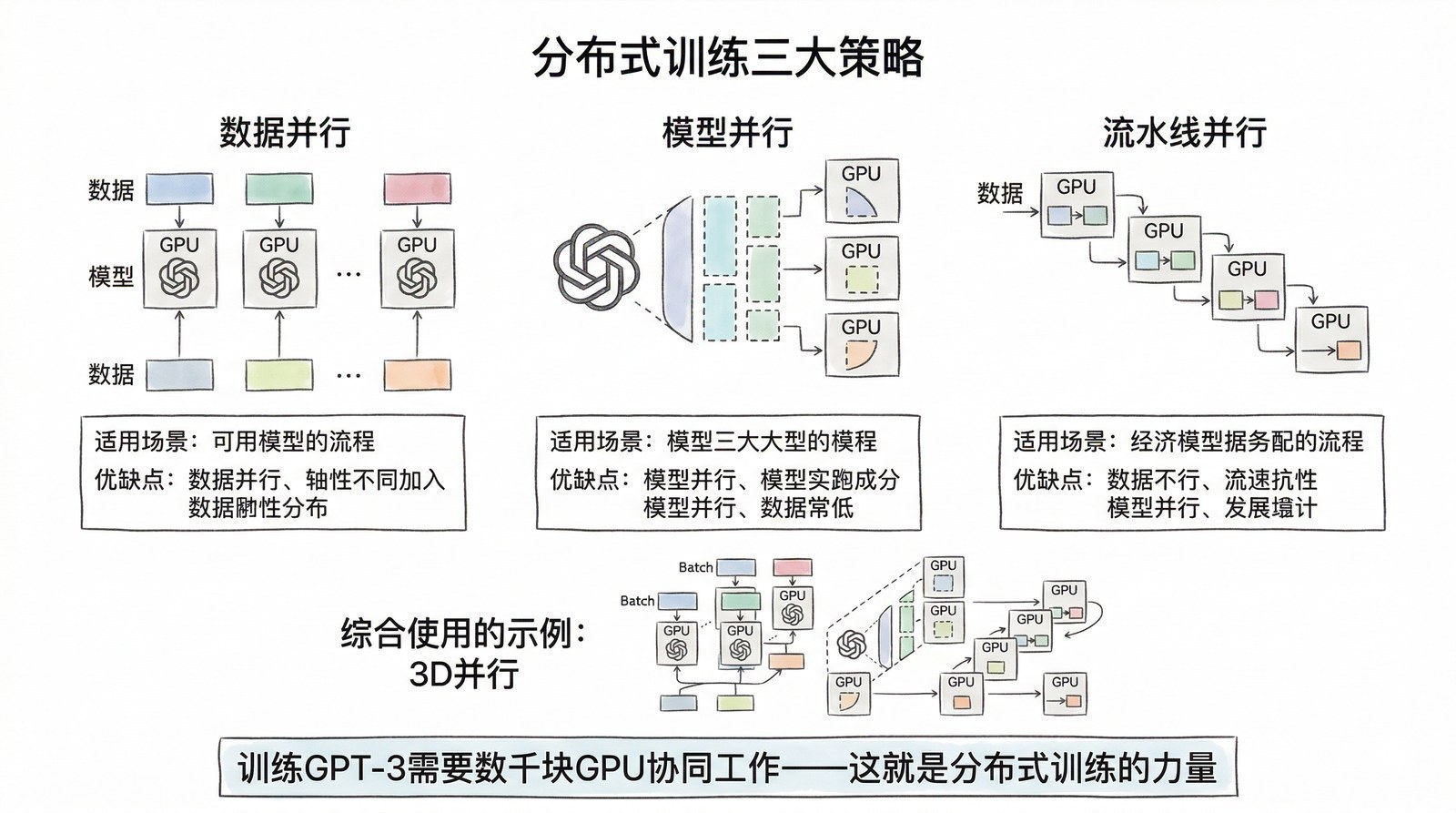

一块GPU再强,也撑不起一个真正的大模型。

GPT-3有1750亿个参数。即使用FP16(每个参数2字节),模型本身就要占350GB显存——远超任何单块GPU。而训练过程中产生的中间数据更加庞大:每个参数需要存储梯度(2字节)、优化器的一阶动量(4字节)和二阶动量(4字节),光是Adam优化器的状态就要占模型大小的6倍以上。一个1750亿参数的模型,训练时的总内存需求可以达到2-3TB。

这意味着训练大模型必须把计算分摊到成百上千块GPU上。但"分给1000块GPU"远不是简单的除以1000——中间有一系列深刻的工程挑战。2014-2019年间,研究者们发明了几种互补的并行策略,每一种都解决了上一种解决不了的问题。

数据并行:最朴素但最有力的起点

最简单的思路:每块GPU放一份完整的模型副本,但各自处理不同的训练数据。每处理完一批数据,所有GPU交换梯度信息,取平均后更新模型——确保所有副本保持同步。

2014年,Google的Jeffrey Dean等人发表了Parameter Server[2],建立了数据并行的标准架构——一组"参数服务器"集中管理模型参数,多个"工人节点"分头计算梯度再发回汇总。这个框架之所以在2014年出现,是因为深度学习模型的规模(几千万到上亿参数)已经超过了单机训练的效率极限,但还没有大到单块GPU装不下——数据并行的前提是每块GPU能装下完整模型。

数据并行的优势是简单、通用、扩展性好——加更多GPU就能处理更多数据,训练更快。但它有一个根本局限:当模型大到一块GPU装不下的时候,就行不通了。2019年GPT-2(15亿参数)还勉强能塞进一块V100(32GB显存),但2020年GPT-3(1750亿参数)无论如何都装不下——模型本身就需要被"切开"。

流水线并行:把模型按层切开

2018年,Google提出GPipe[3],把模型的不同层放在不同GPU上。数据像工厂流水线一样依次经过各个GPU:第一块GPU处理完第一层,结果传给第二块处理第二层,同时第一块开始处理下一批数据的第一层。

GPipe之所以在2018年出现,是因为研究者开始尝试训练几十亿参数级别的模型(如AmoebaNet-B,5.57亿参数),这些模型的层数已经多到需要跨多块GPU存放。GPipe解决了"模型太深、单GPU放不下所有层"的问题。

但流水线并行有一个著名的效率问题:pipeline bubble(流水线气泡)。当第一块GPU在处理最后一批数据时,后面的GPU还在等中间结果——流水线的开头和结尾会有大量GPU处于空闲状态。GPipe通过把每批数据切成更小的micro-batch来缓解这个问题,但无法完全消除。

张量并行:在单层内部切开矩阵

流水线并行解决了"层与层之间"的分配问题。但如果单个层本身就太大呢?一个GPT-3规模模型的单个Transformer层,其中的矩阵乘法操作就可能需要几十GB的显存。

2019年,NVIDIA提出Megatron-LM[4],将单层内的矩阵运算切分到多块GPU上。一个巨大的矩阵乘法被拆成多个小矩阵乘法,分别在不同GPU上执行,结果再拼回来。这种方式打破了"一层必须在一块GPU上"的限制。

Megatron-LM之所以在2019年出现而不是更早,有两个原因:一是V100的NVLink高速互连让GPU之间的数据交换足够快(张量并行需要频繁的GPU间通信,如果通信慢则效率崩溃),二是Transformer的矩阵结构天然适合沿行或列均匀切分。Megatron-LM在NVIDIA DGX SuperPOD上把模型扩展到83亿参数,其方法论被后来几乎所有大模型训练采用。

张量并行的局限是通信开销:切分越细,GPU之间需要交换的数据越多。当扩展到数十块GPU以上时,通信开销会侵蚀计算效率。因此张量并行通常在8-16块GPU的"节点内"使用,跨节点则用其他并行方式。

ZeRO:换一个角度——不切计算,切存储

前面三种方法都在切分"计算"。2019年微软DeepSpeed团队的ZeRO(Zero Redundancy Optimizer)[5]换了一个角度:不切分模型的计算,而是切分模型的存储。

在传统数据并行中,每块GPU都完整存储模型参数、梯度和优化器状态——这是巨大的冗余。如果有1000块GPU,同一份模型就被存了1000份。ZeRO的核心洞见是:这些数据不需要每块GPU都存一份,可以分散存储,需要的时候再临时通信获取。

ZeRO分三个阶段逐步消除冗余:ZeRO-1分散优化器状态(节省约4倍内存),ZeRO-2再分散梯度(节省约8倍),ZeRO-3连模型参数都分散(理论上可线性扩展到任意规模)。代价是增加了通信——但通过精心设计通信调度,与计算重叠,实际性能损失很小。

ZeRO的影响是革命性的:它让研究者可以在相对较少的GPU上训练远超GPU显存的大模型。但它也有边界——当模型规模大到通信量超过计算量时,效率会下降。因此大规模训练通常把ZeRO和其他并行方式组合使用。

"3D并行":今天的标准配方

今天训练千亿参数级模型的标准做法是"3D并行"——数据并行(扩展数据吞吐量)+ 张量并行(切分单层计算,节点内)+ 流水线并行(切分跨层计算,节点间),外加ZeRO的内存优化。这个组合让从GPT-3到GPT-4到DeepSeek-V3的大模型训练成为可能。

每一种并行技术的出现都不是偶然的——它们各自回答了模型规模增长过程中遇到的不同瓶颈问题,而它们的局限又推动了下一种技术的发明。这正是算力领域"需求驱动创新,创新使能更大需求"的典型螺旋。

产品与公司聚光灯

NVIDIA:卖铲子的人赢了淘金热

(1) DGX-1(2016年) — NVIDIA第一台"AI超级计算机",搭载8块P100,AI算力约170 TFLOPS。黄仁勋亲手把第一台交给了OpenAI,机箱上写"To the future of computing"。

(2) 市值破万亿(2023年5月) — 2024年中一度超3万亿美元,短暂成为全球市值最高公司。在淘金热中,最确定赚钱的是卖铲子的人。

(3) H100一卡难求(2023年) — Meta订购35万块,二手价超5万美元。NVIDIA 2024财年营收609亿美元,同比增126%。

Google TPU:十年磨一剑的另一条路

(4) TPU v1的"15个月奇迹"(2015年) — 从设计到部署仅15个月,立刻进入Google搜索、翻译、照片等核心服务。一款仅75W功耗的推理芯片,悄悄支撑着数十亿用户每天的AI请求。

(5) BF16格式的全行业影响 — TPU v2发明的BF16数据格式被NVIDIA(A100起)、AMD、Intel全面采纳,成为AI训练的事实标准。一家公司的芯片设计决策,改变了整个行业的数据表示方式。

寒武纪:用中文拼音命名芯片的中国先驱

(6) DianNao系列横扫顶会(2014-2016) — 陈氏兄弟的DianNao系列在ASPLOS、MICRO、ISCA上连获最佳论文,成为AI芯片领域引用最多的学术系列。合作者Olivier Temam后来加入Google,DianNao的学术思想影响了全球AI芯片方向。

(7) 寒武纪1A进入手机(2017年) — 被华为集成进麒麟970芯片,AI算力第一次进入消费级手机——每秒能识别约2000张图片。

华为昇腾:系统工程的极致

(8) CloudMatrix 384(2024-2025) — 384颗昇腾910C组成全对等超节点,总算力300 PFLOPS。当单芯片性能追不上NVIDIA时,用极致的互连和系统架构来弥补。黄仁勋说过"任何轻视华为的人都极其天真",CloudMatrix就是华为给出的回答。

中国算力之战:三条并行的追赶路线

第一条线:寒武纪——从学术论文到AI芯片的先驱

陈云霁和陈天石兄弟,先后考入中科大少年班,之后都进入中科院计算技术研究所。哥哥是处理器架构专家(参与"龙芯"设计),弟弟是数学出身研究机器学习。两人笑称自己是"全世界唯一用南昌话讨论计算机问题的"。

2010年,兄弟俩提出了一个当时看起来异想天开的想法:专门设计一种芯片来加速神经网络。那时连20万元的科研经费都申请不到,学生们直言是"虚无缥缈的研究"。

但他们坚持了下来。2014年,与法国INRIA的Olivier Temam教授合作发表的《DianNao》[9]获得ASPLOS 2014最佳论文奖——亚洲科研机构首次在体系结构顶会获此殊荣。同年12月续作《DaDianNao》[10]再获MICRO 2014最佳论文——打破该奖自1963年以来由美国垄断的历史。

此后团队连续发表了以中文拼音命名的系列论文,在国际学术界教老外说中文:

- DianNao(电脑,2014)[9]——第一个专用神经网络加速器架构,ASPLOS最佳论文

- DaDianNao(大电脑,2014)[10]——面向大规模神经网络的超级计算机架构,MICRO最佳论文

- PuDianNao(普电脑,2015)[11]——支持多种机器学习算法的通用加速器

- ShiDianNao(视电脑,2015)[12]——面向视觉处理、靠近传感器的加速器

- Cambricon(寒武纪指令集,2016)[13]——第一个神经网络专用指令集架构

- Cambricon-X(2016)[14]——面向稀疏神经网络的加速器

- Cambricon-F(2019)[15]——分形冯·诺依曼架构机器学习计算机

- Cambricon-Q(2020)[16]——高效训练的混合架构

- Cambricon-S(2024)[17]——面向神经场景表示的加速器

这个故事有一条和Google TPU的重要关联: 合作者Olivier Temam教授后来加入了Google。Google 2017年发表的TPU v1论文[6]全文引用了寒武纪团队6篇论文,并专门用一段文字回顾DianNao系列,提到DaDianNao、PuDianNao、ShiDianNao时还特意用英文注释其中文含义("Big computer, general computer, vision computer")——这在学术界是罕见的致敬。中国团队的开创性学术工作,通过人才和思想的流动,深刻影响了全球AI芯片的发展方向。

2016年陈天石创办寒武纪公司。2017年"寒武纪1A"处理器被华为集成进麒麟970手机芯片——AI算力第一次进入消费级手机。2020年科创板上市。此后发布思元系列数据中心芯片,持续追赶。

第二条线:华为昇腾——从达芬奇架构到CloudMatrix 384

华为2018年发布了自研的达芬奇AI计算架构和昇腾910芯片(FP16算力320 TFLOPS),宣告进入AI芯片赛道。达芬奇架构的核心是一个可伸缩的3D Cube计算单元,从端侧到云端使用统一的指令集,打通"训练-推理-端侧"全场景。

芯片禁令后,华为在2023年推出昇腾910B,成为"A100国产替代"的核心选项。多家国内大模型公司(包括华为自己的盘古大模型、百度文心、科大讯飞星火)已在昇腾上完成训练或适配。

CloudMatrix 384超节点是华为2024-2025年最引人注目的系统级突破。核心思路:单芯片性能追不上NVIDIA,那就用架构创新来弥补。 384颗昇腾910C NPU通过自研UB(Unified Bus)统一总线互连,组成逻辑上的"超级服务器"——全对等架构,384颗芯片之间可以直接通信,不需要经过CPU中转。超节点网络交换机使用6812个400G光模块实现高速互联,让几百颗芯片像一颗"超级芯片"一样协同工作。

对比NVIDIA GB200 NVL72(72块GPU):CloudMatrix 384总算力约300 PFLOPS(BF16),互联总带宽和内存总带宽均有显著提升。代价是功耗高数倍——因为用了5倍多的芯片来"堆"算力。华为的逻辑很直接:当单芯片制程受限时,通过极致的互连和软件调度,让大量芯片高效协同。任正非曾提过的"用数学补物理",在CloudMatrix上体现得淋漓尽致。

第三条线:制裁之后的全面突围

2022年10月美国芯片禁令的影响是双重的。短期冲击真实存在——A100/H100被禁,NVIDIA随后推出的"降速版"A800/H800也在2023年10月被封堵。据估计中国科技公司在禁令前紧急囤积了数十万块高端GPU,但库存终会消耗。

但长期来看,禁令意外地加速了中国AI算力的自主化:

芯片设计上,寒武纪思元系列、华为昇腾系列、海光DCU系列、百度昆仑芯片都在快速迭代。系统架构上,华为CloudMatrix 384和字节跳动MegaScale万卡集群展示了中国团队在系统工程上的实力。软件生态上,华为CANN计算框架和MindSpore深度学习框架正在逐步构建国产CUDA替代方案。

最深远的影响可能在算法效率上:算力受限倒逼了效率创新。DeepSeek-V3(第十三章)用远少于OpenAI的算力训练出了接近GPT-4水平的模型——当你拿不到最好的硬件时,就必须让算法跑得更聪明。

这场算力之战远未结束。EUV光刻机和先进制程代工仍被荷兰ASML和台积电主导,中国在制造环节的追赶需要更长时间。但在芯片设计、系统架构和软件生态上,追赶速度正在超出许多人的预期。

这二十年告诉我们什么

规律一:AI的每一次突破,背后都站着一次算力飞跃——但因果关系是双向的。

AlexNet需要GPU,Transformer需要Tensor Core,GPT-3需要万卡V100集群。表面上看是"有了更强的硬件,才有了更强的模型"。但反过来也成立:正是因为AlexNet证明了深度学习的巨大潜力,NVIDIA才下决心在V100中加入Tensor Core;正是因为Transformer让并行计算成为刚需,NVIDIA才在A100中加入TF32和结构化稀疏。模型的需求定义了芯片的方向,芯片的能力又解锁了新的模型可能性。 这是一个协同进化的螺旋,而不是单向的因果链。对从业者的启示是:判断下一代AI的方向,不仅要看模型论文,还要看芯片路线图——因为芯片厂商的设计选择,往往提前两三年预告了AI的发展方向。

规律二:软件生态的壁垒比硬件更深——这可能是AI产业最被低估的事实。

NVIDIA的芯片性能领先固然重要,但CUDA生态才是它真正的护城河。全球几乎所有深度学习框架(PyTorch、TensorFlow、JAX)都是基于CUDA开发的,数百万开发者的代码、经验、调优技巧、第三方库都建立在CUDA之上。AMD的MI300X在硬件性能上已经非常接近H100,价格更有竞争力,但市场份额仍然很小——因为开发者迁移的成本太高了。你不是在换一块芯片,你是在换整个软件栈、重新调优所有代码、重新训练工程团队。这个迁移成本可能比芯片本身的价格差更大。对中国AI芯片的启示同样深刻:华为昇腾面临的最大挑战不是做出一块性能达标的芯片(这已经接近做到了),而是建立一个让开发者愿意迁移过来的软件生态——这需要的不是两三年,而是五到十年的持续投入。

规律三:算力是系统工程,"木桶效应"决定最终效率。

一块H100的算力再强,如果GPU之间的通信速度跟不上(互连瓶颈)、显存装不下模型(内存瓶颈)、服务器散热不够(功耗瓶颈)、训练过程中一块GPU故障就要重启(容错瓶颈),整个系统的效率就会被最短的那块板拖累。NVIDIA的成功不仅在于GPU最快,更在于它构建了从芯片到NVLink到NVSwitch到InfiniBand到DGX到SuperPOD的完整体系。华为CloudMatrix 384的思路也是一样——当单芯片受限时,通过极致的互连和系统架构让384块芯片像一块"超级芯片"一样工作。对于从业者而言,选择AI基础设施时不能只看单卡TFLOPS——互连带宽、内存容量、软件栈成熟度、容错能力同样是关键指标。字节跳动的MegaScale之所以能实现万卡训练,不是因为用了最快的GPU,而是因为在容错和通信调度上做到了极致。

规律四:约束有时候是创新最好的催化剂——但前提是你有足够的底蕴来"被催化"。

芯片禁令催生了华为的全对等互连架构、DeepSeek的高效训练策略、国产软件栈的加速建设。当一条路被堵死时,人们确实会找到另一条路。但这里有一个容易被忽略的前提:华为之所以能在禁令后快速推出昇腾910B和CloudMatrix,是因为它在禁令之前已经有了多年的芯片设计积累和达芬奇架构。DeepSeek之所以能用有限算力训练出接近GPT-4的模型,是因为它的团队在算法效率上有深厚的研究功底。 约束催化创新,但不能凭空创造能力——它只能激发已有底蕴的快速释放。对从业者的启示是:真正的竞争力不在于你能否在顺境中跑得快,而在于你是否在逆境来临之前积累了足够的底蕴来"被催化"。

规律五:AI算力的竞争正在从"芯片竞赛"升级为"体系竞赛"。

2012年AlexNet时代,算力竞争的核心是单块GPU的性能。2020年GPT-3时代,竞争升级到了万卡集群的系统效率。到2025年,竞争已经进一步升级为包含芯片设计、互连网络、分布式软件、数据中心基建、能源供应在内的完整体系。一个前沿大模型的训练可能需要上万块GPU、消耗数百万度电、持续数月——这不再是一个技术问题,而是一个涉及工程、基建、能源、资本的系统问题。NVIDIA卖的不再是一块芯片,而是一个从硬件到软件的完整解决方案。Google建的不再是一个芯片,而是一个从芯片到编译器到框架到模型到产品的垂直体系。华为做的也不再是一块芯片,而是从达芬奇架构到CANN框架到MindSpore生态到CloudMatrix超节点的全链路。未来的AI算力竞争,将是体系与体系的较量,而不是芯片与芯片的比拼。

本章讲了AI算力的第二把钥匙:从G80到V100,GPU并行能力在十一年间提升了数百倍,Tensor Core为矩阵乘法提供了专用加速。与此同时,Parameter Server、GPipe、Megatron-LM和ZeRO让成千上万块GPU可以协同训练一个模型。这些硬件和软件的进步,让"完全基于并行注意力计算"的新架构成为可能。

而第一把钥匙,就是2017年那篇八人合著的论文——他们写道,新架构"完全基于注意力机制","不需要任何循环或卷积"。在8块P100上训练3.5天,就达到当时最好的翻译效果。

他们管这个架构叫Transformer。

本章引用论文

[1] Brook for GPUs: Stream Computing on Graphics Hardware, 2004, Stanford (Buck et al.)

[2] Large Scale Distributed Deep Networks (Parameter Server), 2014, Google (Dean et al.)

[3] GPipe: Efficient Training of Giant Neural Networks using Pipeline Parallelism, 2018, Google (Huang et al.)

[4] Megatron-LM: Training Multi-Billion Parameter Language Models Using Model Parallelism, 2019, NVIDIA (Shoeybi et al.)

[5] ZeRO: Memory Optimizations Toward Training Trillion Parameter Models, 2019, Microsoft (Rajbhandari et al.)

[6] In-Datacenter Performance Analysis of a Tensor Processing Unit (TPU v1), 2017, Google (Jouppi et al.) — ISCA 2017

[7] A Domain-Specific Supercomputer for Training Deep Neural Networks (TPU v2/v3), 2020, Google (Jouppi, Young, Patil, Patterson et al.) — Communications of the ACM

[8] TPU v4: An Optically Reconfigurable Supercomputer for Machine Learning, 2023, Google (Jouppi et al.) — ISCA 2023

[9] DianNao: A Small-Footprint High-Throughput Accelerator for Ubiquitous Machine-Learning, 2014, ICT/INRIA (Chen T., Du, Sun, Wang, Wu, Chen Y., Temam) — ASPLOS 2014 Best Paper

[10] DaDianNao: A Machine-Learning Supercomputer, 2014, ICT/INRIA (Chen Y. et al.) — MICRO 2014 Best Paper

[11] PuDianNao: A Polyvalent Machine Learning Accelerator, 2015, ICT/INRIA (Liu et al.) — ASPLOS 2015

[12] ShiDianNao: Shifting Vision Processing Closer to the Sensor, 2015, ICT/INRIA (Du et al.) — ISCA 2015

[13] Cambricon: An Instruction Set Architecture for Neural Networks, 2016, ICT (Liu et al.) — ISCA 2016

[14] Cambricon-X: An Accelerator for Sparse Neural Networks, 2016, ICT (Zhang et al.) — MICRO 2016

[15] Cambricon-F: Machine Learning Computers with Fractal von Neumann Architecture, 2019, ICT (Song et al.)

[16] Cambricon-Q: A Hybrid Architecture for Efficient Training, 2020, ICT (Zhang et al.)

[17] Cambricon-S: An Accelerator for Neural Scene Representation with Sparse Encoding Table, 2024, ICT

第四章:一统天下——Transformer的诞生

简单的榫卯结构,搭上GPU算力的快车,让AI从手工捏泥娃娃走向了无限搭建的宫殿

八个人,一篇论文,一颗种子

2017年6月12日,一篇论文被上传到arXiv预印本平台。

论文标题只有五个词:Attention Is All You Need[1]——标题取自Beatles的歌"All You Need Is Love"的戏仿。作者是八个人,来自Google Brain和Google Research的七位研究员加上多伦多大学的一位实习生Aidan Gomez。论文标注"Equal contribution. Listing order is random"——八位作者贡献相同,署名顺序随机排列。"Transformer"这个名字是作者之一Jakob Uszkoreit起的,仅仅因为他喜欢这个词的发音。

在2017年,这篇论文只是在机器翻译这个相对小众的领域引起了关注。它证明了一种"只用注意力机制"的新架构可以在翻译任务上超越所有基于RNN的模型,而且训练速度快了一个数量级。这固然令人印象深刻,但在当时看来,也就是机器翻译领域的一次技术迭代——就像之前从统计翻译到神经翻译的升级一样。

谁都没有预料到,这篇论文提出的架构会成为整个AI时代的基石。

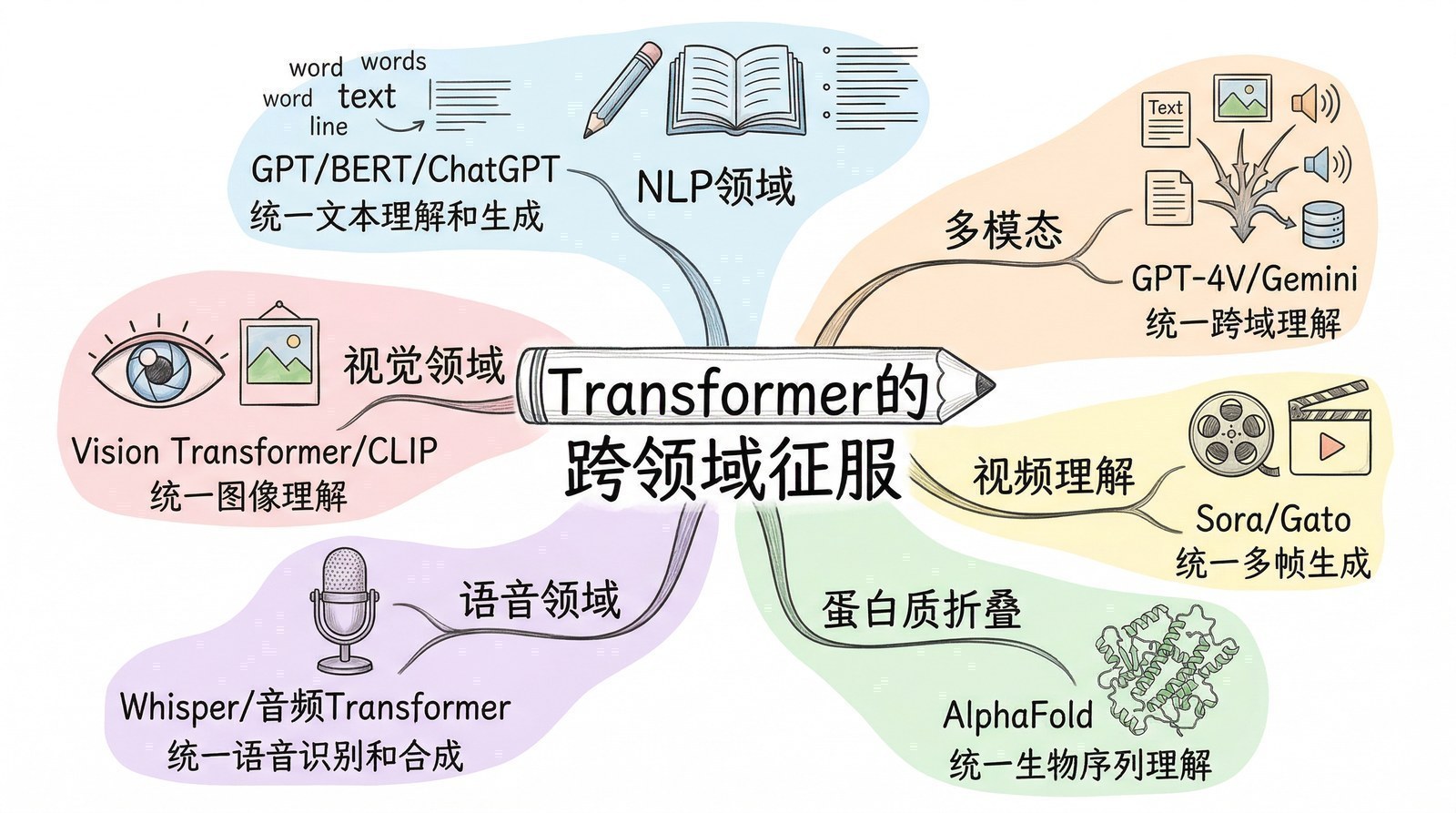

今天你用的ChatGPT、Claude、Gemini、DeepSeek,底层全是Transformer。计算机视觉的ViT、AI绘画的Stable Diffusion、蛋白质预测的AlphaFold 2——也全是Transformer。一个架构统一了几乎所有AI领域,这在技术史上极为罕见。截至2025年,这篇论文的引用量超过17万次,是21世纪被引用最多的论文之一。

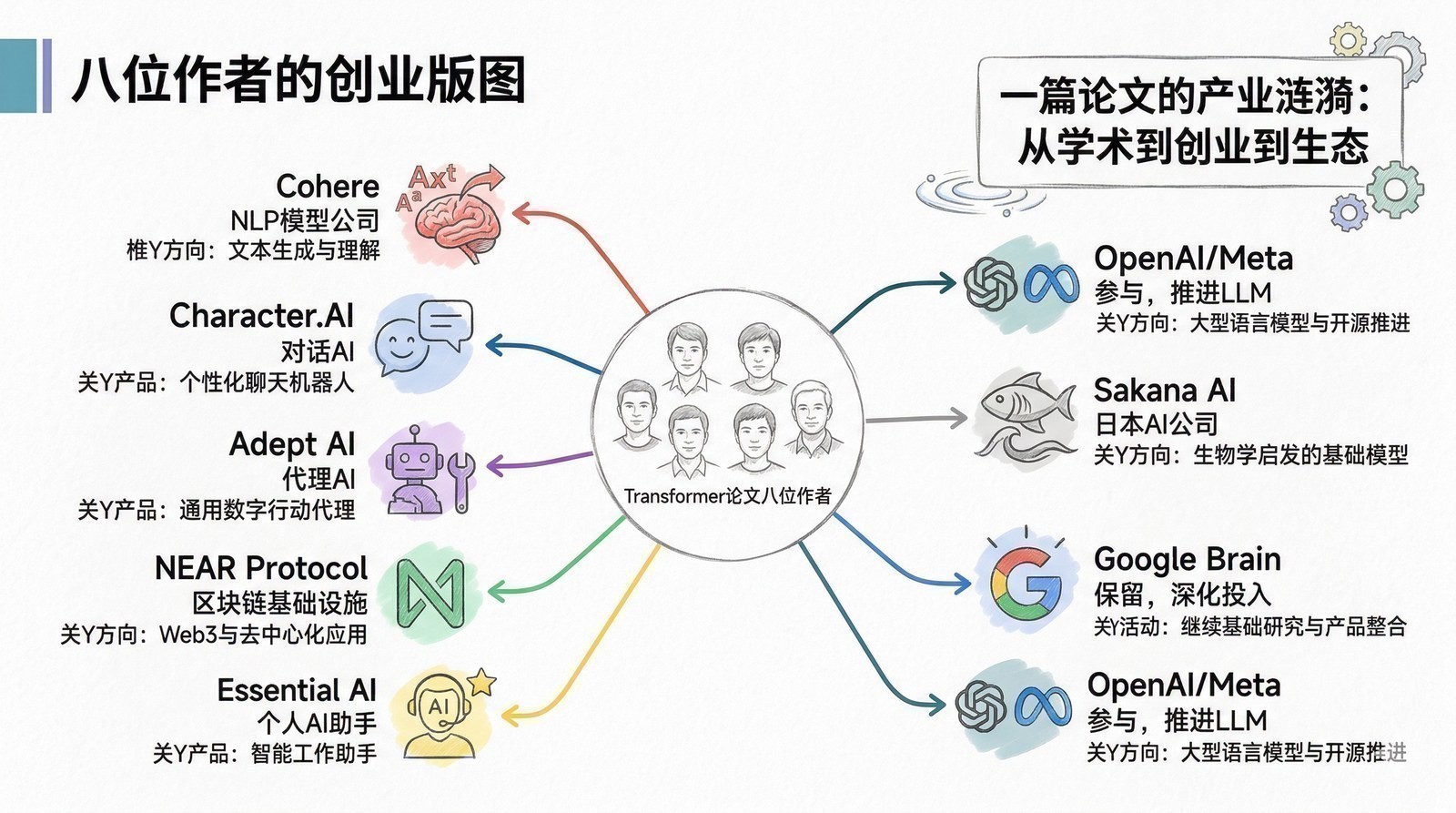

而这八位作者的故事,本身就是一个关于"一粒种子如何长成一片森林"的隐喻。论文发表后的几年里,八位作者陆续离开了Google,像蒲公英的种子一样散落到AI产业的各个角落:Aidan Gomez创办了企业级大模型公司Cohere(估值超55亿美元);Noam Shazeer创办了Character.AI(2024年Google以27亿美元的交易将他请回来主导Gemini开发);Ashish Vaswani和Niki Parmar先后联合创办了Adept AI和Essential AI;Jakob Uszkoreit创办了Inceptive,用Transformer做mRNA药物设计;Llion Jones创办了日本AI实验室Sakana AI;Illia Polosukhin创办了区块链项目NEAR Protocol;而Łukasz Kaiser加入了OpenAI,参与了GPT-4、GPT-5以及推理模型o1/o3的核心研发——他是八人中唯一选择留在技术一线、不走创业路线的人。

Google的实验室孕育了Transformer这项技术,更孕育了这批人才。他们从Google出发,在不同的土壤里长出了不同形态的植物——有的做大模型,有的做AI药物,有的做区块链,有的在OpenAI推动AGI——但所有这些植物的基因都来自同一颗种子。一个实验室对产业最大的贡献,不仅是它产出的论文,更是它培养的人。

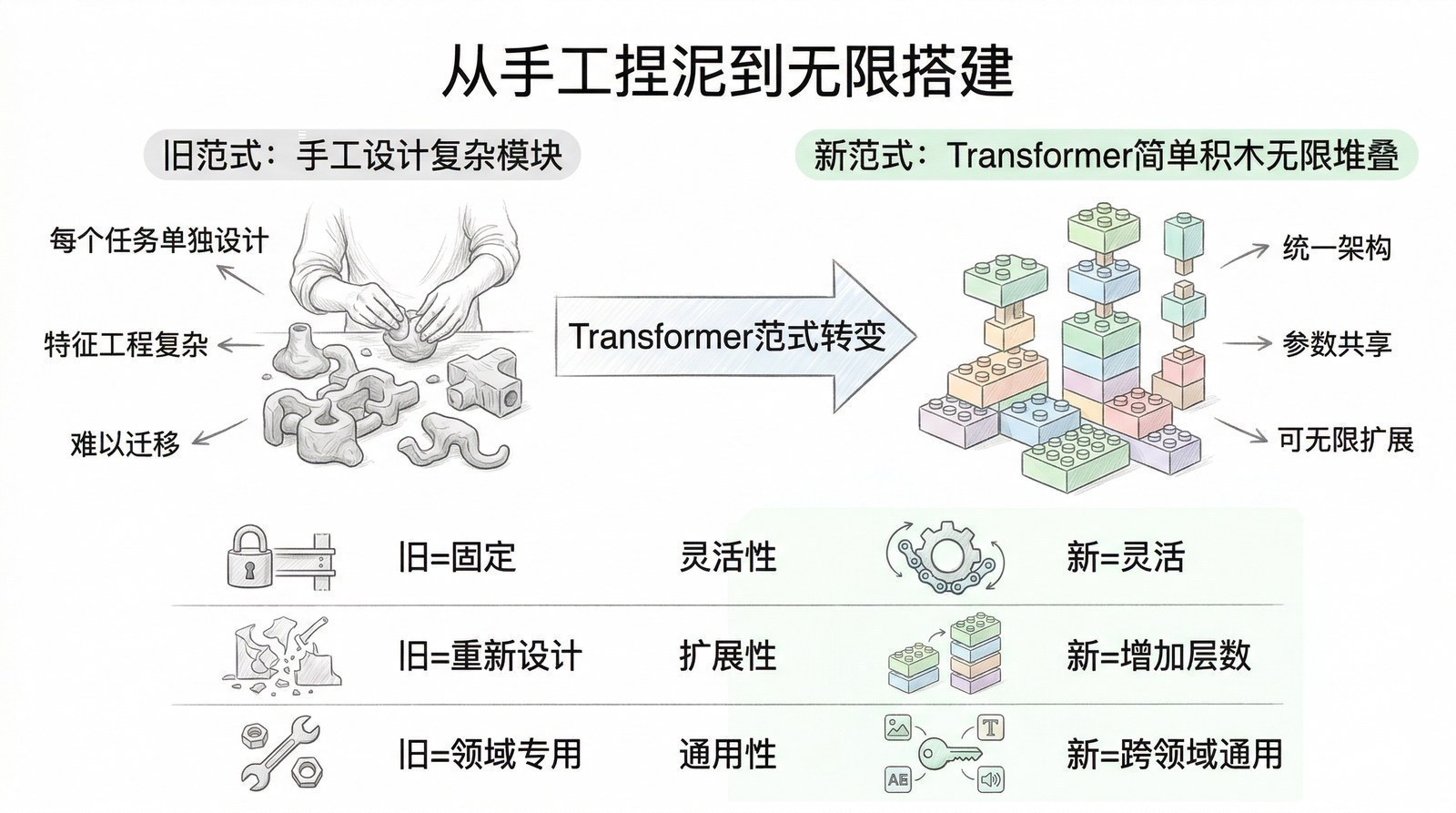

Transformer到底做了什么——一次"点石成金"的简化

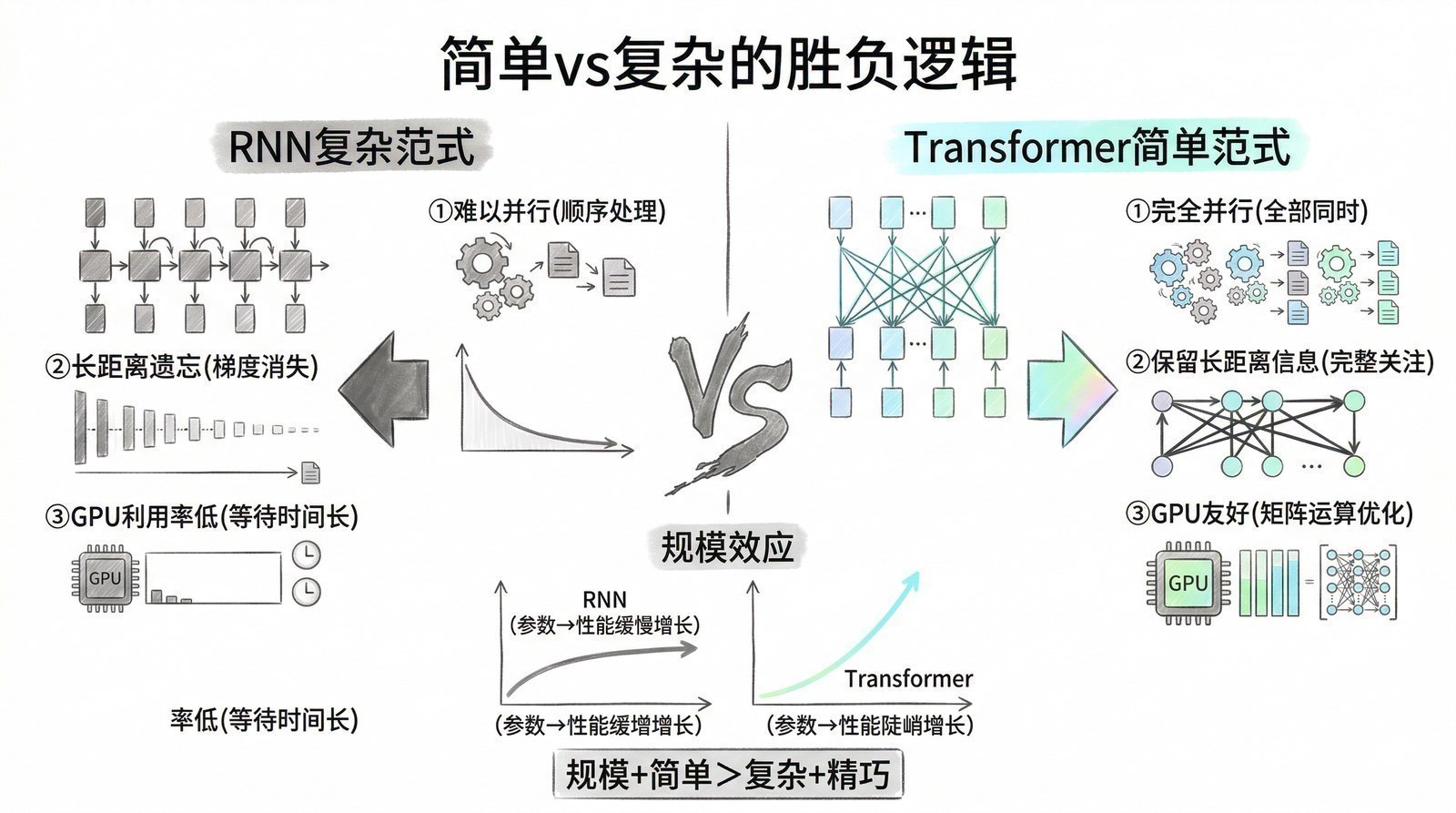

第二章用整整一节讲了从RNN到注意力机制的进化路线:RNN → LSTM/GRU → Seq2Seq → 注意力+RNN → 最终的问题是"为什么不去掉RNN,只留注意力"。Transformer就是这条路线的终点。

但Transformer做的事情,远不止"去掉RNN"那么简单。它的真正革命性在于一种点石成金的简化——丢掉了所有复杂的、串行的、精巧的算法结构,只留下了最简单、最朴素、但最有效的核心机制。

在Transformer之前,NLP领域的研究就像在手工捏泥娃娃——每个研究者精心设计不同形状的网络结构(LSTM的门控、GRU的简化门控、各种注意力变体、highway连接、残差门控……),捏出来千奇百怪的样子,有些在特定任务上效果很好,但换一个任务可能就不灵了。这些精巧的设计很脆弱,泛化能力差,而且因为结构复杂,很难并行化,很难扩展到更大的规模。

Transformer做的事情完全不同——它不再手工捏泥娃娃,而是发明了一套榫卯结构。榫卯本身极其简单朴素(就是注意力+前馈网络+残差连接),但它可以无限搭建——从一张桌子到一座桥到一座宫殿。这种简单但可无限组合的特性,才是Transformer真正的力量所在。

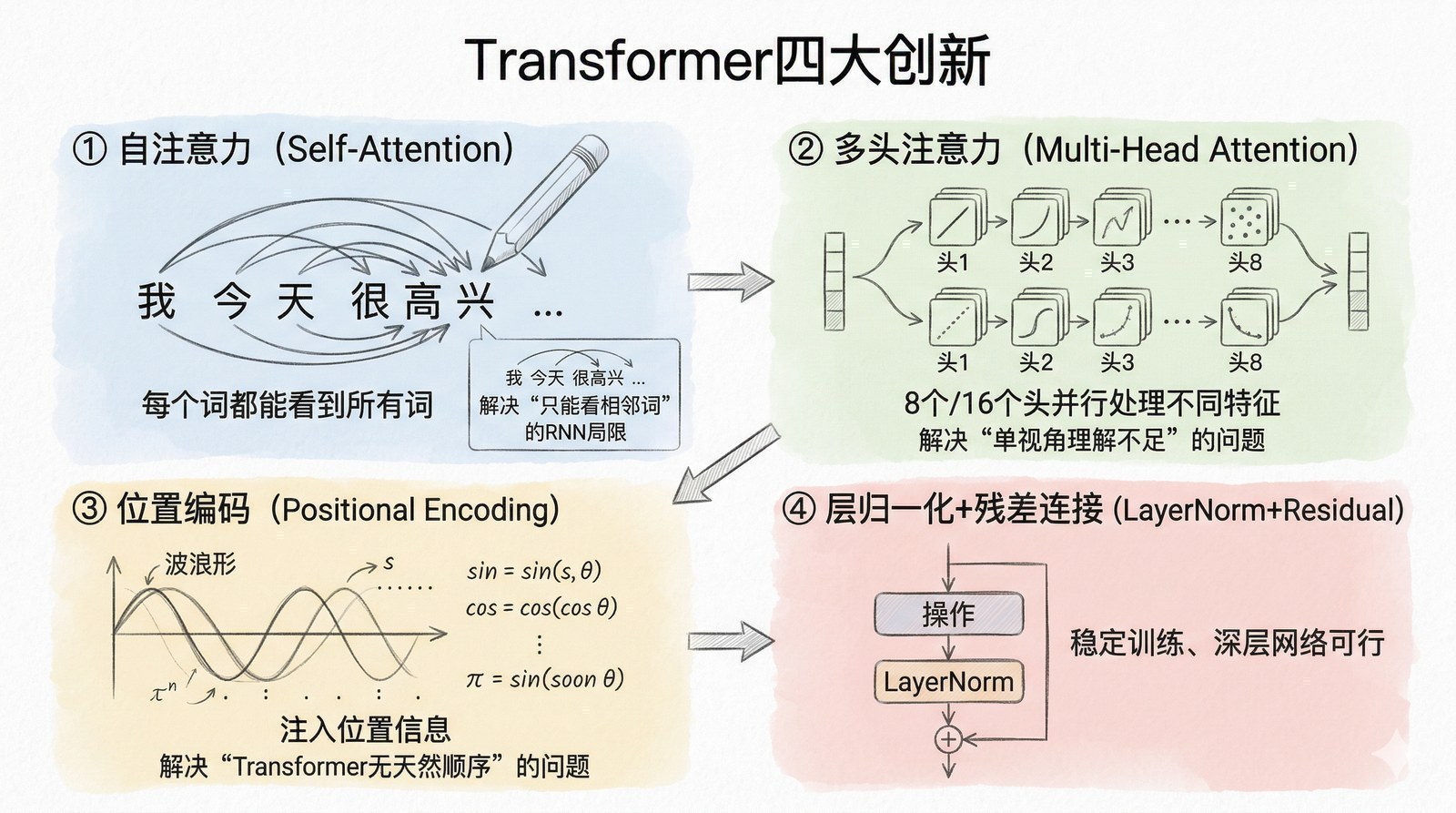

具体来说,Transformer的"榫卯"由四个关键创新组成:

自注意力(Self-Attention):让每个词同时"看到"所有其他词

第二章讲的Bahdanau注意力是"跨注意力"——翻译时解码器去关注编码器的输出。Transformer把这个想法推到了极致:序列中的每个位置都同时关注所有其他位置,这叫"自注意力"。

为什么这个创新如此重要?因为它一次性解决了RNN的三个根本问题。

第一,彻底消除了串行依赖。RNN处理100个词需要100步顺序计算——第2步依赖第1步的结果。自注意力用一次矩阵乘法同时计算所有位置之间的关联——100个词只需要一步并行计算。这让GPU的数千个计算核心可以同时满负荷工作。

第二,任意两个位置之间的信息传递只需一步。在RNN中,第1个词的信息要传到第100个词,需要经过99步传递,每一步都有信息衰减。在自注意力中,第1个词和第100个词直接"对话"——信息零损耗。这彻底解决了长距离依赖问题。

第三,计算结构完全是矩阵乘法。自注意力的核心运算是三个矩阵(Query、Key、Value)的乘法和softmax——这恰好是GPU和Tensor Core(第三章)最擅长的运算。Transformer不是恰好能用GPU加速——它几乎就是为GPU量身定做的架构。

自注意力对后续的影响是全方位的:BERT用它实现了双向上下文理解(第五章),GPT用带掩码的自注意力实现了从左到右的生成(第五章),ViT用它处理图像patch(第八章)。可以说,自注意力是今天所有大模型的核心计算单元——没有它就没有大模型时代。

多头注意力(Multi-Head Attention):从多个角度理解世界

一组注意力权重只能捕捉一种关系。但语言中的关系是多维度的——"他"和"小明"之间有指代关系,"银行"和"钱"之间有语义关系,"去"和"取"之间有时序关系。用一个注意力头来捕捉所有关系太勉强了。

Transformer的方案是多头注意力——同时运行多组独立的注意力计算(原论文8个头),每个头自由学习关注不同类型的关系,最后拼接结果。这就像同时用8种不同的视角来解读同一句话——有的头关注语法结构,有的关注语义相似性,有的关注位置距离——然后综合所有视角得出最终理解。

多头注意力的妙处在于它的自动分工——研究者不需要告诉每个头"你负责关注语法"、"你负责关注语义",这种分工是通过训练自动"涌现"出来的。后来GPT-3等大模型的可视化研究发现,不同的注意力头确实学会了关注不同层次的语言结构——有些头专注于句法,有些关注共指关系,有些捕捉主题相关性。这种"自发分工"是大模型"涌现"能力的早期线索之一。

位置编码(Positional Encoding):一个巧妙的补丁

自注意力有一个副作用:它把所有位置同等对待,丢失了词序——"狗咬人"和"人咬狗"在纯自注意力看来没有区别。但语序对语义至关重要。

RNN天然知道词序(因为它按顺序读),CNN也知道空间位置(因为卷积有固定的感受野)。Transformer把这些都扔掉了,就必须另想办法把位置信息"注入"模型。解决方案是位置编码——给每个位置加上一个独特的向量。原论文用正弦和余弦函数生成这些向量,让模型能学到"第3个词在第1个词后面"这样的相对位置关系。

位置编码看似是个小技术细节,但它的选择对后续发展影响深远。后来的改进版本——旋转位置编码(RoPE)——成为了GPT系列和LLaMA等主流大模型的标配,使模型能够处理远超训练长度的文本。这一切都始于Transformer论文中这个"巧妙的补丁"。

堆叠结构:简单重复,深度带来能力

Transformer的编码器和解码器各由多层相同结构堆叠而成。原论文给出了两个版本:base模型(6层编码器+6层解码器,隐藏维度512,8个注意力头,总参数约6500万)和big模型(6层但隐藏维度翻倍至1024,16个注意力头,总参数约2.13亿)。直观地说:base模型像一栋六层的公寓楼,每层有8个房间;big模型也是六层,但每层有16个更大的房间——楼层数一样,但每层的"容量"大了很多。big模型在翻译质量上显著优于base模型,验证了一个关键直觉:同样的架构,更大的尺寸带来更好的效果。每一层的结构出奇地简单:多头自注意力 → 残差连接+层归一化 → 前馈网络 → 残差连接+层归一化。

这里的关键词是"相同结构堆叠"——不像之前的网络需要为每一层设计不同的结构,Transformer的每一层都是同样的"榫卯"。你想要更强的模型?再叠一层就行,或者把每层做得更宽。从6层到12层到24层到96层——性能持续提升,而架构不需要任何改变。

这就是"榫卯结构"的力量:单个榫卯极其简单,但无限堆叠后可以构建任何规模的建筑。BERT用12层,GPT-2用48层,GPT-3用96层——架构完全一样,只是层数和宽度不同。这种"一套架构打天下"的可扩展性,是Transformer最终统一所有AI领域的核心前提。

为什么简单反而赢了——Transformer的"点石成金"逻辑

把四个创新放在一起看,Transformer做的事情可以概括为一句话:丢掉所有复杂的人工设计,只保留最简单的、可无限扩展的计算结构,然后让数据和算力去"填满"这个结构。

这和之前的范式完全不同。之前的AI研究追求的是"更精巧的算法"——设计更巧妙的门控机制、更精细的注意力变体、更复杂的网络拓扑。每一种精巧设计都像手工打造的瑞士钟表——在特定任务上运行精准,但换个任务就可能失灵,而且很难做大。

Transformer反其道而行之:它的核心计算(矩阵乘法+softmax)简单到连本科生都能实现。但正是这种简单,赋予了它三个前辈架构无法企及的优势:

第一,完美匹配GPU并行计算。 自注意力的核心就是矩阵乘法,而矩阵乘法是GPU最擅长的运算——数千个CUDA核心可以同时处理不同位置之间的注意力计算。2017年V100的Tensor Core让矩阵乘法效率再翻几倍。Transformer不只是"能用GPU",它几乎是"为GPU而生"的架构。 这意味着GPU算力的每一次提升(V100→A100→H100→B200),Transformer都能立刻、直接、完整地受益——不需要任何架构改动。

第二,可以无限扩展。 想要更强?加更多层、加更宽的矩阵、喂更多数据——效果会持续提升。从GPT-1的1.17亿参数到GPT-3的1750亿参数,参数量增加了1500倍,架构没有任何本质变化。这种"线性扩展带来线性收益"(后来被总结为Scaling Law,第六章)在RNN/LSTM时代是不可能的——因为RNN的顺序瓶颈让训练时间随模型增大而超线性增长。

第三,对数据结构不做假设。 CNN假设数据有空间局部性,RNN假设数据有时间顺序。这些假设在特定领域很有效,但也限制了通用性。Transformer不做任何假设——它只是让序列中的每个元素都能关注所有其他元素,让数据自己"告诉"模型什么是重要的。文本是序列,图像可以切成patch变成序列,蛋白质是氨基酸序列,音频是帧序列——只要能变成序列,Transformer就能处理。

三个优势叠加在一起,形成了一个前所未有的正循环:简单的架构 → 完美利用GPU → 可以做得更大 → 更大的模型从更多数据中学到更多知识 → 效果更好 → 吸引更多算力投入 → 模型继续变大 → 效果继续变好…… 这个正循环就是大模型时代的底层引擎。

这里值得特别展开讲一下Richard Sutton在2019年写的《The Bitter Lesson》(苦涩的教训)[2]。Sutton是强化学习领域的奠基人之一,他回顾了AI七十年的历史后得出一个让很多研究者不愿接受的结论:在AI发展的每一个领域——国际象棋、围棋、语音识别、计算机视觉、自然语言处理——最终胜出的方案都不是那个最精巧、最有人类先验知识的方案,而是那个最简单、最通用、但配合了最大规模计算的方案。

这条规律为什么"苦涩"?因为它意味着研究者花几年时间精心设计的巧妙算法,往往会被一个更简单但规模更大的方案轻松击败。LSTM的精巧门控机制被Transformer的简单矩阵乘法替代了。CNN精心设计的局部感受野被ViT的全局注意力替代了。每一次,精巧都输给了规模。

Transformer就是这条规律最极致的体现——一个足够简单的架构,配合足够大的数据和算力,就能在几乎任何领域达到最好的效果。它不需要为每个领域定制不同的结构,只需要把数据喂进去,然后scaling up。这种"暴力但有效"的方式颠覆了之前AI研究追求精巧设计的传统范式。

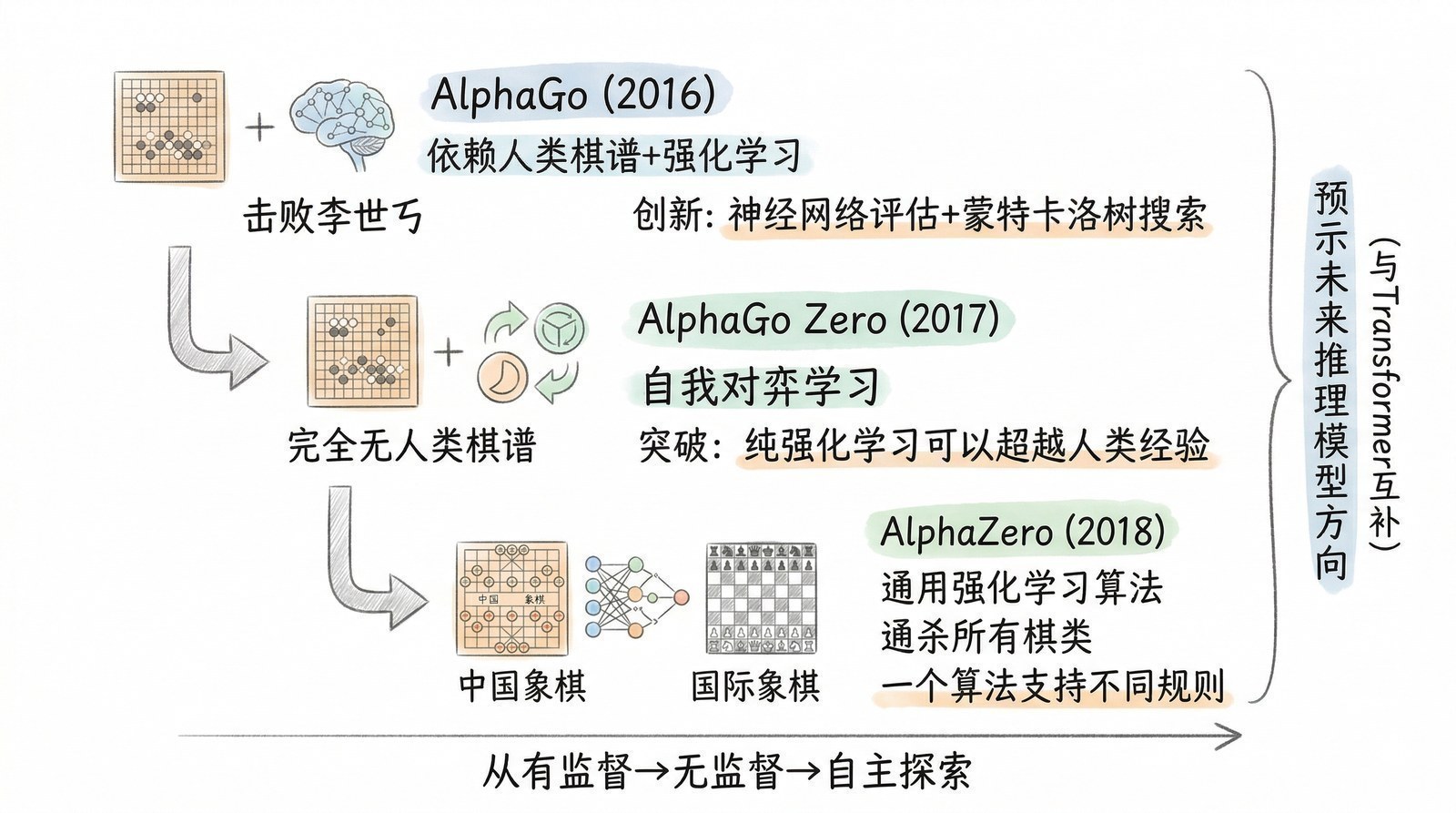

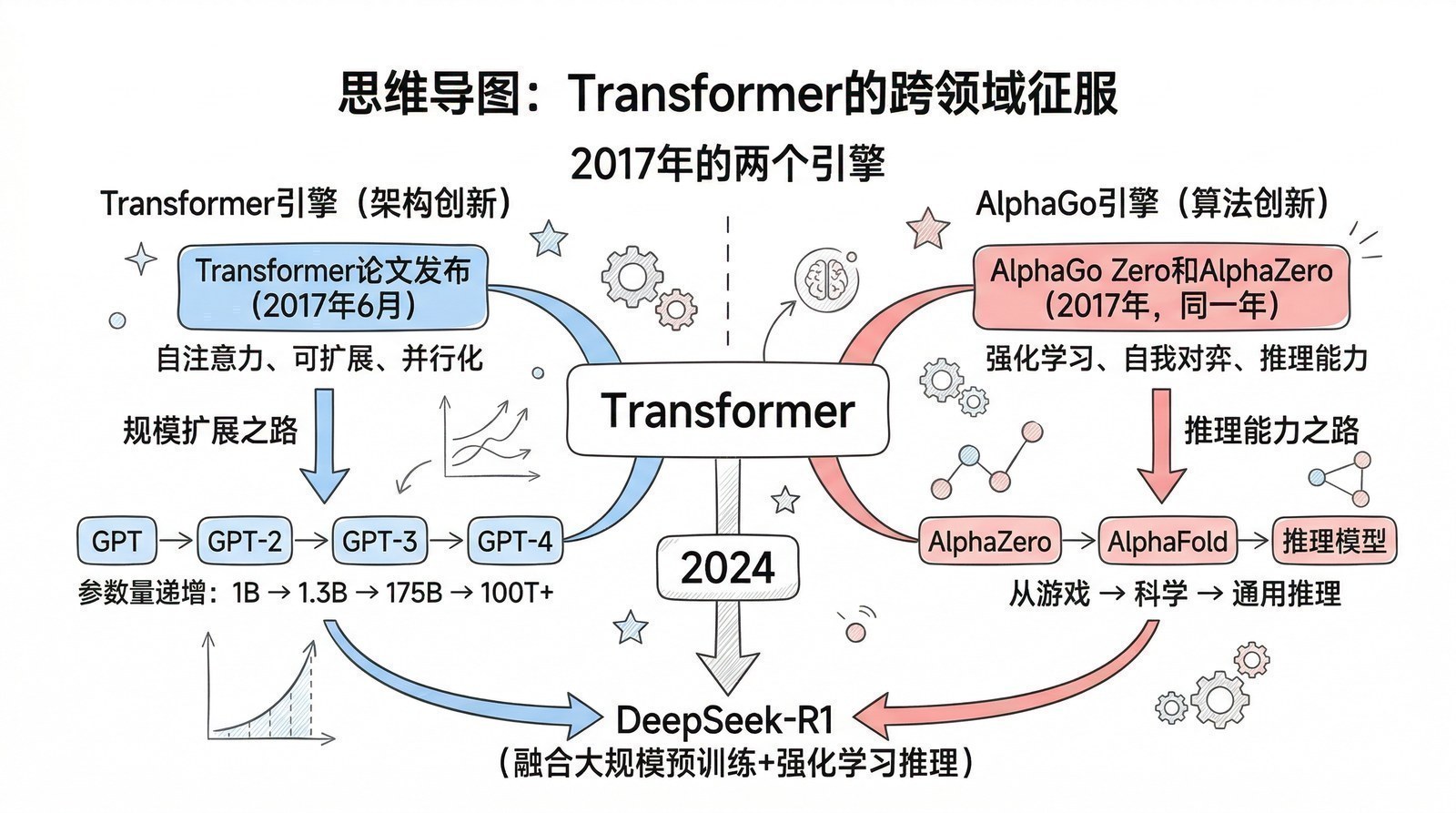

同一年的另一个金矿:AlphaGo与强化学习

2017年不仅属于Transformer。同一年还有一个故事,从完全不同的角度预示了AI的未来——那就是AlphaGo的进化。

从AlphaGo到AlphaGo Zero:人类知识是必需的吗?

2016年3月,DeepMind的AlphaGo以4:1战胜围棋世界冠军李世石[3],全球超过2亿人观看了这场比赛的直播。

AlphaGo的训练分两步:第一步是"模仿学习"——从人类高手的16万盘棋谱中学习如何下棋(监督学习);第二步是"自我提升"——让学会了人类棋路的AlphaGo和自己对弈,通过胜负反馈不断改进(强化学习)。可以这样理解:第一步相当于一个围棋学徒先看了所有大师的棋谱把基本功打好,第二步相当于这个学徒关起门来和自己反复练习,不断发现并纠正自己的弱点。

2017年10月,DeepMind发表了AlphaGo Zero[4]——它做了一件看起来不可思议的事:彻底跳过了第一步。AlphaGo Zero从零开始,没看过任何一盘人类棋谱,只知道围棋的规则(哪里可以落子、什么算赢),然后纯粹通过自我对弈来学习下棋。

结果令人震惊:AlphaGo Zero在短短3天内就超越了战胜李世石的AlphaGo版本,21天后超越了后来以3:0横扫柯洁的AlphaGo Master,40天后成为围棋史上最强的"棋手"——以100:0碾压了所有之前的AlphaGo版本。

从AlphaGo到AlphaGo Zero的进化,区别不在于算法细节,而在于一个根本性的问题:AI需要人类知识作为起点吗?

AlphaGo的回答是"需要"——它从人类棋谱开始学习。AlphaGo Zero的回答是"不需要"——它完全靠自我探索就超越了人类。而且,恰恰因为没有被人类棋谱"污染",AlphaGo Zero发现了很多人类几千年围棋史上从未出现过的下法——它不受人类思维定式的束缚。

这个发现具有里程碑价值,因为它打破了一个根深蒂固的假设:人类专家的知识不是AI学习的天花板,而可能是一种地板——甚至是一种限制。

强化学习:大模型的第二引擎

AlphaGo和AlphaGo Zero背后的核心方法——强化学习(Reinforcement Learning)——和监督学习有什么区别?用一个日常例子来说明。

想象你在教一个孩子下象棋。监督学习的方式是:给他看100万盘大师棋谱,每一步告诉他"这里应该走马""这里应该走车"——孩子通过模仿大师来学习。强化学习的方式完全不同:不给他看任何棋谱,只告诉他规则,然后让他自己下棋。赢了奖励一颗糖(正反馈),输了什么都没有(负反馈)。通过成千上万次试错,孩子自己摸索出什么走法容易赢——而且他摸索出的走法可能和任何大师都不一样。

AlphaGo Zero证明了第二种方式可以超越第一种——因为自我探索不受人类知识的局限,能发现人类专家的盲区。

强化学习的研究历史比深度学习更长——从1950年代的动态规划,到1990年代的Q-learning和TD-learning,到2013年DeepMind用深度Q网络(DQN)在Atari游戏上超越人类,到2016-2017年AlphaGo系列的巅峰。但在大模型出现之前,强化学习主要应用在游戏和机器人控制这些"规则清晰、反馈即时"的领域——因为它需要明确的奖励信号,而现实世界的很多任务(比如"写一篇好文章""回答一个开放性问题")很难给出精确的奖励。

然而,AlphaGo Zero的核心原理——"不依赖人类专家的示范,通过自我探索和试错反馈来学习"——在几年后被证明对大模型同样适用,而且同样有效。

2022年,OpenAI用RLHF(基于人类反馈的强化学习)训练出了ChatGPT(第七章)——让大模型学会"说人话"。但RLHF还依赖大量人类标注的偏好数据——某种意义上还是"看了大师棋谱"。

2024-2025年,真正的突破来了。OpenAI的o1和DeepSeek的R1(第十章)用强化学习让大模型"学会推理"——不是教它一步步怎么推理,而是设定目标(比如"解对这道数学题"),让模型自己探索推理策略,做对了给奖励,做错了给惩罚。DeepSeek-R1更是直接验证了AlphaGo Zero的哲学:不用任何人类编写的思维链样本,只靠纯强化学习,大模型就能"涌现"出推理能力——和AlphaGo Zero不用人类棋谱就学会下棋,逻辑上完全一致。

这条从AlphaGo(2016)→ AlphaGo Zero(2017)→ RLHF/ChatGPT(2022)→ o1/R1(2024-2025)的线索,构成了大模型发展的第二引擎:如果说Transformer + Scaling Law是第一引擎(通过扩大模型规模来积累知识),那么强化学习就是第二引擎(通过自我探索来获得推理和逻辑能力)。第一引擎给了大模型"博学",第二引擎给了大模型"善思"。第十章会详细展开这个故事。

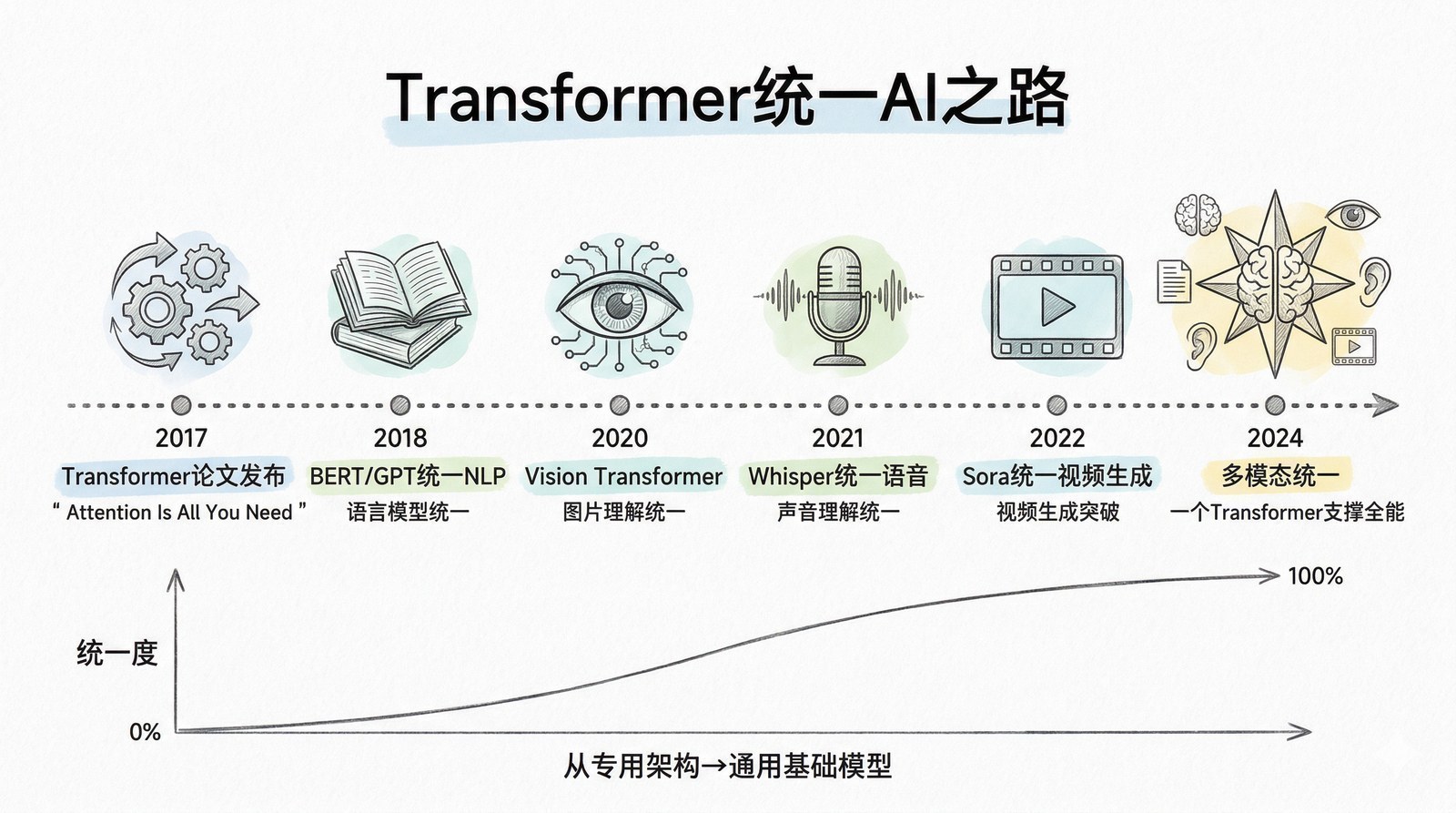

Transformer为什么能"统一一切"

Transformer最初是为翻译设计的。但在随后几年里,它像一种适应力惊人的"物种",迅速入侵并占领了AI的每一个领域。

2018年:统一NLP。 OpenAI的GPT-1用Transformer的解码器做文本生成,Google的BERT用Transformer的编码器做文本理解。两条路线都全面抛弃了RNN。从此Transformer成为NLP的唯一主流架构。

2020年:入侵计算机视觉。 Google的ViT证明:把一张图片切成16×16的小块(patch),排成一个序列,然后用标准的Transformer处理——效果不输甚至超过了统治CV十年的卷积神经网络。Meta的DETR用Transformer做目标检测,TimeSformer用Transformer做视频理解。

2021年:攻入生命科学。 DeepMind的AlphaFold 2用一种改良的Transformer预测蛋白质结构,解决了困扰生物学界五十年的问题。

2021-2024年:打通一切模态。 OpenAI的CLIP用Transformer同时处理图像和文本;DALL-E、Stable Diffusion用Transformer生成图像;Sora用Transformer生成视频。Transformer成了AI世界的"通用语言"——无论什么类型的数据,都可以变成序列,用同一种架构处理。

这种"一统天下"的能力,建立在三个前提之上:

前提一:足够通用的输入格式。 任何数据都可以被表示成"token序列"——文字天然是词的序列;图片可以切成patch变成序列;音频可以按帧切成序列;视频是图片帧的序列;蛋白质是氨基酸的序列;甚至化学分子式都可以变成序列。这种"万物皆可序列"的表示方式,给了Transformer处理一切数据的基础。

前提二:足够大的数据和算力。 ViT的论文明确指出:在小数据集上ViT不如CNN,因为CNN自带的"局部性"假设在数据少时是有用的先验。但当数据量够大时,Transformer反超——它不受假设限制,能学到更丰富的模式。这就是为什么Transformer统一各领域是在2020年之后而非2017年——因为到那时候,数据集和算力(A100级别)才大到让Transformer在各领域都能充分发挥。

前提三:Scaling的可预测性。 Transformer独特的价值在于,它的性能随规模增长的曲线是可预测的(第六章的Scaling Law)。研究者可以根据小模型的表现推断大模型的效果,从而敢于投入千万甚至上亿美元去训练更大的模型。RNN/LSTM从来没有展现出这种可预测的scaling行为——你不知道把LSTM做大10倍是否会有效果。Transformer给了研究者和投资人信心:只要继续投入,效果就会继续提升。 这种信心是大模型军备竞赛的心理基础。

一篇论文与一场围棋赛

2017年的AI历史可以浓缩为两个画面:一篇论文和一场比赛。它们各自代表了大模型时代的一个引擎。

"Attention Is All You Need"——AI世界的"集装箱"

Transformer对AI的意义,可以类比集装箱对全球贸易的意义。

1956年之前,全球货物运输靠的是人工装卸——不同形状、不同尺寸的货物需要不同的搬运方式,效率极低。1956年马尔科姆·麦克莱恩发明了标准化集装箱——一个简单的金属盒子,尺寸统一。它本身没有什么技术含量,但它让装卸流程标准化了:所有货物(无论是电视机还是衣服还是汽车零件)都被塞进同一规格的箱子,用同样的吊车装到同样的船上。这个简单的标准化使全球贸易效率提升了数十倍,催生了今天的全球化供应链。

Transformer就是AI领域的"集装箱"。它本身的设计并没有超出2015-2016年已有知识的范围——自注意力、多头注意力、残差连接、位置编码,每一个组件单独拿出来都不是全新的。它的革命性在于:把这些组件用最简单的方式组合在一起,形成了一个标准化的、可无限扩展的"容器"。 任何类型的数据都可以被塞进这个容器,用同样的训练流程、同样的硬件、同样的扩展方式来处理。

Transformer之前,做NLP的模型和做CV的模型完全不同——不同的架构、不同的训练技巧、不同的工程栈。Transformer之后,一切数据都变成了序列,一切模型都用同样的"注意力+前馈网络+残差连接"来搭建,一切训练都在同样的GPU集群上运行。这种标准化使得AI领域的"规模化生产"成为可能——就像集装箱使全球贸易的规模化成为可能一样。

AlphaGo对李世石——强化学习进入公众视野的那一天

2016年3月9日至15日,首尔四季酒店。这场五番棋对决,让"强化学习"这个原本只存在于学术论文中的概念,第一次以一种全世界都能理解的方式进入了公众视野——通过一场围棋比赛。

绝大多数观众并不知道什么是"策略网络""价值网络""蒙特卡洛树搜索"。但他们看到了一个事实:一个AI程序,通过反复和自己下棋来提升(这就是强化学习的通俗表述),最终打败了人类最强的围棋选手。这个故事简单到每个人都能理解,震撼到每个人都会记住。

第一局,AlphaGo以稳健棋风获胜,观众惊讶但尚能接受。第二局第37手,AlphaGo下出一步让所有围棋专家目瞪口呆的棋——落在一个没有人类棋手会考虑的位置,解说员沉默了十几秒。事后分析证明这是一步极其精妙的战略性布局——这就是强化学习"自我探索"的力量,它发现了人类几千年围棋史从未想到的下法。

第四局,李世石在第78手下出了被后来称为"神之一手"的妙招,让AlphaGo出现了判断失误,李世石赢下了人类唯一的一场胜利。这一局的象征意义远大于技术意义——它代表了人类智慧最后的闪光,也让这场比赛从"人类被碾压"变成了"人类虽败犹荣"的叙事。

这场比赛之后,全球对AI的关注度急剧上升。在中国,"人工智能"成为年度热词,投资机构开始疯狂寻找AI标的,政府把AI写进国家战略。第一章提到的AI四小龙获得天量融资、第二章中李志飞的出门问问获得大众汽车1.8亿美元投资,很大程度上都受益于AlphaGo引发的这波热潮。可以说,AlphaGo用一场围棋比赛完成了AI历史上最成功的一次"公众科普"——它让全世界第一次相信,AI不是科幻,而是现实。

2017年:一切就绪

回头看,2017年是AI历史上的"枢纽之年"——三件事同时就位,为大模型时代的到来准备好了所有条件。

架构就位:Transformer提供了一个足够通用、足够简单、可以无限扩展的"容器"。它不对数据做任何假设,只要把数据变成序列就能处理。

算力就位:同一年NVIDIA发布了V100和Tensor Core(第三章),Transformer的核心计算——矩阵乘法——恰好是Tensor Core最擅长的运算。架构和硬件完美匹配。

理念就位:AlphaGo Zero证明了"规模+自我学习"可以超越人类专家。这个思想预示了后来大模型的两个核心策略——用Scaling扩大知识(第六章),用强化学习提升推理(第十章)。

但一个"空容器"造出来之后,下一个问题是:往里填什么? 怎么训练这个Transformer?让它学什么任务?用什么数据?

2018年,两个团队分别给出了截然不同的答案。一个来自Google,方案叫BERT——让模型做"完形填空",用双向注意力理解文本。另一个来自OpenAI,方案叫GPT——让模型做"续写",从左到右一个词一个词地生成文本。

BERT在当年赢了所有排行榜。但GPT赢了未来。

本章引用论文

[1] Attention Is All You Need (Transformer), 2017, Google (Vaswani, Shazeer, Parmar, Uszkoreit, Jones, Gomez, Kaiser, Polosukhin) — NeurIPS 2017

[2] The Bitter Lesson, 2019, Richard Sutton

[3] Mastering the Game of Go with Deep Neural Networks and Tree Search (AlphaGo), 2016, DeepMind (Silver et al.) — Nature

[4] Mastering the Game of Go Without Human Knowledge (AlphaGo Zero), 2017, DeepMind (Silver et al.) — Nature

[5] Non-local Neural Networks, 2017, FAIR/CMU (Wang, Girshick, Gupta, He)

第五章:两条路线之争——BERT vs GPT,理解还是生成?

同一个Transformer,两种截然不同的信仰,引发了大模型时代最重要的路线之争

一个容器,两种填法

2017年Transformer诞生后(第四章),整个NLP领域面对一个兴奋又迷茫的局面:我们有了一个前所未有的强大架构,但它只是一个"空容器"。怎么用它?用什么数据训练?让它学什么?这些问题的答案将决定AI的走向。

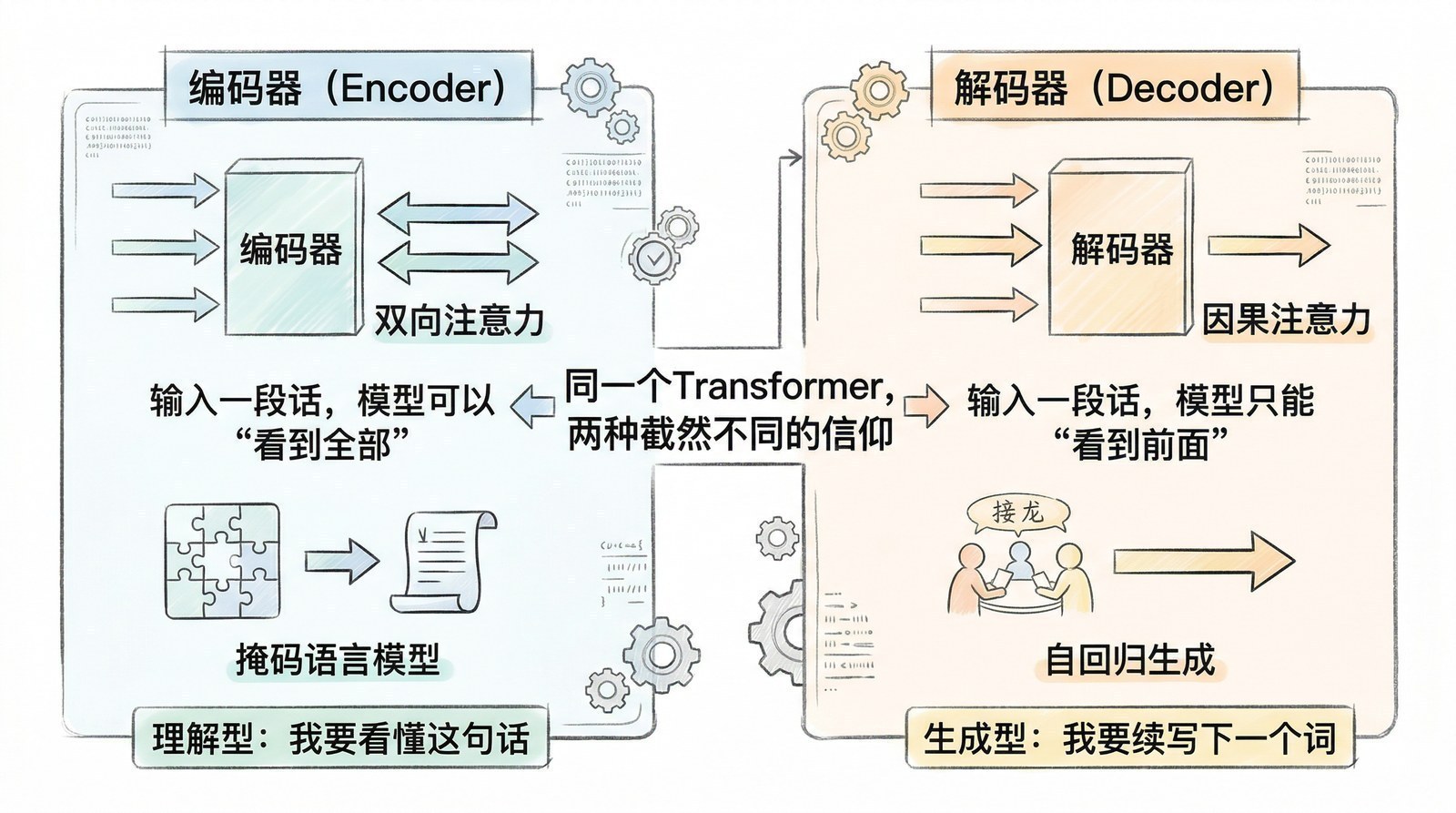

先搞清楚:编码器和解码器有什么不同

Transformer原论文有两个核心组件——编码器和解码器。它们的分工和能力有本质区别。

编码器负责"读"。 它处理每个位置时可以同时看到句子中所有其他位置的信息——既能看前面也能看后面。读"我今天在北京吃了牛肉面"时,处理"北京"时它既能看到"我今天在"也能看到"吃了牛肉面"。这种"全知全能"的双向视野让编码器非常擅长理解——因为它拥有最完整的上下文。

解码器负责"写"。 它生成每个词时只能看到已经生成的词,不能偷看后面还没生成的内容。写到第10个字时,只知道前9个字是什么,不知道第11个字会是什么。这种"只看过去"的限制恰好让解码器天然适合生成文本——因为真实的写作就是一个字一个字往下写的。

一个类比:编码器像阅卷老师——看到完整的答案后理解含义、判断对错。解码器像写作文的学生——一个字一个字往下写,每个字都基于已经写好的部分来决定。

为什么只用解码器就能做"语句续写"?因为续写的本质就是"根据已经写好的内容预测下一个词"——给出"今天天气很",模型预测下一个词是"好"。解码器的"只看过去"限制恰好匹配这个任务。

为什么只用编码器就能做"完形填空"?因为完形填空的本质是"根据上下文推断空缺"——给出"我今天在____吃了牛肉面",模型要综合前后文推断空格是"北京"。编码器的"双向视野"恰好提供了这种能力。

2018年,两个团队各取了Transformer的一半,走向了截然不同的方向:OpenAI只用解码器做续写,Google只用编码器做填空。

"预训练+微调":一个改变NLP范式的思想

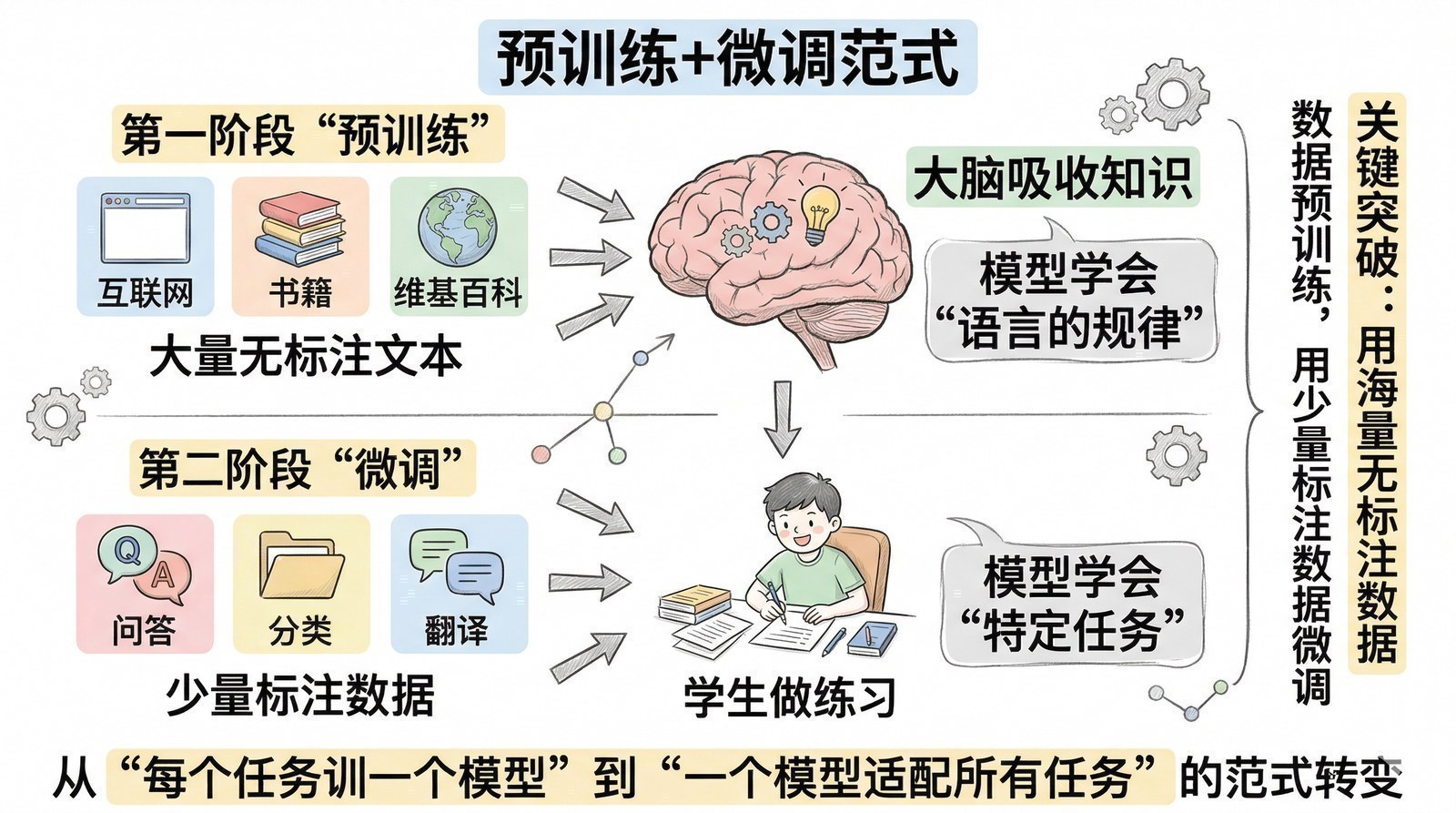

在展开GPT和BERT的具体设计之前,需要先理解它们共同的核心创新——"预训练+微调"范式。这个思想的重要性不亚于Transformer架构本身。

在2018年之前,做一个NLP应用的标准流程是:确定任务(比如情感分析)→ 收集该任务的标注数据(10万条标注了"正面/负面"的评论)→ 设计专用模型架构 → 从零开始训练。这个流程有三个致命问题:标注数据贵(人工标注10万条评论需要大量时间和金钱)、每个任务从头来(做完情感分析想做问答?得重新收数据、重新训练)、小数据训练能力有限(10万条数据训练出的模型不可能具备广泛的语言知识)。

"预训练+微调"反转了这个逻辑,分两步走:

第一步:预训练(Pre-training)。 在海量无标注文本上让模型自己学习语言的通用规律。互联网上有几乎无限的文本,不需要任何人工标注——每一段文本本身就包含了丰富的语法、语义、常识知识。让模型在这些文本上反复做"预测下一个词"或"完形填空",它就会逐渐建立起对语言的深层理解。这个过程像是让一个孩子从小大量阅读——不是为了某次考试,而是为了积累广博的语言底蕴。

第二步:微调(Fine-tuning)。 在预训练好的模型基础上,用少量任务相关的标注数据做最后的专门训练。相当于博览群书的孩子在考前做几套模拟题——因为有了深厚的底蕴,少量训练就能快速适配新任务。

为什么之前没人这么做?三个原因。第一,架构不支持——RNN/LSTM的顺序瓶颈让它们很难在超大规模文本上高效训练(第二章)。第二,算力不够——预训练需要在几十亿词上训练巨大的模型,2017年之前的GPU做不到(第三章)。第三,没有先例——在GPT和BERT之前,没人证明过无标注文本上的预训练能产生如此强大的迁移效果。

GPT和BERT的成功让"预训练+微调"成为NLP的新范式。从此几乎所有NLP工作都不再从零训练,而是在预训练模型基础上微调。这个范式转变也为后来的scaling打下了基础——预训练阶段可以利用无限的无标注数据和不断增长的算力来扩大模型规模,而模型越大、预训练越充分,微调后的效果就越好。这种"规模带来收益"的特性,正是大模型时代的底层逻辑(第六章)。

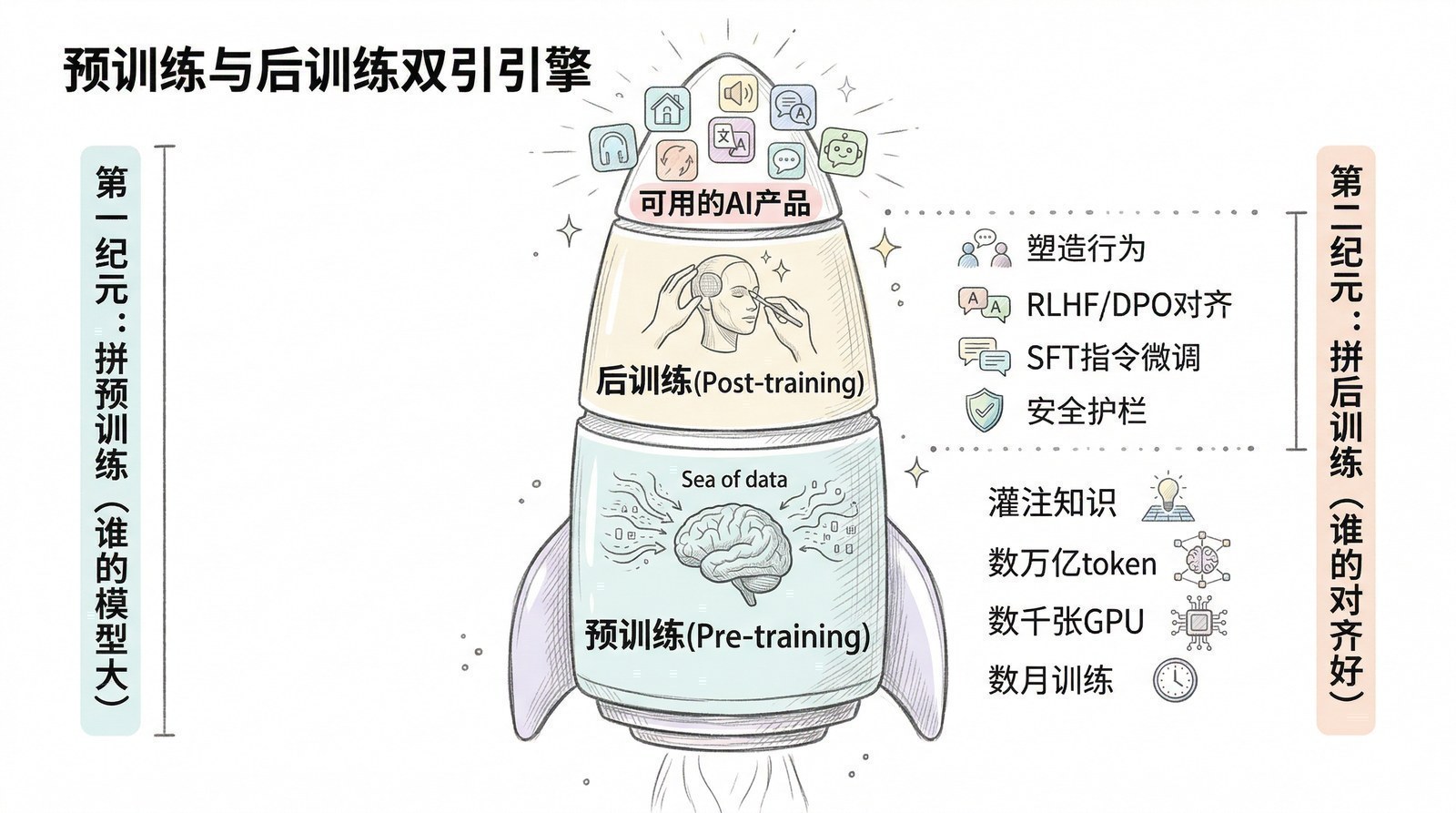

而"如何更好地预训练"和"以微调为代表的后训练(post-training)技术",后来成为了大模型领域研发的两大核心技术轴线——预训练决定了模型的"基础能力上限",后训练决定了模型能否"听话"并适配具体场景。第六章和第七章会分别展开这两条线。

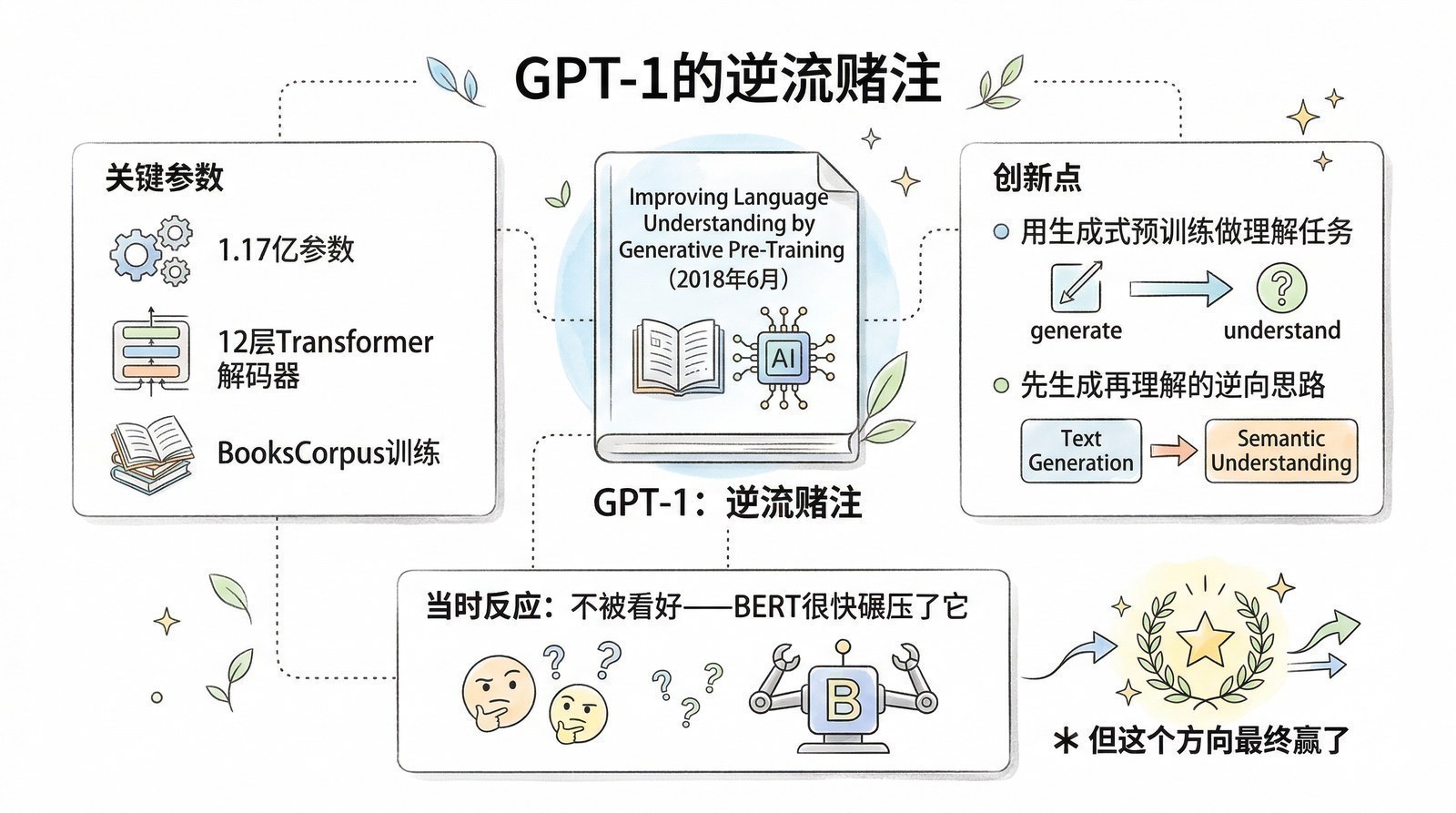

GPT-1:一个"不被看好"的开始

2018年6月,OpenAI的Alec Radford、Karthik Narasimhan、Tim Salimans和Ilya Sutskever发表了《Improving Language Understanding by Generative Pre-Training》[1]——GPT(Generative Pre-Training,生成式预训练)由此得名。

GPT-1的设计极其简洁:12层Transformer解码器,768维隐藏状态,12个注意力头,总参数约1.17亿。训练数据是BooksCorpus——约7000本未出版的电子书,共约8亿词。用8块GPU训练约30天。训练任务只有一个:从左到右预测下一个词——一种最朴素的语句续写训练。

这个选择在当时看起来既大胆又有些"笨"。"预测下一个词"是语言建模中最古老的任务——从1950年代Shannon的信息论就开始了。很多研究者认为这太简单,学不到深层的语言理解能力。更何况GPT-1只用了Transformer的解码器——等于放弃了双向理解能力,只让模型看"左边"的内容。在学术圈看来,这像是一个自我设限的选择。

但GPT-1的结果出人意料:预训练后只需少量微调,就在12个NLP基准中的9个上取得了当时最好的成绩。一个只学了"猜下一个词"的模型,居然能做文本分类、语义相似度判断、问答等一系列不相关的任务。

这暗示了一个深刻的可能性:为了准确预测下一个词,模型被迫学习了远比表面看起来深刻得多的知识。 预测"他去了"后面是什么需要语法知识,预测"医生给病人开了"后面是什么需要语义知识,预测"地球绕着"后面是什么需要世界知识,预测"下雨了但他没带伞所以他"后面是什么需要常识推理。看似简单的续写练习,实际上迫使模型建立了一个关于语言和世界的内部模型。

但在2018年,几乎没人把GPT-1当回事。1.17亿参数,效果还行但不够惊艳。学术圈的注意力很快被另一个名字吸引——因为几个月后,Google的BERT带着一份碾压级的成绩单来了。

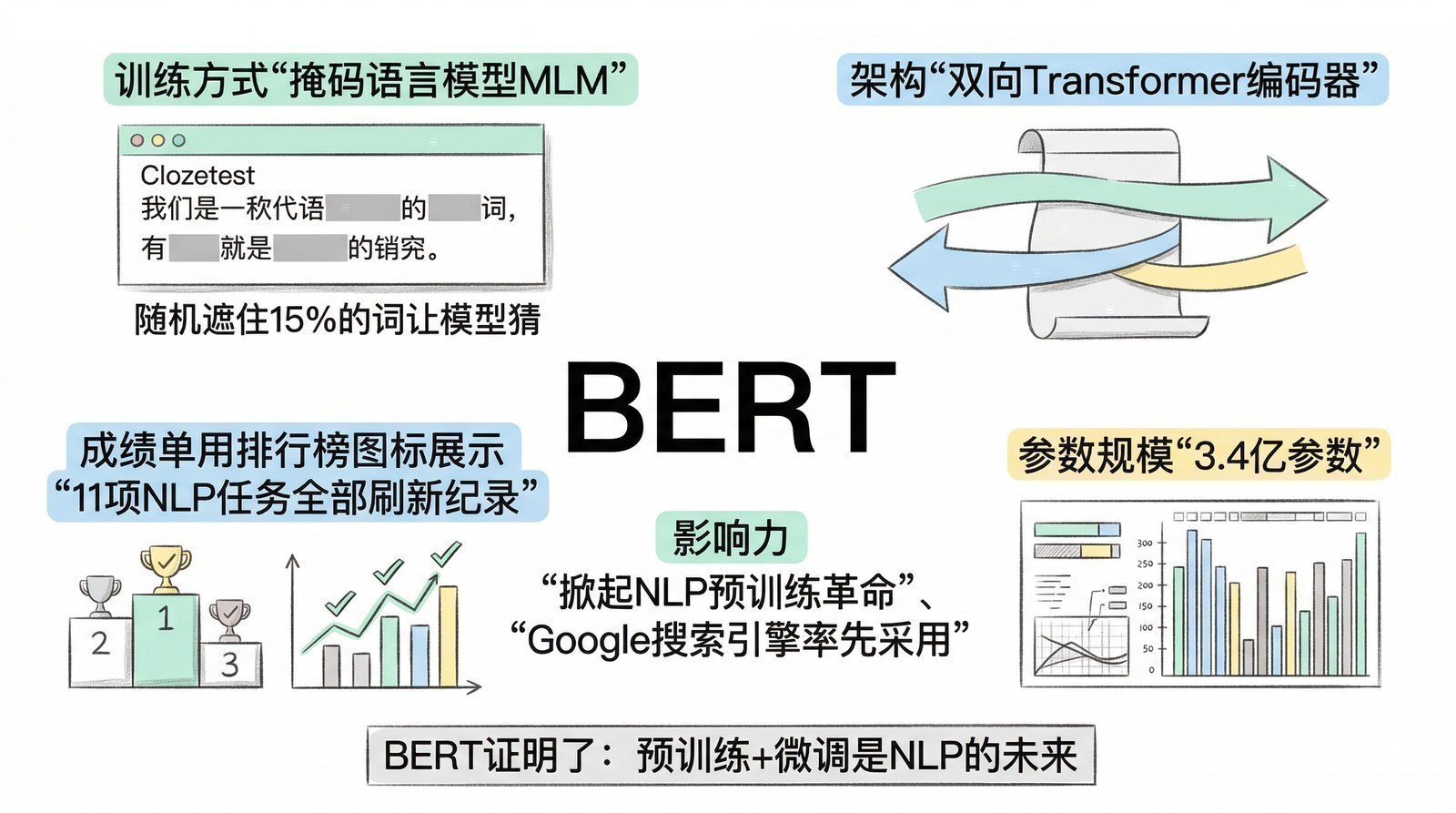

BERT:横扫排行榜的"学霸"

2018年10月,Google的Jacob Devlin、Ming-Wei Chang、Kenton Lee和Kristina Toutanova发表了BERT[2]——Bidirectional Encoder Representations from Transformers。如果说GPT-1是一个不被看好的起步,BERT就是一场碾压式的亮相。

BERT只用Transformer的编码器,核心训练任务是完形填空(论文中叫Masked Language Model, MLM):随机遮住句子中15%的词,让模型根据上下文猜被遮住的是什么。同时还有一个辅助任务——下一句预测(NSP):给两个句子判断第二句是否是第一句的真正后续。

BERT有两个版本:Base(12层,1.1亿参数)和Large(24层,3.4亿参数)。训练数据是BooksCorpus加英文Wikipedia,共约33亿词——比GPT-1的数据量大约4倍。训练用了Google的TPU:16块TPU训练Base模型需要4天,64块TPU训练Large模型也需要4天。

BERT发表后的效果是核弹级的。它在11个NLP基准测试上同时刷新了最佳纪录——GLUE基准(当时NLP最重要的综合评测)上BERT-Large得分80.5,大幅领先之前的最佳成绩。SQuAD问答测试上甚至超过了人类标注者的表现。到2019年7月,基于BERT改进的模型在GLUE上的得分(88.4)已经超过了人类基线(87.1)。

2019年10月,Google宣布在搜索引擎中使用BERT来理解用户查询——这是Transformer首次被部署到影响十亿级用户的产品中。

在2018-2019年,如果你问NLP研究者"GPT和BERT谁更好",绝大多数人会毫不犹豫地回答BERT——效果更好、理论上更合理(双向总比单向强)、在学术界影响更大。GPT-1看起来只是BERT的一个弱化版本。

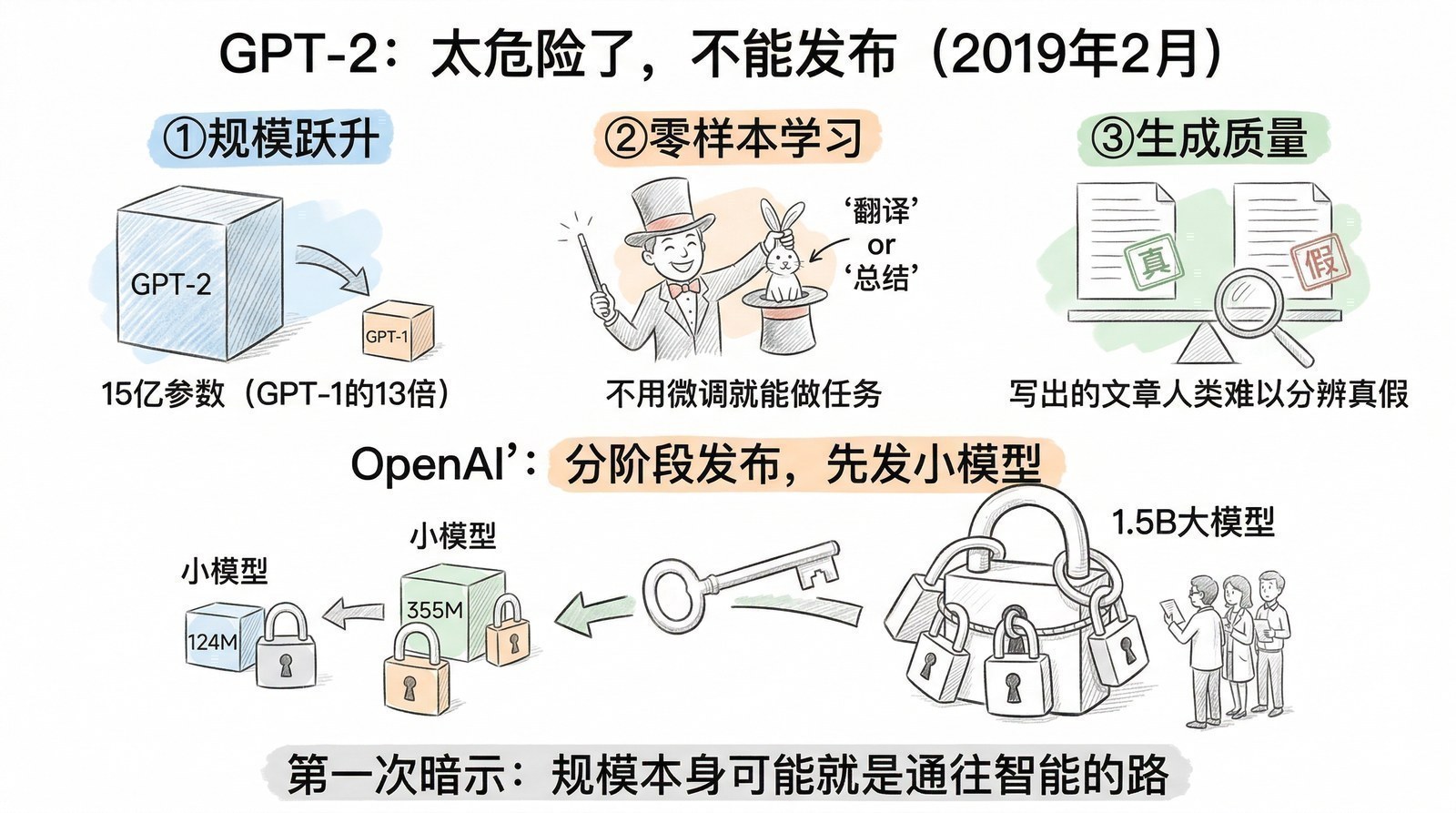

GPT-2:"太危险了,不能发布"

2019年2月,OpenAI发表了GPT-2[3]——论文标题《Language Models are Unsupervised Multitask Learners》本身就是一个大胆宣言。

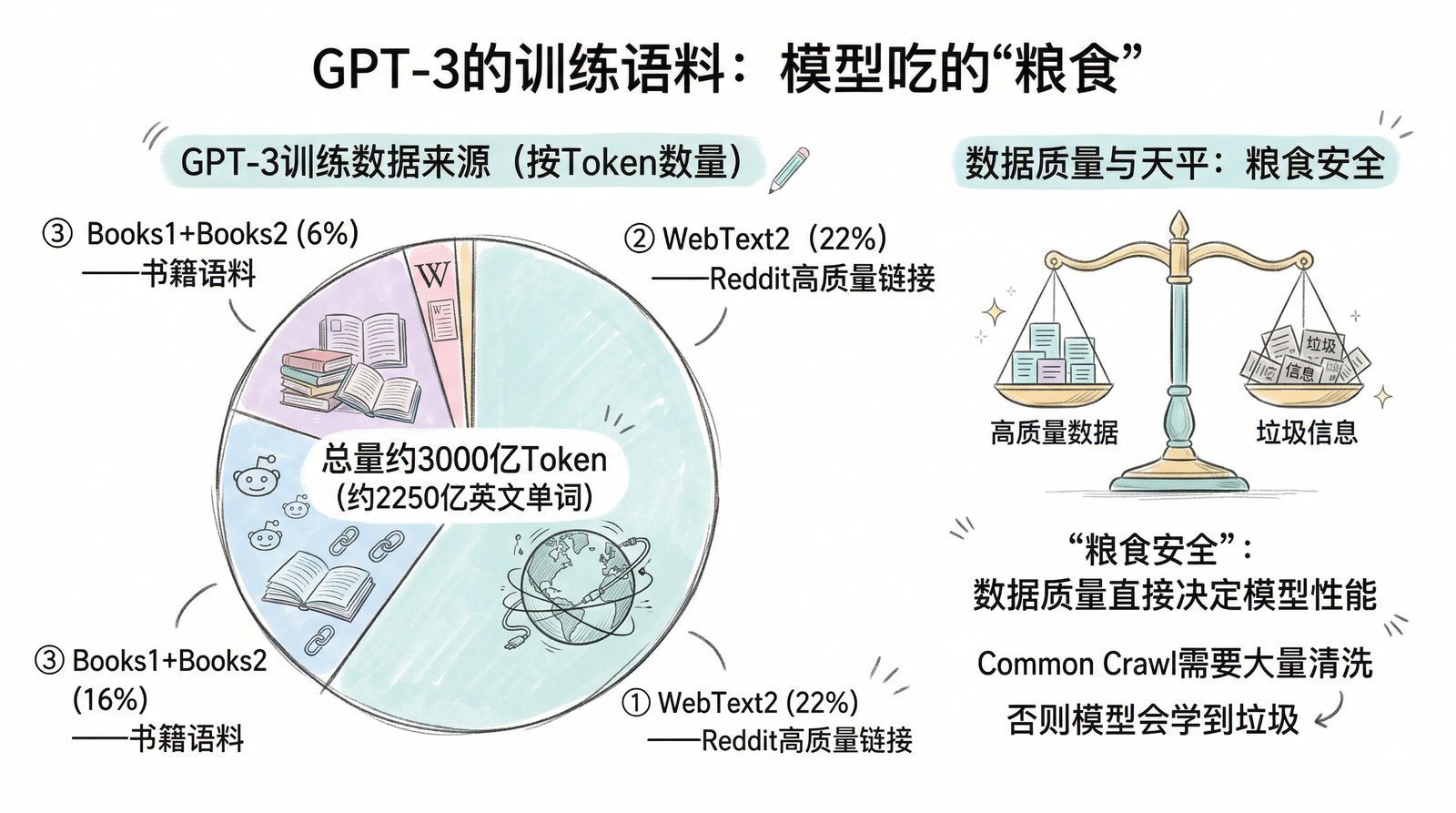

GPT-2是GPT-1的直接放大版:从12层到48层,参数从1.17亿增长到15亿(约13倍),训练数据从BooksCorpus换成WebText——从Reddit上高赞链接指向的约800万网页中爬取的40GB文本。架构完全不变,还是decoder-only Transformer,还是"预测下一个词"。唯一的变化就是更大。

但"更大"带来了质变。

GPT-2生成的文本质量达到了新水平——给一个开头,它能生成连贯、有逻辑、读起来像人写的几段话。更重要的是,它展现了一种GPT-1没有的能力——零样本学习(Zero-shot Learning):在没有对任何特定任务微调的情况下,GPT-2可以直接做翻译、做摘要、做问答——只要把任务描述成"续写"的形式。比如输入"把以下英文翻译成法文:Hello, how are you? →",GPT-2就能"续写"出法文翻译。

零样本学习的意义极其深远——它意味着你不需要为每个任务收集标注数据、训练专门的模型,只需要用自然语言"描述"你想做什么,模型就能理解并执行。这正是后来"提示词工程"(Prompt Engineering)的原型。 今天人们使用ChatGPT时写的每一条提示词,本质上都在利用GPT-2首次展示的零样本能力——用自然语言告诉模型"你要做什么",模型把你的指令当作"开头"来续写"答案"。从零样本学习到提示词工程,是同一种能力的不同表述:模型把所有任务理解为"续写",而你通过设计开头(提示词)来引导续写的方向。

OpenAI因此做出了一个前所未有的决定:以"太危险"为由延迟发布完整模型。 先发布小版本(1.24亿参数),之后分批发布更大版本,完整的15亿参数模型直到2019年11月才公开。这是AI领域第一次因为"模型能力太强"而限制发布,开启了至今仍在持续的AI安全辩论。

胜负已分:为什么GPT赢了未来

到2019年底,排行榜上BERT仍然领先。但GPT-2展示的生成能力和零样本能力暗示了一条BERT走不通的路。

GPT最终赢得路线之争,有三个关键原因。

第一,生成比理解更通用。 BERT能理解但不能创造。GPT能创造——而创造天然包含理解。一个能写出正确答案的模型,必然已经理解了问题;但一个能理解问题的模型,不一定能写出答案。后来ChatGPT把所有任务都统一成了"生成":问答是生成答案,翻译是生成译文,编程是生成代码。

第二,GPT天然适合scaling。 "预测下一个词"极其简单,不需要人工标注,互联网上有近乎无限的文本作为训练数据。而BERT的"完形填空"每次只学习被遮住的15%的词,浪费了85%的计算。当规模从几十亿词扩展到几千亿词时,GPT更容易受益。

第三,GPT路线能"涌现"。 GPT-1只是不错的语言模型,GPT-2开始展现零样本能力,GPT-3(第六章)出现了让研究者震惊的涌现现象。这种"规模增长→新能力涌现"在BERT路线上从未出现过。